神经网络&深度学习记录(一)

Perceptrons

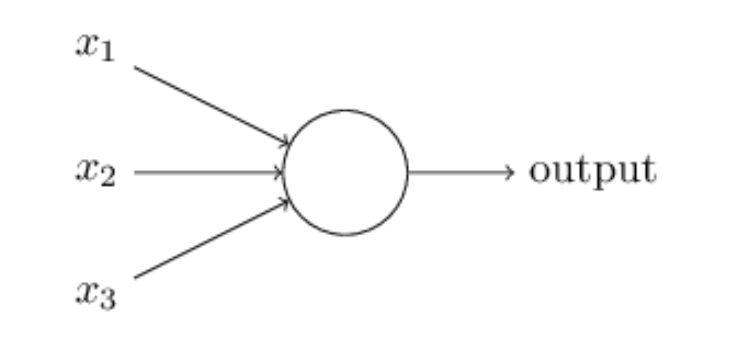

单个Perceptron

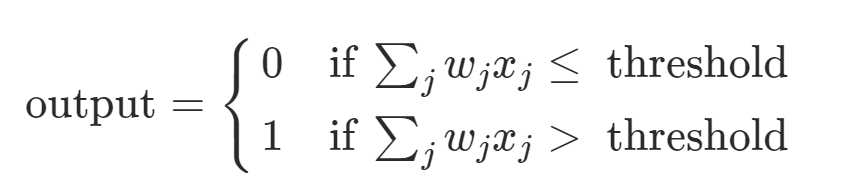

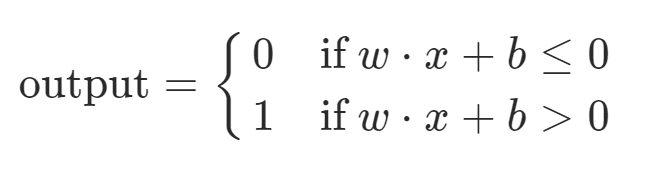

工作原理:接受一系列0/1输入,输出单个0/1。对于每个输入xi,设置有其所对应的权重wi。当∑xiwi ≥ threshold时输出1,反之为0。

用bias = -threshold代换,得到

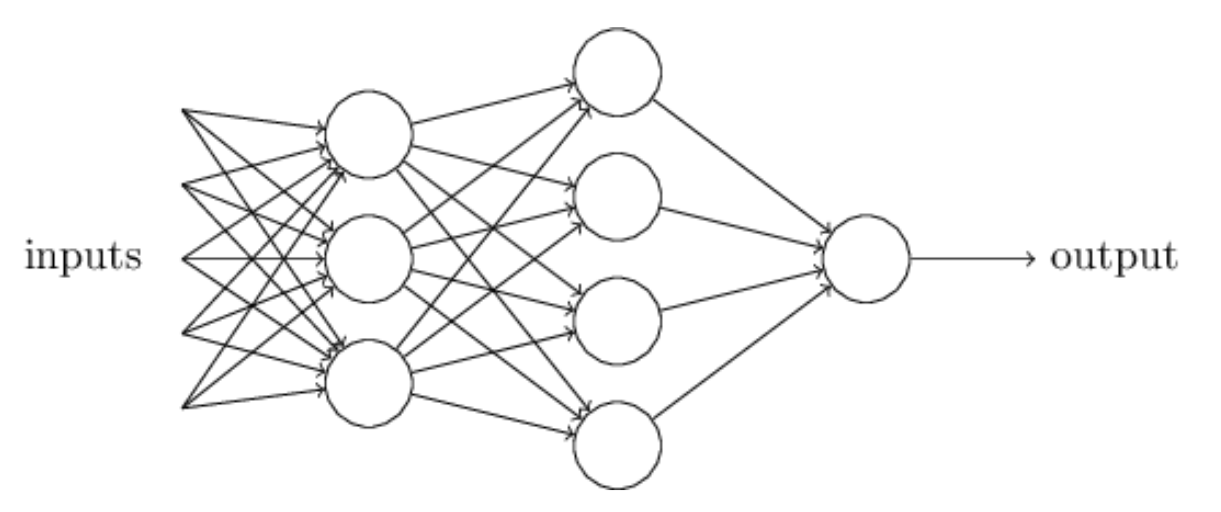

学习算法可以调整各个节点对应的weight和bias,从而模拟决策行为。

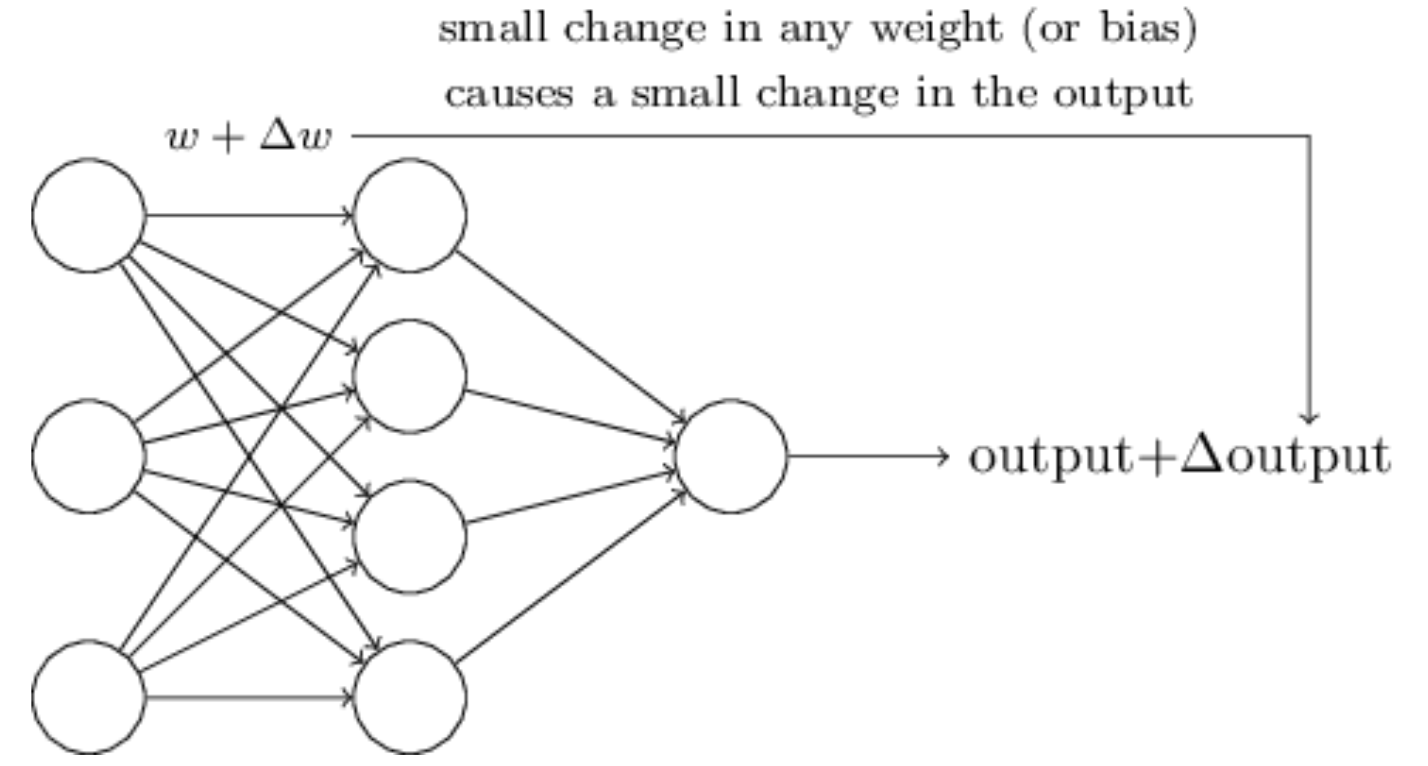

perception 网络

Sigmoid neurons

理想状态

对于学习算法,例如一个识别手写文字图片的算法,假如原网络错误的将“8”识别成“9”,我们希望学习算法能够通过调整weight,来使网络能正确识别。但是这并不会在包含perceptron的网络中发生。对weight的微小改动会造成整个网络的变化。可能对8/9的识别改进,会导致其他数字识别效果的下降。

为此,我们引入sigmoid neuron。

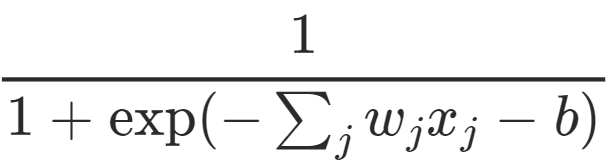

对于sigmoid,其输入xi为区间 [0 , 1] 上的数。而其输出定义为 σ(w⋅x+b), σ为被称作sigmoid function: ![]() 。

。

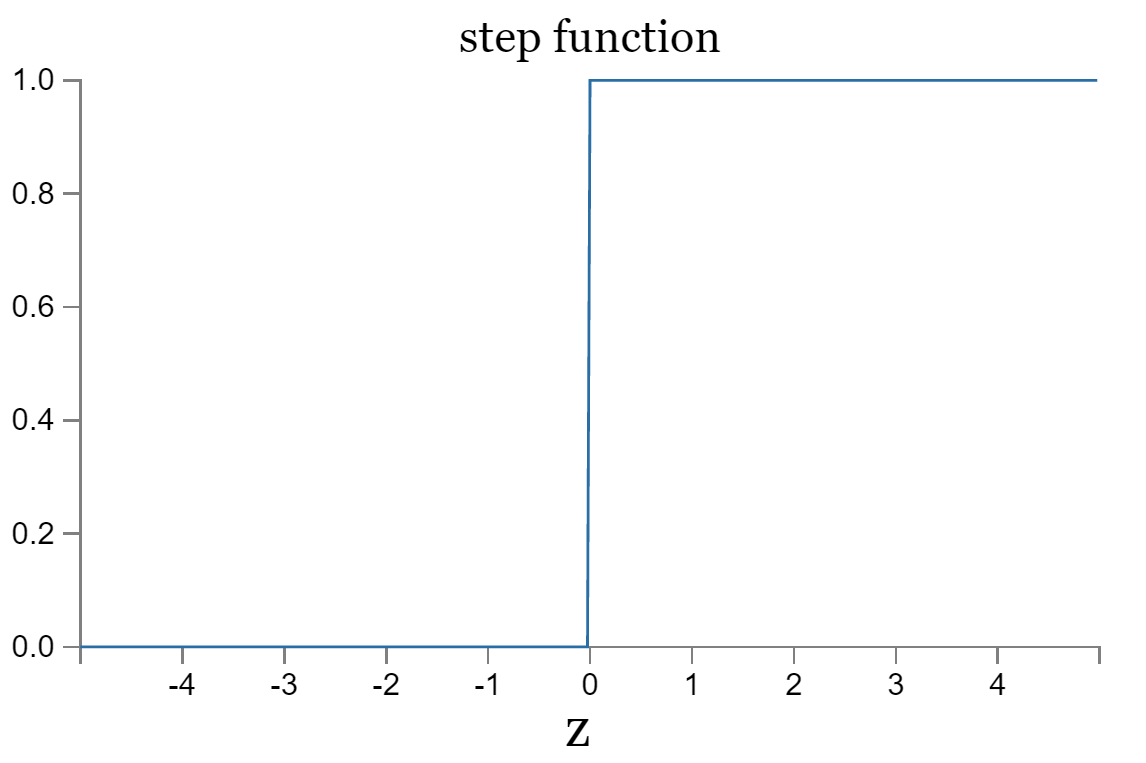

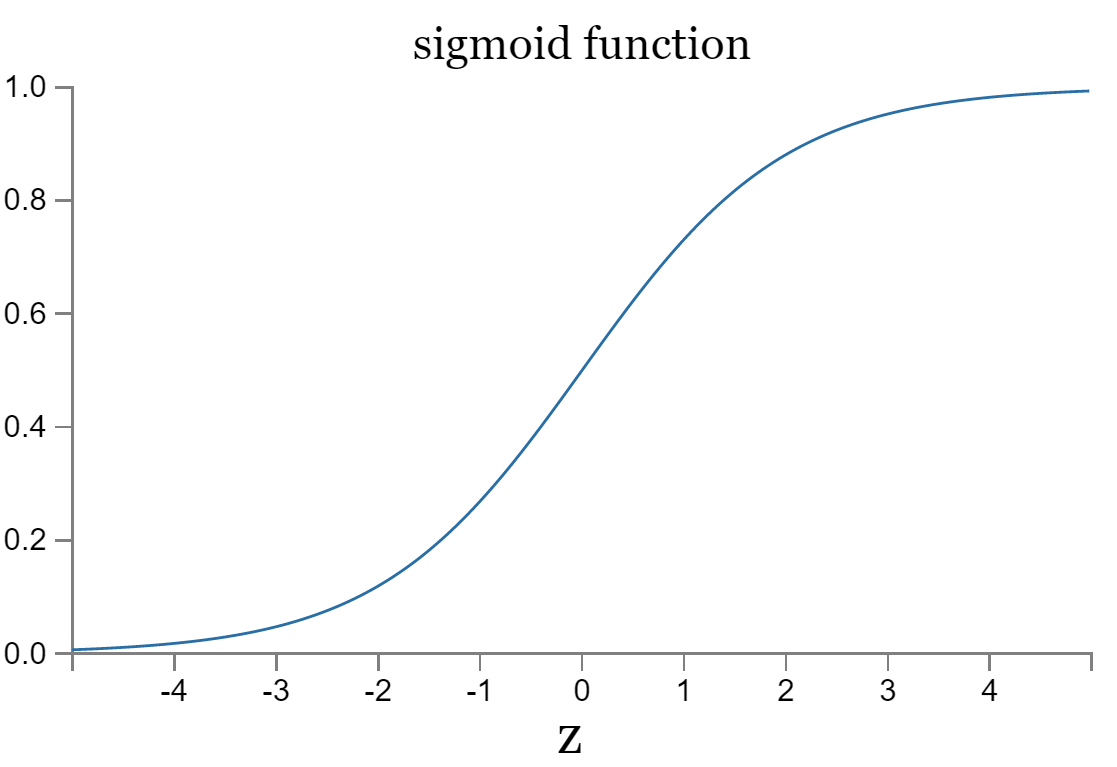

具体化的函数

将原决策函数平滑化,使微调成为可能

如果我们微调bias或weight,那么对于output的影响可以用全微分表示。其意义可以看作Δoutput是Δb & Δw的一个线性函数。线性性质使我们的微调成为可能。

注:自用学习笔记

原文:http://neuralnetworksanddeeplearning.com/chap1.html 作者: Michael Nielsen

浙公网安备 33010602011771号

浙公网安备 33010602011771号