[T.16] 团队项目:Beta 阶段发布说明

| 项目 | 内容 |

|---|---|

| 这个作业属于哪个课程 | 2025年春季软件工程(罗杰、任健) |

| 这个作业的要求在哪里 | [T.16] 团队项目:Beta 阶段发布说明 |

| 我在这个课程的目标是 | 学习软件工程的基础知识,和团队成员们实践各种软件工程的方法与流程,开发一个让我们值得骄傲的项目 |

| 这个作业在哪个具体方面帮助我实现目标 | Beta阶段发布说明 |

Beta版本的新功能和特性

B端应用场景MPA-Agent

C端用户体验平台

用户/租户登录与注册

用户主页

租户下管理的用户

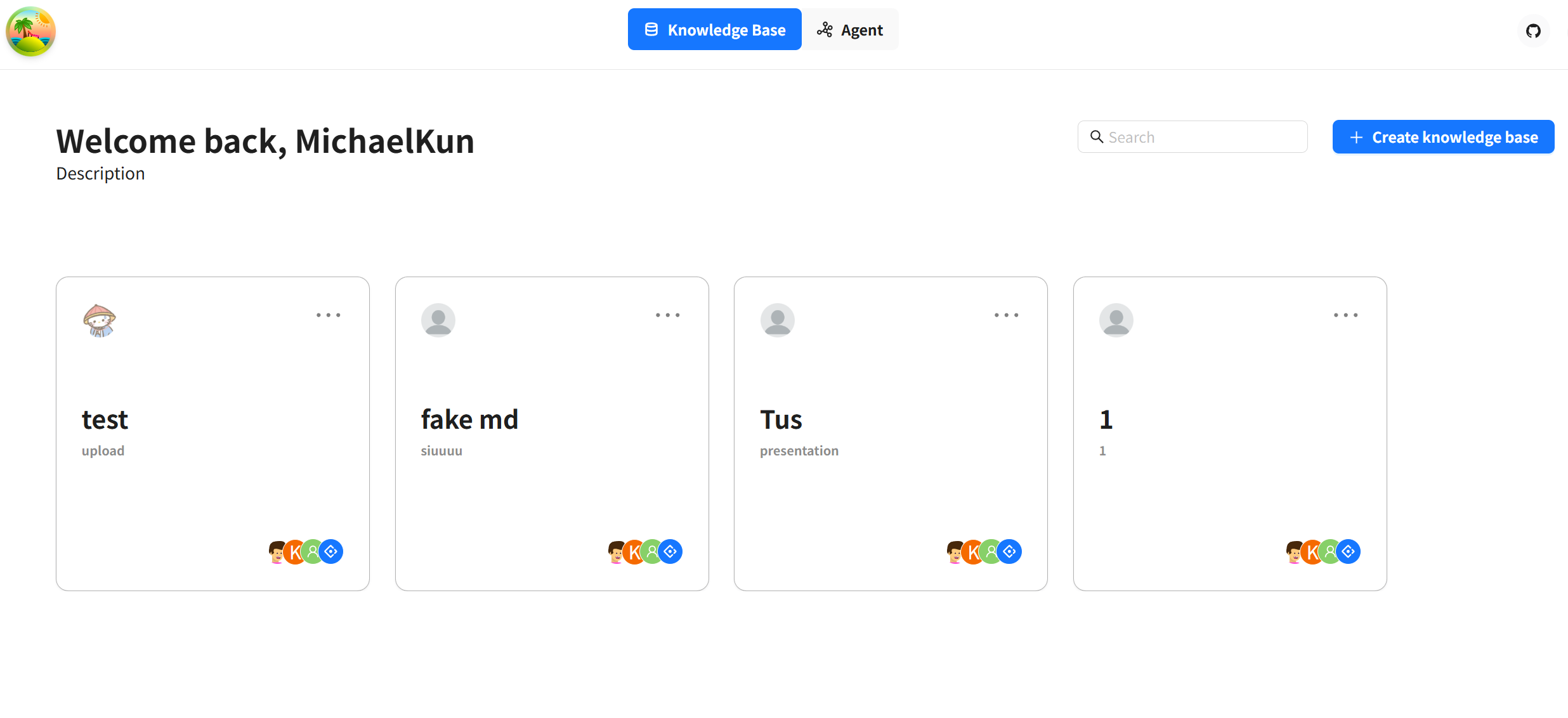

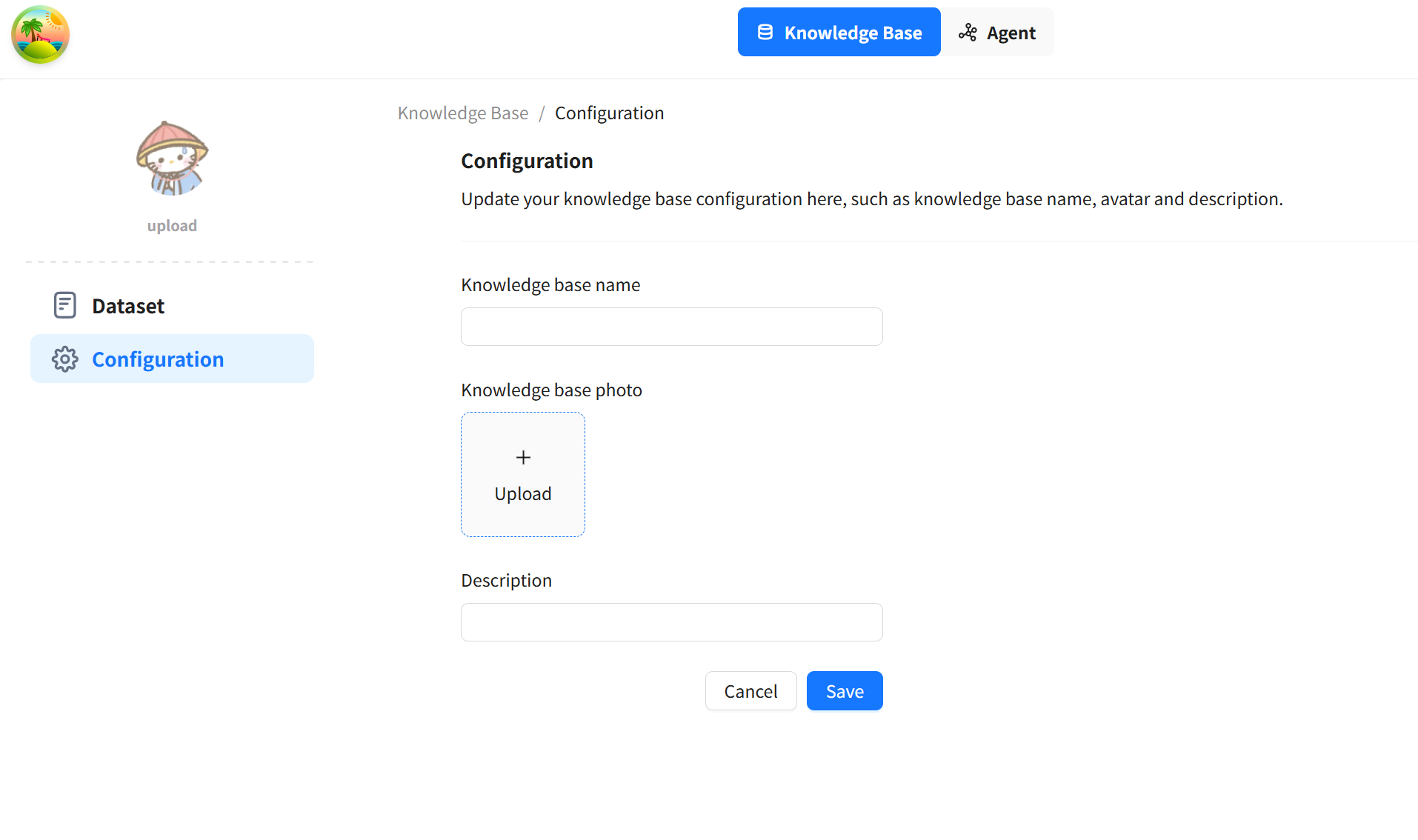

知识库

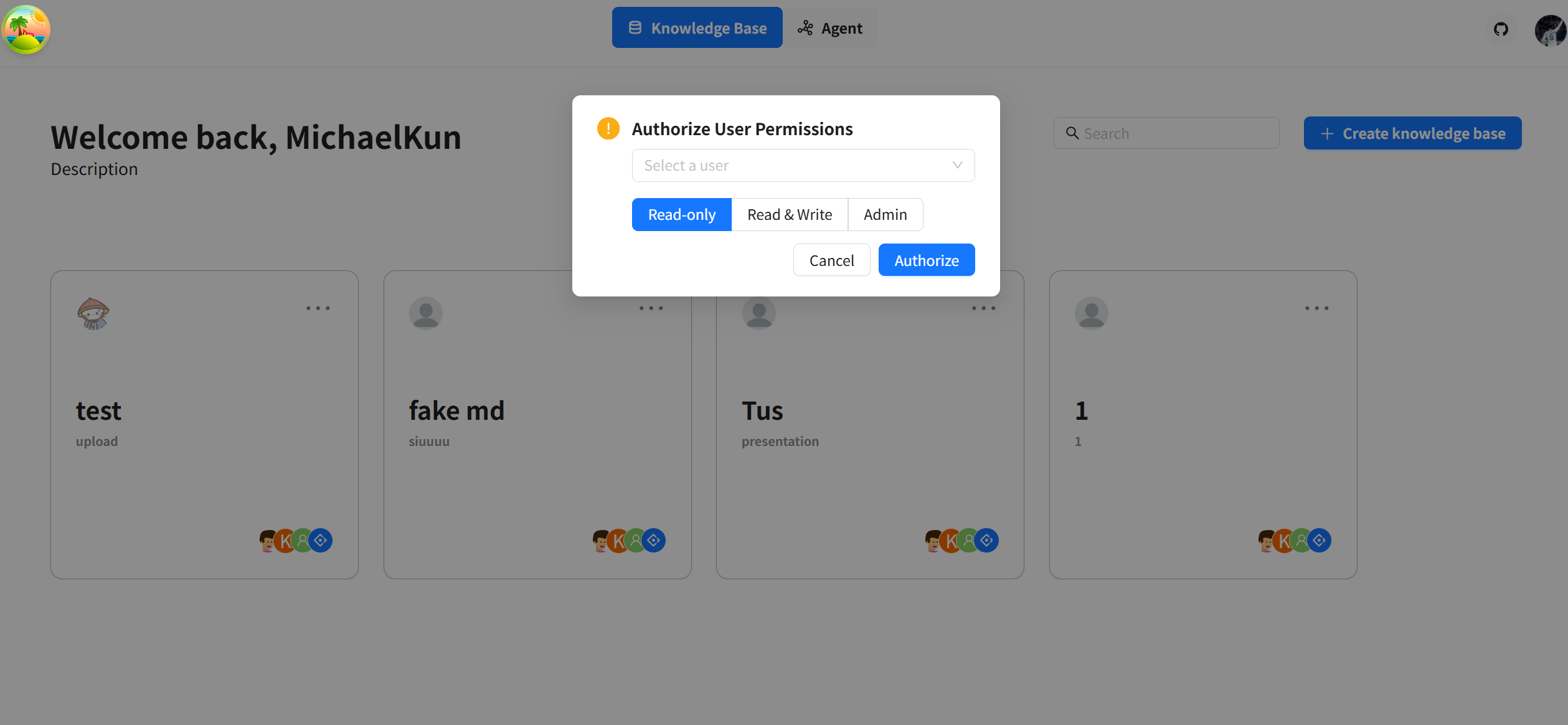

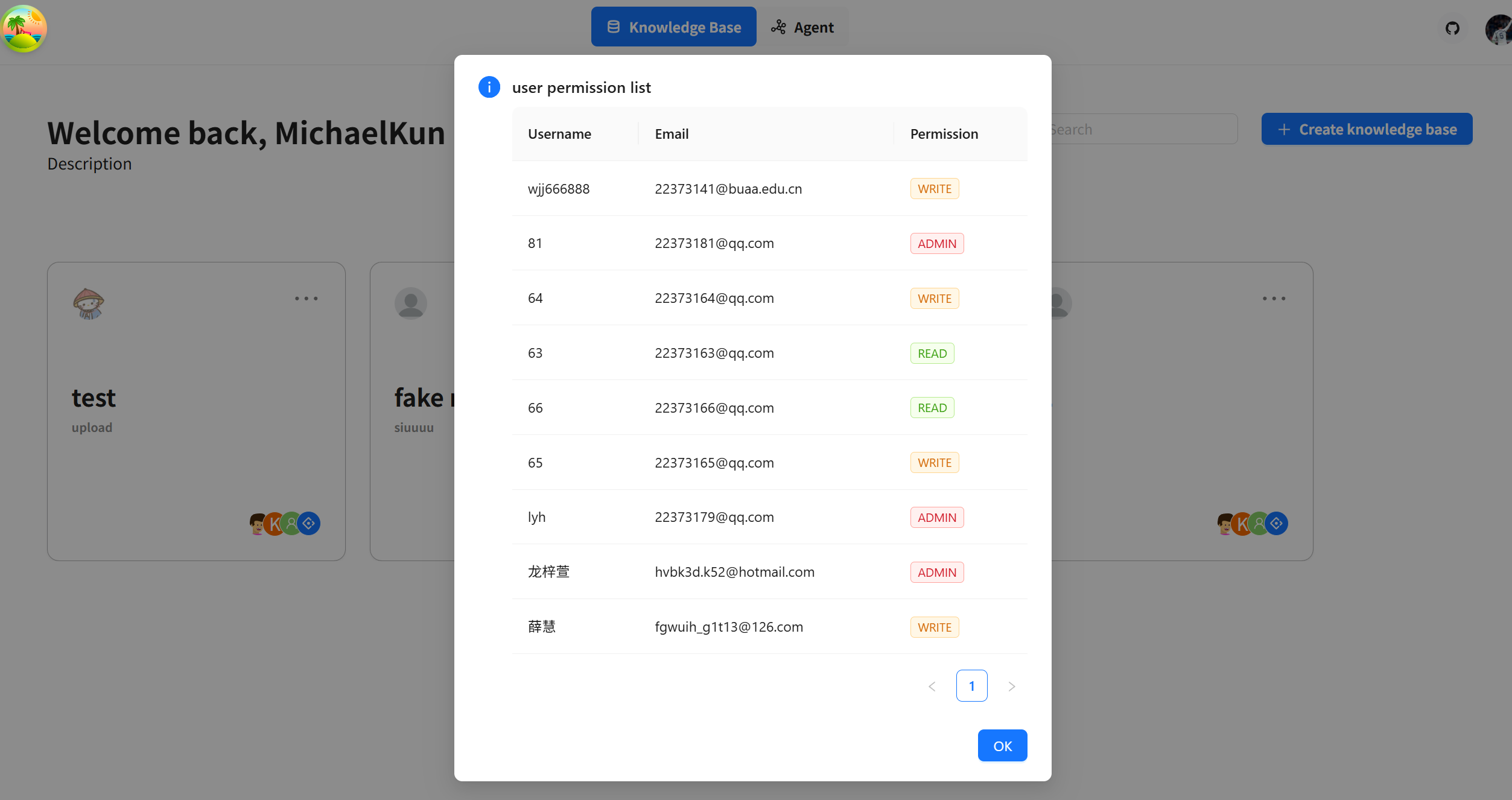

知识库权限管理

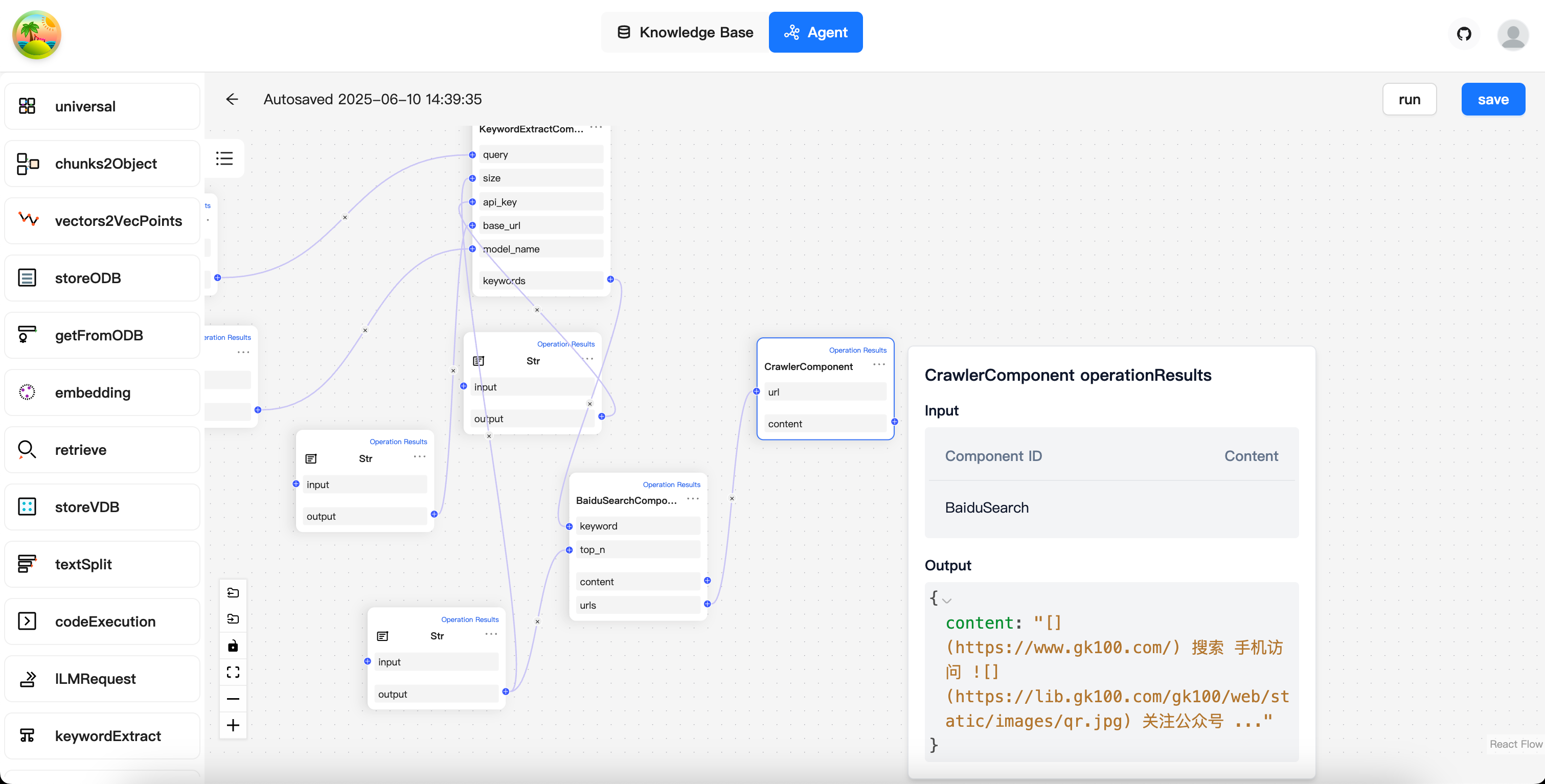

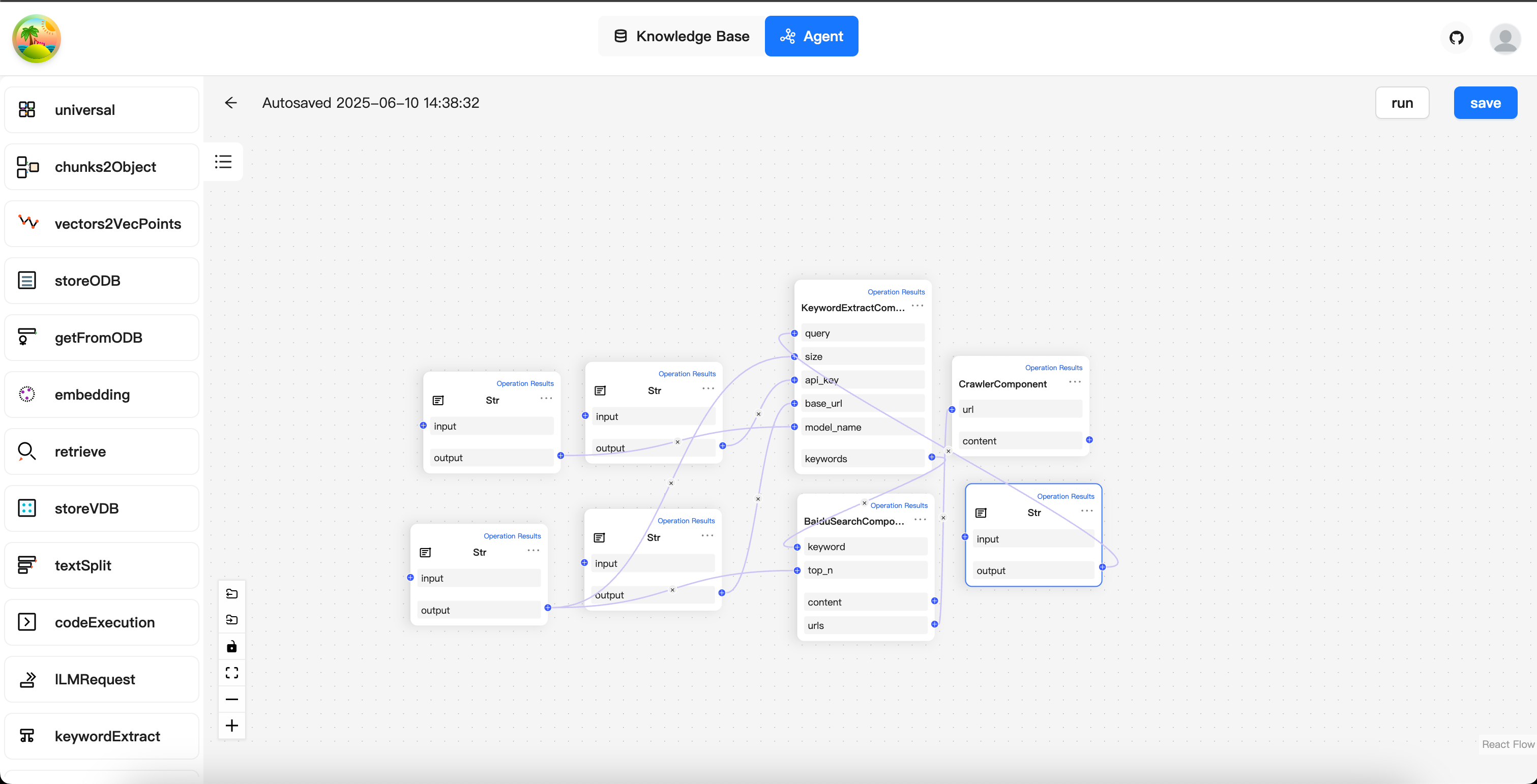

pipeline agent

1.本版本的新功能和特性

实现的新功能与特性

| 功能/特性 | 功能简述 |

|---|---|

| 模块化Pipeline编排 | 支持文档上传 -> 检索 -> 排序 -> LLM生成的完整流水线配置,用户可灵活定义流程以适配不同任务 |

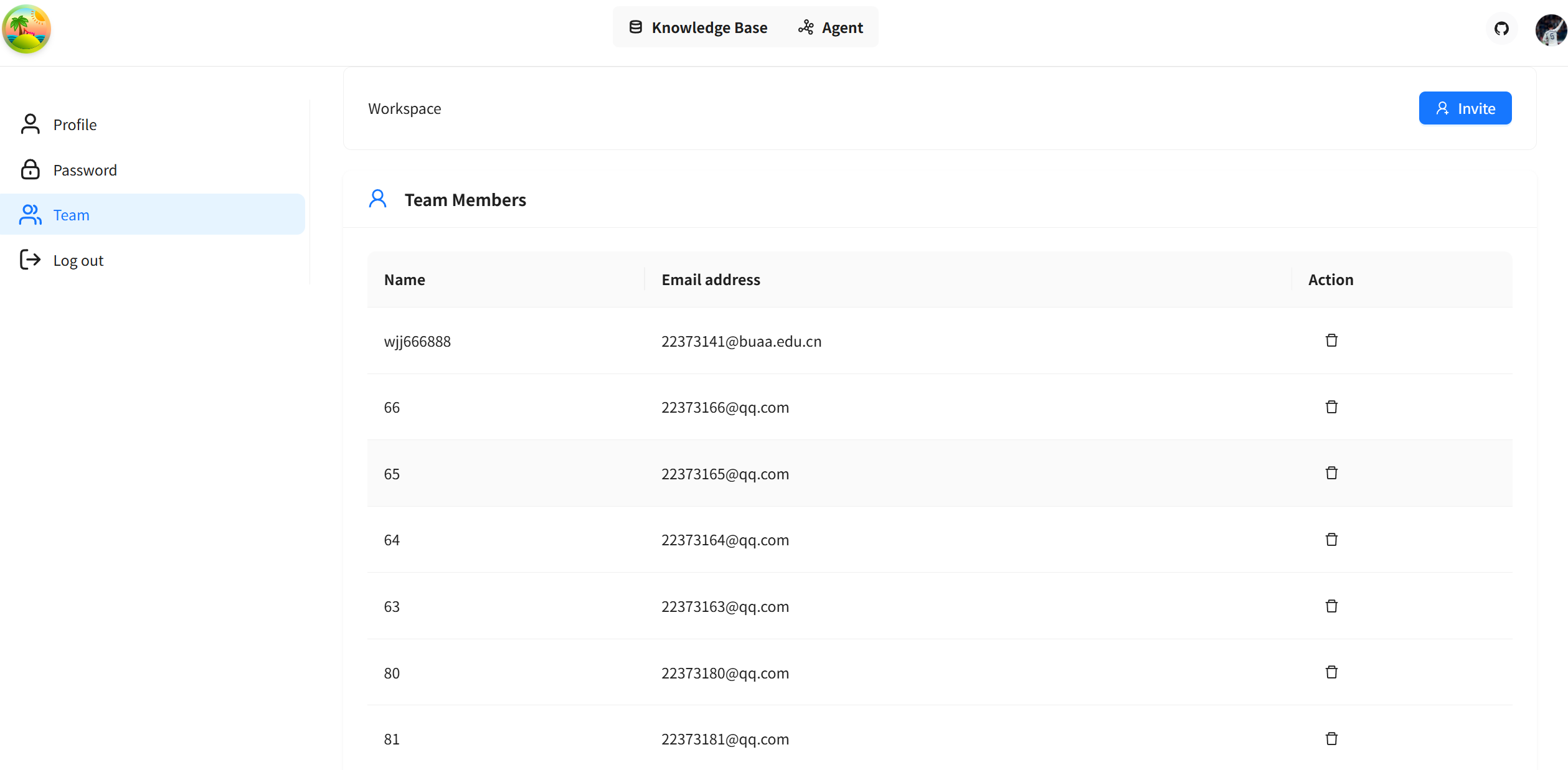

| 多租户私有化部署架构 | 实现企业级多租户数据隔离与权限管理,支持各部门独立构建知识库并共享底层架构资源 |

| 智能问答 + 引用追溯机制 | 每个答案都带有原始文档的引用链接,提升结果透明度与信任度 |

| 低代码知识库构建体验 | 支持用户通过拖拽组件构建知识库与QA流程,不需要用户了解很多背景知识 |

这些功能分别能解决什么样的问题

| 功能点 | 对应用户需求/痛点说明 |

|---|---|

| 模块化Pipeline | 企业和个人用户需要根据自身业务/学习场景灵活定制问答流程;主流平台流程不可控 |

| 多租户部署 | 企业需要对内部不同部门的数据进行隔离;满足数据合规和权限分级管理要求 |

| 引用追溯机制 | 用户对LLM答案不信任,担心生成内容虚构;希望能验证信息来源 |

| 低代码知识构建 | C端用户或非开发者难以快速构建知识库和检索机制;希望“拖一拖就能用” |

2.这些功能与特性的应用场景

场景一:大型企业搭建内部知识助手

某企业的IT部门希望构建一个内部智能问答系统,服务于上万名员工的日常知识查询。他们定制了RAGnarok服务,通过私有化部署和多租户机制为各个事业部分别配置知识库。产品部门上传了大量产品手册,行政部门则导入了规章制度和报销流程PDF。

为了方便集成,企业IT架构师调用RAGnarok的MCP接口协议将问答系统对接到了OA系统。员工在OA中输入“今年加班换调休政策是什么?”系统通过Pipeline调用文档检索和排序模块,找到匹配文档,最后由LLM生成可引用回答。

场景二:学生使用RAGnarok查文献、做题复习

小林是一位考研英语的学生。他常常被阅读理解的选项迷惑,希望有一个可以解析答案和讲解技巧的工具。他注册了RAGnarok账号,将历年真题和阅读题打包上传后,构建了自己的“英语题库知识库”。

每当遇到难题,小林就在界面中输入“第15题为什么选B?”系统通过Pipeline流程从题目材料中抽取内容,再由LLM生成答案,解释为何其他选项错误。引用机制让小林可以看到解析来源。

随着使用次数增加,系统会根据他的答题记录和知识偏好,智能推荐相似题目。小林省去了整理材料、到处搜索资料的时间,学习效率大幅提升。

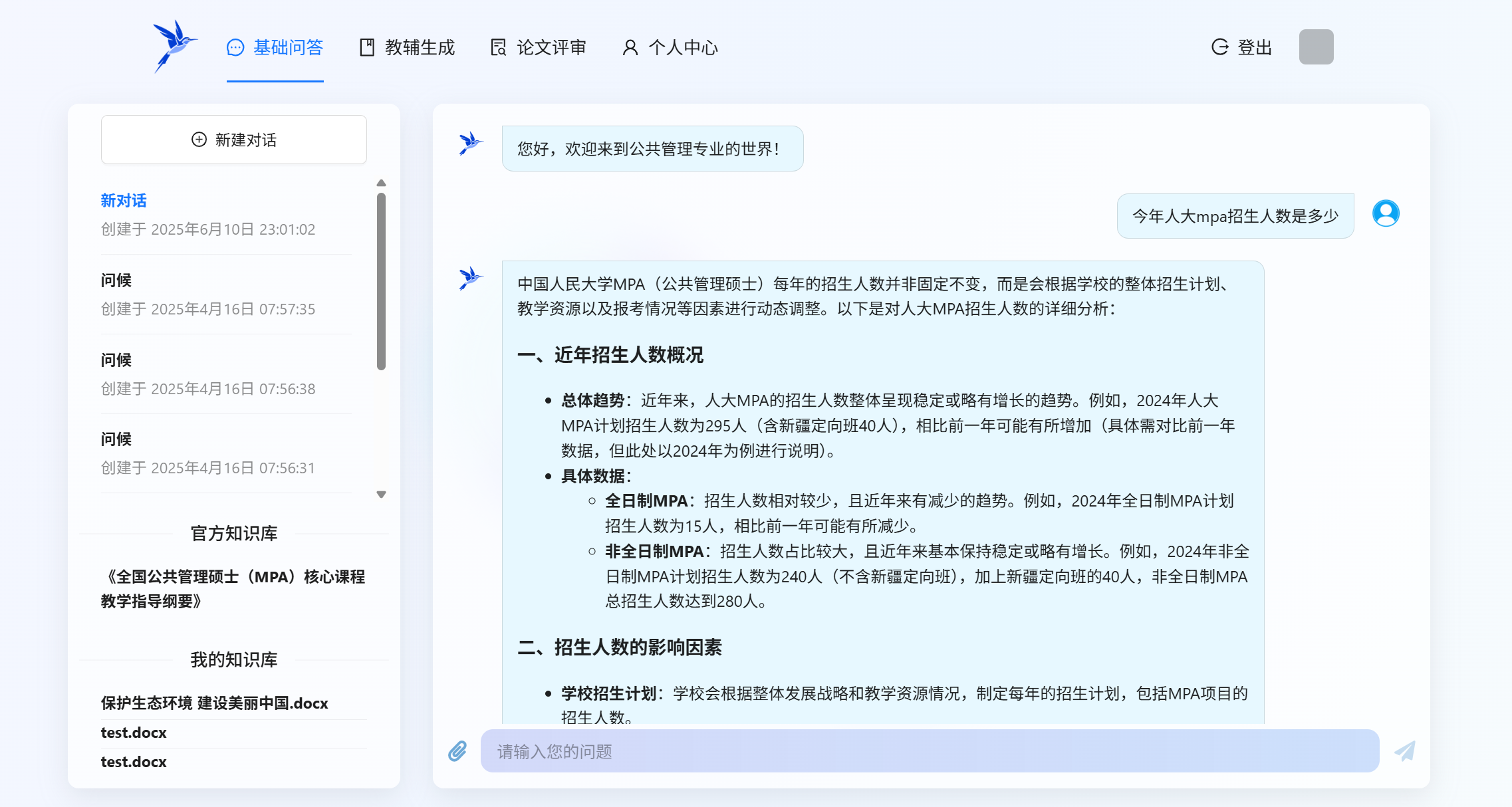

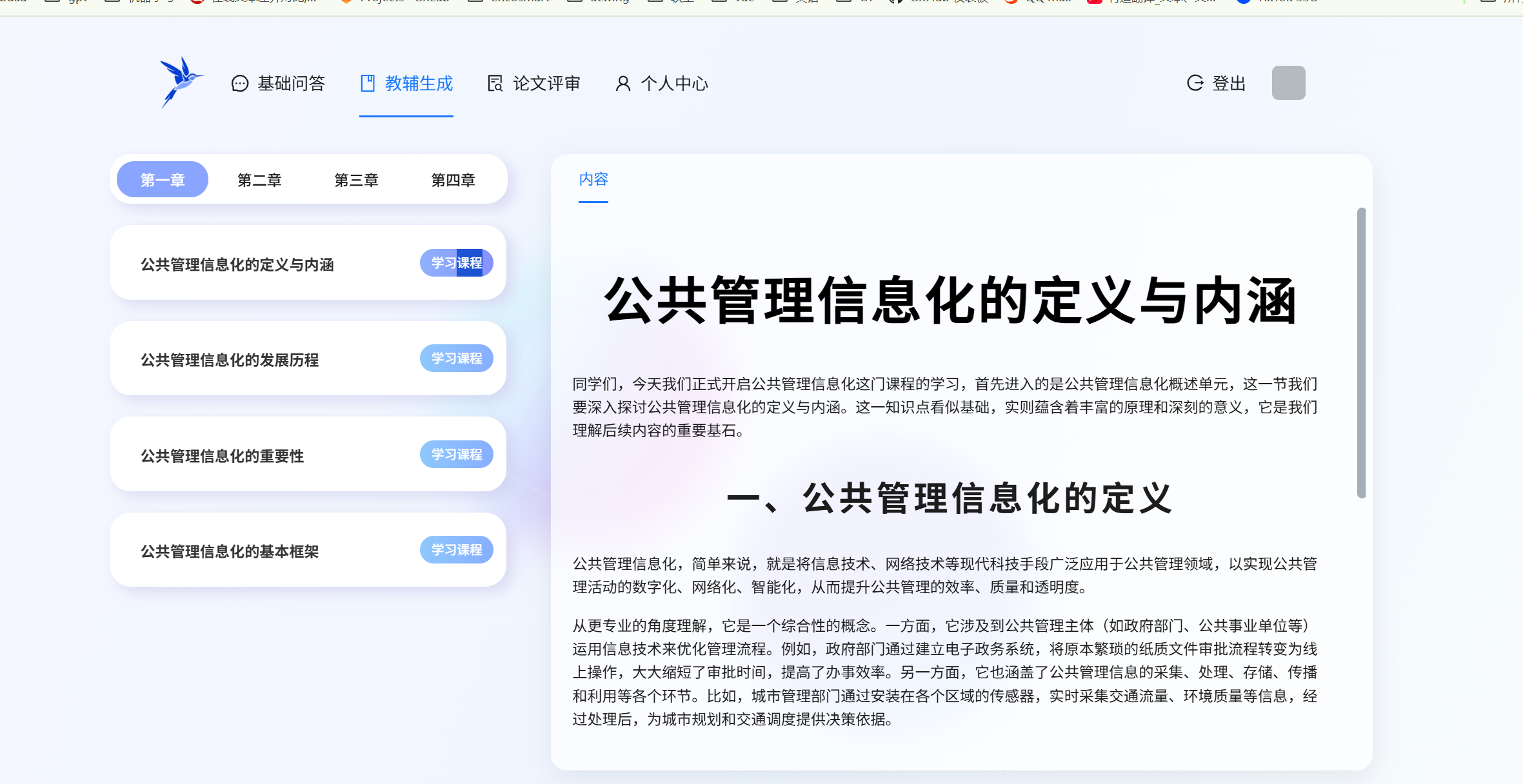

场景三:MPA-Agent系统服务多个行业

一个教育公司希望将智能技术应用于K12教学、企业内训和论文评审。他们基于RAGnarok开发了“MPA-Agent”:一个集基础问答、教辅生成、论文初审三大模块于一体的多功能平台。

每个模块都通过独立的流水线配置构建问答流程。例如,论文评审模块接收Word文件后,系统自动调用句法分析器和审校LLM模型,对语言风格、格式规范进行初步审查并给出建议。

启明教育通过多租户机制区分内部员工和外部合作伙伴的数据使用权,保障数据隔离的同时,快速迭代内容与服务模式,赢得了多个教育机构的合作机会。

3.总结:如何满足典型用户需求?

| 用户类型 | 核心需求 | RAGnarok的满足方式 |

|---|---|---|

| B端企业 | 系统集成、数据隔离、权限审计 | MCP协议、多租户部署、权限管理、Pipeline编排 |

| C端个人 | 简便易用、答案准确、学习辅助 | 开箱即用UI、引用机制、个性化知识库与推荐 |

| 教育行业 | 教辅内容生成、智能评审、模块灵活调用 | 多模块配置、语义理解优化、结构化审阅链 |

4.团队努力与实际效果

团队在Beta版本发布期间:

- 技术团队完成了Retriever优化、异步推理链完善、模块联通与链路打通;

- 用户团队针对B端用户场景进行个性化设计并建立C端用户群,收集反馈进行产品优化;

- 特别关注UI/UX简洁性设计,实现“零学习成本”的上手体验。

实际上线后,RAGnarok应对多种应用场景都能够很好地满足要求,具有高灵活性,进一步验证了RAGnarok在多行业、跨人群中的适应力与可扩展性。

这一版本修复的缺陷

1.之前存在怎样的缺陷?会带来什么样的负面体验或造成什么样的负面影响?

拖拽式组件画布部分实现困难

点击运行按钮后用户很难知道Pipeline的运行进度、运行情况

- 负面影响:

- 用户需要频繁点击pipeline中的结点来查看输出情况

Retriever 与向量库接口性能问题

Retriever组件与底层向量库接口存在效率瓶颈,检索速度慢,延迟较高。

-

负面影响:

- 对企业用户来说,文档问答响应时间长,影响系统在客服和内部知识检索中的实用性。

- 对个人用户来说,知识问答的交互不流畅,容易导致用户流失或降低使用体验。

LLM 推理链处理过程不稳定

异步处理能力不足,推理链中间环节出错率高,影响整体问答成功率。

- 负面影响:

- 导致部分提问无法返回结果或结果不完整,影响用户对系统可信度和满意度。

- 无法支持高并发问答请求,限制了产品的扩展性和业务接入能力。

系统模块联通性差

从“文档上传”到“问答生成”的链路不够通畅,出现模块间调用失败或信息丢失的情况。

-

负面影响:

- 阻碍B端企业用户搭建完整问答流程;

- 降低C端用户自建知识库后的系统响应质量;

- 增加运维人员介入成本。

2.这次通过什么样的方式解决了这样的问题?在新版本中原本存在问题的地方现在是什么样的?

在Beta阶段,团队对以上问题进行了系统性修复与优化:

运行状态可视化

结点运行完成后边会变成红色

- 修复效果:

- 将运行状态体现在pipeline的外观上,提升用户体验

优化 Retriever 与向量库接口

改写底层数据访问逻辑,引入批量检索与缓存机制。

-

修复效果:

- 检索速度显著提升;

- 支持大规模文档库下的秒级响应;

- 实现更平稳的问答体验。

完善异步处理与推理链机制

引入异步执行队列与超时恢复策略,增加日志追踪点。

-

修复效果:

- 推理过程更稳定,出错率降低;

- LLM调用并发能力增强;

- 可监控的流程链路为调试与维护提供支撑。

打通模块联通链路

重新设计模块间的数据格式与接口标准,确保文档 → 检索 → 问答的闭环完整。

-

修复效果:

- 各模块联动顺畅,用户上传文档后即可无缝使用问答功能;

- B端企业可快速搭建完整流水线;

- 显著减少因接口报错造成的功能中断。

3.修复后的产品状态总结

- RAGnarok在Beta阶段已实现:模块稳定互通、推理快速准确、界面简洁高效。

- 支持从文档上传到智能问答的全链路打通;

- 同时兼顾企业级场景的安全与权限管理,以及个人用户的轻量化使用需求;

- 能够丝滑适配多种B端应用场景,显示出较高的稳定性与应用广度。

对运行环境要求

1.对客户端运行环境

| 项目 | 要求说明 |

|---|---|

| 系统平台 | 支持 Windows 10/11、macOS Monterey/Ventura、Ubuntu 22.04 |

| 浏览器类型与版本 | 推荐使用最新版 Chrome、Edge、Safari、Firefox,兼容主流浏览器内核 |

| 网络要求 | 建议连接稳定的网络,便于加载文档与发送请求 |

| 分辨率与适配 | 支持 1080p、2K、4K 屏幕分辨率,已完成响应式适配测试 |

| 接口兼容性 | 支持通过 MCP 协议与外部系统集成,如知识库平台、认证系统等 |

2.对企业私有部署环境要求

| 要求类别 | 配置说明 |

|---|---|

| 操作系统 | Ubuntu 22.04 推荐,兼容 CentOS 7+ / Windows Server / macOS(开发测试环境) |

| 硬件配置 | 最低:8GB RAM + 双核 CPU;推荐:16GB RAM + 四核 CPU;高负载支持:32GB RAM + 八核 CPU |

| Python 版本 | Python 3.10 及以上,使用uv进行项目的环境管理 |

| 部署方式 | 支持本地 Docker 部署、云端部署等 |

| 依赖服务 | Docker / Redis / PostgreSQL 等支持组件需预装 |

安装与使用方法

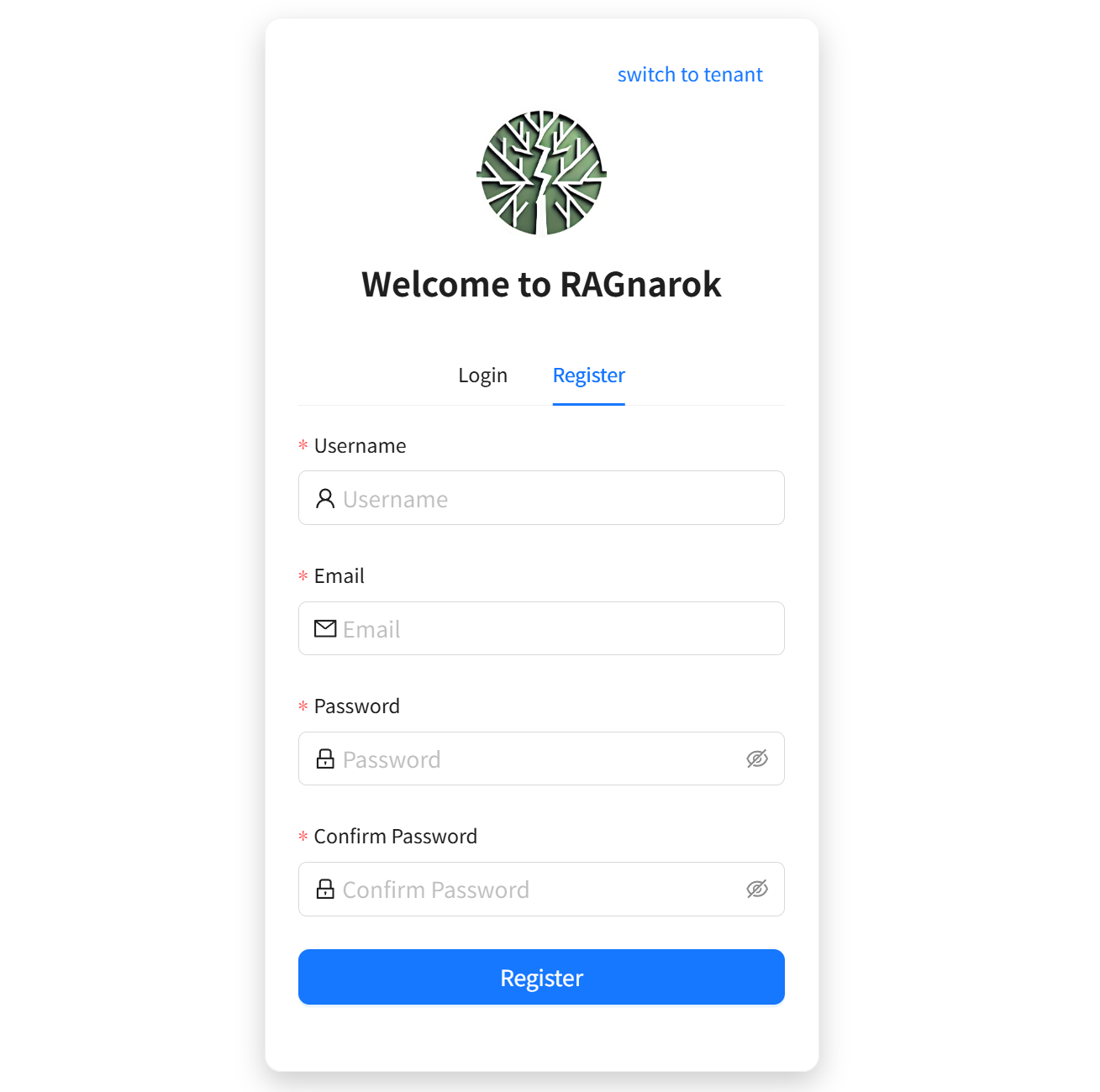

个人用户(Web端)

- 打开官网注册账号

- 创建个人知识库并上传文档(支持拖拽)

- 在界面中输入问题,即可获得AI回答

企业用户(部署)

- 克隆RAGnarok项目

- 按文档配置启动服务

- 登录后台上传企业文档,配置Pipeline

- 设定权限、开启服务

系统已知的问题和限制

当前发布版本的已知但不计划在本版本修复的问题

1. Retriever 与向量库性能问题

- 问题表现:在高并发查询或大型知识库检索场景下,向量库响应较慢或资源占用较高。

- 触发条件:上传大量文档后进行连续问答或检索,或多个用户并发访问系统时。

- 规避/缓解方法:

- 推荐在企业部署中为 Qdrant/向量库服务配置独立高性能节点。

- 临时通过限制上传文档数量或控制并发量缓解性能压力。

- 对索引构建进行定期维护,避免向量碎片积累。

2. LLM 推理链异步处理不稳定

- 问题表现:在高负载下可能出现 LLM 返回慢或生成中断的情况,尤其在多用户同时提问时。

- 触发条件:异步调用链路未充分优化,特别是在网络或计算资源紧张环境下。

- 规避/缓解方法:

- 用户端避免一次性并发发起多个复杂问答请求。

- 建议在部署时开启 LLM 负载均衡机制或将生成部分部署于独立服务。

当前发布版本的已知限制条件及应对方式

1. 文档上传格式支持有限

- 限制说明:当前系统支持 PDF、word、txt,但尚未全面支持 Office 文档和Markdown。

- 规避方法:

- 建议用户将 Markdown/Excel 文件转为 PDF 后上传。

- 使用文本类笔记整理关键知识进行上传。

2. MCP 协议对接需使用者具备一定技术背景

- 限制说明:MCP 协议用于对接企业系统,当前版本对使用者的后端系统开发能力有一定要求。

- 规避方法:

- 提供参考接入文档,需企业技术人员参与接入过程。

- 后续可通过发布图形化集成界面进一步降低门槛。

发布方式以及发布地址

B端应用场景MPA-Agent:一款多功能智能代理系统

在线访问地址:https://www.gpapers.cn/

B 端用户部署方式(支持私有化与深度集成)

企业用户或开发者如需进行私有部署、定制功能或二次开发,请访问我们的 GitHub 仓库获取完整源码与部署说明:

GitHub 项目地址:https://github.com/RAGnarok-dev/

项目内附带详细的部署文档,涵盖:

- 后端与前端服务部署说明

- 多租户与私有部署配置

- 模块化组件启用与禁用方法

- 数据库与模型服务初始化流程

C 端用户访问

RAGnarok 系统的前端已部署并开放访问,用户可以直接通过以下地址使用智能问答平台:

在线访问地址:http://81.70.198.42/

浙公网安备 33010602011771号

浙公网安备 33010602011771号