[T.11] 团队项目:Alpha 阶段发布说明

| 项目 | 内容 |

|---|---|

| 这个作业属于哪个课程 | 2025年春季软件工程(罗杰、任健) |

| 这个作业的要求在哪里 | [T.11] 团队项目:Alpha 阶段发布说明 |

| 我在这个课程的目标是 | 学习软件工程的基础知识,和团队成员们实践各种软件工程的方法与流程,开发一个让我们值得骄傲的项目 |

| 这个作业在哪个具体方面帮助我实现目标 | Alpha 阶段发布说明 |

一、本版本的功能与特性

功能演示

注册

登录

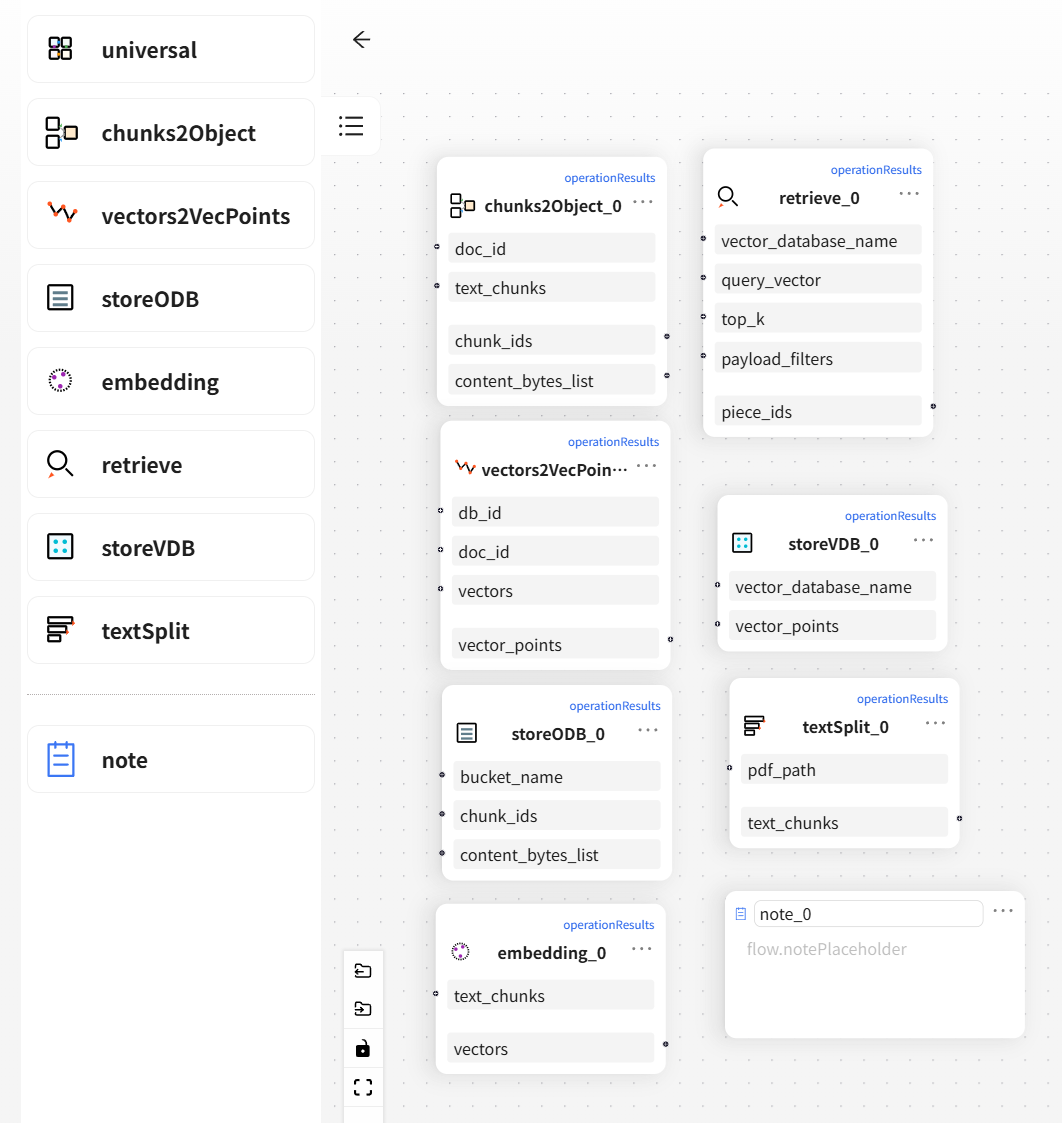

低代码pipeline组件

用户上传知识库文件

新建pipeline

点击运行pipeline

MCP协议简化与B端用户现有系统的集成工作

功能与特性总览

| 功能/特性名 | 解决的问题 | 应用场景简介 |

|---|---|---|

| 模块化Pipeline编排 | 不同业务场景需要灵活配置问答流程 | 企业或个人按需配置处理流程 |

| 多租户架构支持 | 各部门/用户知识库隔离,保障数据安全性 | 企业内部各部门共用一套问答系统 |

| MCP协议双向集成 | 接入外部系统或暴露知识库服务能力困难 | 与OA、CRM等企业现有系统对接 |

| 权限分级与审计日志 | 企业需进行合规操作记录与权限管理 | 管理员设定谁可访问/上传哪些文档 |

| 开箱即用可视化界面 | 非技术用户难以配置RAG流程 | 个人用户上传PDF一键问答 |

| 引文追溯与知识库引用展示 | 回答可信度低,无法验证来源 | 用户查看答案出处,提升信任 |

| 推荐机制与个性化知识库 | 用户重复提问,效率低 | 根据提问记录推荐内容,逐步构建知识体系 |

场景讲述法描述应用场景

B端企业用户:企业智能问答助手构建故事

老王是某大型制造企业的IT负责人,公司员工需频繁查询操作规范、制度流程,但资料分散在多个系统中。为提升效率,老王使用 RAGnarok私有部署 系统:

- 上传企业内部制度文档

- 用 模块化Pipeline 配置:文档解析 → 检索匹配 → 回答生成

- 用 MCP协议 与企业OA系统联动获取实时人事制度

- 启用 多租户机制,各部门上传独立文档、权限隔离

- 使用 运维调试工具 监控性能

效果:员工提问「请假制度」,系统返回简洁政策摘要与出处,提升效率90%,大幅减少IT负担。

C端个人用户:智能学术助手使用故事

小李是高校研究生,常需撰写综述。她通过RAGnarok平台上传文献、笔记,查询术语定义、总结段落:

- 使用 可视化界面 上传PDF

- 系统通过RAG流程检索关键内容,返回总结及出处

- 小李收藏答案并将其标记

- 系统基于提问习惯优化后续推荐

效果:小李用RAGnarok生成初稿摘要,效率提升3倍,文献组织更清晰。

二、本版本修复的缺陷

| 原始问题 | 负面影响与必要性说明 |

|---|---|

| 用户上传不同格式文档后解析失败 | 多文档场景易出错,影响系统稳定性与用户信任 |

| 权限机制不完善,导致不同租户数据混淆 | 数据泄露风险高,企业用户拒绝使用 |

| 知识库引用显示不完整,回答缺乏溯源 | 用户无法信任AI回答内容,特别是学术或合规场景 |

修复方式与效果

- 统一文档解析接口:引入自动格式识别与格式转换模块,支持PDF/HTML/TXT,确保无格式失败

- 多租户机制优化:每个租户配有独立命名空间和Token认证机制,文档与回答完全隔离

- 引用链路增强:所有回答附带文档标题、段落位置及链接,提升答案可信度

修复后用户上传文档体验流畅,企业数据更安全,用户更信任输出内容。

三、对运行环境的要求

对客户端运行环境

| 项目 | 要求说明 |

|---|---|

| 系统平台 | 支持 Windows 10/11、macOS Monterey/Ventura、Ubuntu 22.04,兼容移动端系统(iOS、Android) |

| 浏览器类型与版本 | 推荐使用最新版 Chrome、Edge、Safari、Firefox,兼容主流浏览器内核 |

| 网络要求 | 建议连接稳定的网络,便于加载文档与发送请求 |

| 分辨率与适配 | 支持 1080p、2K、4K 屏幕分辨率,已完成移动端响应式适配测试 |

| 接口兼容性 | 支持通过 MCP 协议与外部系统集成,如知识库平台、认证系统等 |

对企业私有部署环境要求

| 要求类别 | 配置说明 |

|---|---|

| 操作系统 | Ubuntu 22.04 推荐,兼容 CentOS 7+ / Windows Server / macOS(开发测试环境) |

| 硬件配置 | 最低:8GB RAM + 双核 CPU;推荐:16GB RAM + 四核 CPU;高负载支持:32GB RAM + 八核 CPU |

| Python 版本 | Python 3.10 及以上,建议使用虚拟环境(venv)或 Conda 进行依赖隔离管理 |

| 部署方式 | 支持本地 Docker 部署、云端部署等 |

| 依赖服务 | Docker / Redis / PostgreSQL 等支持组件需预装 |

四、安装与使用方法

个人用户(Web端)

- 打开官网注册账号

- 创建个人知识库并上传文档(支持拖拽)

- 在界面中输入问题,即可获得带引用的AI回答

- 收藏/点赞/反馈回答结果,逐步优化个性化推荐

企业用户(部署)

- 克隆RAGnarok项目

- 按文档配置启动服务

- 登录后台上传企业文档,配置Pipeline

- 设定权限、集成内网系统、开启服务

五、已知问题与限制

1. 功能完整性方面

- 多租户权限控制粒度不足

当前权限体系尚未完全实现对租户间资源隔离的细粒度控制,如跨租户操作或部分租户自定义配置仍依赖统一逻辑处理。 - MCP协议接入能力有限

虽然初步实现了对 MCP(Modular Context Protocol)的解析与传输,但对复杂嵌套结构与实时动态上下文的支持仍不完整,限制了与复杂业务系统的深度集成。

2. 技术与性能方面

- LLM响应时间波动大

在高并发或长上下文输入场景下,LLM模块存在异步响应延迟不稳定的问题,尚需进一步调优调用策略与上下文压缩方案。 - 向量检索性能瓶颈

当前基于 Qdrant 的向量库检索模块在大规模数据(如十万级文档)场景下存在响应时间上升趋势,影响用户体验。

3. 用户体验与可用性方面

-

文档上传格式支持有限

当前知识文档上传主要支持PDF和文本格式,尚未覆盖主流网页、Office文档、Markdown等更多类型,限制用户输入通道。 -

缺少用户反馈闭环机制

问答结果虽已支持用户收藏与参考文献展示,但缺乏完整的反馈收集与再训练机制,无法基于用户行为持续优化问答质量。 -

系统部署复杂度较高

现阶段支持私有化部署但依赖多个组件(如LLM API、Qdrant、后端服务)独立配置,尚未形成统一部署脚本或容器化解决方案。

六、软件发布方式与地址

C 端用户访问(无需部署,开箱即用)

RAGnarok 系统的前端已部署并开放访问,用户可以直接通过以下地址使用智能问答平台:

在线访问地址:http://81.70.198.42/

B 端用户部署方式(支持私有化与深度集成)

企业用户或开发者如需进行私有部署、定制功能或二次开发,请访问我们的 GitHub 仓库获取完整源码与部署说明:

GitHub 项目地址:https://github.com/RAGnarok-dev/

项目内附带详细的部署文档,涵盖:

- 后端与前端服务部署说明

- 多租户与私有部署配置

- 模块化组件启用与禁用方法

- 数据库与模型服务初始化流程

浙公网安备 33010602011771号

浙公网安备 33010602011771号