《机器学习》第一次作业——第一至三章学习记录和心得

第一章基本概念

1.1什么是模式识别

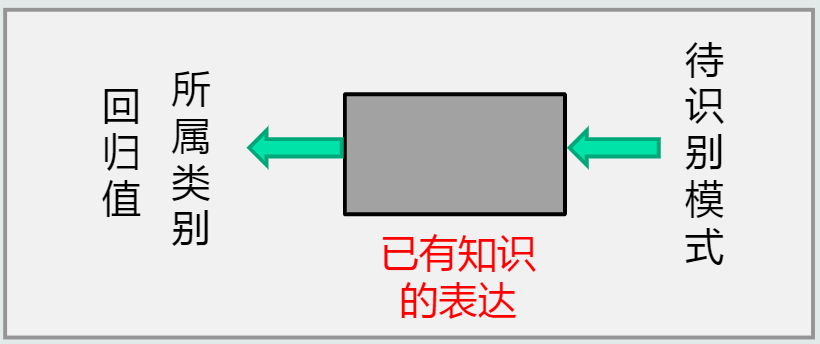

1.定义:根据已有知识的表达,针对待识别模式,判别决策其所属类别或者预测其对应的回归值。

2.应用领域:计算机视觉,人机交互,医学,网络,金融,机器人,无人车。

1.2模式识别数学表达

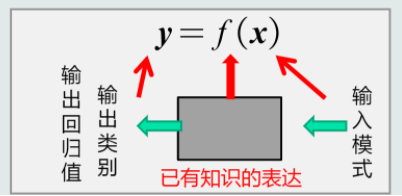

1.数学解释:看成一种函数映射f(x),将待识别模式x从输入空间映射到输出空间,f(x)是关于已有知识的表达。

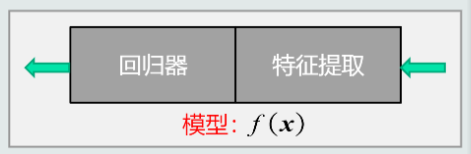

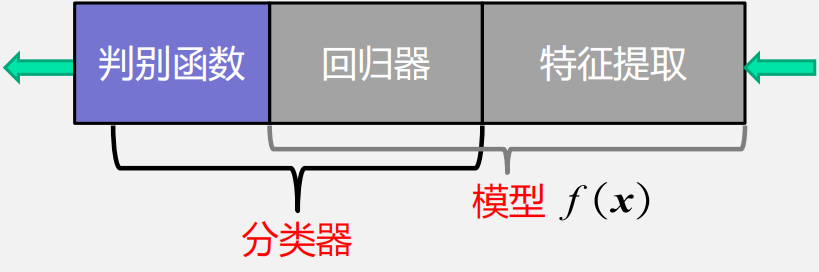

2.模型:关于已有知识的一种表达方式,即函数f(x)。模型可用于回归和分类。

- 回归:特征提取+回归器

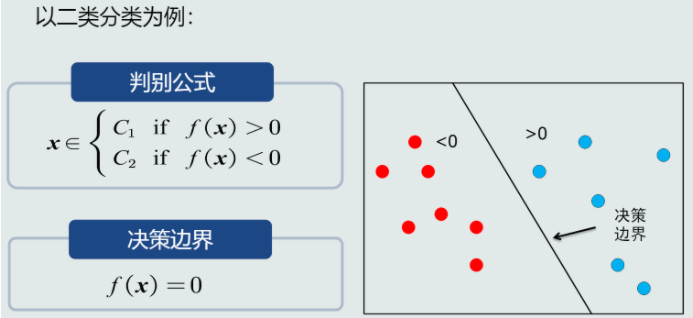

- 分类:

其中,判别函数使用一些特定的非线性函数实现,分为:

- 二类分类:sign函数(判断回归值>0还是<0)。

- 多类分类:max函数(取最大的回归值所在维度对应的类别)。

3.特征:可以用于区分不同类别模式的、可测量的量。

- 特征特性:特征要具有辨别能力、鲁棒性。

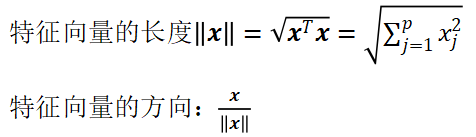

- 特征向量:多个特征构成的(列)向量,可以表达为模长x方向。

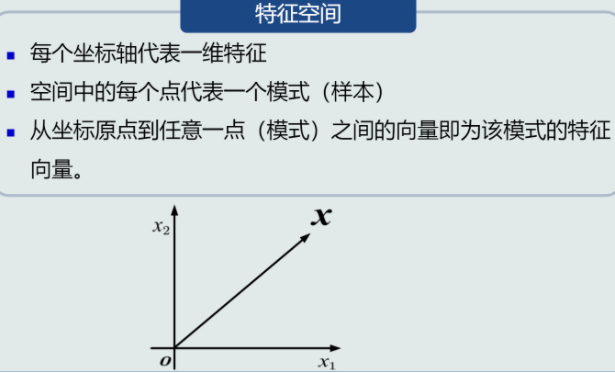

- 特征空间:

1.3特征向量的相关性

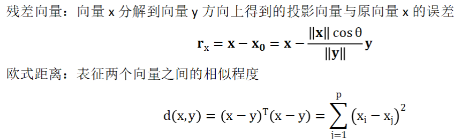

- 特征向量点积(标量、对称、线性变化) VS 特征向量投影:x0=∥x∥cosθ (不具有对称性)。

- 残差向量

- 特征向量的欧式距离

1.4机器学习基本概念

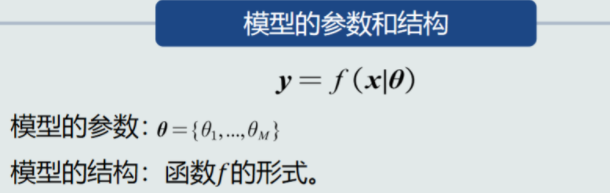

1.模型使用机器学习技术来得到,那么怎样进行机器学习?

1)可理解为“用一组训练样本(数据)学习模型的参数和结构”(利用训练样本,定义目标函数,使用优化算法来解出一组最优参数作为模式识别的模型)。

训练样本可认为是尚未加工的原始知识,模型则是经过学习后的真正知识表达。

线性模型(直线、面、超平面):y=w^Tx+w0 适用于线性可分的数据。

非线性模型:多项式,神经网络,决策树。

2)训练样本个数N与模型参数M的关系

N=M唯一的解;

N>>M没有准确的解(Over-determined);

N<<M无数个解/无解(Under-determined)。

3)目标函数:(对于Over-determined情况)通过优化该标准来确定一个近似解。(对于Under-determined情况)加入对于参数解的约束条件,从无数个解中选最优解。

优化算法:最小化或最大化目标函数的技术。

4)机器学习流程示意图:

2.机器学习方式:监督式学习、无监督式学习、半监督式学习、强化学习。

模型怎么学?

1.5模型的泛化能力

- 训练集:集合中的每个样本称作训练样本。

- 测试集:集合中的测试样本。

训练集训练模型,测试集评估模型。 - 训练误差:模型在训练集上的误差。

- 测试(泛化)误差:模型在测试集上的误差。它反映了模型的泛化能力。

- 泛化能力:训练得到的模型不仅要对训练样本具有决策能力,也要对新的(训练过程中未看见)的模式具有决策能力。

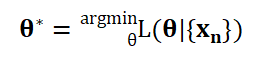

- 泛化能力低:过拟合:训练阶段表现好,测试阶段表现差。

提高方法:(1)选择复杂度适合的模型(2)正则化(在目标函数中加入正则项实现)

1.6评估方法与性能指标

1.评估方法:留出法、K折交叉验证、留一验证(缺点:计算开销大 优点:确定性、适用于小样本)

2.性能指标:

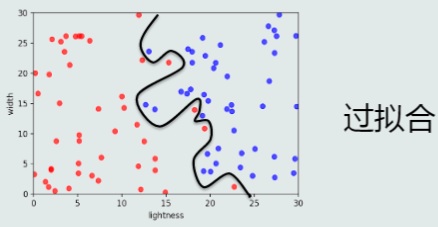

- 准确度(Accuracy)、精度(Precision)、召唤率(Recall)

- F-Score、F1-Score

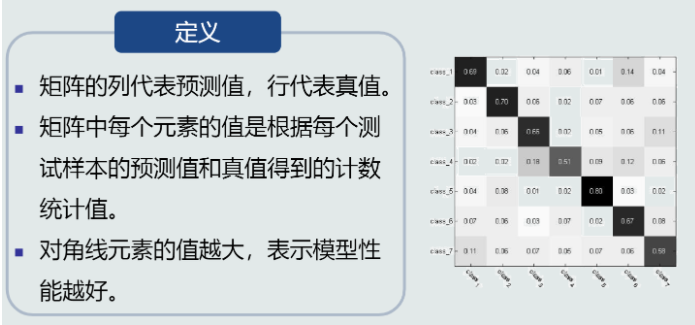

- 混淆矩阵

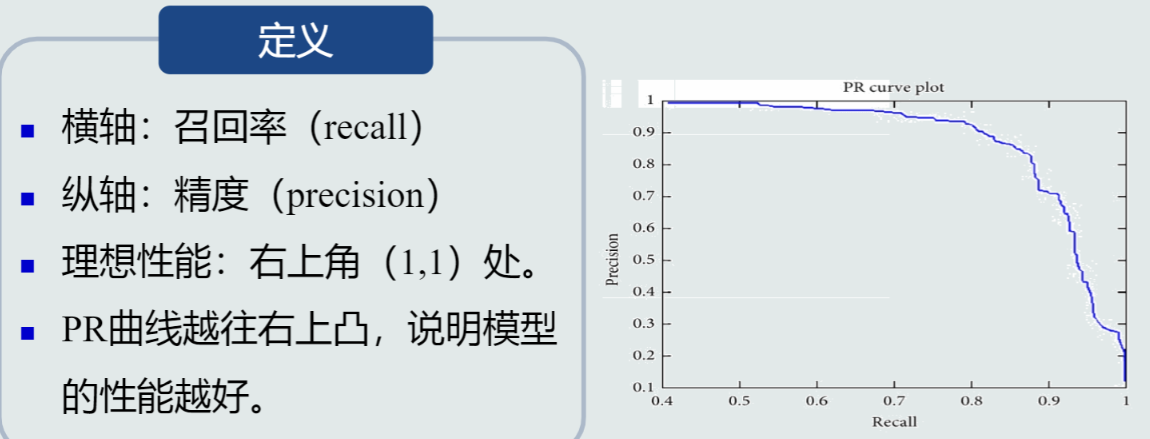

- PR曲线

- ROC曲线

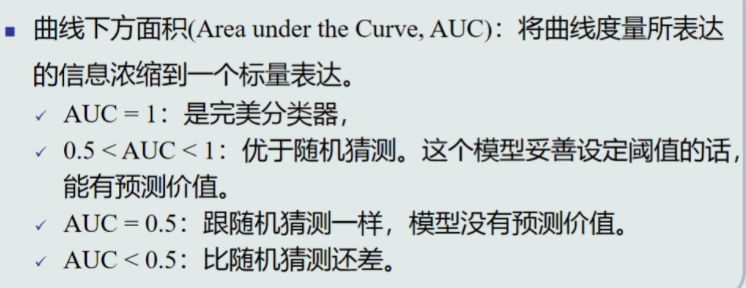

- AUC曲线

第二章基于距离的分类器

2.1 MED分类器——最小欧式距离分类器 (类的原型是均值,衡量的距离为欧式距离)

1.基于距离的决策:把测试样本到每个类之间的距离作为决策模型,将测试样本判定为与其最近的类。

2.原型的种类:均值——将该类中所有训练样本的均值作为类的原型。

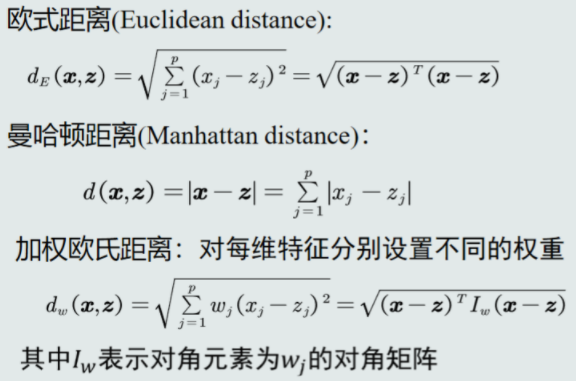

3.距离的种类:欧式距离,曼哈顿距离,加权欧式距离。

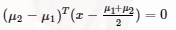

4.MED分类决策边界方程:

5.存在的问题:MED分类器采用欧氏距离作为距离度量,没有考虑特征变化的不同及特征之间的相关性。 ———解决方法:特征白化

2.2特征白化

1.特征白化的目的: 将原始特征映射到一个新的特征空间,使得在新空间中特征的协方差矩阵为单位矩阵,从而去除特征变化的不同及特征之间的相关性。

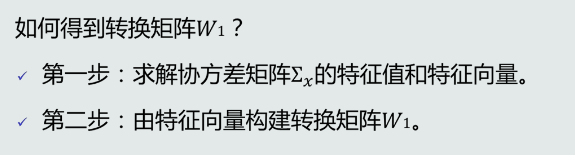

2.步骤

(1)解耦:通过W1实现协方差矩阵对角化,去除特征之间的相关性。

(2)白化:通过W2对上一步变换后的特征再进行尺度变换,实现所有特征具有相同方差。

W1起到旋转的作用

W转换后的欧式距离发生改变,变成马氏距离

2.3MICD分类器——最小类内部距离分类器 (类的原型是均值,衡量的距离为马氏距离)

1.在MED分类器的基础上经过特征白化而得,优点是不受量纲的影响。

2.存在的问题: 当两个类均值一样时,偏向于方差大的类。事实上在此种情况,决策真值应该是倾向于方差小(分布紧致)的类。

3.补充:

- 马氏距离是非奇异、线性变换不变的。

- 欧式距离具有平移不变性、旋转不变性。

- 马氏距离具有平移不变性、旋转不变性、尺度缩放不变性、不受量纲影响的特性。

-

第三章贝叶斯决策与学习

1.基于距离的决策存在的问题

- 仅考虑每个类别各自观测到的训练样本的分布情况(例如:均值(MED分类器)、协方差(MICD分类器))

- 没有考虑类的分布等先验知识(例如:类别之间样本数量的比例,类别之间的相互关系)

2.概率的观点

- 随机性:每个样本是一次随机采样,样本个体具有随机性

- 机器学习的任务:反复观测采样,找出数据蕴含的概率分布规律

- 推理决策:根据学习出来的概率分布规律来做决定

- 每维特征构成一个随机变量,其概率分布由两个元素组成

- 该特征的取值空间(离散或连续)

- 在该特征维度上,样本处于各个取值状态的可能性

3.后验概率:用于分类决策

- 从概率的观点,给定一个测试模式x,决策其属于哪个类别需要依赖条件概率:p(C|x)

- 输入模式x:随机变量(单维特征)或向量(高维特征)

- 类别输出C:随机变量,取值是所有类别标签{Ci}

- 针对每个类别Ci,该条件概率可以写作:p(Ci|x)

- 该条件概率也称作后验概率,表达给定模式x属于类Ci可能性

- 决策方式:找到后验概率最大的那个类

4.如何得到后验概率——贝叶斯规则 Bayes rule

- 已知先验概率和观测概率,模式x属于类Ci后验概率的计算公式为:p(Ci|x)=p(x|Ci)p(Ci)p(x)

- 其中,p(Ci)为类Ci的先验概率,p(x|Ci)为观测似然概率,p(x)=∑jp(x|cj)p(cj)=∑jp(x,Cj)为所有类别样本x的边缘概率

- 加入先验后,相较于观测,后验概率产生了迁移

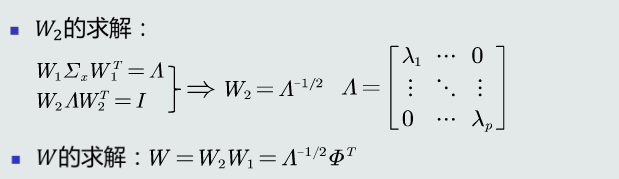

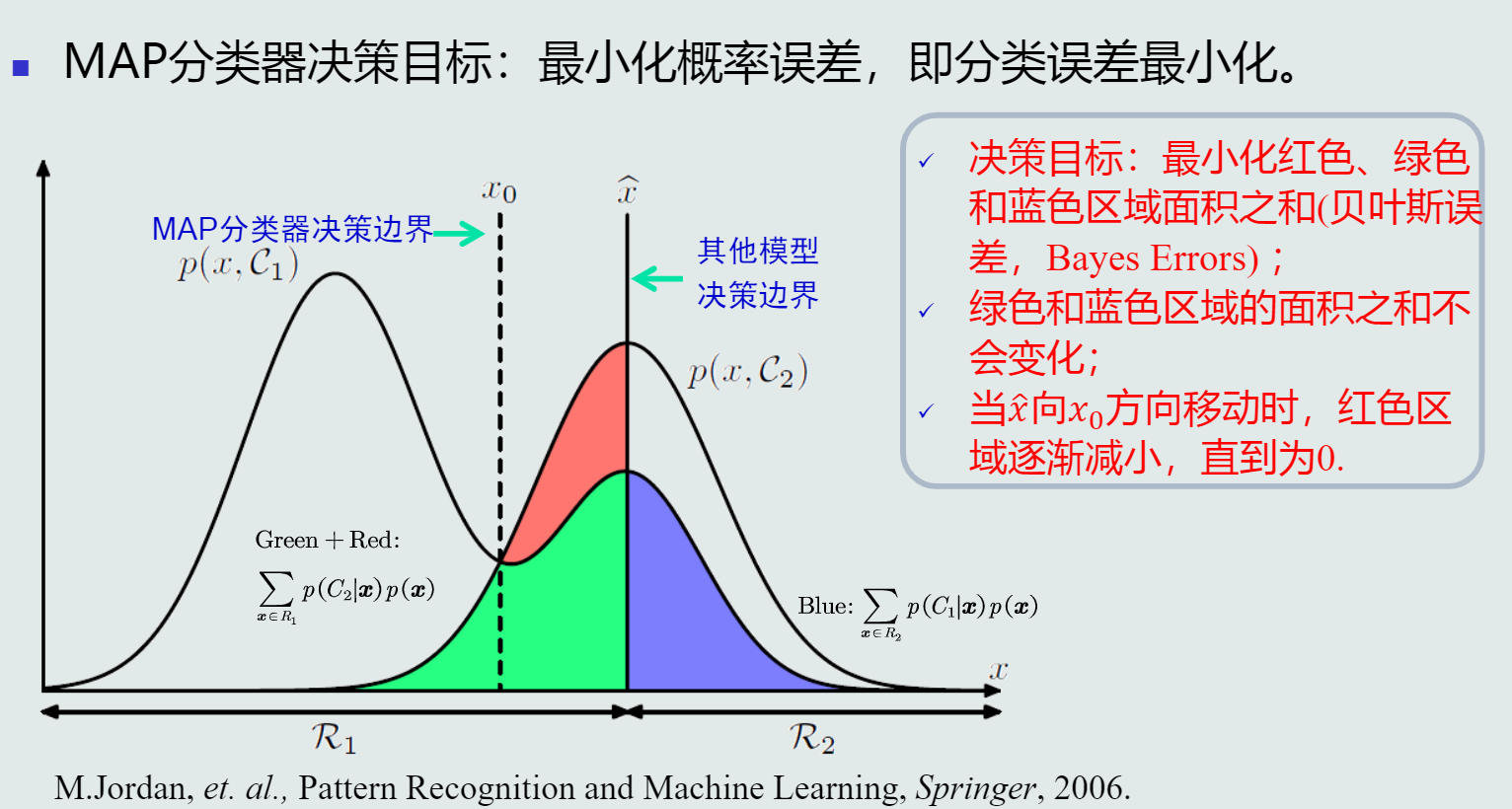

5.MAP分类器

- 最大后验概率分类器:将测试样本决策分类给后验概率最大的那个类

- 判别公式:

![13]()

- 决策误差:概率误差等于未选择的类所对应的后验概率

![14]()

- MAP目标:最小化概率误差,当选用其他模型决策边界为下图中实线,此时若为R1类,则红色与绿色均是误差,若为R2类则蓝色部分是误差。MAP的决策边界下不存在红色区域,故误差最小

![15]()

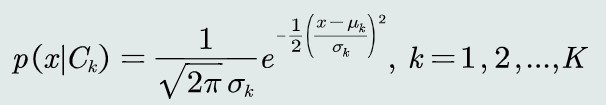

6.MAP分类器:高斯观测概率

- 观测概率:单维高斯分布

![16]()

决策边界:-

当𝜎𝑖 = 𝜎𝑗 = σ 时,决策边界是线性的,只有一条;

如果𝜇𝑖 < 𝜇𝑗,且𝑃 𝐶𝑖 < 𝑃 𝐶𝑗 ,则𝛿 < 0;

说明:在方差相同的情况下,MAP决策边界偏向先验可能性较小的类,即分类器决策偏向先验概率高的类 -

当𝜎𝑖 ≠ 𝜎𝑗时,决策边界有两条(非线性边界),该决策方程是关于𝒙的二次型函数

且若𝜎𝑖 > 𝜎𝑗及先验概率相等时,可知𝛿 > 0,分类器倾向选择𝐶𝑗类,即方差较小(紧致)的类 -

MAP分类器偏向于先验较大可能性、分布较为紧致的类

-

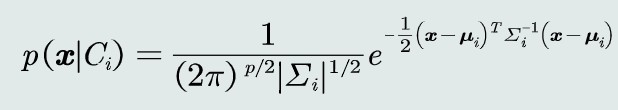

- 观测概率:高维高斯分布

![17]()

决策边界为一个超二次型

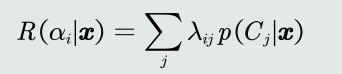

7.决策风险与贝叶斯分类器

- 决策风险: 贝叶斯决策不能排除出现错误判断的情况,由此会带来决策风险。 更重要的是,不同的错误决策会产生程度完全不一样的风险

给定一个测试样本𝒙 ,分类器决策其属于𝐶𝑖类的动作α𝑖对应的 决策风险可以定义为相对于所有候选类别的期望损失![18]()

- 损失:表征当前决策动作相对于其他候选类别的风险程度

- 假设分类器把测试样本x决策为Ci类,这个决策动作记作αi

- 假设该测试样本x的真值是属于Cj类,决策动作αi对应的损失可以表达为:λ(αi|Cj),简写为λij

- 损失的评估:针对所有决策动作和候选类别,可以用一个矩阵来表示对应的损失值

- 决策风险的评估:给定一个测试样本x,分类器决策其属于Ci类的动作αi对应的决策风险可以定义为相对于所有候选类别的期望损失,记作R(αi|x)=∑jλijp(Cj|x)

- 贝叶斯分类器:在MAP分类器基础上,加入决策风险因素,得到贝叶斯分类器 Bayes classifier。给定一个测试样本x,贝叶斯分类器选择决策风险最小的类。

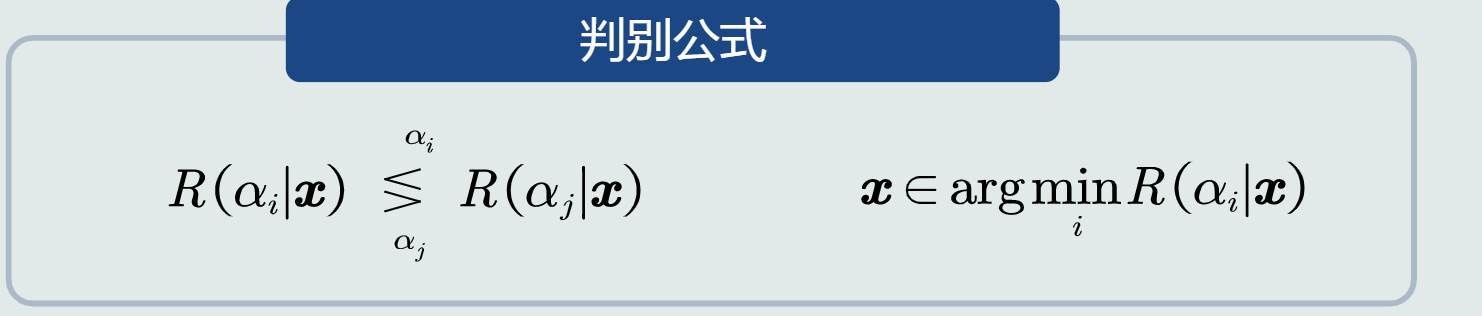

- 判别公式

![19]()

- 贝叶斯决策的期望损失

- 对于单个测试样本,贝叶斯决策损失就是决策风险R(αi|x)

- 对于所有测试样本(N为样本个数),贝叶斯决策的期望损失是所有样本的决策损失之和:R({x})=∑iR(αi|{x})=∑i∑kλik∑x∈RiP(Ck|x)

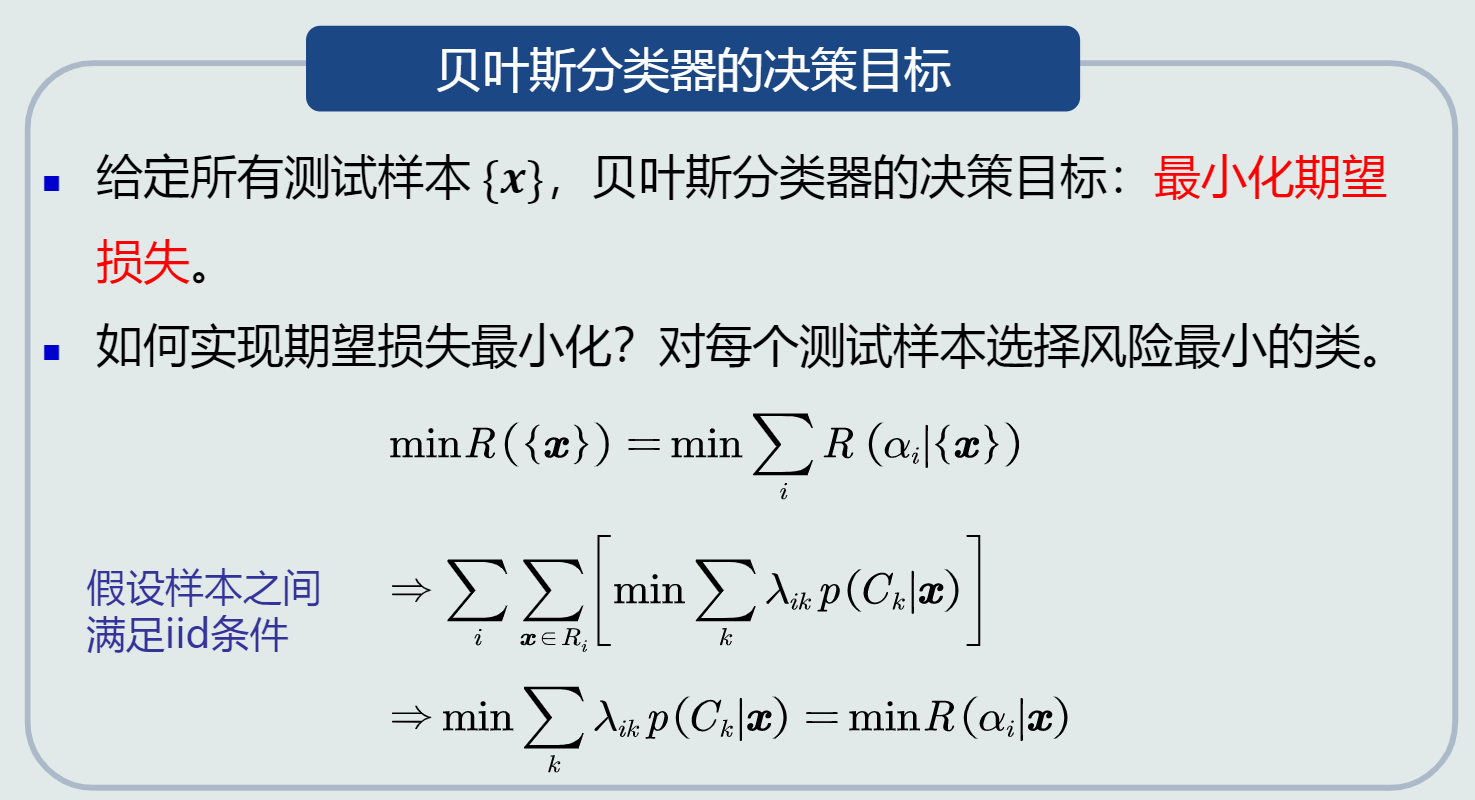

- 贝叶斯分类器的决策目标

- 决策目标:最小化期望损失

- 实现方式:对每个测试样本选择风险最小的类

![20]()

- 朴素贝叶斯分类器

- 特征维度太高,通过即假设特征之间符合独立同分布以达到简化计算的目的

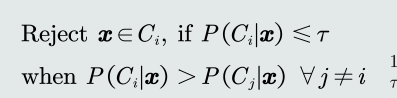

- 在决策边界附近的处理:拒绝选项(引入阈值τ)

![21]()

- 当τ = 1,所有样本的任何决策 都会被拒绝

- 当τ < 1/𝐾,所有样本的决策都 不会被拒绝,K是类别的个数

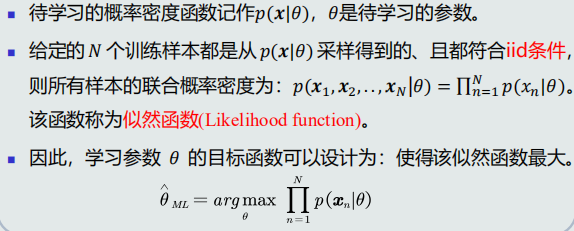

8.最大似然估计

- 引言: 在贝叶斯决策中,求取后验概率需要事先知道每个类的先验概率和观测似然概率。 这两类概率分布需要通过机器学习算法得到

- 监督式学习方法

- 参数化方法:最大似然估计、贝叶斯估计

- 非参数化方法

- 最大似然估计

![22]()

- 先验概率估计: 给定所有类的𝑁个训练样本,假设随机抽取其中一个样本属于𝐶1类的概率为𝑃,则选取到𝑁1个属于𝐶1类样本的概率为先验概率的似然函数(即目标函数)

为最大化似然函数,采用对参数P求偏导

先验概率的最大似然估计就是该类训练样本出现的频率 - 观测概率估计: 如果观测似然概率服从高斯分布,待学习的参数包含该高斯分布的均值𝝁和协方差𝚺(观测似然概率是关于单个类的条件概率)

为最大化似然函数,采用对两个参数𝝁和𝚺分别求导

高斯分布均值的最答似然估计等于样本的均值,高斯分布协方差估计等于所有训练模式的协方差

- 先验概率估计: 给定所有类的𝑁个训练样本,假设随机抽取其中一个样本属于𝐶1类的概率为𝑃,则选取到𝑁1个属于𝐶1类样本的概率为先验概率的似然函数(即目标函数)

9.最大似然的估计偏差

- 无偏估计

- 如果一个参数的估计量的数学期望是该参数的真值,则该估计量称作无偏估计

- 无偏估计意味着只要训练样本个数足够多,该估计值就是参数的真实值

- 均值的最大似然估计是无偏估计

- 高斯分布协方差的最大似然估计式有偏估计

- 需对协方差估计进行修正

可以通过将训练样本的协方差乘以𝑁/(𝑁 − 1)来修正协方差的估计值

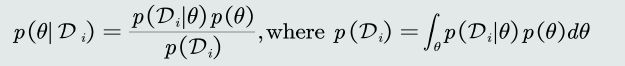

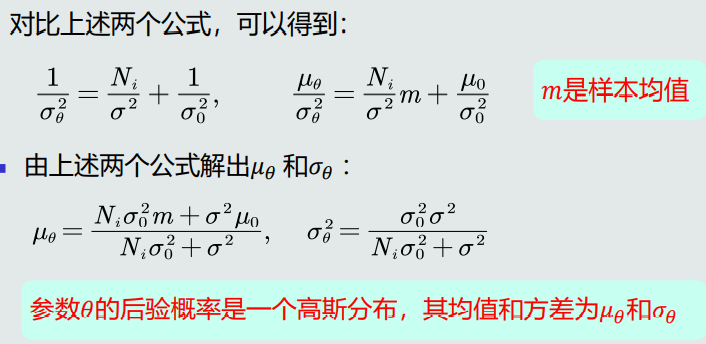

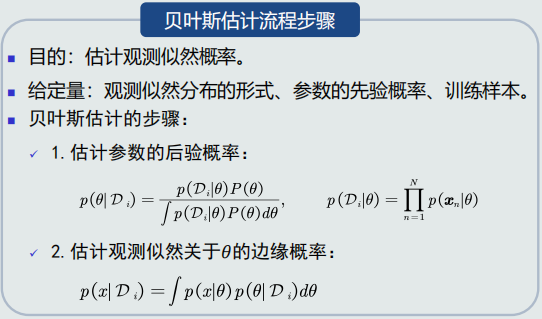

10.贝叶斯估计

- 贝叶斯估计:给定参数𝜃分布的先验概率以及训练样本,估计参数θ分布的后验概率

- 参数的后验概率

- 给定单个𝐶𝑖类的训练样本集合𝐷𝑖,针对𝜃应用贝叶斯理论,得到 其后验概率:

![23]()

- 由于样本之间相互独立(iid条件),可以得到:

![24]()

- 给定单个𝐶𝑖类的训练样本集合𝐷𝑖,针对𝜃应用贝叶斯理论,得到 其后验概率:

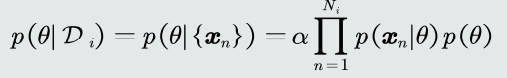

- 高斯观测似然

- 假设𝐶𝑖类的观测似然概率是单维高斯分布,且高斯分布的方差 𝜎 2已知,则待估计参数𝜃就只是高斯分布的均值𝜇

![25]()

- 假设𝐶𝑖类的观测似然概率是单维高斯分布,且高斯分布的方差 𝜎 2已知,则待估计参数𝜃就只是高斯分布的均值𝜇

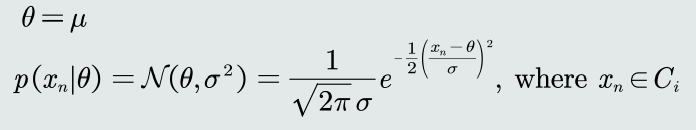

- 参数(高斯均值)先验概率:

- 假设θ的先验概率分布也服从单维高斯分布,该分布的均值𝜇0 和方差𝜎0 已知:

![26]()

- 假设θ的先验概率分布也服从单维高斯分布,该分布的均值𝜇0 和方差𝜎0 已知:

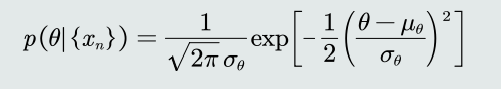

- 参数(高斯均值)的后验概率

![27]()

![28]()

- 分析

- 给定𝐶𝑖类的𝑁𝑖个训练样本,参数θ概率分布的均值等于训练样 本均值和该参数先验概率均值的加权和。

- 给定𝐶𝑖类的𝑁𝑖个训练样本,参数θ概率分布的方差是由𝐶𝑖类观 测似然分布的方差、该参数的先验概率方差、 𝐶𝑖类的样本个 数共同决定。

- 当𝑁𝑖足够大时,样本均值m就是参数θ的无偏估计。

- 如果参数的先验方差𝜎0 = 0,则𝜇𝜃 → 𝜇0,意味先验的确定性较 大,先验均值的影响也更大,使得后续训练样本的不断进入对 参数估计没有太多改变。

- 如果参数的先验方差𝜎0 ≫ 𝜎,则𝜇𝜃 → 𝑚,意味着先验的确定 性非常小。刚开始由于样本较少,导致参数估计不准。随着样 本的不断增加,后验均值会逼近样本均值。

- 估计观测似然关于θ的边缘概率

![29]()

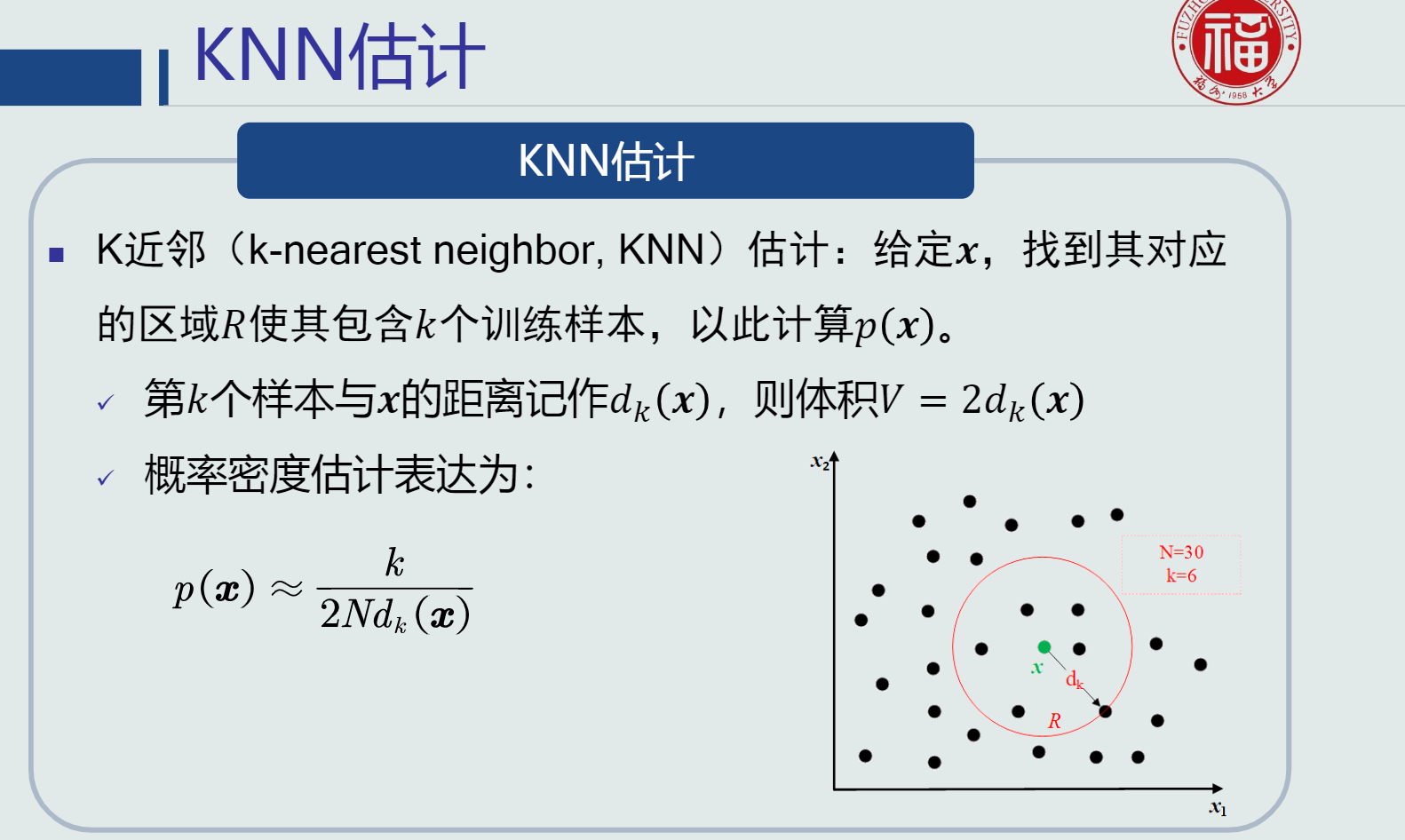

11.无参数技术

- 贝叶斯估计等是假设概率分布为高斯分布,但如果分布未知,就需要使用无参数估计技术来实现概率密度估计

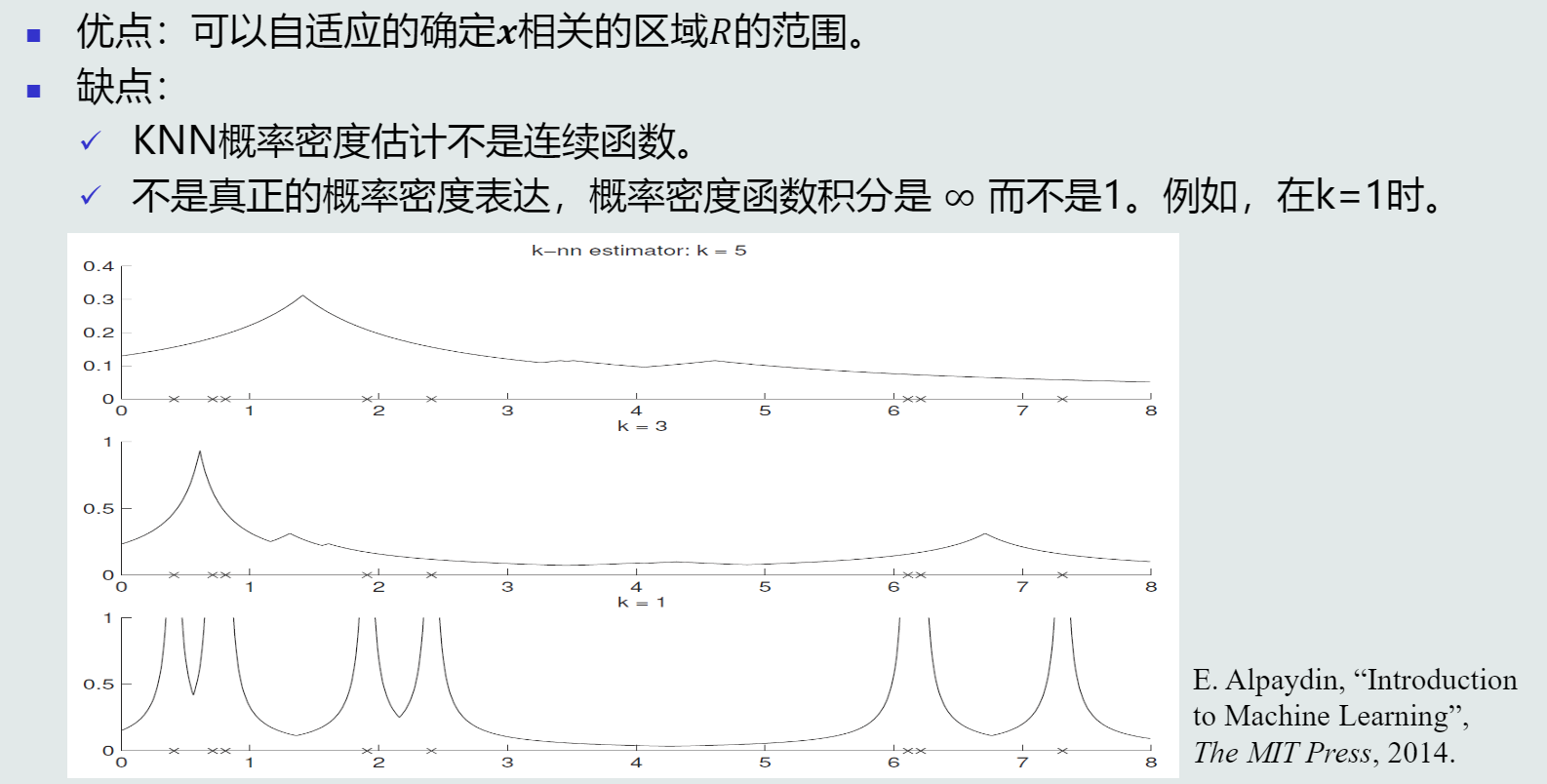

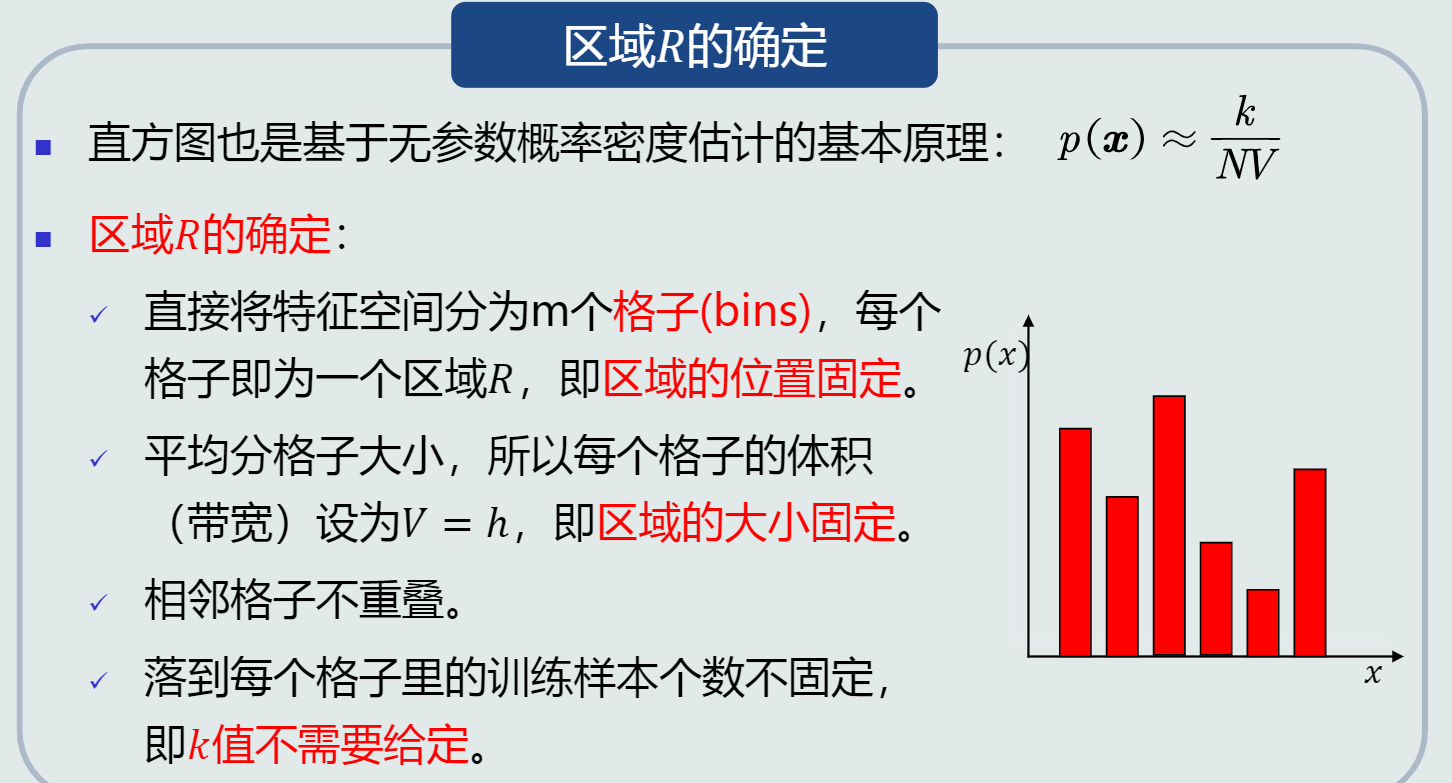

- 常用的无参数估计技术:KNN估计、直方图估计、核密度估计,基于p(x)=k/(NV)估计概率密度

- KNN估计

![30]()

![31]()

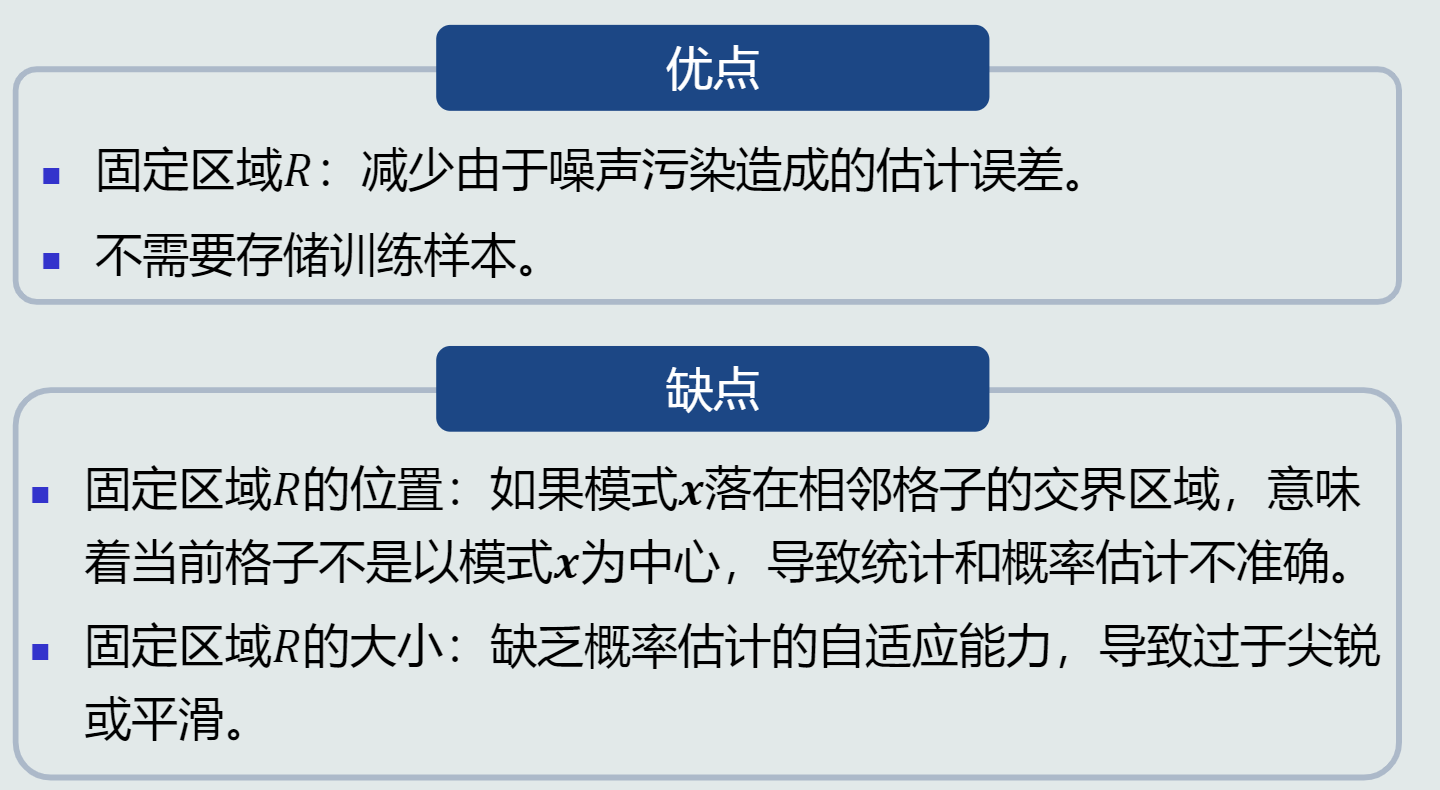

- 直方图估计

![32]()

![33]()

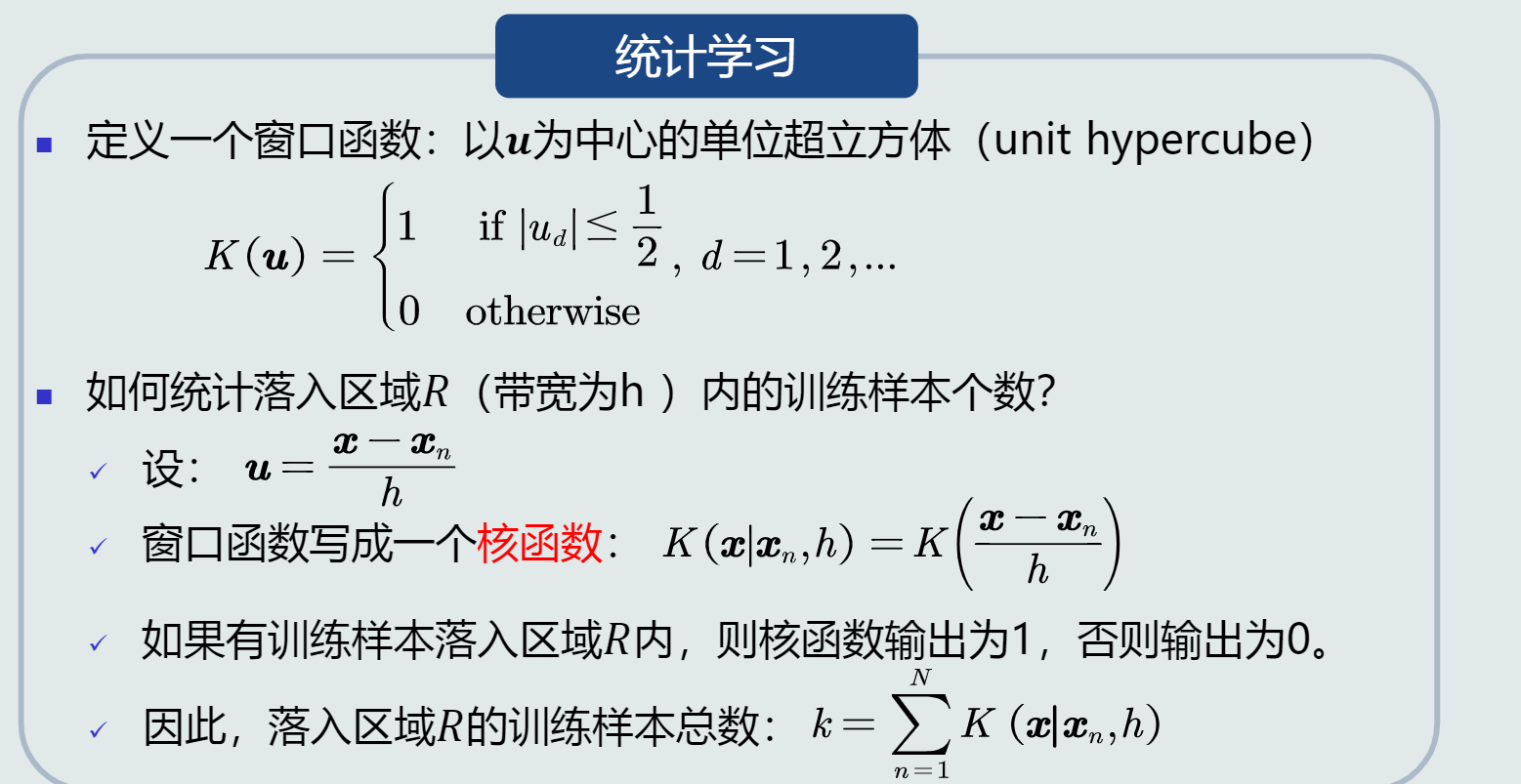

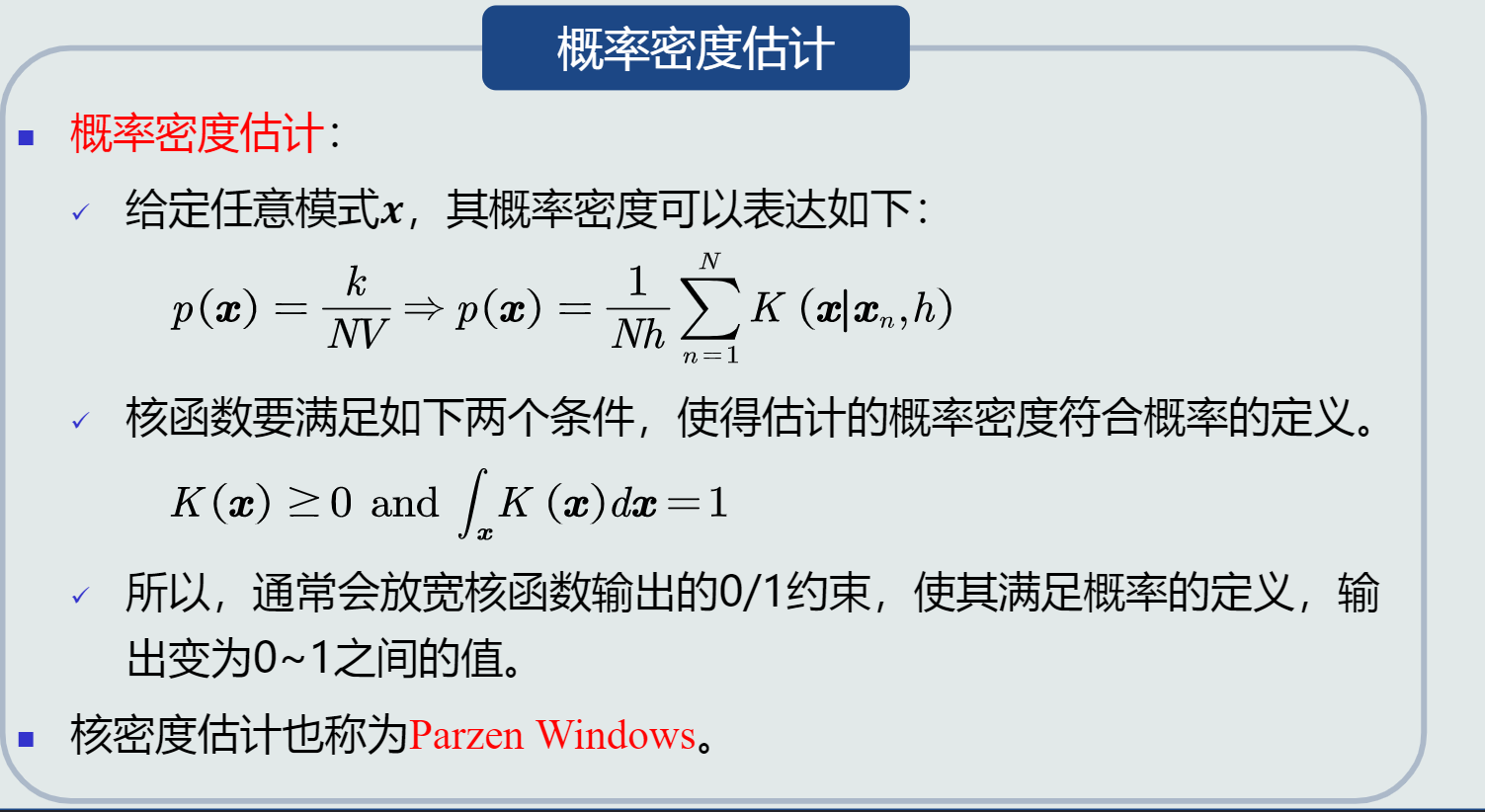

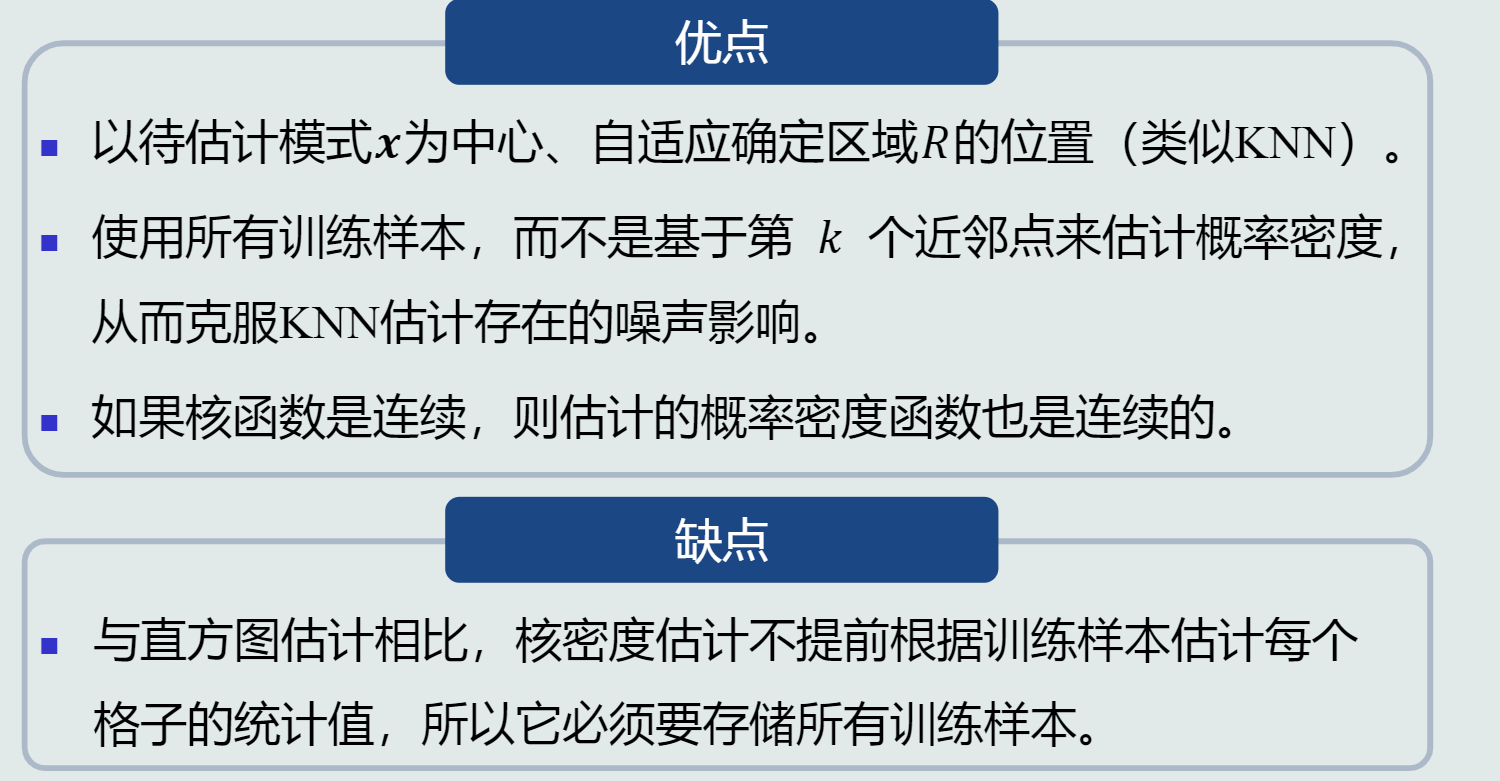

- 核密度估计

![34]()

![35]()

![36]()

![37]()

浙公网安备 33010602011771号

浙公网安备 33010602011771号