EdgeConnect: Structure Guided Image Inpainting using Edge Prediction

论文

pytorch

引言

语义分割获取边缘信息指导修复其二

存在的问题:之前方法能够生成具有有意义结构的缺失区域,但生成的区域往往模糊或边缘部分存在伪影。

提出问题:提出了一个两阶段的模型,将inpaint问题分为结构预测和图像补全。与素描图相似,我们的模型首先以边缘映射的形式预测缺失区域的图像结构。预测的边缘映射被传递到第二阶段来指导inpaint过程。

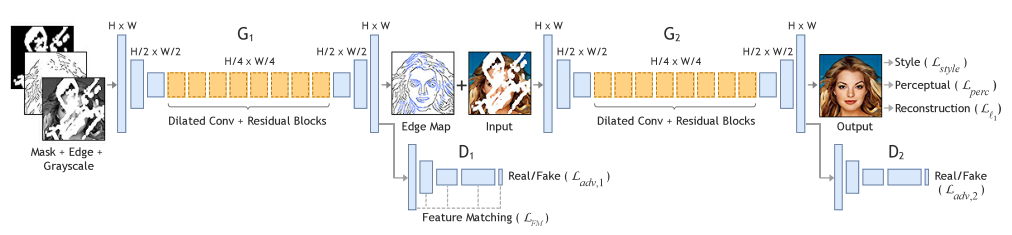

网络框架

每个阶段均包括一对生成器/判别器。G1的输入是不完全灰度图像和边缘映射,掩模是用来预测完整边缘映射的。将预测的边缘映射和不完整的彩色图像传递给G2执行补绘任务。

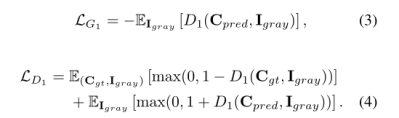

输入灰度图 canny输入是二维 dataset.py

EdgeConnect:

发生器由两个编码器组成,向下采样两次,然后是八个residual block和向上采样图像回到原始大小的解码器。在residual block层中使用扩张因子为8的扩张卷积代替普通卷积,以增加后续层的接受野。

对于鉴别器,我们使用70×70 PatchGAN

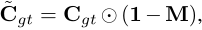

I_gt:ground truth C_gt:gt的边缘图 I_gray:gt的灰度图

输入的灰度图: ![]()

输入的边缘图:

生成器预测了缺失区域的边缘映射The edge map:

损失函数

铰链对抗损失

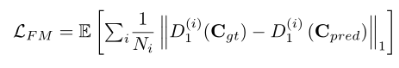

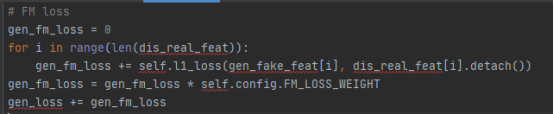

The feature-matching loss L_FM

比较判别器中的特征层,类似于感知损失。

I:第i个特征层 N_i:i层的元素数量

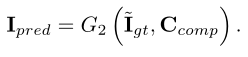

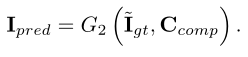

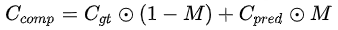

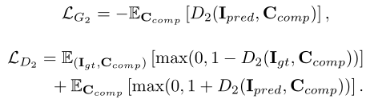

3.2. Image Completion Network

输入带mask的RGB的ground truth

损失函数

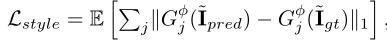

感知损失:

VGG网络提取特征

Style loss

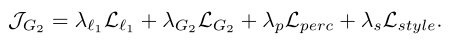

联合损失:

对比效果

浙公网安备 33010602011771号

浙公网安备 33010602011771号