Mixed Precision Training

概

本文提出了混合精度训练.

主要内容

-

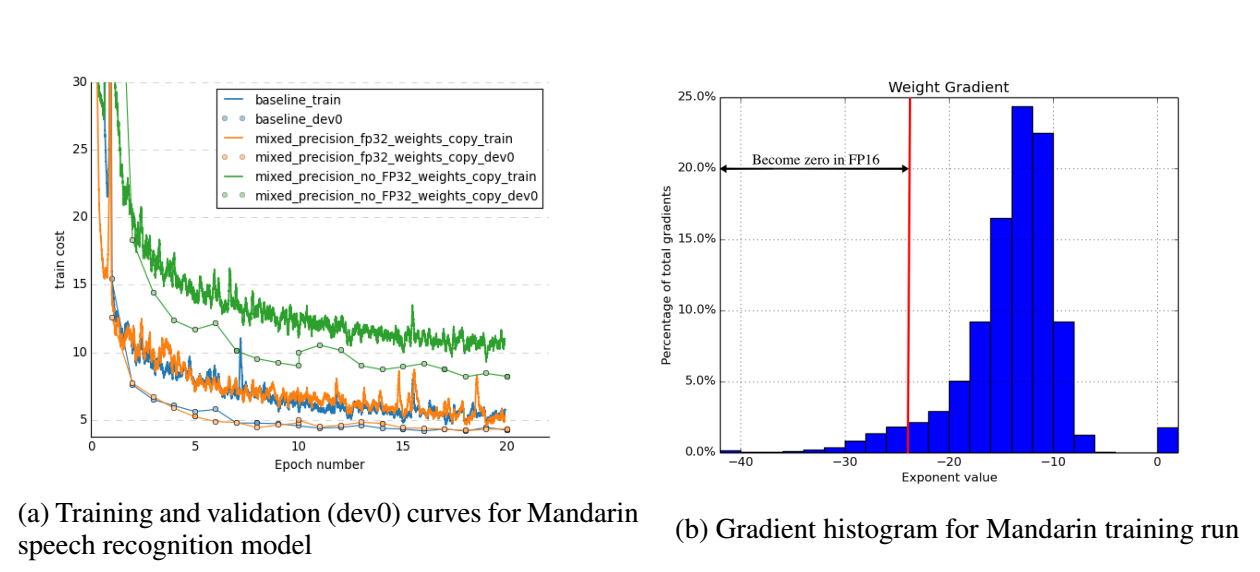

从 FP32 到 FP16 的一个重要问题是, 绝对值小于 \(2^{-24}\) 的梯度会被直接置为 0, 而根据如上图所示, 其实是有不少梯度值是落在这一区间的.

-

于是作者的建议就是, 在梯度回传前, 先对 loss 乘上一个较大的数 \(s\), 然后等 backward 回传结束后, (梯度) 再乘上 \(1 / s\), 以避免 backward 中会出现大量 0 的情况. 貌似这个操作经常能看到.

浙公网安备 33010602011771号

浙公网安备 33010602011771号