Ollama本地部署DeepSeek

本地部署 DeepSeek 大模型教程

由于 DeepSeek 大模型访问人数过多,经常出现反应迟缓甚至宕机的情况。幸运的是,DeepSeek 是一个开源模型,我们可以通过本地部署在自己的终端上随时使用,且无需联网即可直接使用。以下是详细的部署步骤:

一、安装 Ollama

-

下载 Ollama

访问 Ollama 官网,下载适合自己操作系统的安装包(Windows、macOS、Linux)。本文以 Windows 版本为例。![]()

-

安装 Ollama

下载完成后,双击安装包进行安装,安装速度较快。 -

验证安装

安装完成后,打开命令提示符(CMD)。可以通过以下方式打开:- 在电脑搜索框中输入

cmd。 - 或按

Win + R,输入cmd后回车。

![]()

![]()

在命令提示符中输入以下命令并按回车键:

ollama help如果没有报错,则表示 Ollama 安装成功。

![]()

- 在电脑搜索框中输入

二、下载并部署 DeepSeek 模型

-

选择模型

回到 Ollama 官网,在搜索框中输入Deepseek-r1,这是我们需要本地部署的模型。![]()

-

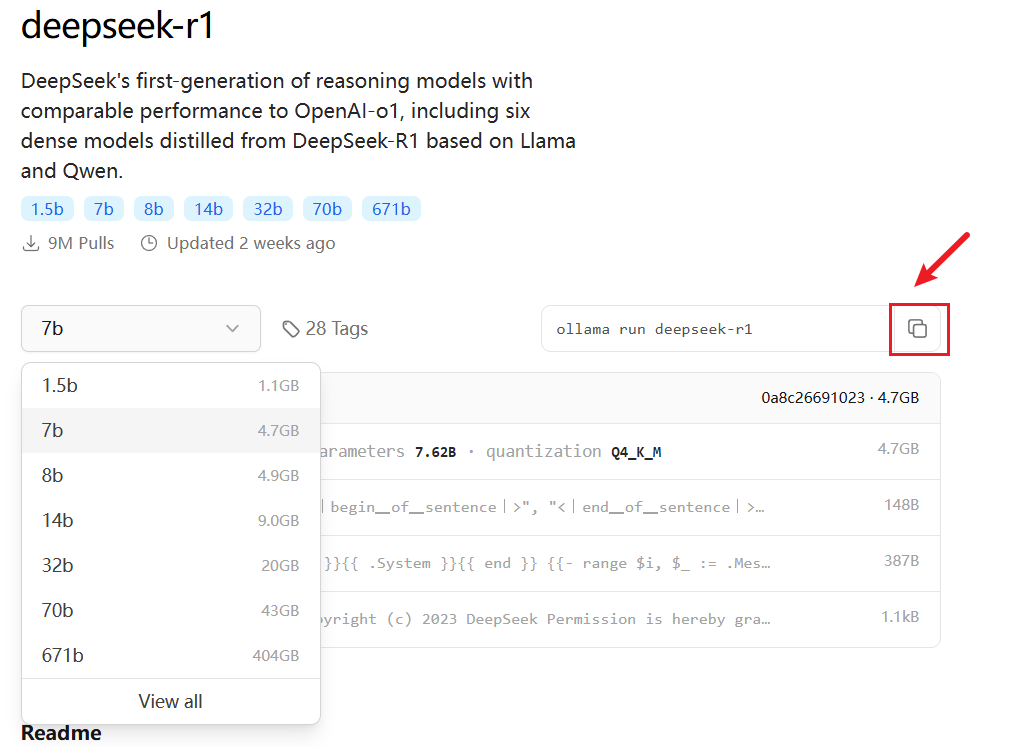

选择模型规模

进入 Deepseek-r1 详情页面后,可以看到多个参数规模可供选择(从 1.5b 到 671b)。根据自己电脑的硬件配置选择合适的模型规模。以下是模型大小与硬件配置的参考表格:模型规模 显存需求 适用硬件配置 1.5b 4GB - 8GB 低端 GPU(如 NVIDIA GTX 1650) 3b 8GB - 16GB 中端 GPU(如 NVIDIA RTX 2080) 7b 16GB - 32GB 高端 GPU(如 NVIDIA RTX 3090) 13b 32GB - 80GB 多卡配置(如 2x NVIDIA A100) 671b 80GB 以上 多节点分布式训练(如 8x NVIDIA A100) ![]()

-

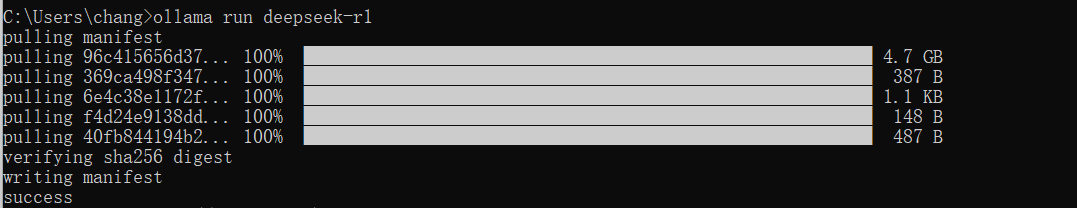

下载模型

选择好模型规模后,复制右侧的命令。例如:ollama run deepseek-r1-7b回到命令提示符窗口,粘贴命令并按回车键,开始下载模型。

![]()

![]()

![]()

-

使用模型

模型下载完成后,可以直接在命令提示符中对模型进行提问。例如:ollama run deepseek-r1-7b "你好,DeepSeek!"![]()

三、使用可视化图文交互界面 Chatbox

虽然可以在命令提示符中使用 DeepSeek,但界面较为简陋。可以通过 Chatbox 这个可视化图文交互界面来提升使用体验。

-

下载 Chatbox

访问 Chatbox 官网,下载客户端。虽然 Chatbox 有网页版,但建议使用客户端,因为网页版可能无法检测到本地部署的 DeepSeek 模型。 -

配置 Chatbox

打开 Chatbox 客户端后,选择“使用自己的 API Key 或本地模型”。![]()

如果不小心关闭了配置界面,可以按以下步骤重新设置:

- 点击右上角的设置按钮。

- 选择“本地模型”,并确保 Ollama 正在运行。

![]()

-

开始使用

配置完成后,即可通过 Chatbox 与 DeepSeek 进行对话。![]()

总结

通过以上步骤,您已经成功在本地部署了 DeepSeek 大模型,并可以通过 Chatbox 进行可视化交互。本地部署不仅避免了网络延迟和宕机问题,还能根据需求灵活选择模型规模,提升使用体验。

浙公网安备 33010602011771号

浙公网安备 33010602011771号