聚类--K均值算法:自主实现与sklearn.cluster.KMeans调用

1.用python实现K均值算法

K-means是一个反复迭代的过程,算法分为四个步骤:

(x,k,y)

1) 选取数据空间中的K个对象作为初始中心,每个对象代表一个聚类中心;

def initcenter(x, k): kc

2) 对于样本中的数据对象,根据它们与这些聚类中心的欧氏距离,按距离最近的准则将它们分到距离它们最近的聚类中心(最相似)所对应的类;

def nearest(kc, x[i]): j

def xclassify(x, y, kc):y[i]=j

3) 更新聚类中心:将每个类别中所有对象所对应的均值作为该类别的聚类中心,计算目标函数的值;

def kcmean(x, y, kc, k):

4) 判断聚类中心和目标函数的值是否发生改变,若不变,则输出结果,若改变,则返回2)。

while flag:

y = xclassify(x, y, kc)

kc, flag = kcmean(x, y, kc, k)

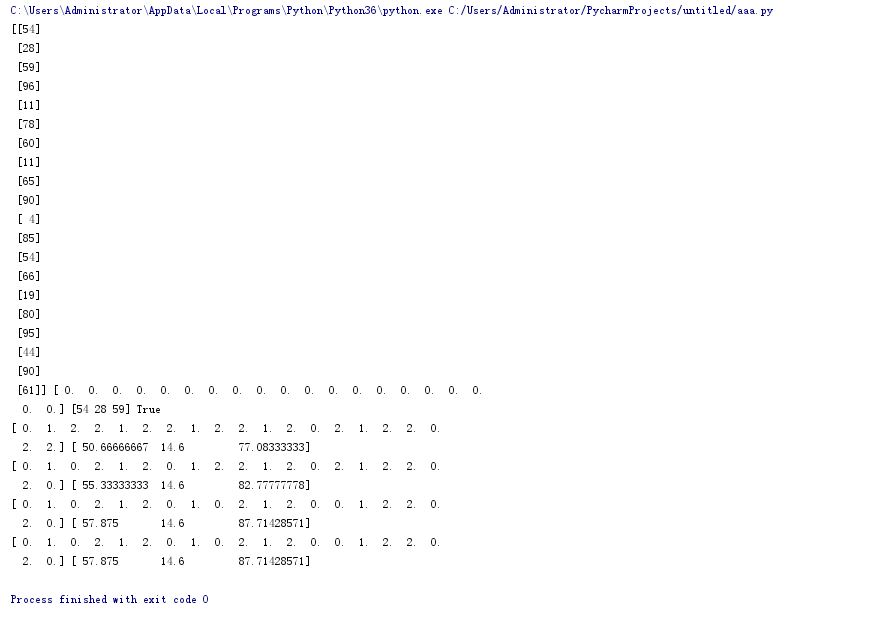

import numpy as np

x=np.random.randint(1,100,[20,1])

y=np.zeros(20)

k=3

def initcent(x,k): #初始聚类中心数组

return x[0:k].reshape(k)

def nearest(kc,i): #数组中的值,与聚类中心最小距离所在类别的索引号

d=(abs(kc-i))

w=np.where(d==np.min(d))

return w[0][0]

def xclassify(x,y,kc):

for i in range(x.shape[0]): #对数组的每个值分类

y[i]=nearest(kc,x[i])

return y

def kcmean(x,y,kc,k): #计算各聚类新均值

l=list(kc)

flag = False

for c in range(k):

m=np.where(y==c)

n=np.mean(x[m])

if l[c]!=n:

l[c]=n

flag=True

return(np.array(l),flag)

kc = initcent(x,k)

flag = True

print(x,y,kc,flag)

while flag:

y=xclassify(x,y,kc)

kc,flag=kcmean(x,y,kc,k)

print(y,kc)

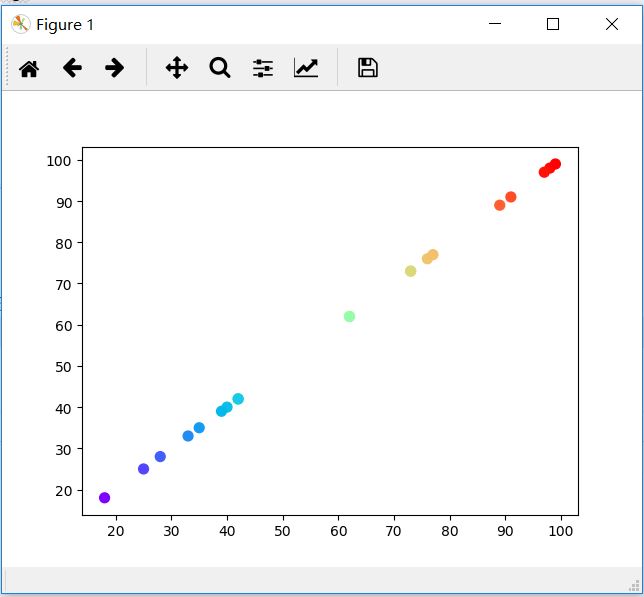

2. 鸢尾花花瓣长度数据做聚类并用散点图显示。

import matplotlib.pyplot as plt plt.scatter(x, x, c=x, s=50, cmap="rainbow"); plt.show()

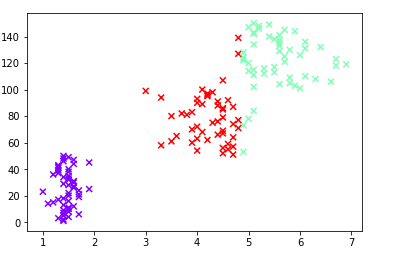

3. 用sklearn.cluster.KMeans,鸢尾花花瓣长度数据做聚类并用散点图显示.

from sklearn.datasets import load_iris from sklearn.cluster import KMeans import matplotlib.pyplot as plt import numpy as np # 用sklearn.cluster.KMeans,鸢尾花花瓣长度数据做聚类并用散点图显示. data=load_iris() data_length=data['data'][:,2:3]#取出鸢尾花花瓣的长度 x=data_length #y=np.zeros(x.shape[0]) k1=KMeans(n_clusters=3)#将其类别分为3类 k1.fit(x) kc1=k1.cluster_centers_ y_kmeans=k1.predict(x)##预测每个样本的聚类索引 print(y_kmeans,kc1) plt.scatter(x,np.linspace(1,150,150),c=y_kmeans,marker='x',cmap='rainbow',linewidths=4) plt.show()

4. 鸢尾花完整数据做聚类并用散点图显示.

data=load_iris() x2=data.data k2=KMeans(n_clusters=3)#将其类别分为3类 k2.fit(x2) kc2=k2.cluster_centers_ y_kmeans2=k2.predict(x2)##预测每个样本的聚类索引 print(y_kmeans2,kc2,len(y_kmeans2)) plt.scatter(x2[:,0],x2[:,1],c=y_kmeans2,marker='p',cmap='rainbow',linewidths=4) plt.show()

浙公网安备 33010602011771号

浙公网安备 33010602011771号