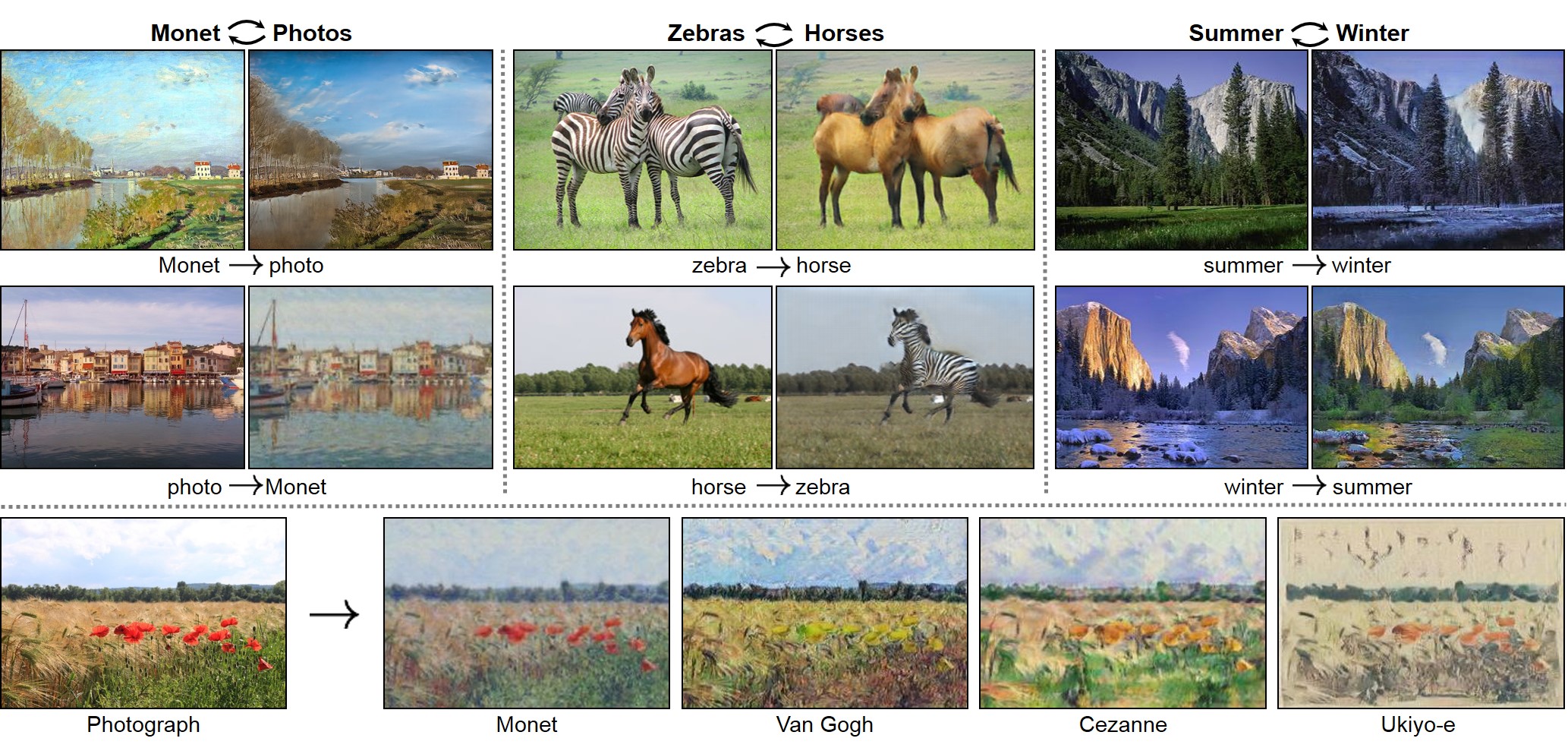

CycleGAN

Cycle-GAN

Unpaired Image-to-Image Translation using Cycle-Consistent Adversarial Networks paper

方法

损失

对抗损失 Adversarial loss

\(\mathcal{L}_{GAN}(G,D_Y,X,Y)=\mathbb{E}_{y \backsim p_{data}(y)}[\log D_Y(y)] +\mathbb{E}_{x \backsim p_{data}(x)}[\log(1-D_Y(G(x)))]\)

循环一致性损失 Cycle Consistency Loss

\(\mathcal{L}_{cyc}(G,F)= \mathbb{E}_{x \backsim p_{data}(x)}[\|F(G(x))-x\|_1] +\mathbb{E}_{y \backsim p_{data}(y)}[\|G(F(y))-y\|_1]\)

总损失

\(\mathcal{L}(G,F,D_X,D_Y)=\mathcal{L}_{GAN}(G,D_Y,X,Y) + \mathcal{L}_{GAN}(F,D_X,X,Y)+\lambda\mathcal{L}_{cyc}(G,F)\)

生成器

编码:利用卷积神经网络从输入图象中提取特征。将图像压缩成256个64*64的特征向量。

转换:通过组合图像的不相近特征,将图像在DA域中的特征向量转换为DB域中的特征向量。作者使用了6层Reset模块,每个Reset模块是一个由两个卷积层构成的神经网络层,能够达到在转换时同时保留原始图像特征的目标。

解码:利用反卷积层(decovolution)完成从特征向量中还原出低级特征的工作,最后得到生成图像。

判别器

70 × 70 PatchGANs

鉴别器本身属于卷积网络,需要从图像中提取特征,再通过添加产生一维输出的卷积层来确定提取的特征是否属于特定类别。

评估

AMT

Amazon Mechanical Turk

FCN

The FCN metric evaluates how interpretable the generated

photos are according to an off-the-shelf semantic segmentation algorithm (the fully-convolutional network, FCN)

Semantic segmentation metrics

Cityscapes benchmark

浙公网安备 33010602011771号

浙公网安备 33010602011771号