2021.4.10| 近期一周进展(激光雷达与相机联合仿真)

这周使用ROS的体会。

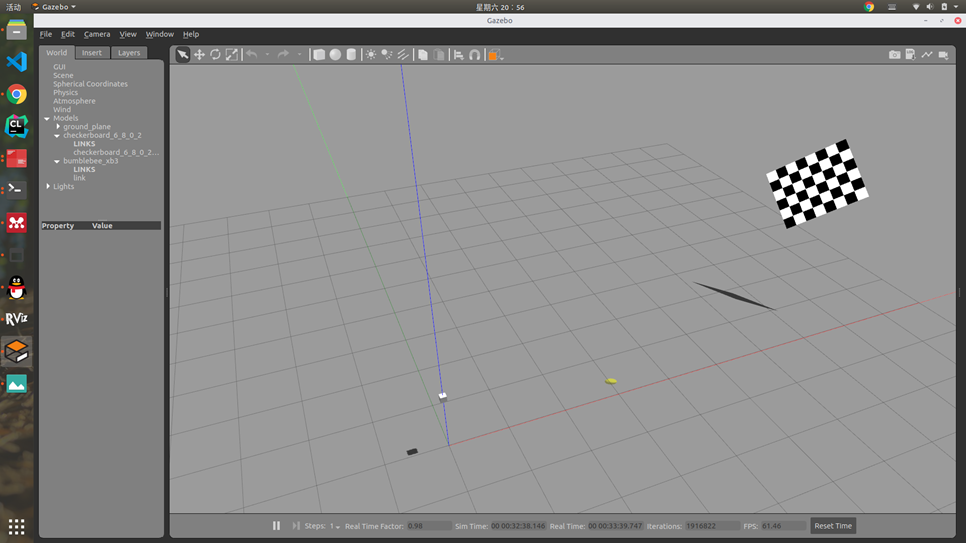

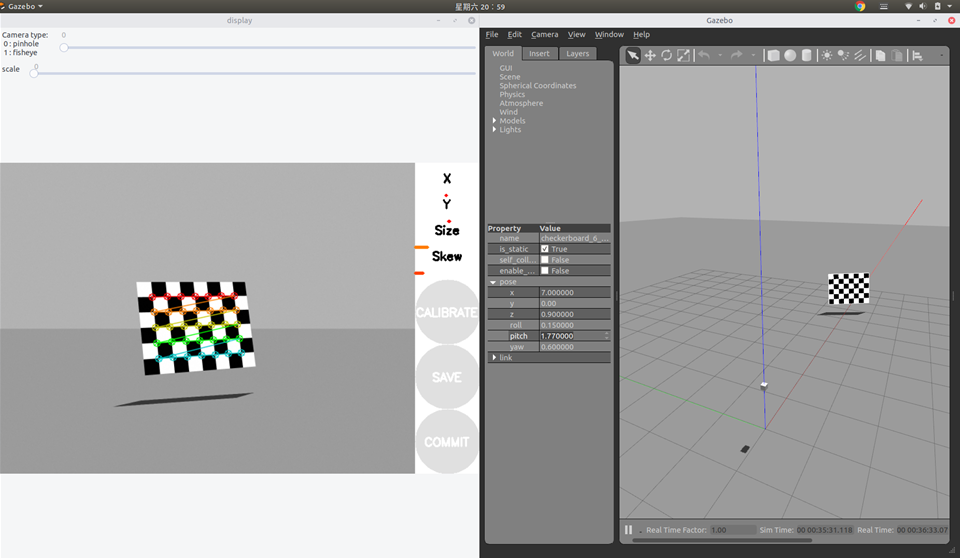

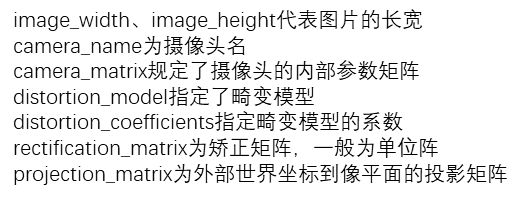

首先进行ROS下Gazebo场景搭建,先校准相机,获得相机的参数。

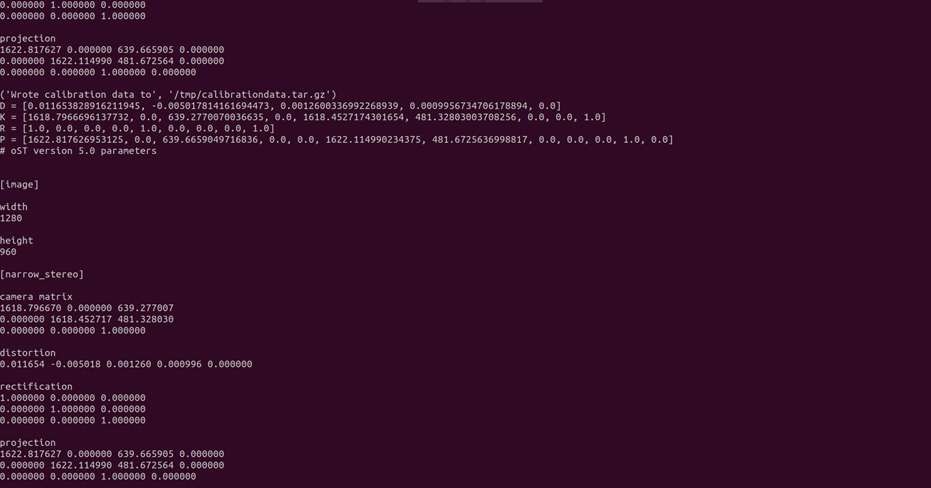

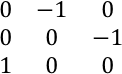

校准完毕后计算结果如下:

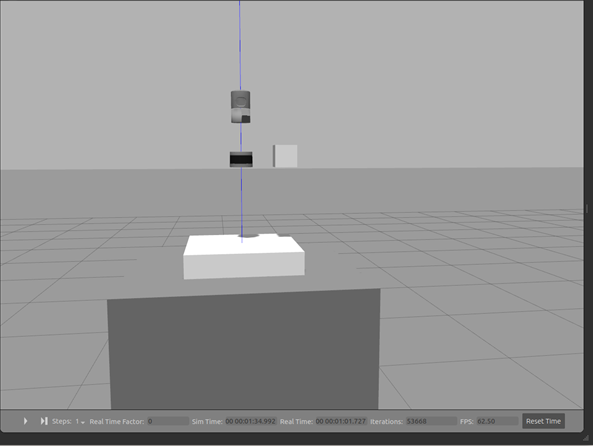

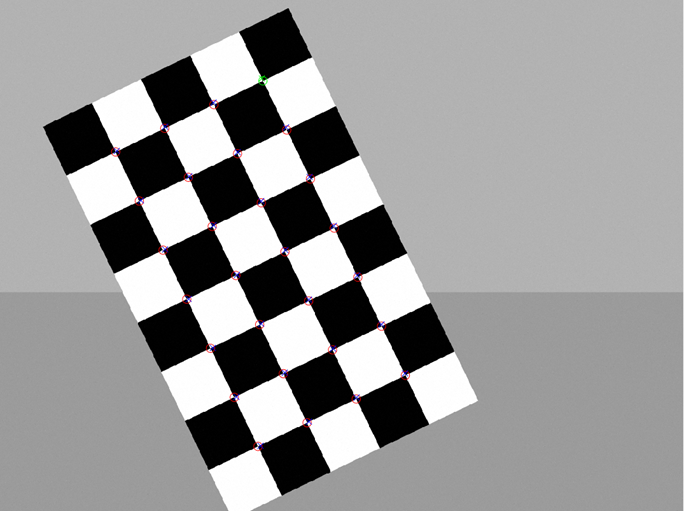

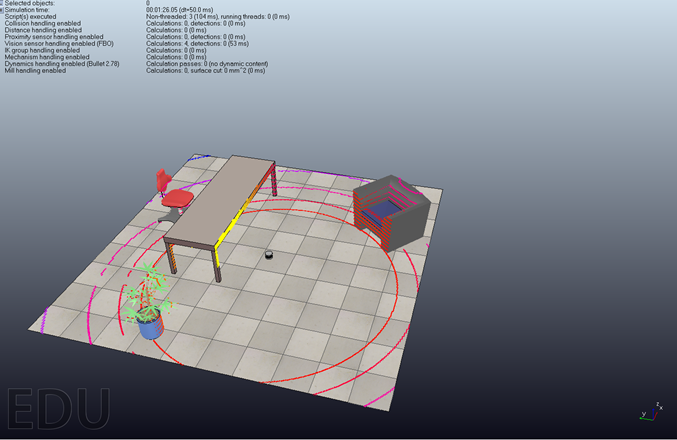

然后再将相机和雷达一起标定,场景搭建如下:

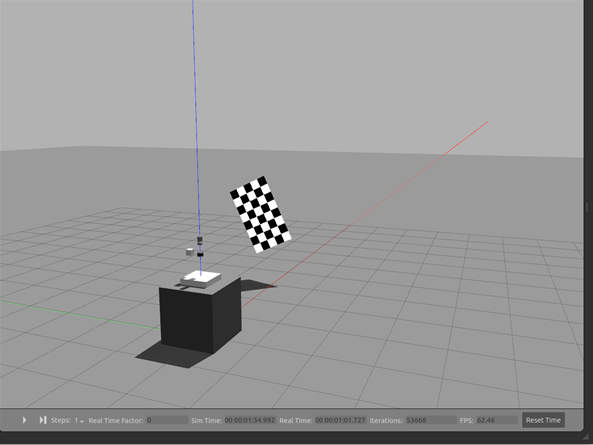

两坐标系相对位姿关系如下所示:

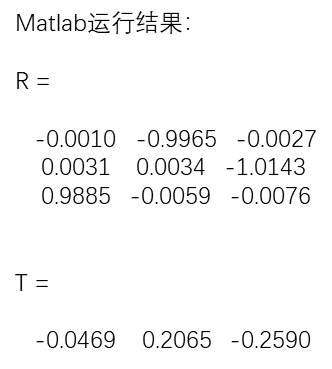

按照仿真环境的设置,摄像头坐标系相对于雷达坐标系的旋转矩阵R为

摄像头相对于雷达坐标系的位移向量T为

分别读取雷达和相机数据20组

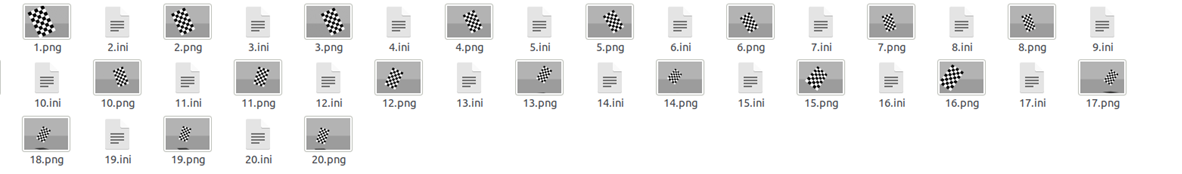

利用PolyWorks软件处理点云,提取标定板的矩形特征并保存为igs格式文件,该文件保存了矩形的四个角点的坐标。

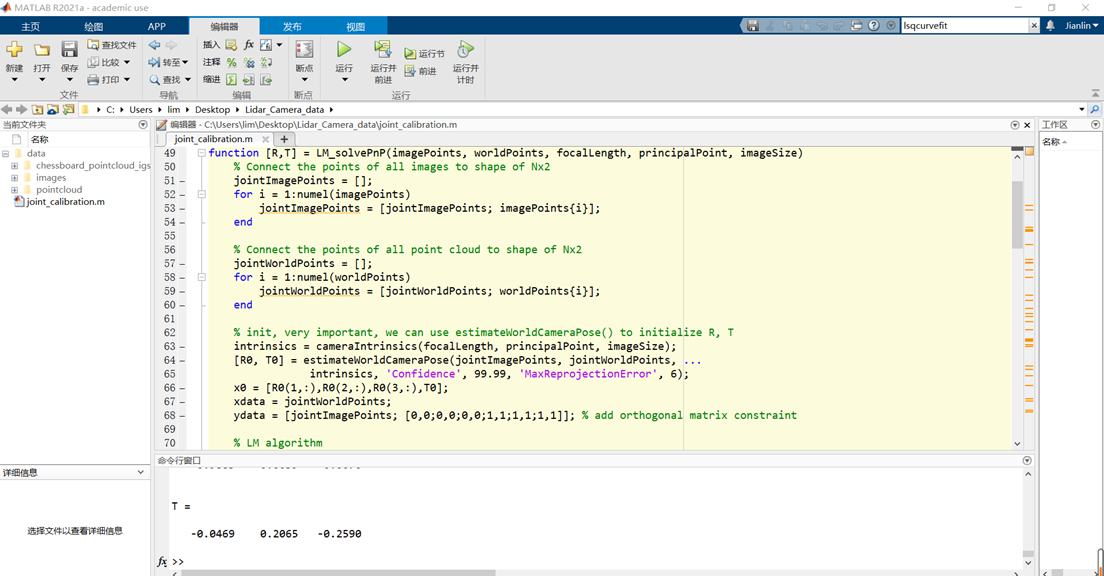

运行Matlab程序

程序的大致思路如下:

1.利用从点云里提取的四个矩形角点坐标将其他的格点坐标都算出来,用X表示,作为Pw。

2.调用Matlab的detectCheckerboardPoints函数找到图像的角点,并估计坐标,用O标出,作为Pc。

3.调用Matlab的lsqcurvefit函数(非线性拟合)去拟合,找到合适的R和T,使得Pc=K*R*(Pw-T)。

可见,基本与之前设置的R与T相近。

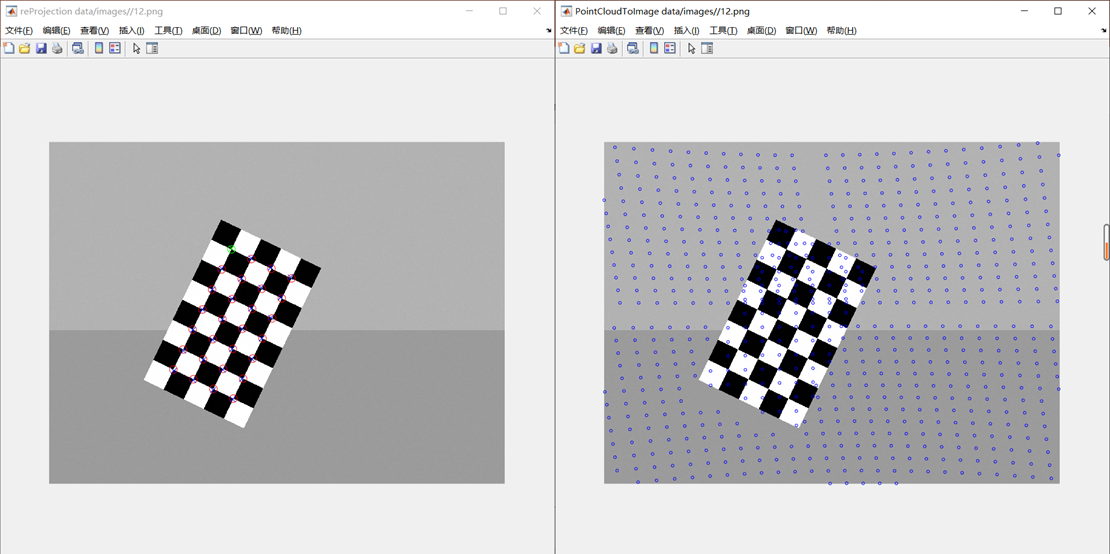

校准结果:

待解决的问题:

1.依赖PolyWorks软件,需要手动找到矩形特征并保存角点坐标,处理20个文件,比较麻烦。尝试用pcl点云库区实现这个操作。

2.依赖Matlab,尝试C++实现非线性拟合。

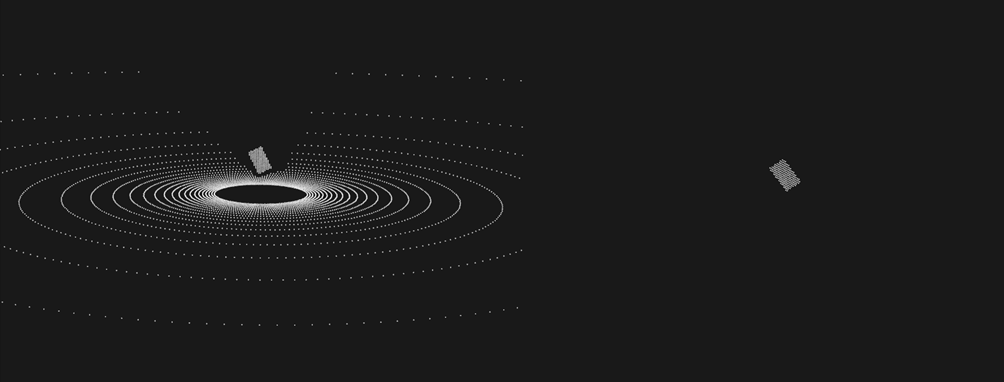

下面的初步的点云滤波处理。左图是原始点云,右图是经滤波之后的点云,只保留板子。

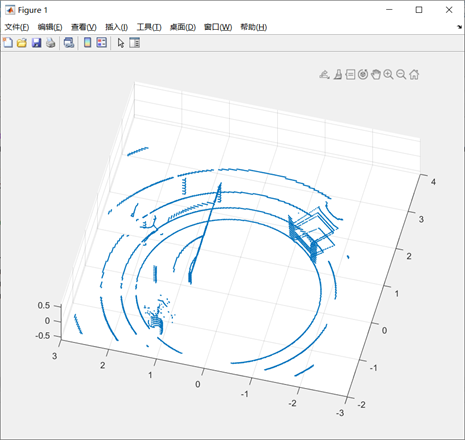

另外还实现了V-Rep与Matlab的通讯,在Vrep里搭建仿真环境,设置好雷达,将数据输出到Matlab并显示。

浙公网安备 33010602011771号

浙公网安备 33010602011771号