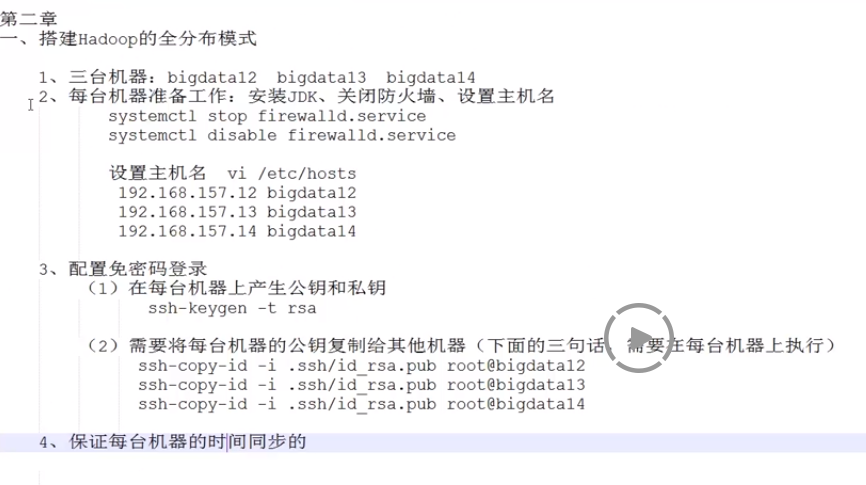

Hadoop——搭建Hadoop的全分布模式

2019-11-24

23:11:50

课程资料:

全分布模式

特点:真正的分布式环境,用于生产

1、三台机器:bigdata12 bigdata13 bigdata14

2、每台机器准备工作:安装JDK、关闭防火墙、设置主机名

systemctl stop firewalld.service

systemctl disable firewalld.service

设置主机名 vi /etc/hosts

192.168.157.12 bigdata12

192.168.157.13 bigdata13

192.168.157.14 bigdata14

3、配置免密码登录

(1)在每台机器上产生公钥和私钥

ssh-keygen -t rsa

(2)需要将每台机器的公钥复制给其他机器(下面的三句话,需要在每台机器上执行)

ssh-copy-id -i .ssh/id_rsa.pub root@bigdata12

ssh-copy-id -i .ssh/id_rsa.pub root@bigdata13

ssh-copy-id -i .ssh/id_rsa.pub root@bigdata14

4、保证每台机器的时间同步的

5、安装Hadoop的全分布环境(在主节点bigdata12上安装,操作与伪分布模式一样)

(1)解压设置环境变量

(2)修改配置文件

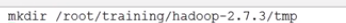

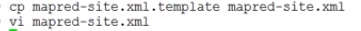

hadoop-env.sh 26行 export JAVA_HOME=/root/training/jdk1.8.0_144 hdfs-site.xml <!--数据块的冗余度,默认是3--> <property> <name>dfs.replication</name> <value>2</value> </property> <!--是否开启HDFS的权限检查,默认:true--> <property> <name>dfs.permissions</name> <value>false</value> </property> core-site.xml <!--NameNode的地址--> <property> <name>fs.defaultFS</name> <value>hdfs://bigdata12:9000</value> </property> <!--HDFS数据保存的目录,默认是Linux的tmp目录--> <property> <name>hadoop.tmp.dir</name> <value>/root/training/hadoop-2.7.3/tmp</value> </property> mapred-site.xml <!--MR程序运行的容器是Yarn--> <property> <name>mapreduce.framework.name</name> <value>yarn</value> </property> yarn-site.xml <!--ResourceManager的地址--> <property> <name>yarn.resourcemanager.hostname</name> <value>bigdata12</value> </property> <!--NodeManager运行MR任务的方式--> <property> <name>yarn.nodemanager.aux-services</name> <value>mapreduce_shuffle</value> </property> slaves: 配置的是所有的从节点 bigdata13 bigdata14 (3)格式化NameNode: hdfs namenode -format

6、将配置好的目录复制到bigdata13和bigdata14上

scp -r hadoop-2.7.3/ root@bigdata13:/root/training

scp -r hadoop-2.7.3/ root@bigdata14:/root/training

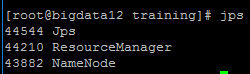

7、启动Hadoop集群(在主节点上):

start-all.sh

stop-all.sh

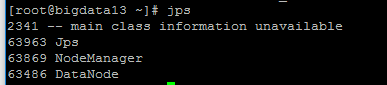

8、验证

(*)命令行:hdfs dfsadmin -report

(*)网页:HDFS:http://192.168.157.12:50070/ Yarn:http://192.168.157.12:8088

浙公网安备 33010602011771号

浙公网安备 33010602011771号