2019/08/29

今日完成

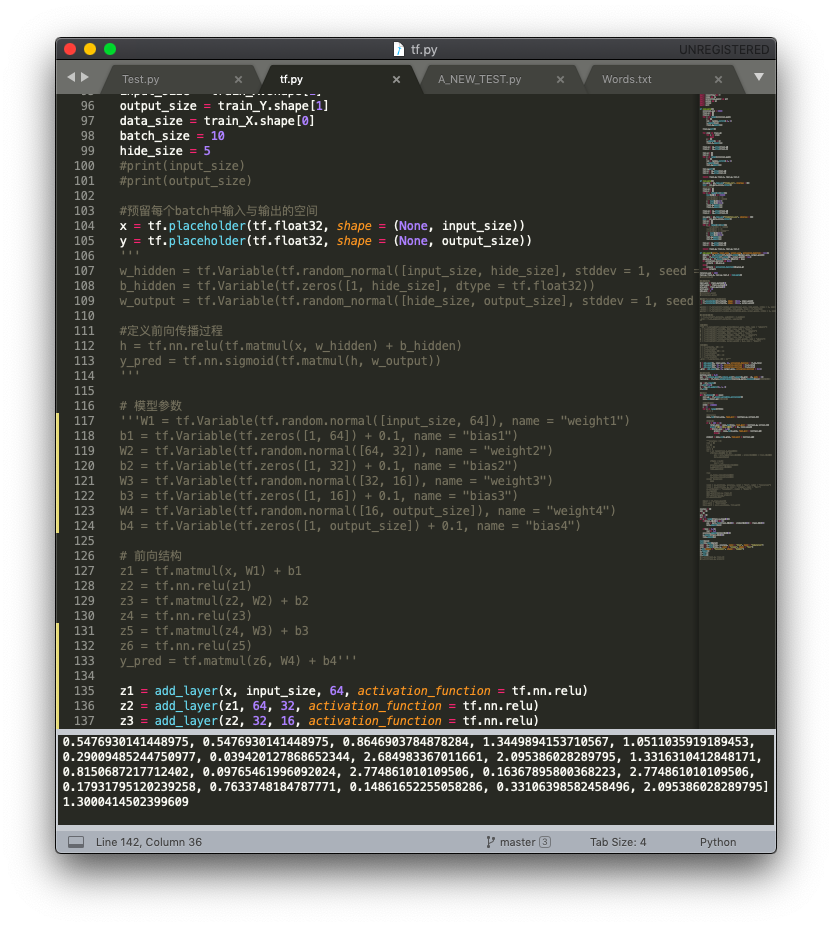

调整了神经网络的参数,从两层隐层扩展为三层隐层

第一层隐层64个节点

第二层隐层32个节点

第三层隐层16个节点

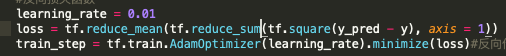

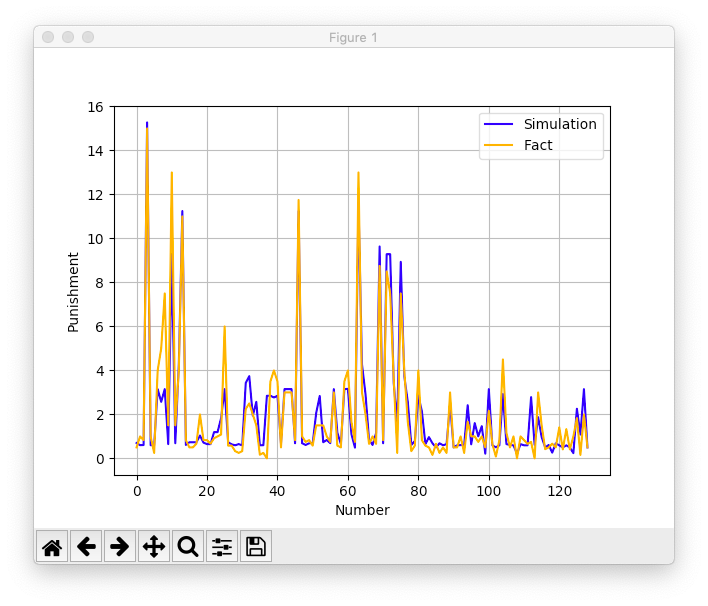

修改了loss fuction

得到了新一轮的拟合曲线

而误差保持在百分之五十七,如果继续进行训练,可以展望结果

明日计划

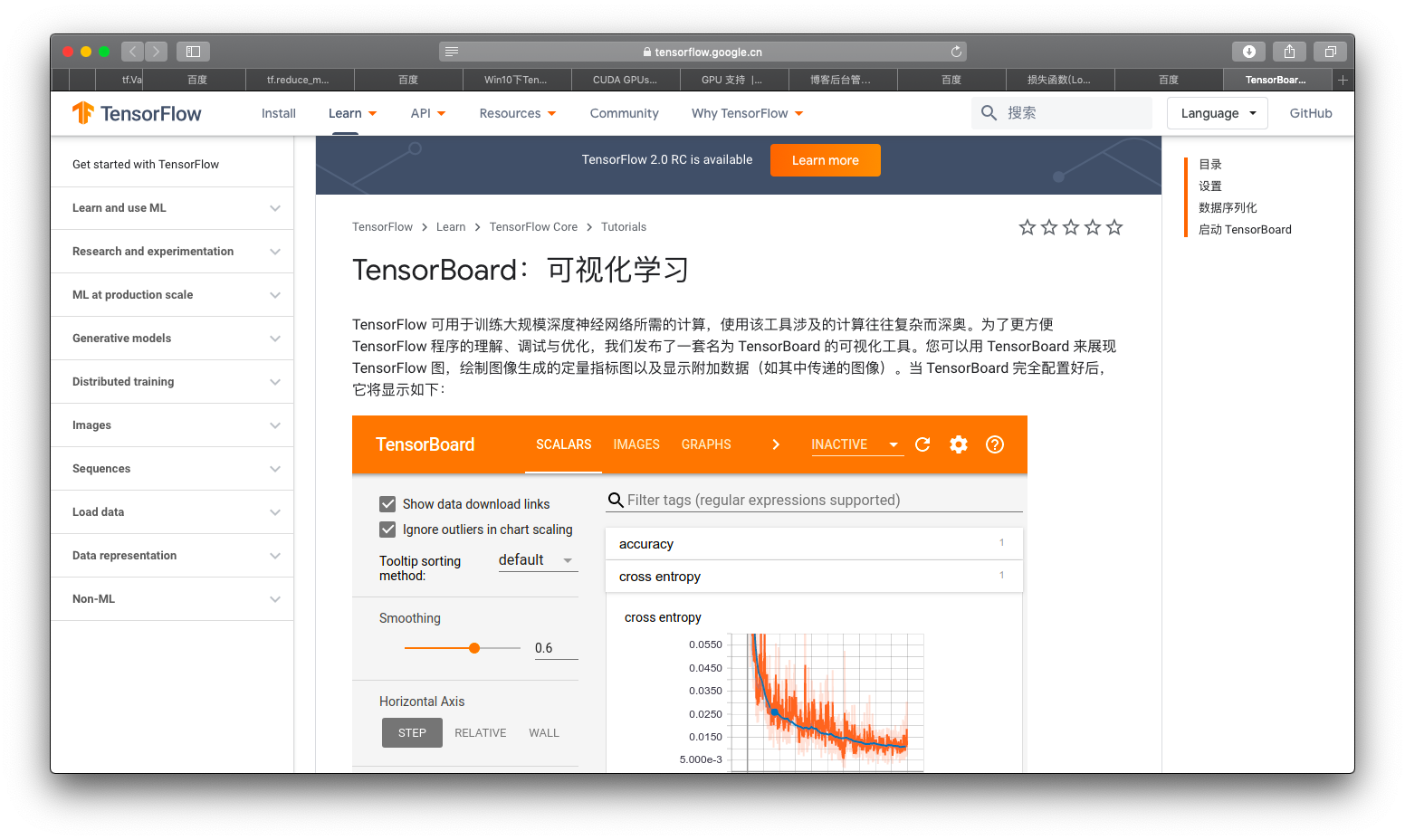

用tensorflow GPU跑模型,更快得到一个结果,做一个可视化

今日感想

非常的重要,非常的重要,loss function和激活函数非常的重要,通过看书我把relu函数换为sigmoid函数,效果显著,loss function稳定下降。

如果在多给一点时间有非常大的可能性收敛。

浙公网安备 33010602011771号

浙公网安备 33010602011771号