代码笔记12 pytorch冻结部分参数的坑

问题

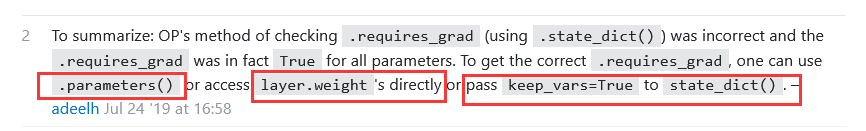

关于在pytorch中冻结参数,我看网上大多都使用了

for param in net.parameters():

param.requires_grad = False

但我的需求是这样的,我创建了一个dict,里面含有对应的tensor的name与param,我想让根据这些名称对网络的参数进行冻结,这就用到了一个我们平时经常使用的查看网络参数的方法。

for name, para in net.state_dict().items:

print(name, para.shape, para.requires_grad)

通过这样的方式,我们可以查看网络中的参数名称,参数值,以及是否需要梯度(是否冻结参数)。

但我这样的方法尝试了好几次发现,这样得出来的requires_grad全部为False。

在此感谢博客[1]

博客中写出关于state_dict()函数的说明可见[2]

在我们需要查看网络中的梯度时,需要使用state_dict(keep_vars=True)

回到原题,当我准备使用freeze_dict的name去冻结网络中的相应参数时,却发现没有效果

def _freeze_parameters(self):

freeze_dict = self.freezedict

state_dict = self.state_dict()

for k, v in freeze_dict.items():

if k in state_dict:

state_dict[k].requires_grad = False

其实问题依旧在keep_vars这里,所以不管我怎么修改,都不会影响网络传播中的梯度。

解决方法

加入keep_vars,修改网络,成功

def _freeze_parameters(self):

freeze_dict = self.freezedict

state_dict = self.state_dict(keep_vars=True)

for k, v in freeze_dict.items():

if k in state_dict:

state_dict[k].requires_grad = False

补充

补充一种今天又看到的方法,来源于[3]

大概是将冻结层转换为列表后,再逐个用parametes()函数设定requires_grad

if freeze_resnet:

layers = [self.layer1, self.layer2, self.layer3, self.layer4]

for layer in layers:

for param in layer.parameters():

param.requires_grad = False

又找到一种办法

for name,para in net.named_parameters():

para.requires_grad = False

再来一个

def freeze(layer):

for child in layer.children():

for param in child.parameters():

param.requires_grad = False

Refrences

[1] https://blog.csdn.net/qq_40268672/article/details/119620630

[2] https://stackoverflow.com/questions/57171426/pytorch-loss-decreases-even-if-requires-grad-false-for-all-variables

[3] https://github.com/Minerva-J/Pytorch-Segmentation-multi-models/tree/master/models

浙公网安备 33010602011771号

浙公网安备 33010602011771号