以色列海法大学开源水下双目惯性数据集!

2023-03-28 09:43 计算机视觉life 阅读(824) 评论(0) 收藏 举报以下内容来自小六的机器人SLAM学习圈知识星球每日更新内容

点击领取学习资料 → 机器人SLAM学习资料大礼包

论文##开源数据集# FLSea: Underwater Visual-Inertial and Stereo-Vision Forward-Looking Datasets

论文地址:https://arxiv.org/abs/2302.12772

作者单位:以色列海法大学

数据集地址:https://www.kaggle.com/datasets/viseaonlab/flsea-vi

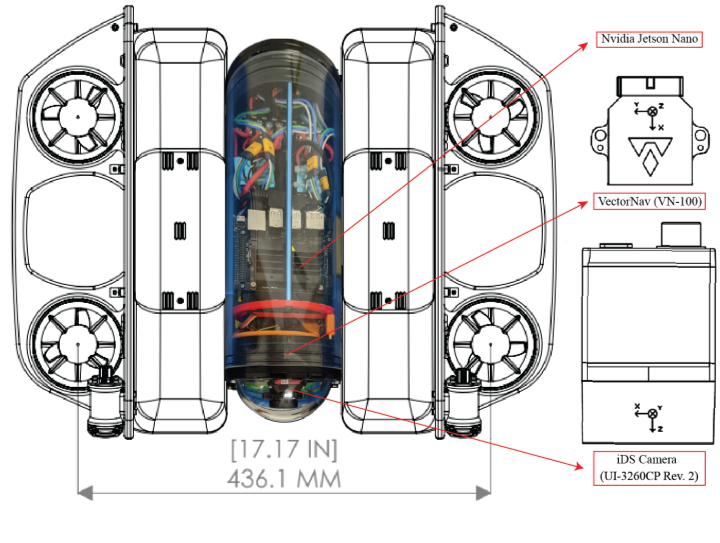

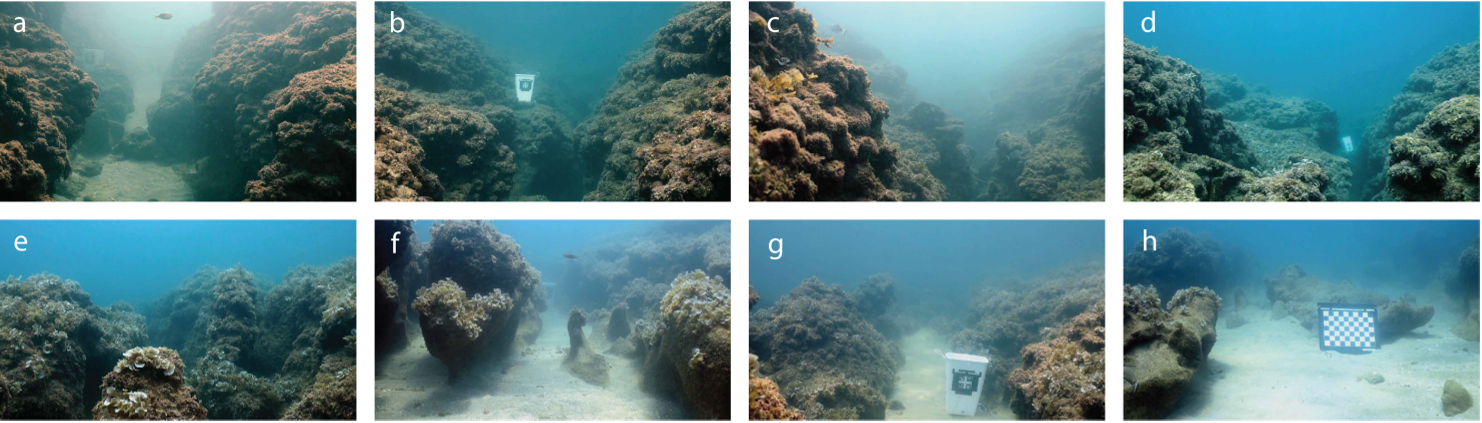

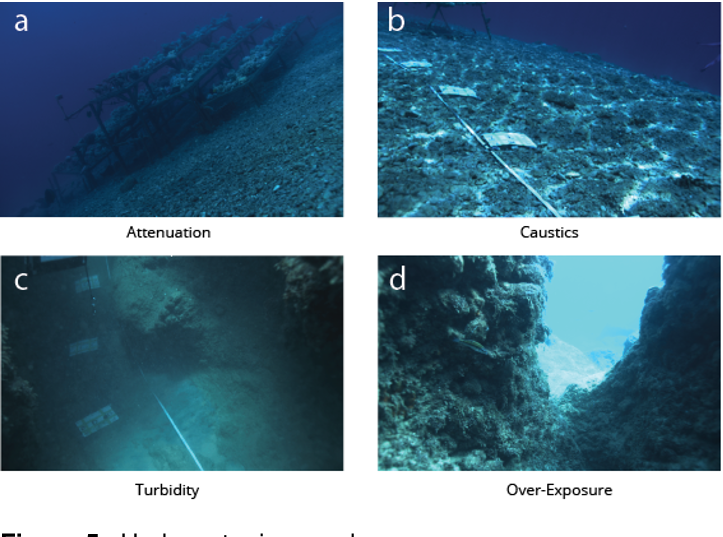

水下的能见度是具有挑战性的,随着拍摄对象和相机之间距离的增加,能见度会降低。这就是为什么前瞻方向的水下计算机视觉任务难度更大。我们在地中海和红海用两个水下成像平台、一个双目相机平台和一个ROV收集了水下前视双目和视觉惯性成像组。据我们所知,在水下环境中,只有一个公开的数据集具有这种相机-传感器方向。这些数据集对于开发几种水下应用至关重要,包括自主避障、视觉里程计、3D跟踪、同步定位和建图(SLAM)以及通过深度学习进行深度估计。

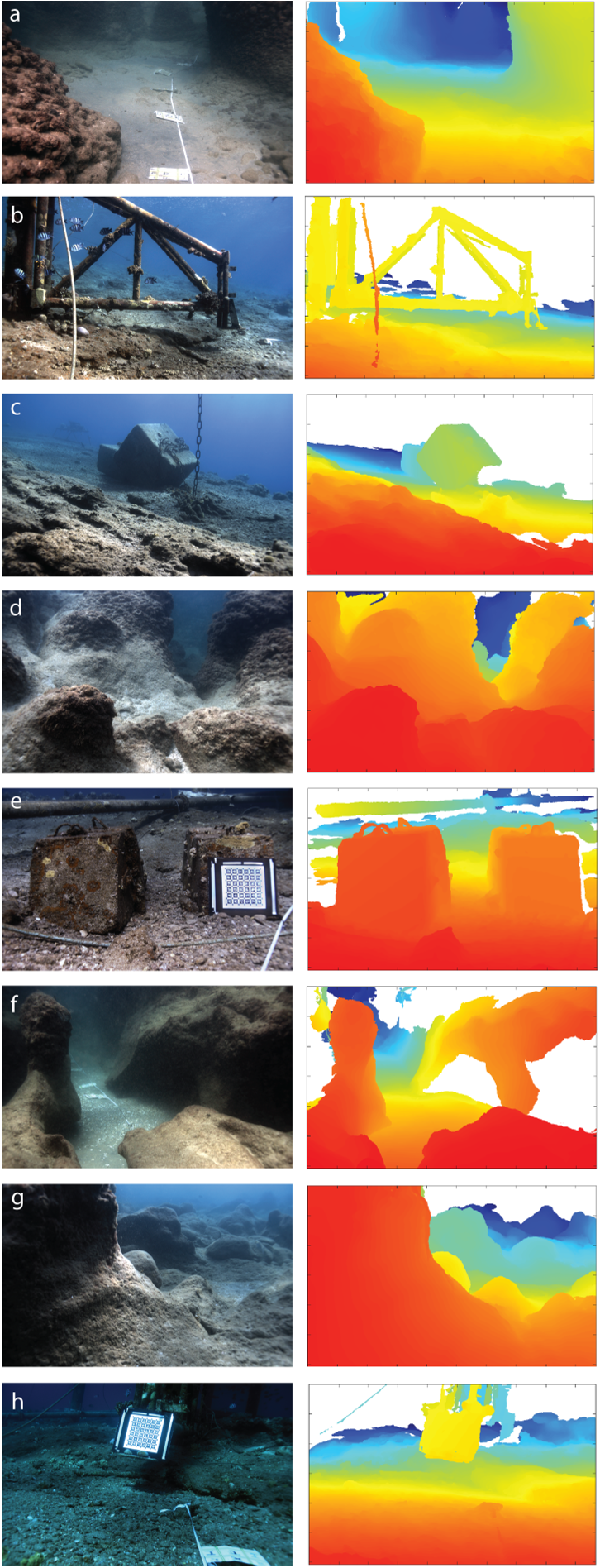

双目数据集包括动态水下环境中具有已知大小的物体的同步立体图像。视觉惯性数据集包含单目图像和IMU测量,与放置在场景中的毫秒分辨率时间戳和已知大小的对象对齐。这两种传感器配置都允许进行比例估计,在双目设置中使用标定的基线,在视觉惯性设置中使用IMU。使用商业摄影测量软件(Agisft Metashape)为这两种数据集类型离线创建了地面真实深度图。地面真实情况通过在整个成像环境中放置的多个已知测量来验证。

总共有5个立体数据集和8个视觉惯性数据集,每个数据集包含数千张图像,其中包括一系列不同的水下能见度和环境光条件、自然和人造结构以及动态相机运动。相机的前瞻性定位使这些数据集独一无二,非常适合测试水下障碍物避免算法,以及在动态环境中接近海底的导航。通过我们的数据集,我们希望促进水下机器人在动态和/或浅水环境中自主功能的进步。

以色列海法大学开源水下双目惯性数据集!

以色列海法大学开源水下双目惯性数据集!

浙公网安备 33010602011771号

浙公网安备 33010602011771号