1.1学习记录|1.2日学习记录|1.3日

1.在linux服务器上创建新用户时,出现了以下问题:

解决办法,通过加sudo啊创建新用户,并不是改文件的属性之类的。

但是在登陆时又说,等不上,因为

/usr/bin/xauth: file /home/user/.Xauthority does not exist

解决:https://www.cnblogs.com/youcong/p/11070351.html

https://blog.csdn.net/li_101357/article/details/69367457这个创建用户的博客比较好,还是谷歌好用。

2.还是在新服务器下配环境和包吧。

从安装conda开始,https://blog.csdn.net/weixin_43840215/article/details/89599559

————————————1.2日————————————

1.还是在安装torch,不好确定是安装哪个版本的,cudnn和cuda都还没有安装,

https://pytorch.org/get-started/locally/

2.在安装torch时,cudnn会一起安装,只需有nvidia的驱动即可。

https://discuss.pytorch.org/t/how-to-check-if-torch-uses-cudnn/21933

3.使用下面语句安装,出现了问题torch包导入不进来。

conda install pytorch torchvision cudatoolkit=10.1 -c pytorch

所以选择安装cuda。版本就是下面对应的版本:

cuda10.0.

但是安装需要sudo权限,

https://blog.csdn.net/wf19930209/article/details/81879514 这个cuda安装教程不错。

跟着这个将cuda安装成功了。

cuda的网址:https://developer.nvidia.com/cuda-toolkit-archive

cat /usr/local/cuda/include/cudnn.h | grep CUDNN_MAJOR -A 2

查看cudnn版本。

接下来尝试安装cudnn。https://developer.nvidia.com/rdp/cudnn-archive

下载的cuDNN Library for Linux,不知道能不能行。

5.如何查看已安装的python包?

>>> help("modules")

即可。

https://blog.csdn.net/DarrenXf/article/details/82182449 这个指导安装,

然后用下面语句查看cudnn版本:

cat /usr/local/cuda/include/cudnn.h | grep CUDNN_MAJOR -A 2

安装成功。

6.sem格式转换

在这里关于sem格式转换成json,而且这个数据集如此之火,肯定有在我之前做预处理的。

预处理总是一件令人很烦的事情,我上次想参加一个比赛,就黄在了数据预处理。。

在github上找到了一个预处理的文件。

1.3日:

1.因为python文件是通过shell脚本运行的,并且指定参数,但是在pycharm端指定的编译是python3.7,但是

#!/usr/bin/env bash

以上注解加在了shell文件上,并没有什么帮助,可能就无法指定python3.7的编译路径,然后出错。

http://www.voidcn.com/article/p-uzvjrhno-bts.html从这里可以看出pycharm并不支持shell脚本的运行,但是可以通过安装插件来运行。

https://www.plugin-dev.com/plugins/bashsupport/这里可以设置添加支持bash的插件,但是如果这样的话,我不就是本地运行了?因为我paobash是通过远程映射的编译器来进行的。

2.parser = argparse.ArgumentParser()

命令行选项、参数和子命令解析器。(也就是说只针对命令行来的参数。

https://blog.csdn.net/the_time_runner/article/details/97941409

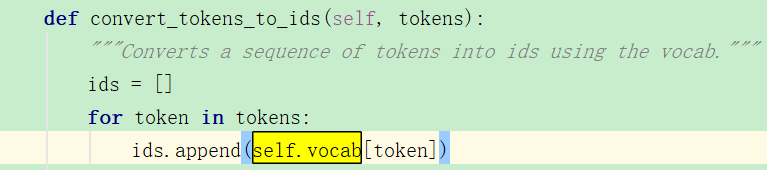

4.抛出keyerror

https://blog.csdn.net/u013210620/article/details/78532993python中的OrderedDict如果关键字不存在那么就会报出keyerror。

5.#!shebang语句

https://www.jianshu.com/p/400c612381dd

可以放在python文件开头作为指定解释器,解释器。

6.抛出了运行时错误

![]()

解决办法是将参数cuda设置为1,服务器上只有一个显卡,不是0,而是1

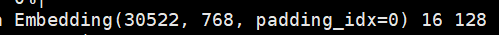

7. 嵌入下标越界

![]()

https://github.com/chenxijun1029/DeepFM_with_PyTorch/issues/1这个试一下

尝试将modeling.py中设置为+1:

然后打印了一个self.word_embeddings的size:是没有问题的。

然后一个batch是16。

https://discuss.pytorch.org/t/embeddings-index-out-of-range-error/12582/2这里说可能是因为UNK没有算进vocab中。

:

:

那么现在就有一个疑问,使用预训练模型的话,预训练模型的vocab和现在使用的数据集的vocab有什么关系呢?

8.预训练如何初始化token的id?

因为这里的token不一定都在vocab中,vocab是对应bert的预训练模型的,也就是说有的token对应不到id?

浙公网安备 33010602011771号

浙公网安备 33010602011771号