论文笔记:InductivE_Inductive Learning on Commonsense Knowledge Graph Completion

Type: research paper

Research domain: knowledge graph completion, commonsense knowledge graph, inductive learning

Public date: 2021

Model/Algorithm: InductivE

Architecture of model/Processing of algorithm:

Main idea:

-

本文提出一个基于归纳学习(inductive learning)的常识知识图谱补全框架,旨在从可见实体构成的图中归纳出常识模式,从而用于实现不可见实体的补全,即本文提出的常识知识补全。

-

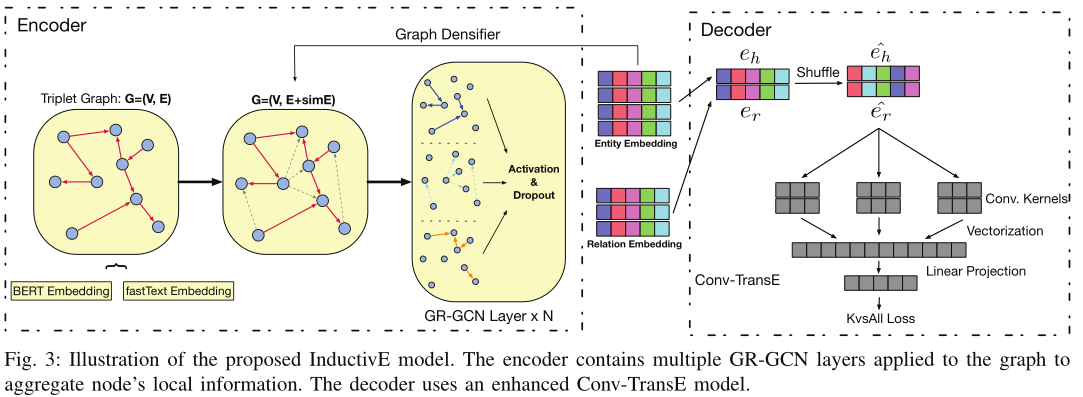

本文整体架构为encoder-decoder架构,整体和SACN很像,框架一共包含三大部分:free-text encoder,graph encoder以及Conv-TransE decoder。

-

free-text encoder通过使用预训练好的Bert 以及fast text对知识图谱中的实体以及简短的文本描述进行联合embedding,将其映射为\(d\)维向量方便后续运算;

-

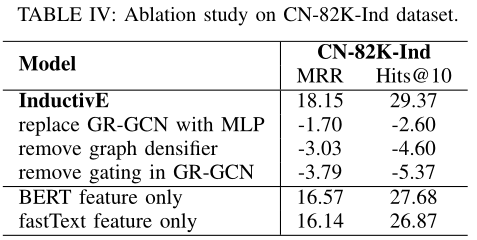

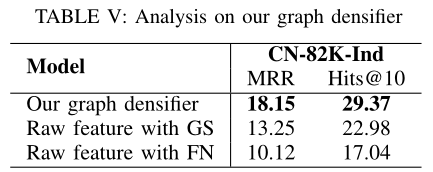

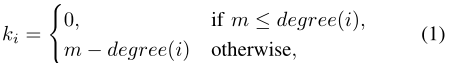

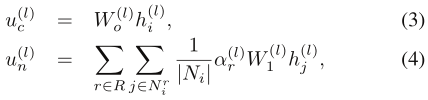

graph encoder则是负责图稠密化以及完成对(head,relation)对的特征提取操作,图稠密化主要是通过比较两实体经由GCN处理后的特征向量的余弦相似度判定是否属于语义相近的实体,如果是,则根据阈值\(m\)(超参数)判断是否需要增加边,少于\(m\)则取相似实体的\(k\)个最近邻居进行补齐,如式(1),并且在训练过程中迭代地进行更新,以此实现图的稠密化;稠密化后的图输入进加入门控机制的R-GCN(GR-GCN)中,此处进行图卷积操作,\(h^{(l)}\)为经过\(l\)层图卷积后的实体的表示,\(\beta\)代表门控机制,其实就是设置自转换以及邻居信息的比重用以生成下一层的表示,最终通过sigmoid函数将值映射到(0,1)区间内,\(W_o\)以及\(W_1\)分别代表自转移矩阵以及邻居转移矩阵。

![image]()

![image]()

![image]()

![image]()

-

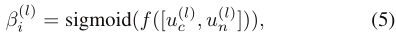

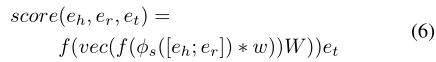

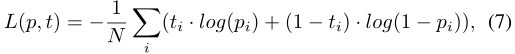

本文对Conv-TransE也进行了改进,改进措施为在卷积操作之前进行了维度混洗的操作(打乱特征顺序),目的是实现跨维度的更多交互,\(\phi_s\)为混洗操作,\(w\)代表卷积核,\(\phi_s * w\)代表卷积操作,\(vec()\)代表将多个特征图拼接到一起再进行向量化,最后通过转移矩阵\(W\)映射回d维向量。因为头实体加关系对最终对应的可能不止一个尾实体,所以将其看成一个多标签分类问题,对每个候选的实体都求其二元交叉熵损失,最终将所有的候选实体损失相加取平均,其中\(t\)为标签向量,\(t_i\)代表标签的每个维度,取值为或1,表示每个候选实体是否为ground truth,\(p\)代表经sigmoid函数处理过的分数,相当于模型预测的每个候选实体的概率。

![image]()

![image]()

-

Experimental Setup:

| CN | ATOMIC | |

|---|---|---|

| GR-GCN layers | 2 | 2 |

| m | 5 | 3 |

| the frequency of updating graph | every 100 epochs | every 500epochs |

| number of kernels | 300 | 300 |

| kernel size | \(2\times 5\) | \(2\times 5\) |

| learning rate | 3e-4 | 1e-4 |

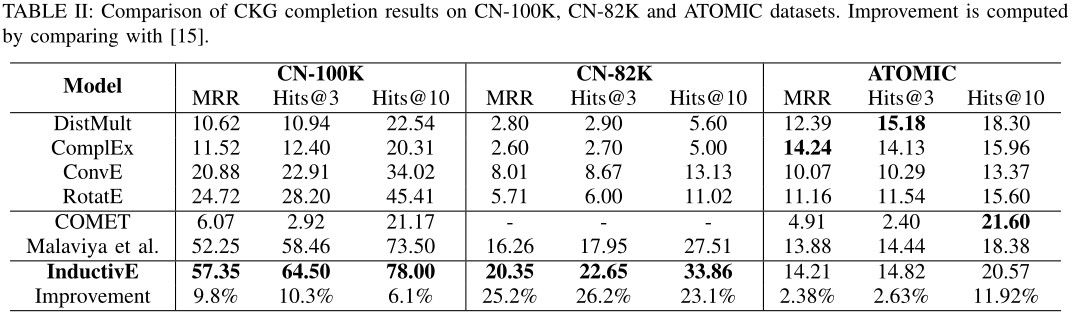

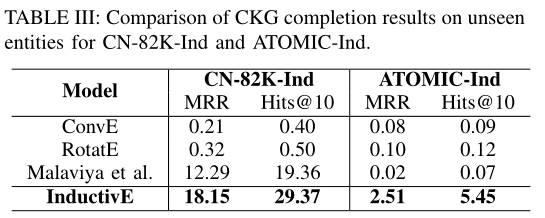

Result:

Evaluation:

本文最大创新点在于提出基于inductive learning 的补全框架以及构造了两个用于该任务的数据集,而单从模型架构来看的话其实算是SACN在常识知识图谱上的全面升级版,很多地方可以对比来看,如embedding生成采用更加成熟的预训练模型而不是由高斯分布中随机产生,引入门控机制去控制邻域信息聚合,相当于升级了WGCN的权重分配,同时引入图稠密化解决数据稀疏问题,decoder方面则是在Conv-TransE基础上加入维度混洗以获取更多交互。

注:本文仅为个人拙见,如有错误之处,烦请大佬指正。

浙公网安备 33010602011771号

浙公网安备 33010602011771号