看遍了市面上的coding plan,我发现还是这个好用

OpenClaw 本质上就是个“吞金兽”。

你给它一句简单指令,后台可能会向大模型发起几十次 API 请求,这种高频次 Token 消耗,是普通 AI 聊天的十几倍。

我之前设置了每日新闻收集的定时任务,刚跑没多久就发现 Token 消耗快到离谱,不得不紧急停掉……

从那之后,我开始研究市面上各家的 Coding Plan,发现真是各有各的玩法,也各有各的坑。

先看模型厂商的“御三家”

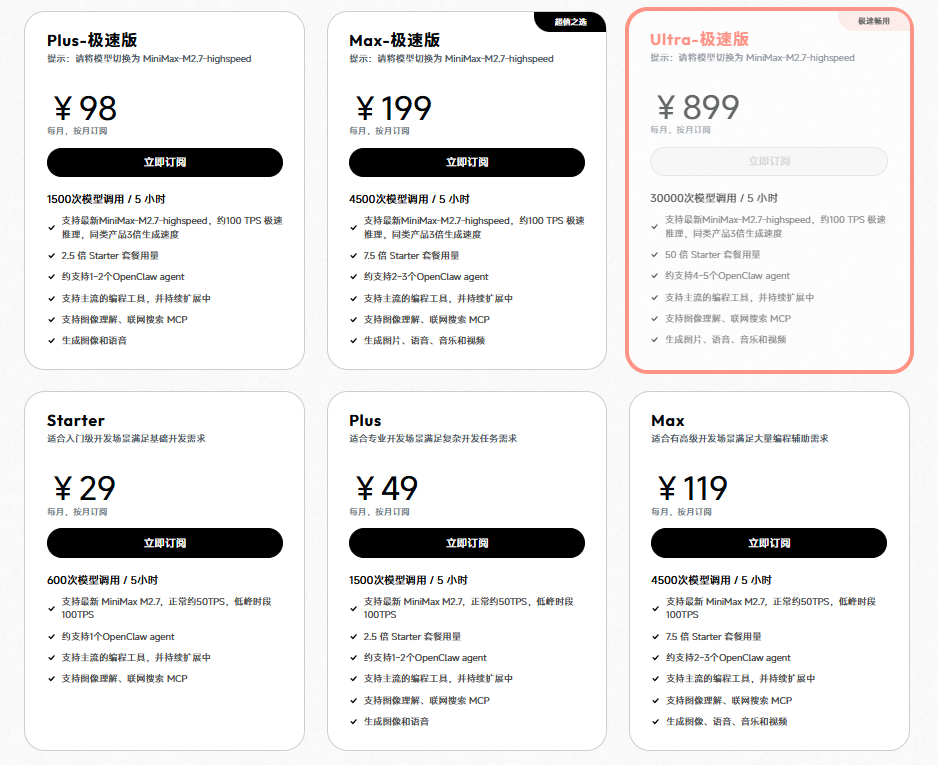

MiniMax Coding Plan

主打自家模型专属体验,从入门到高端档位齐全,额度直接标注调用次数,最透明。

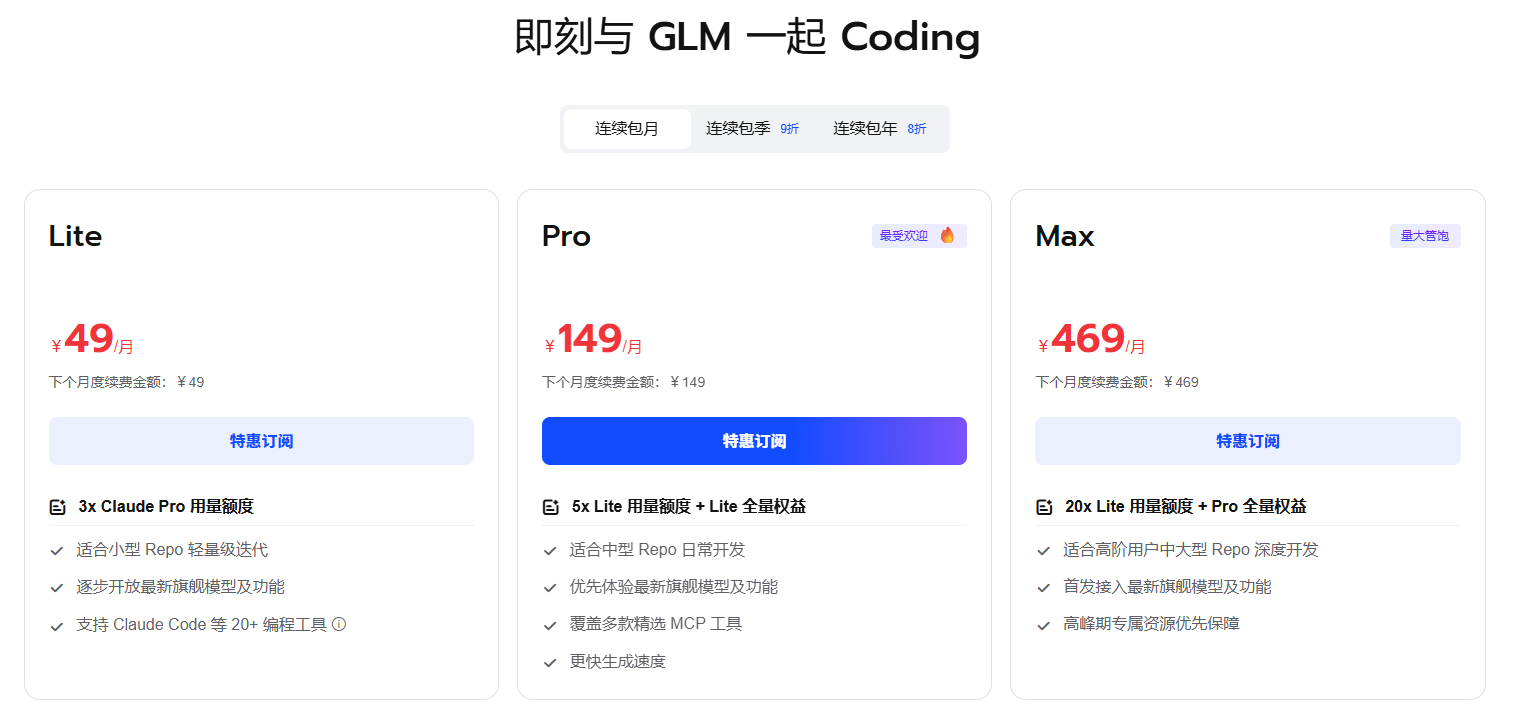

GLM Coding Plan

围绕自家模型打造深度编程能力,长上下文和代码理解是核心卖点,但额度以倍数描述,成本不好精确估算。

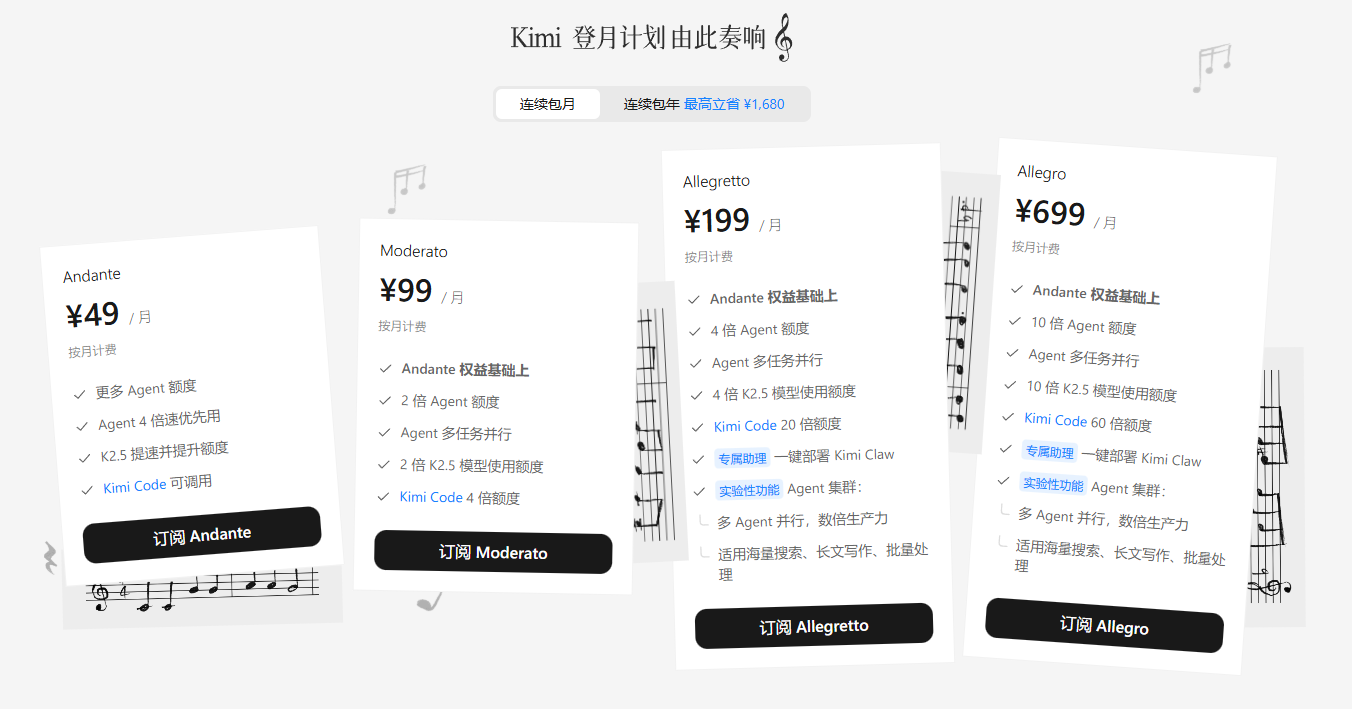

Kimi Coding Plan

侧重超长上下文与实时检索,同样以倍数描述额度,适合重度文档处理场景。

模型厂商 Coding Plan 整体特点:

- 模型高度锁定:只提供自家大模型,优势是适配性、响应速度和能力上限更稳定,但无法切换外部模型。

- 定价梯度精细:从入门到高端、标准版/极速版全覆盖,满足不同强度的研发需求。

- 额度规则差异大:MiniMax 直接标调用次数,Kimi/GLM 用倍数描述,成本感知差异明显。

- 编程生态深度绑定:围绕自家模型构建专属 Code 能力和 Agent 工具链,长上下文、代码并行是核心优势。

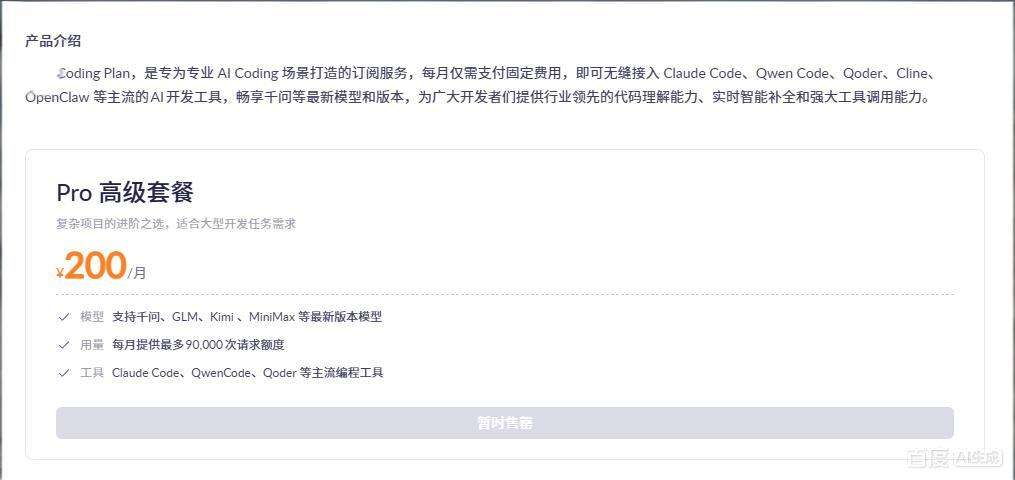

再看云厂商的聚合方案

A 厂

只有 200 元一档可选,选择面太窄。

H 厂

提供两档套餐,定价相对清晰,但是使用额度没有明确标注。

T 家

价格便宜,但需要抢购,饥饿营销太磨人。

B 厂

同样是两档可选,结构简单,也标注了使用额度,还没搞饥饿营销。

云厂商 Coding Plan 整体特点:

- 多模型聚合:一站式调用多家主流模型,无需单独订阅,灵活性更强。

- 定价简单统一:基本只有 Lite/Pro 两档,价格集中在 40 元和 200 元,决策成本低。

- 额度更透明:大多直接给出月度/小时/周调用次数,方便成本预估和用量管理。

- 生态兼容为主:支持 Claude Code 等通用编程插件,广度足够,但深度和专属能力弱于模型厂商。

咱就是说

有没有一个计费不复杂、能自由切换模型、使用简单,付款前能清晰看到使用额度的 Coding Plan?

还真有——九章智算云 Alaya Code Coding Plan!

作为 AI 算力云厂商,我们有自己的算力调度、节点优化、带宽保障。

而且它完美踩中了我所有痛点:

- 多模型全家桶,不绑定单家直接集成当前顶流国产模型:

- MiniMax-M2.5:MoE 架构,编程与工具调用强,支持低成本本地部署

- GLM-5:超大上下文,代码与智能体能力接近闭源旗舰

- Kimi-2.5:超长上下文 + 实时检索,处理文档和多轮对话一绝

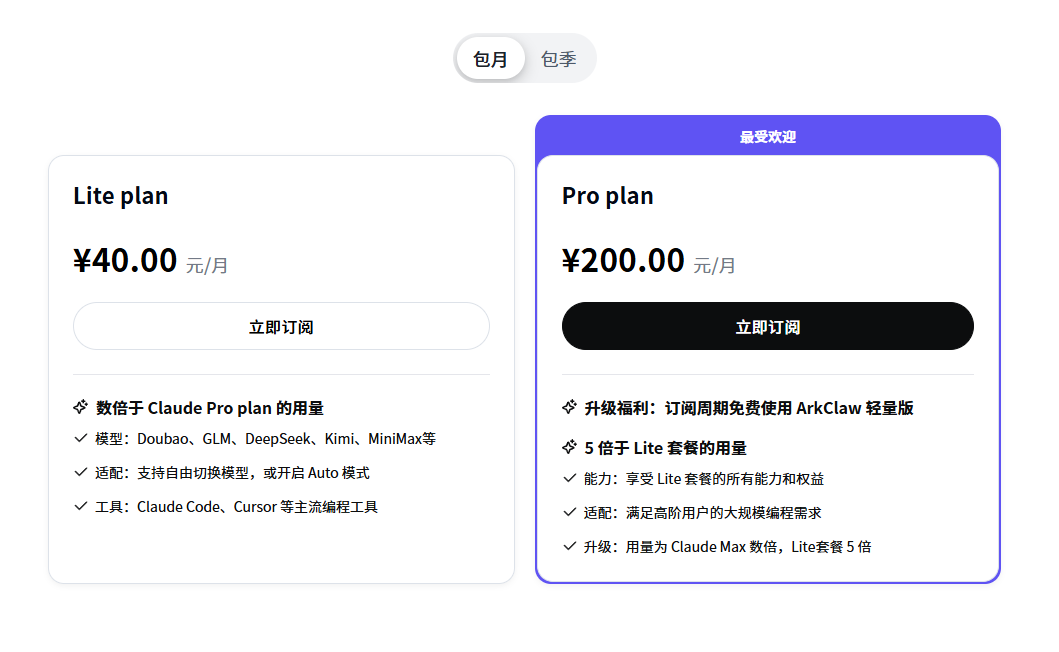

- 定价透明无套路:两档一口价,低价39元,高价199元。不搞饥饿营销、不拆分小时/周限额,付款前就能看清调用量。

对比一下就很明显:

比 H 厂:额度写得明明白白,不用猜;

比 T 家:模型更多一个,用量相当,体验更稳。

左看右看上看下看,都觉得这个Coding Plan的性价比都很高。

更省心的是,它还能完美兼容市面上所有主流 AI 编程工具,接入超级简单,不用改原有代码,不用重写业务逻辑。

不管是 Claude Code、Continue,还是本地部署的 OpenClaw,全都能开箱即用。

你只需要修改 4 行代码里的 base_url 和 api_key 两个配置,就能一键接入,真正做到零成本、零门槛快速集成。

支持工具一览:

- CLI 工具:Claude Code、OpenCode、Codex CLI

- IDE 插件:Cline、Continue

- 本地助手:OpenClaw(可本地部署的个人 AI Agent)

最后,作为 AI 算力云厂商,我们有自己的算力调度、节点优化、带宽保障。

- 不卡顿

- 不限流

- 高峰期不掉线

- 调用成功率更高

如何购买?

第一步:复制下方链接到浏览器

https://www.alayanew.com/?utm_source=official02

第二步:进入主页后点击下图即可购买

这套方案我们内部也一直在用,就是想给大家一个少套路、多真诚的选择。

除了 Coding Plan,平台还支持龙虾云部署一键开通。

想在自己 IDE 里养一只全能 “龙虾”,拥有专属超级大脑全家桶的,真心推荐试试。

早用早下班~

浙公网安备 33010602011771号

浙公网安备 33010602011771号