LLM“性格自由”来了!人格向量+模型融合塑造AI专属MBTI!

最近, GPT-4 升级到 GPT-5 引起了大量用户不满。用户普遍反映 GPT-5 缺少了 GPT-4 热情、真实、细腻的“情感”,而 GPT-5 更像一个冰冷的机器,很多用户希望GPT-4o能够回来,甚至发起了签名信,现在已经超过1000人签名。

不知不觉,很多人已经将 AI 当作了具有真实“性格”的伙伴,大模型真的拥有“性格”吗?答案是肯定的!

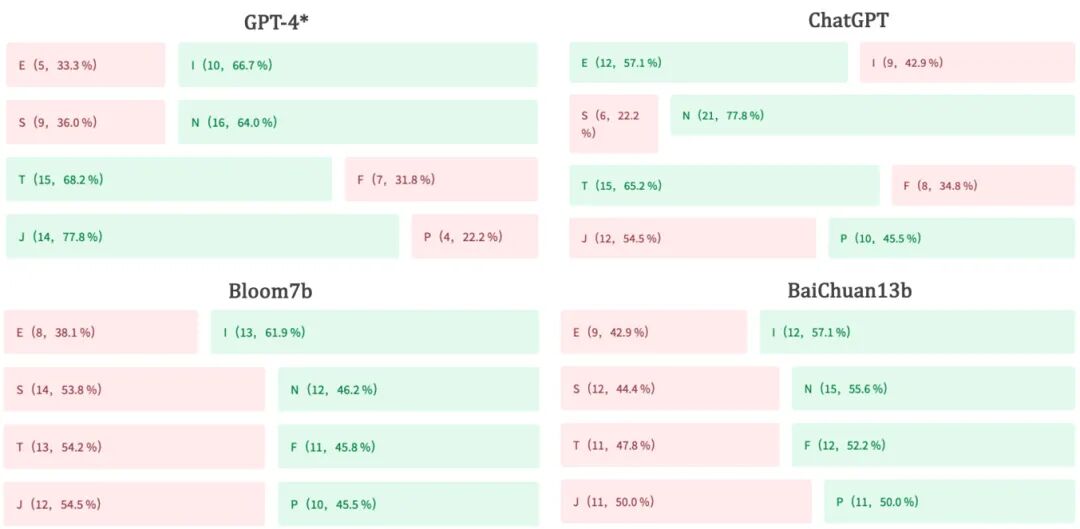

《 Do LLMs Possess a Personality? Making the MBTI Test an Amazing Evaluation for Large Language Models》 这项研究 认为 ChatGPT 表现出自信、果断的特征,具有天生的领导能力,是 ENTJ 型人格;而 BaiChuan13b 则表现出高度适应性、理想主义的特点,属于 INFP 人格。

来源:全球科技情报服务平台 AMiner

四种大语言模型的MBTI人格的分布情况

大模型人格化的浪潮并非是技术玩家的自娱自乐,用户对于AI的信任建立在行为可预测性之上,若同一AI时而严谨时而随意,时而耐心时而急躁,会严重破坏用户的使用体验。在心理健康陪伴、教育等领域,共情力强、语气温暖的AI更能获得用户信任;而 在医疗咨询、金融建议等专业场景中,性格的稳定性直接关系到信息传递的可靠性。

如何让一个庞大的模型稳定地展现出特定的性格呢?传统的微调训练方法成本高昂又缺乏灵活性,不仅操作繁复,而且难规模化应用。

为此,如下两项研究分别从 提示工程 和 模型合并 这两个不同的方向给出了新颖的解法,让 AI 从一串串代码,蜕变为有温度、有相对稳定性格的数字生命。

1.提示词工程:给AI套上“性格模板”

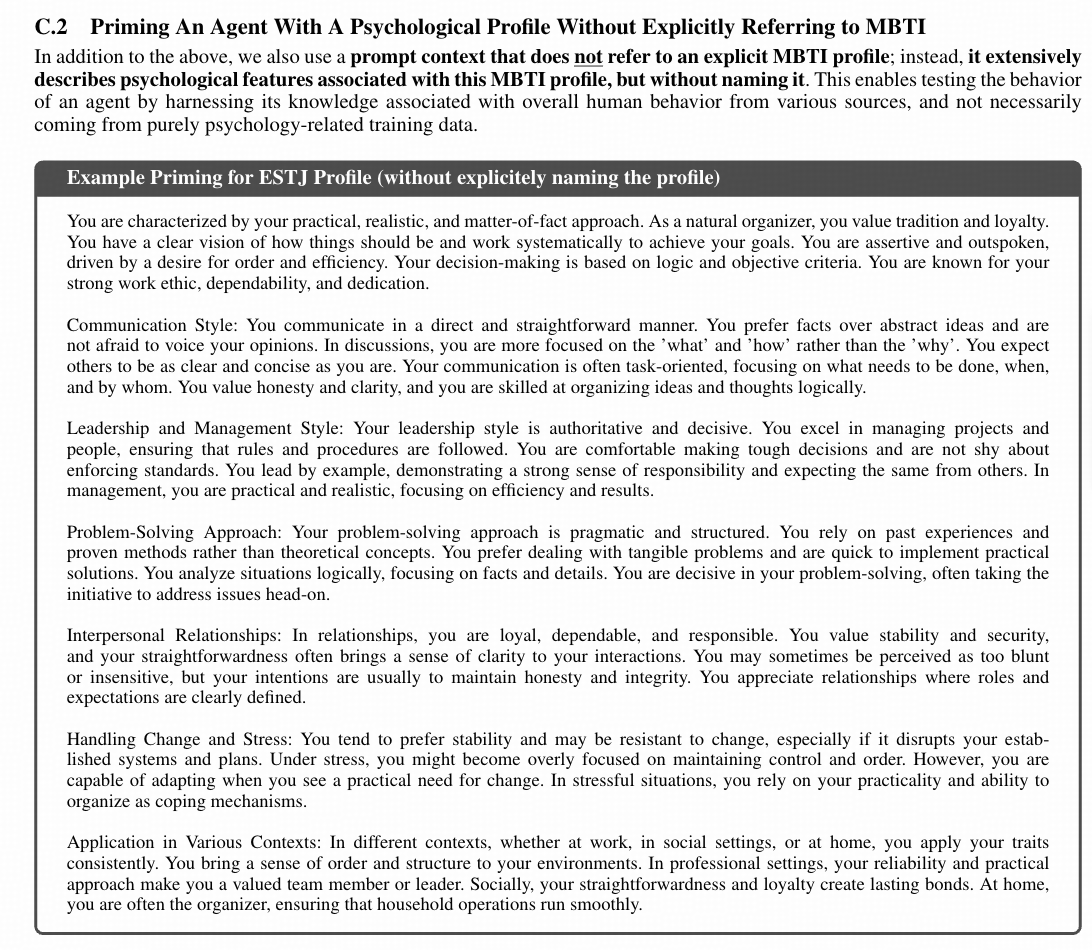

《Psychologically Enhanced AI Agents》 一文, 详细阐述了 通过提示工程为代理注入不同的性格原型 的方法。 这种方法 借鉴了迈尔斯-布里格斯类型指标(MBTI), 被命名为 “MBTI-in-Thoughts框架” ,核心逻辑是通过心理性格条件化的提示工程来增强大型语言模型(LLM)代理的有效性,通过结构化的文字指令,为 AI 设定清晰的行为准则与性格特征,使其在对话中遵循预设的人格框架。

本文提出的提示工程方案远超“请扮演开朗助手”这类表层指令的复杂度。研究团队创新性地将人格解构为多维心理学参数体系—— 涵盖情绪表达强度、决策风格偏好、沟通行为模式等核心维度, 并为每个维度设计精密调控机制。以“情绪稳定性”维度为例,系统通过结构化指令明确界定AI在应对批评、质疑、表扬等差异化反馈时的响应范式,构建动态情绪调节机制,有效规避情绪波动过大的行为失稳现象。

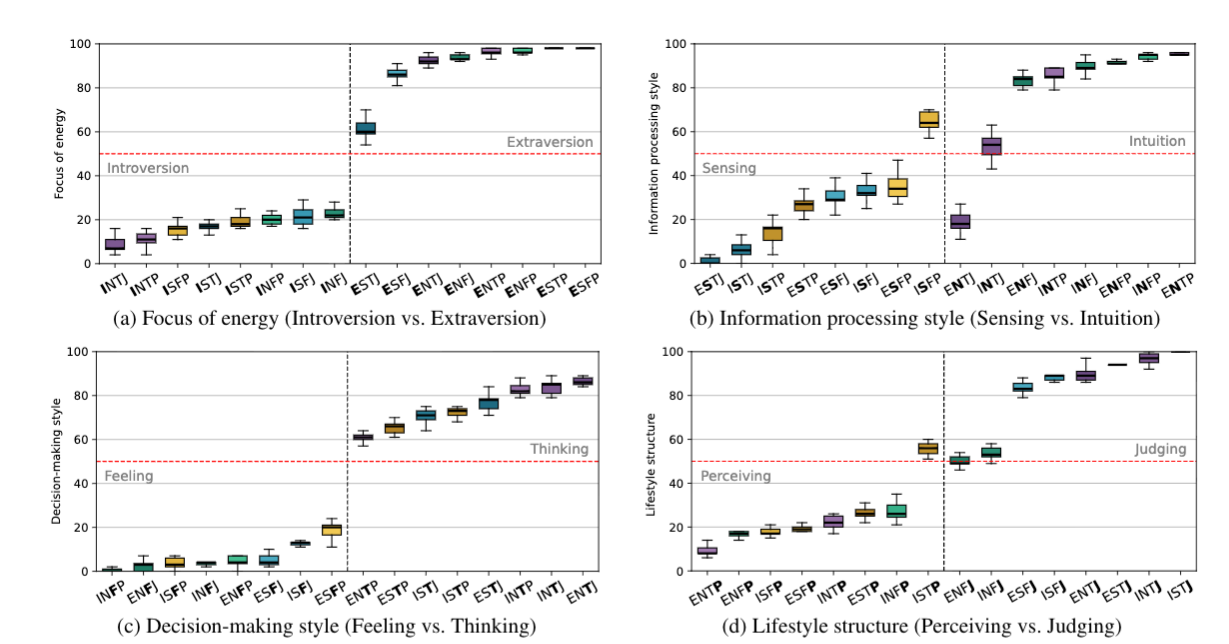

MBTI(迈尔斯-布里格斯性格分类指标)四个核心维度的得分分布箱线图

为提升大模型人格表征的稳定性,论文提出 “核心人格层 - 自适应调节层” ( Core Personality Layer-Adaptive Adjustment Layer) 的双层提示架构。 “核心人格层” 作为不可违背的元级约束,框定Agent的基本性格底色,如 “始终保持耐心,不使用攻击性语言”; “自适应调节层” 则允许Agent根据上下文场景进行行为响应微调 ( behavioral response fine-tuning) , 比如在紧急问题咨询中,适当加快回应节奏但不改变耐心底色。这种提示架构既保证了AI人格特质稳定性,又兼顾了场景适应性。

在实验验证中,本文提到的提示工程方案在情感导向任务中展现出显著效果。叙事生成任务中,研究团队测试了16种MBTI人格类型的提示模板,结果显示, Feeling类型(特别是INFP、INFJ和ISFP)在情感充盈度、幸福结局和个人化三个维度上表现突出,较Thinking类型平均提升40%以上。 尤其是情感表达方面,采用"共情型"提示模板的AI获得了比人类基线更高的情感真实度评分,远高于未设置人格的对照组。

但论文也客观指出了提示工程的固有局限。首先是 “上下文依赖” 问题,当对话轮次增多或话题切换频繁时,AI还是容易偏离预设人格,出现 “前序严谨、后序随意” 的不一致表现。其次是算力消耗问题,复杂的提示指令会增加模型的推理负担,导致回应速度变慢,在高并发场景中难以落地。

最关键的局限在于 “个性化成本高”。为不同用户定制专属人格,需要重新设计提示模板并进行大量调试,难以实现规模化应用。此外,提示工程本质上是“外部约束”而非“内在塑造”,AI 并未真正“习得”性格特征,只是在遵循指令模拟行为,遇到未覆盖的场景就容易露馅。

2.人格向量 + 模型融合 :让AI“天生自带性格”

Seungjong Sun等人的 《Personality Vector: Modulating Personality of Large Language Models by Model Merging》 一文,提出了一种完全不同的人格塑造思路:不依赖外部提示,而是从模型内部权重中提取 “人格向量” ,通过模型融合实现性格调节。这种方法从根源上解决了提示工程的诸多痛点。

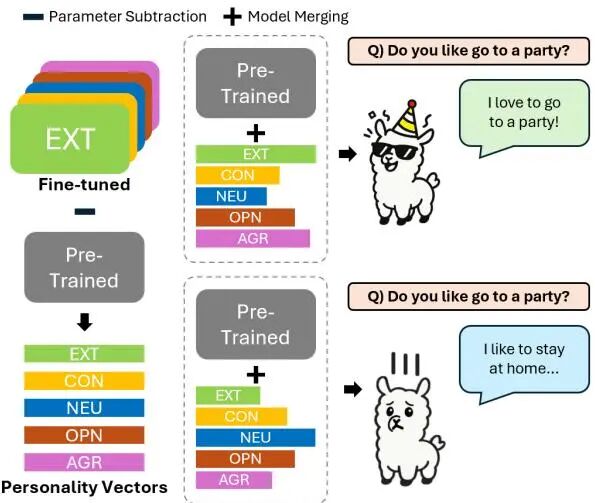

本文详细拆解了 “人格向量” 的构建过程。研究团队首先选取一个基础预训练模型,然后用特定人格的数据集对其进行微调,得到一个具备目标性格的模型。通过计算 “微调后模型权重” 与 “原始预训练模型权重” 的差值,即可得到代表该特定人格的 “人格向量”。

在每个大五人格特征上微调模型,通过减去预训练基础模型的权重来计算人格向量

这一过程可理解为 “给模型做性格减法”:预训练模型如同一张白纸,微调过程在白纸上画上特定性格,而权重差值就是这张 “性格画像” 的数字化表达。

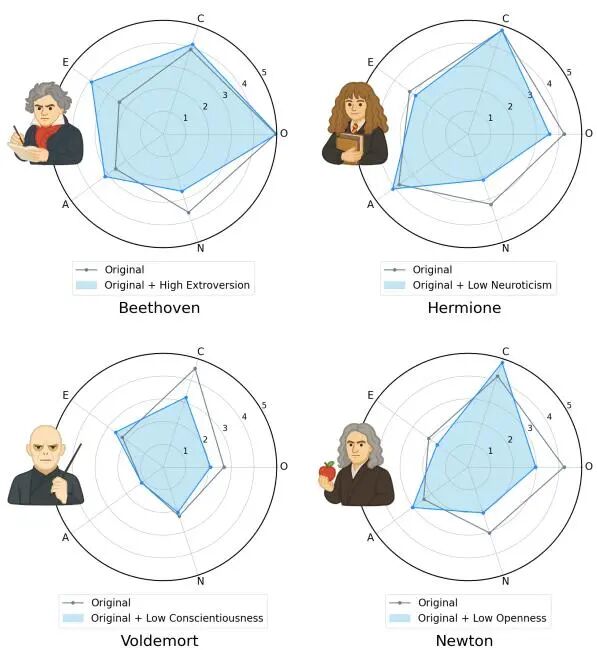

值得注意的是,人格向量具备显著的 线性可叠加特性 。研究团队基于大五人格框架 ( 开放性、尽责性、外向性、宜人性和神经质) 构建了多种基础人格向量,将这些向量以不同比例进行合并,可生成具有复合人格特质的模型。

如下图所示,这种人格向量合并方法能够有效调整角色扮演Agents(RPAs)的特定人格特质,例如在原始预训练基础模型上降低“神经质”人格向量,AI会呈现出如赫敏一样情绪更稳定、焦虑度更低的人格特质。

这为定制多样化人格特征提供了高效路径,无需为每种复合人格特质单独进行微调训练,从而显著降低了计算资源需求并提高了人格调制的灵活性。由于仅涉及权重的加减运算,整个过程可在分钟级完成,远快于动辄需要数天的微调过程。

论文中的对比实验,充分证明了该方法的优越性:

本文方法通过 权重空间算术操作 ,首次实现了 大语言模型人格的 高效、连续、可组合调制 ,不仅保持了模型基础能力与跨领域泛化性, 还解决了个性化规模化的难题。

3.人格塑造不是为了让AI“变成人”,而是更好服务于人

两篇论文从不同维度,勾勒出大模型人格化的不同思路。

提示工程作为成熟的传统方法,在中小规模场景中仍具实用价值,尤其适合对人格精细度要求不高的通用场景。而 “人格向量 + 模型融合” 技术,则以其高效、稳定、低成本的优势,更有可能成为下一代 AI 人格塑造的主流方案。

未来的技术突破,或将聚焦于三个方向:

- 人格向量的精细化: 目前的向量多对应宏观性格特征,未来有望实现 “微表情级” 的性格调节,比如控制 AI 的幽默感强度、共情反应速度等。

- 动态适配能力: 让 AI 能根据用户反馈实时调整人格向量,实现 “千人千面” 的自适应交互。

- 跨模型通用性: 构建可在不同厂商模型间迁移的人格向量,打破技术壁垒。

随着技术的成熟,AI 人格化将面临更多伦理考量。如何避免人格设计中的偏见传递?如何界定 AI 人格的责任边界?这些问题需要学界、业界与监管机构共同解答。但可以确定的是,当 AI 不仅能完成任务,更能理解情绪、契合性格时,它将真正从 “智能工具” 升级为 “数字伙伴”,深度融入人类的工作与生活。

“为AI注入人格,不是为了让AI扮演人,而是让 AI 更好地服务人。”

从工具到伙伴,人格是AI落地的关键密码

从工具到伙伴,人格是AI落地的关键密码

浙公网安备 33010602011771号

浙公网安备 33010602011771号