卷积神经网络视频学习

绪论

卷积神经网络应用:

分类、检索、检测、分割

例如:人脸识别、表情识别、图像生成、图像风格转化、自动驾驶

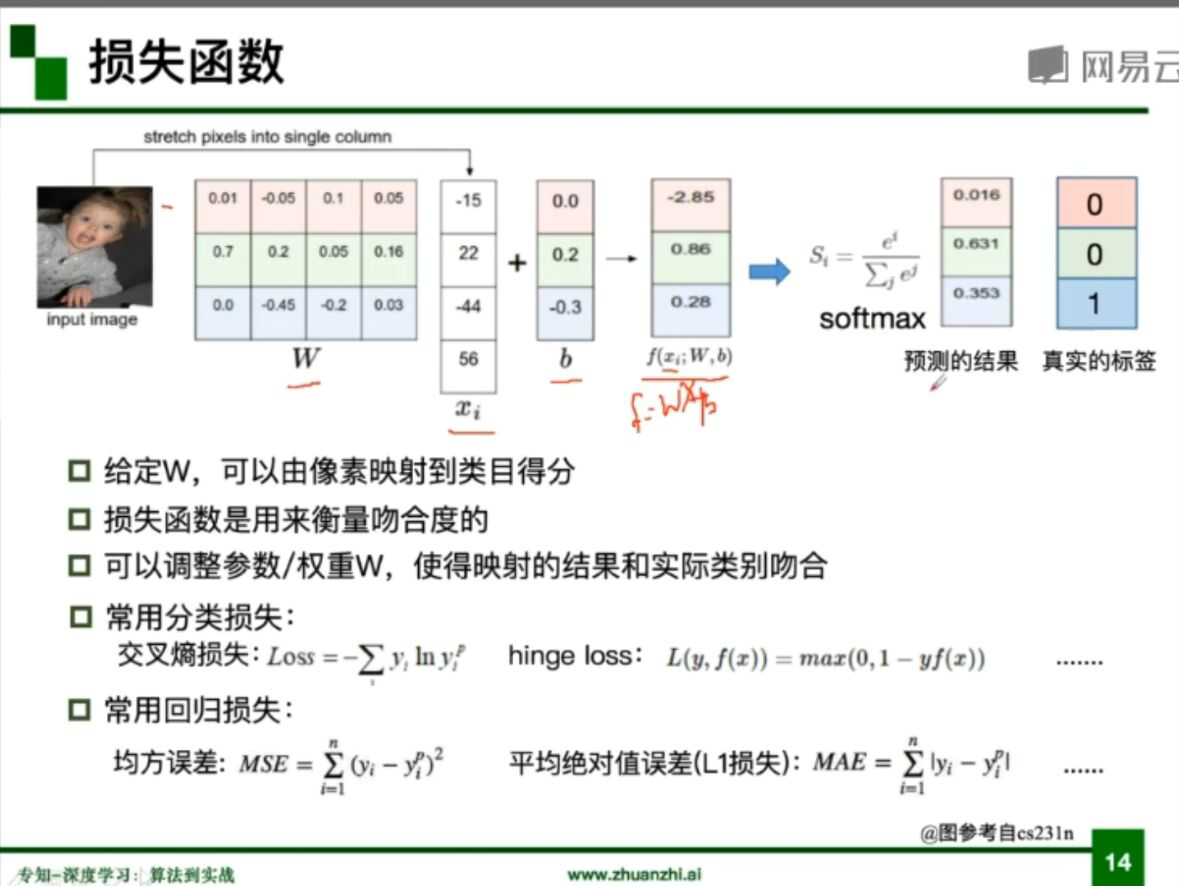

深度度学习:

- 搭建神经网络结构;

- 找到一个合适的损失函数;

- 找到一个合适的优化函数,更新参数。

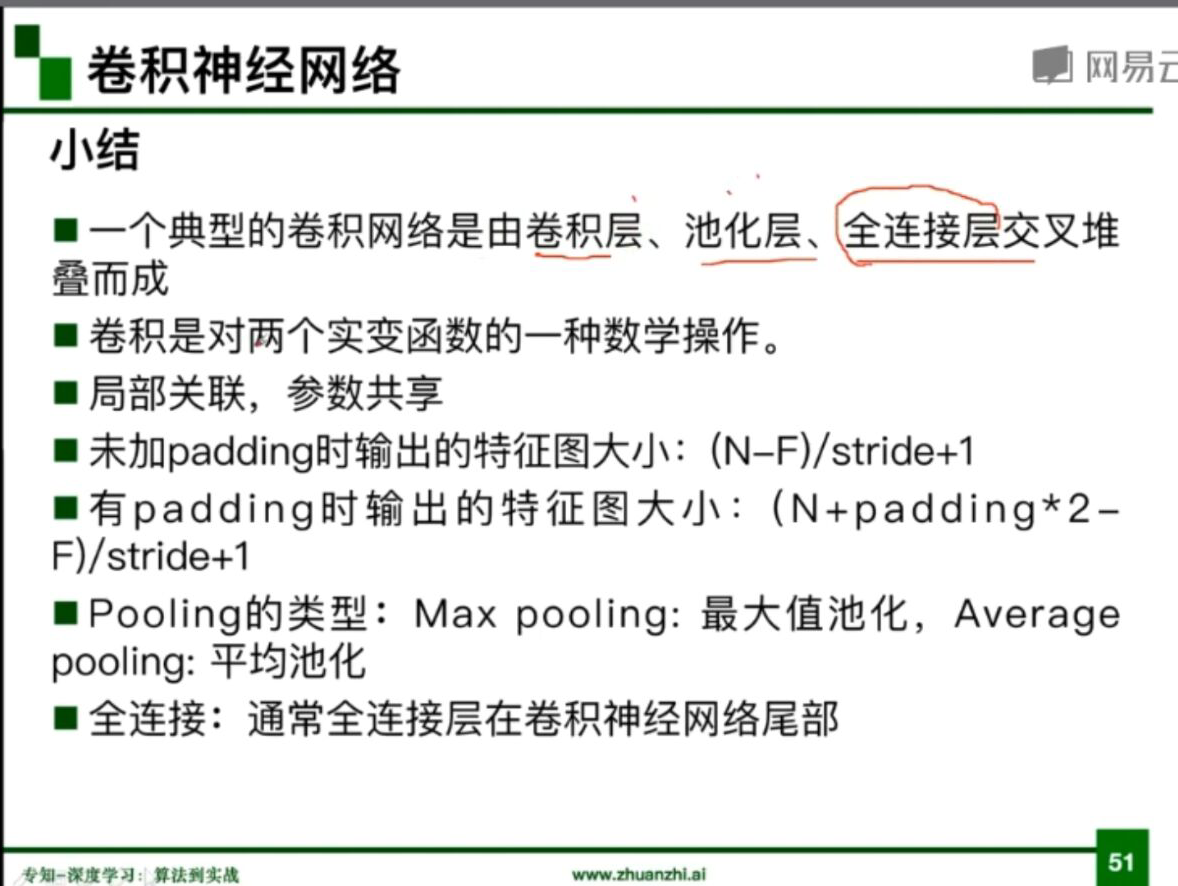

基本组成结构

- 卷积

- input:输入

- kernel/filter:卷积核/过滤器

- weight:权重

- receptive filed :感受野

- activation map:特征图

- padding

- channel:深度

- output:输出

- 池化

- 全连接

卷积神经网络典型结构

AlexNet

ReLU 函数:

优点:

- 解决了梯度消失问题(在正区间)

- 计算速度特别快,只需要判断是否大于0

- 收敛速度远快于sigmoid

DropOut(随即失活)【随即关闭神经元】作用:防止过拟合

第一次卷积:卷积-ReLU-池化

第二次卷积:卷积-ReLU-池化

VGG

更深的网络,迁移学习,先训练前八层(AlexNet)

GoogleNet

参数量是AlexNet的1/2,没有FC层

Inception V2:插入1*1卷积核进行降维

Inception V3:把5*5卷积核裂变成两个3*3的卷积核

好处:

- 降低参数量

- 增加非线性激活函数,是网络产生更多独立特,表征能力更强,训练速度更快。

stem:卷积-池化-卷积-卷积-池化

多个Inception

输出无额外全连接层

ResNet

残差学习网络

深度152层,无梯度消失现象。

思想:去掉相同的主体部分,从而突出微小的变化。

可以被用来训练非常深的网络。

浙公网安备 33010602011771号

浙公网安备 33010602011771号