Linux常识02

第9章 Linux磁盘管理

学习Linux请加QQ群: 群1(163262181) 群2(148412746) 群3(246401509) 群4(173884211)

跟阿铭学Linux邀请函 (http://www.aminglinux.com),猿课已上线,请加微信aminglinux84索要配套视频教程。

在日常的Linux管理工作中,这部分内容使用还是比较多的。

查看磁盘或者目录的容量

命令 : df

“df” 查看已挂载磁盘的总容量、使用容量、剩余容量等,可以不加任何参数,默认是按k为单位显示的。

[root@localhost ~]# df

文件系统 1K-块 已用 可用 已用% 挂载点

/dev/sda3 14347632 1490876 12127924 11% /

tmpfs 163308 0 163308 0% /dev/shm

/dev/sda1 99150 26808 67222 29% /boot

“df” 常用选项有 “-i” “-h” “-k” “-m”等

“-i” 查看inodes使用状况

文件系统 Inode 已用(I) 可用(I) 已用(I)%% 挂载点

/dev/sda3 912128 66195 845933 8% /

tmpfs 40827 1 40826 1% /dev/shm

/dev/sda1 25688 38 25650 1% /boot

“-h” 使用合适的单位显示,例如 ‘G’

文件系统 容量 已用 可用 已用%% 挂载点

/dev/sda3 14G 1.5G 12G 11% /

tmpfs 160M 0 160M 0% /dev/shm

/dev/sda1 97M 27M 66M 29% /boot

“-k”, “-m” 分别以K, M 为单位显示

[root@localhost ~]# df -k

文件系统 1K-块 已用 可用 已用% 挂载点

/dev/sda3 14347632 1490880 12127920 11% /

tmpfs 163308 0 163308 0% /dev/shm

/dev/sda1 99150 26808 67222 29% /boot

[root@localhost ~]# df -m

文件系统 1M-块 已用 可用 已用% 挂载点

/dev/sda3 14012 1456 11844 11% /

tmpfs 160 0 160 0% /dev/shm

/dev/sda1 97 27 66 29% /boot

简单介绍一下各列所表示的含义,其实如果你的Linux和阿铭的虚拟机一样也是中文显示的话,那么不用说太多,看字面意思就明白了。第一列是分区的名字,第二列为该分区总共的容量,第三列为已经使用了多少,第四列为还剩下多少,第五列为已经使用百分比,如果这个数值到达90%以上,那么你就应该关注了,磁盘分区满了可不是什么好事情,会引起系统崩溃的。最后一列为挂载点,你是否还记得,阿铭在装系统的时候,有说到这个词,”/dev/shm” 为内存挂载点,如果你想把文件放到内存里,就可以放到/dev/shm/目录下。

命令 : du

“du” 用来查看某个目录或文件所占空间大小.

语法 : du [-abckmsh] [文件或者目录名] 常用的参数有:

“-a” 全部文件与目录大小都列出来。如果不加任何选项和参数只列出目录(包含子目录)大小。

[root@localhost ~]# du dirb

4 dirb/dirc

12 dirb

[root@localhost ~]# du -a dirb

4 dirb/filee

4 dirb/dirc

12 dirb

如果du不指定单位的话,默认显示单位为K.

“-b” 列出的值以bytes为单位输出。

“-k” 以KB为单位输出,和默认不加任何选项的输出值是一样的。

“-m” 以MB为单位输出

“-h” 系统自动调节单位,例如文件太小可能就几K,那么就以K为单位显示,如果大到几G,则就以G为单位显示。

[root@localhost ~]# du -b /etc/passwd

1181 /etc/passwd

[root@localhost ~]# du -k /etc/passwd

4 /etc/passwd

[root@localhost ~]# du -m /etc/passwd

1 /etc/passwd

[root@localhost ~]# du -h /etc/passwd

4.0K /etc/passwd

“-c” 最后加总

[root@localhost ~]# du -c dirb

4 dirb/dirc

12 dirb

12 总用量

[root@localhost ~]# du dirb

4 dirb/dirc

12 dirb

“-s” 只列出总和

[root@localhost ~]# du -s dirb

12 dirb

阿铭习惯用 du -sh filename 这样的形式。

磁盘的分区和格式化

阿铭经常做的事情就是拿一个全新的磁盘来分区并格式化。这也说明了作为一个linux系统管理员,对于磁盘的操作必须要熟练。所以请你认真学习该部分内容。在正式介绍Linux下分区工具之前,阿铭需要先给虚拟机添加一块磁盘,以便于我们做后续的实验,如果你也是使用vmware 虚拟机,请跟着阿铭一起来做吧。

- 先关闭正在运行的Linux系统

init 0. - 到vmware的Linux虚拟机界面,点 “Edit virtual machine settings”, 点一下左侧靠下面的 “Add...” 按钮。

- 在左侧选中 “Hard Disk” 默认就是这一行,点右下角的 “Next”, 继续点 “Next”.

- “Virtual disk type” 选择 IDE, 点 “Next”

- 继续点 “Next”, “Disk size” 默认即可,最后点 “Finish”.

命令 : fdisk

fdisk 是Linux下硬盘的分区工具,是一个非常实用的命令,但是fdisk只能划分小于2T的分区。

语法 : fdisk [-l ] [设备名称] 选项只有一个。

“-l” 后边不跟设备名会直接列出系统中所有的磁盘设备以及分区表,加上设备名会列出该设备的分区表。

[root@localhost ~]# fdisk -l

Disk /dev/sda: 17.2 GB, 17179869184 bytes

255 heads, 63 sectors/track, 2088 cylinders

Units = cylinders of 16065 * 512 = 8225280 bytes

Sector size (logical/physical): 512 bytes / 512 bytes

I/O size (minimum/optimal): 512 bytes / 512 bytes

Disk identifier: 0x00018d63

Device Boot Start End Blocks Id System

/dev/sda1 * 1 13 102400 83 Linux

Partition 1 does not end on cylinder boundary.

/dev/sda2 13 274 2097152 82 Linux swap / Solaris

Partition 2 does not end on cylinder boundary.

/dev/sda3 274 2089 14576640 83 Linux

Disk /dev/sdb: 8589 MB, 8589934592 bytes

255 heads, 63 sectors/track, 1044 cylinders

Units = cylinders of 16065 * 512 = 8225280 bytes

Sector size (logical/physical): 512 bytes / 512 bytes

I/O size (minimum/optimal): 512 bytes / 512 bytes

Disk identifier: 0x00000000

[root@localhost ~]# fdisk -l /dev/sda

Disk /dev/sda: 17.2 GB, 17179869184 bytes

255 heads, 63 sectors/track, 2088 cylinders

Units = cylinders of 16065 * 512 = 8225280 bytes

Sector size (logical/physical): 512 bytes / 512 bytes

I/O size (minimum/optimal): 512 bytes / 512 bytes

Disk identifier: 0x00018d63

Device Boot Start End Blocks Id System

/dev/sda1 * 1 13 102400 83 Linux

Partition 1 does not end on cylinder boundary.

/dev/sda2 13 274 2097152 82 Linux swap / Solaris

Partition 2 does not end on cylinder boundary.

/dev/sda3 274 2089 14576640 83 Linux

可以看到刚才阿铭加的一块磁盘 /dev/sdb 的信息。

“fdisk” 如果不加 “-l” 则进入另一个模式,在该模式下,可以对磁盘进行分区操作。

[root@localhost ~]# fdisk /dev/sda

WARNING: DOS-compatible mode is deprecated. It's strongly recommended to

switch off the mode (command 'c') and change display units to

sectors (command 'u').

Command (m for help):

如果你输入 ‘m’ 会列出常用的命令:

Command action

a toggle a bootable flag

b edit bsd disklabel

c toggle the dos compatibility flag

d delete a partition

l list known partition types

m print this menu

n add a new partition

o create a new empty DOS partition table

p print the partition table

q quit without saving changes

s create a new empty Sun disklabel

t change a partition's system id

u change display/entry units

v verify the partition table

w write table to disk and exit

x extra functionality (experts only)

如果你的英文好,我想你不难理解这些字母的功能。阿铭常用的有’p’, ‘n’, ‘d’, ‘w’, ‘q’.

“p” 打印当前磁盘的分区情况。

Command (m for help): p

Disk /dev/sda: 17.2 GB, 17179869184 bytes

255 heads, 63 sectors/track, 2088 cylinders

Units = cylinders of 16065 * 512 = 8225280 bytes

Sector size (logical/physical): 512 bytes / 512 bytes

I/O size (minimum/optimal): 512 bytes / 512 bytes

Disk identifier: 0x00018d63

Device Boot Start End Blocks Id System

/dev/sda1 * 1 13 102400 83 Linux

Partition 1 does not end on cylinder boundary.

/dev/sda2 13 274 2097152 82 Linux swap / Solaris

Partition 2 does not end on cylinder boundary.

/dev/sda3 274 2089 14576640 83 Linux

‘n’ 建立一个新的分区。

‘w’ 保存操作。

‘q’ 退出。

‘d’ 删除一个分区

下面阿铭会把刚才增加的磁盘/dev/sdb进行分区操作。先使用 ‘p’ 命令看一下/dev/sdb的分区状况:

[root@localhost ~]# fdisk /dev/sdb

Device contains neither a valid DOS partition table, nor Sun, SGI or OSF disklabel

Building a new DOS disklabel with disk identifier 0xf4121235.

Changes will remain in memory only, until you decide to write them.

After that, of course, the previous content won't be recoverable.

Warning: invalid flag 0x0000 of partition table 4 will be corrected by w(rite)

WARNING: DOS-compatible mode is deprecated. It's strongly recommended to

switch off the mode (command 'c') and change display units to

sectors (command 'u').

Command (m for help): p

Disk /dev/sdb: 8589 MB, 8589934592 bytes

255 heads, 63 sectors/track, 1044 cylinders

Units = cylinders of 16065 * 512 = 8225280 bytes

Sector size (logical/physical): 512 bytes / 512 bytes

I/O size (minimum/optimal): 512 bytes / 512 bytes

Disk identifier: 0xf4121235

Device Boot Start End Blocks Id System

Command (m for help):

可以看到目前/dev/sdb没有任何分区,下面阿铭给它建立第一个分区:

Command (m for help): n

Command action

e extended

p primary partition (1-4)

使用 ‘n’ 命令新建分区,它会提示是要 ‘e’ (扩展分区) 还是 ‘p’ (主分区) [1] 阿铭的选择是 ‘p’, 于是输入 ‘p’ 然后回车

Command action

e extended

p primary partition (1-4)

p

Partition number (1-4): 1

First cylinder (1-1044, default 1): 1

Last cylinder, +cylinders or +size{K,M,G} (1-1044, default 1044): +1000M

输入 ‘p’ 后,会提示分区数,这里阿铭写 ‘1’, 因为是第一个分区,当然你也可以写 ‘2’ 或 ‘3’, 如果你直接回车的话,会继续提示你必须输入一个数字,接着又提示第一个柱面从哪里开始,默认是 ‘1’, 你可以写一个其他的数字,不过这样就浪费了空间,所以还是写 ‘1’ 吧,或者你直接回车也会按 ‘1’ 处理,接着是让输入最后一个柱面的数值,也就是说你需要给这个分区分多大空间,关于柱面是多大阿铭不再细究,你只需要掌握阿铭教给你的方法即可,即写 “+1000M”, 这样即方便又不容易出错。用 ‘p’ 查看已经多出了一个分区:

Command (m for help): p

Disk /dev/sdb: 8589 MB, 8589934592 bytes

255 heads, 63 sectors/track, 1044 cylinders

Units = cylinders of 16065 * 512 = 8225280 bytes

Sector size (logical/physical): 512 bytes / 512 bytes

I/O size (minimum/optimal): 512 bytes / 512 bytes

Disk identifier: 0x0600660a

Device Boot Start End Blocks Id System

/dev/sdb1 1 128 1028128+ 83 Linux

继续上面的操作,一直创建主分区到4, 然后再一次创建分区的时候则会提示:

Command (m for help): n

You must delete some partition and add an extended partition first

这是因为,在linux中最多只能创建4个主分区,那如果你想多创建几个分区如何做?很容易,在创建完第三个分区后,创建第四个分区时选择扩展分区。

Command (m for help): n

Command action

e extended

p primary partition (1-4)

e

Selected partition 4

First cylinder (385-1044, default 385):

Using default value 385

Last cylinder, +cylinders or +size{K,M,G} (385-1044, default 1044):

Using default value 1044

Command (m for help): p

Disk /dev/sdb: 8589 MB, 8589934592 bytes

255 heads, 63 sectors/track, 1044 cylinders

Units = cylinders of 16065 * 512 = 8225280 bytes

Sector size (logical/physical): 512 bytes / 512 bytes

I/O size (minimum/optimal): 512 bytes / 512 bytes

Disk identifier: 0xef267349

Device Boot Start End Blocks Id System

/dev/sdb1 1 128 1028128+ 83 Linux

/dev/sdb2 129 256 1028160 83 Linux

/dev/sdb3 257 384 1028160 83 Linux

/dev/sdb4 385 1044 5301450 5 Extended

扩展分区,在最后一列显示为 “Extended”, 接下来继续创建分区:

Command (m for help): n

First cylinder (385-1044, default 385):

Using default value 385

Last cylinder, +cylinders or +size{K,M,G} (385-1044, default 1044): +1000M

Command (m for help): p

Disk /dev/sdb: 8589 MB, 8589934592 bytes

255 heads, 63 sectors/track, 1044 cylinders

Units = cylinders of 16065 * 512 = 8225280 bytes

Sector size (logical/physical): 512 bytes / 512 bytes

I/O size (minimum/optimal): 512 bytes / 512 bytes

Disk identifier: 0xef267349

Device Boot Start End Blocks Id System

/dev/sdb1 1 128 1028128+ 83 Linux

/dev/sdb2 129 256 1028160 83 Linux

/dev/sdb3 257 384 1028160 83 Linux

/dev/sdb4 385 1044 5301450 5 Extended

/dev/sdb5 385 512 1028128+ 83 Linux

这时候再分区和以前有区别了,不再选择是主分区还是扩展分区了,而是直接定义大小。有一点阿铭要讲一下,当分完三个主分区后,第四个扩展分区需要把剩余的磁盘空间全部划分给扩展分区,不然的话剩余的空间会浪费,因为分完扩展分区后,再划分新的分区时是在已经划分的扩展分区里来分的。其中/dev/sdb4为扩展分区,这个分区是不可以格式化的,你可以把它看成是一个空壳子,能使用的为/dev/sdb5, 其中/dev/sdb5为/dev/sdb4的子分区,这个子分区叫做逻辑分区。如果你发现分区分的不合适,想删除掉某个分区怎么办?这就用到了 ‘d’ 命令:

Command (m for help): d

Partition number (1-5): 1

Command (m for help): p

Disk /dev/sdb: 8589 MB, 8589934592 bytes

255 heads, 63 sectors/track, 1044 cylinders

Units = cylinders of 16065 * 512 = 8225280 bytes

Sector size (logical/physical): 512 bytes / 512 bytes

I/O size (minimum/optimal): 512 bytes / 512 bytes

Disk identifier: 0x7b9a6af3

Device Boot Start End Blocks Id System

/dev/sdb2 129 256 1028160 83 Linux

/dev/sdb3 257 384 1028160 83 Linux

/dev/sdb4 385 1044 5301450 5 Extended

/dev/sdb5 385 512 1028128+ 83 Linux

Command (m for help): d

Partition number (1-5): 5

Command (m for help): p

Disk /dev/sdb: 8589 MB, 8589934592 bytes

255 heads, 63 sectors/track, 1044 cylinders

Units = cylinders of 16065 * 512 = 8225280 bytes

Sector size (logical/physical): 512 bytes / 512 bytes

I/O size (minimum/optimal): 512 bytes / 512 bytes

Disk identifier: 0x7b9a6af3

Device Boot Start End Blocks Id System

/dev/sdb2 129 256 1028160 83 Linux

/dev/sdb3 257 384 1028160 83 Linux

/dev/sdb4 385 1044 5301450 5 Extended

Command (m for help): n

Command action

l logical (5 or over)

p primary partition (1-4)

l

First cylinder (385-1044, default 385):

Using default value 385

Last cylinder, +cylinders or +size{K,M,G} (385-1044, default 1044): +1000M

Command (m for help): p

Disk /dev/sdb: 8589 MB, 8589934592 bytes

255 heads, 63 sectors/track, 1044 cylinders

Units = cylinders of 16065 * 512 = 8225280 bytes

Sector size (logical/physical): 512 bytes / 512 bytes

I/O size (minimum/optimal): 512 bytes / 512 bytes

Disk identifier: 0x7b9a6af3

Device Boot Start End Blocks Id System

/dev/sdb2 129 256 1028160 83 Linux

/dev/sdb3 257 384 1028160 83 Linux

/dev/sdb4 385 1044 5301450 5 Extended

/dev/sdb5 385 512 1028128+ 83 Linux

Command (m for help): d

Partition number (1-5): 4

Command (m for help): p

Disk /dev/sdb: 8589 MB, 8589934592 bytes

255 heads, 63 sectors/track, 1044 cylinders

Units = cylinders of 16065 * 512 = 8225280 bytes

Sector size (logical/physical): 512 bytes / 512 bytes

I/O size (minimum/optimal): 512 bytes / 512 bytes

Disk identifier: 0x7b9a6af3

Device Boot Start End Blocks Id System

/dev/sdb2 129 256 1028160 83 Linux

/dev/sdb3 257 384 1028160 83 Linux

输入 ‘d’ 会提示要删除哪个分区,可以选择从 1-5 其中1-3是主分区(sdb1, sdb2, sdb3),4是扩展分区(sdb4),5是逻辑分区 [1] (sdb5),如果输入5,则直接把逻辑分区sdb5删除掉,但是如果输入4的话,会把整个扩展分区sdb4干掉,当然也包含扩展分区里面的逻辑分区sdb5。在刚才的分区界面直接 Ctrl + C 退出来,这样刚刚的分区全部都取消了,咱们重新来做分区:

[root@localhost ~]# fdisk /dev/sdb

WARNING: DOS-compatible mode is deprecated. It's strongly recommended to

switch off the mode (command 'c') and change display units to

sectors (command 'u').

Command (m for help): p

Disk /dev/sdb: 8589 MB, 8589934592 bytes

255 heads, 63 sectors/track, 1044 cylinders

Units = cylinders of 16065 * 512 = 8225280 bytes

Sector size (logical/physical): 512 bytes / 512 bytes

I/O size (minimum/optimal): 512 bytes / 512 bytes

Disk identifier: 0x7b9a6af3

Device Boot Start End Blocks Id System

Command (m for help): n

Command action

e extended

p primary partition (1-4)

e

Partition number (1-4): 1

First cylinder (1-1044, default 1): 1

Last cylinder, +cylinders or +size{K,M,G} (1-1044, default 1044): 1044

Command (m for help): p

Disk /dev/sdb: 8589 MB, 8589934592 bytes

255 heads, 63 sectors/track, 1044 cylinders

Units = cylinders of 16065 * 512 = 8225280 bytes

Sector size (logical/physical): 512 bytes / 512 bytes

I/O size (minimum/optimal): 512 bytes / 512 bytes

Disk identifier: 0x7b9a6af3

Device Boot Start End Blocks Id System

/dev/sdb1 1 1044 8385898+ 5 Extended

Command (m for help): n

Command action

l logical (5 or over)

p primary partition (1-4)

如果把第一个分区分为扩展分区,并且把全部空间都分给扩展分区的话,再继续分区的话,会提示的分区类型为主分区还是逻辑分区(logical), 用 ‘l’ 表示逻辑分区,逻辑分区的id是从5开始的,因为前四个id为主分区或者扩展分区。既然阿铭把所有磁盘空间都分为了扩展分区,如果你在这里选择 ‘p’ 则会报错:

Command action

l logical (5 or over)

p primary partition (1-4)

p

Partition number (1-4): 2

No free sectors available

这是因为没有足够空间分给主分区了,那我们就分逻辑分区:

Command (m for help): n

Command action

l logical (5 or over)

p primary partition (1-4)

l

First cylinder (1-1044, default 1): 1

Last cylinder, +cylinders or +size{K,M,G} (1-1044, default 1044): +1000M

Command (m for help): p

Disk /dev/sdb: 8589 MB, 8589934592 bytes

255 heads, 63 sectors/track, 1044 cylinders

Units = cylinders of 16065 * 512 = 8225280 bytes

Sector size (logical/physical): 512 bytes / 512 bytes

I/O size (minimum/optimal): 512 bytes / 512 bytes

Disk identifier: 0x7b9a6af3

Device Boot Start End Blocks Id System

/dev/sdb1 1 1044 8385898+ 5 Extended

/dev/sdb5 1 128 1028097 83 Linux

Command (m for help): n

Command action

l logical (5 or over)

p primary partition (1-4)

l

First cylinder (129-1044, default 129): 129

Last cylinder, +cylinders or +size{K,M,G} (129-1044, default 1044): +1000M

Command (m for help): p

Disk /dev/sdb: 8589 MB, 8589934592 bytes

255 heads, 63 sectors/track, 1044 cylinders

Units = cylinders of 16065 * 512 = 8225280 bytes

Sector size (logical/physical): 512 bytes / 512 bytes

I/O size (minimum/optimal): 512 bytes / 512 bytes

Disk identifier: 0x7b9a6af3

Device Boot Start End Blocks Id System

/dev/sdb1 1 1044 8385898+ 5 Extended

/dev/sdb5 1 128 1028097 83 Linux

/dev/sdb6 129 256 1028128+ 83 Linux

分区完后,需要输入 ‘w’ 命令来保存我们的配置:

Command (m for help): w

The partition table has been altered!

Calling ioctl() to re-read partition table.

Syncing disks.

再使用 fdisk -l /dev/sdb 查看分区情况:

[root@localhost ~]# fdisk -l /dev/sdb

Disk /dev/sdb: 8589 MB, 8589934592 bytes

255 heads, 63 sectors/track, 1044 cylinders

Units = cylinders of 16065 * 512 = 8225280 bytes

Sector size (logical/physical): 512 bytes / 512 bytes

I/O size (minimum/optimal): 512 bytes / 512 bytes

Disk identifier: 0x7b9a6af3

Device Boot Start End Blocks Id System

/dev/sdb1 1 1044 8385898+ 5 Extended

/dev/sdb5 1 128 1028097 83 Linux

/dev/sdb6 129 256 1028128+ 83 Linux

通过以上操作,相信你也学会了用fdisk来分区了吧。但阿铭要提醒你,不要闲着没事分区玩儿,这操作的危险性是很高的,一不留神就把服务器上的数据全部给分没有了。所以在你执行分区操作的时候,请保持百分之二百的细心,切记切记!

格式化磁盘分区

命令 : mke2fs, mkfs.ext2, mkfs.ext3, mkfs.ext4

当用man查询这四个命令的帮助文档时,你会发现我们看到了同一个帮助文档,这说明四个命令是一样的。mke2fs常用的选项有:

‘-b’ 分区时设定每个数据区块占用空间大小,目前支持1024, 2048 以及4096 bytes每个块。

‘-i’ 设定inode的大小

‘-N’ 设定inode数量,有时使用默认的inode数不够用,所以要自定设定inode数量。

‘-c’ 在格式化前先检测一下磁盘是否有问题,加上这个选项后会非常慢

‘-L’ 预设该分区的标签label

‘-j’ 建立ext3格式的分区,如果使用mkfs.ext3 就不用加这个选项了

‘-t’ 用来指定什么类型的文件系统,可以是ext2, ext3 也可以是 ext4.

[root@localhost ~]# mke2fs -t ext4 /dev/sdb5

mke2fs 1.41.12 (17-May-2010)

文件系统标签=

操作系统:Linux

块大小=4096 (log=2)

分块大小=4096 (log=2)

Stride=0 blocks, Stripe width=0 blocks

64256 inodes, 257024 blocks

12851 blocks (5.00%) reserved for the super user

第一个数据块=0

Maximum filesystem blocks=264241152

8 block groups

32768 blocks per group, 32768 fragments per group

8032 inodes per group

Superblock backups stored on blocks:

32768, 98304, 163840, 229376

正在写入inode表: 完成

Creating journal (4096 blocks): 完成

Writing superblocks and filesystem accounting information: 完成

This filesystem will be automatically checked every 24 mounts or

180 days, whichever comes first. Use tune2fs -c or -i to override.

指定文件系统格式为ext4, 该命令等同于 mkfs.ext4 /dev/sdb5. 目前CentOS 6 默认文件系统格式为ext4, 所以以后你遇到需要格式磁盘分区的时候,直接指定格式为ext4即可,但早期的版本CentOS 5 是使用ext3作为默认的文件系统的,所以你可以根据操作系统的版本来决定格式化什么格式的文件系统。在上面的例子中,你是否有注意到一些指标呢?其中一个指标是 “块大小=4096” 这里涉及到一个 “块” 的概念,磁盘在被格式化的时候会预先规定好每一个块的大小,然后再把所有的空间分割成一个一个的小块,存数据的时候也是一个块一个块的去写入。所以如果你的磁盘存的都是特别小特别小的文件,比如说1k或者2k,那么建议在格式化磁盘的时候指定块数值小一点。ext文件系统默认块大小为4096也就是4k. 在格式化的时候,可以指定块大小为1024, 2048, 4096(它们是成倍增加的),虽然格式化的时候可以指定块大小超过4096,但是一旦超过4096则不能正常挂载,如何指定块大小?

[root@localhost ~]# mke2fs -t ext4 -b 8192 /dev/sdb5

Warning: blocksize 8192 not usable on most systems.

mke2fs 1.41.12 (17-May-2010)

mke2fs: 8192-byte blocks too big for system (max 4096)

无论如何也要继续? (y,n) y

Warning: 8192-byte blocks too big for system (max 4096), forced to continue

文件系统标签=

操作系统:Linux

块大小=8192 (log=3)

分块大小=8192 (log=3)

Stride=0 blocks, Stripe width=0 blocks

64256 inodes, 128512 blocks

6425 blocks (5.00%) reserved for the super user

第一个数据块=0

Maximum filesystem blocks=134201344

2 block groups

65528 blocks per group, 65528 fragments per group

32128 inodes per group

Superblock backups stored on blocks:

65528

正在写入inode表: 完成

Creating journal (4096 blocks): 完成

Writing superblocks and filesystem accounting information: 完成

This filesystem will be automatically checked every 28 mounts or

180 days, whichever comes first. Use tune2fs -c or -i to override.

指定块大小为8192会提示,块值设置太大了,我们直接输入 ‘y’ 强制格式化,你还可以尝试指定更大的数字。

[root@localhost ~]# mke2fs -t ext4 -L TEST -b 8192 /dev/sdb5

可以使用 ‘-L’ 来指定标签。标签会在挂载磁盘的时候使用,另外也可以写到配置文件里,稍后阿铭介绍。关于格式化的这一部分,阿铭建议你除非有需求,否则不需要指定块大小,也就是说,你只需要记住这两个选项: ‘-t’ 和 ‘-L’ 即可。

命令 : e2label

用来查看或修改分区的标签,阿铭很少使用,你只要了解一下即可。

[root@localhost ~]# e2label /dev/sdb5

TEST

[root@localhost ~]# e2label /dev/sdb5 TEST123

[root@localhost ~]# e2label /dev/sdb5

TEST123

挂载/卸载磁盘

在上面的内容中讲到了磁盘的分区和格式化,那么格式化完了后,如何去用它呢?这就涉及到了挂载这块磁盘。格式化后的磁盘其实是一个块设备文件,类型为b,也许你会想,既然这个块文件就是那个分区,那么直接在那个文件中写数据不就写到了那个分区中么?当然不行。

在挂载某个分区前需要先建立一个挂载点,这个挂载点是以目录的形式出现的。一旦把某一个分区挂载到了这个挂载点(目录)下,那么再往这个目录写数据使,则都会写到该分区中。这就需要你注意一下,在挂载该分区前,挂载点(目录)下必须是个空目录。其实目录不为空并不影响所挂载分区的使用,但是一旦挂载上了,那么该目录下以前的东西就不能看到了。只有卸载掉该分区后才能看到。

命令 : mount

如果不加任何选项,直接运行 “mount” 命令,会显示如下信息:

[root@localhost ~]# mount

/dev/sda3 on / type ext4 (rw)

proc on /proc type proc (rw)

sysfs on /sys type sysfs (rw)

devpts on /dev/pts type devpts (rw,gid=5,mode=620)

tmpfs on /dev/shm type tmpfs (rw)

/dev/sda1 on /boot type ext4 (rw)

none on /proc/sys/fs/binfmt_misc type binfmt_misc (rw)

这个命令可以查看当前系统已经挂载的所有分区,以及分区文件系统的类型,挂载点和一些选项等信息,所以你如果想知道某个分区的文件系统类型直接用该命令查看即可。下面我们先建立一个空目录,然后在目录里建一个空白文档。

[root@localhost ~]# mkdir /newdir

[root@localhost ~]# touch /newdir/newfile.txt

[root@localhost ~]# ls /newdir/newfile.txt

/newdir/newfile.txt

然后把刚才格式化的 /dev/sdb5 挂载到 /newdir 上。

[root@localhost ~]# mount /dev/sdb5 /newdir/

mount: wrong fs type, bad option, bad superblock on /dev/sdb5,

missing codepage or helper program, or other error

In some cases useful info is found in syslog - try

dmesg | tail or so

不能完成挂载,根据提示可以查看一下错误信息:

[root@localhost ~]# dmesg |tail

eth0: no IPv6 routers present

sdb: sdb1 < sdb5 >

sdb:

sdb: sdb1 < sdb5 sdb6 >

EXT4-fs (sdb5): bad block size 8192

EXT4-fs (sdb5): bad block size 8192

EXT4-fs (sdb5): bad block size 8192

EXT4-fs (sdb5): bad block size 8192

EXT4-fs (sdb5): mounted filesystem with ordered data mode. Opts:

EXT4-fs (sdb5): bad block size 8192

可以看到,我的/dev/sdb5指定的块值8192不合法,所以只能重新格式化磁盘。

[root@localhost ~]# mke2fs -t ext4 -L TEST /dev/sdb5

使用默认块值即可。我们继续挂载sdb5:

[root@localhost ~]# mount /dev/sdb5 /newdir/

[root@localhost ~]# ls /newdir/

lost+found

[root@localhost ~]# df -h

文件系统 容量 已用 可用 已用%% 挂载点

/dev/sda3 14G 1.5G 12G 11% /

tmpfs 160M 0 160M 0% /dev/shm

/dev/sda1 97M 27M 66M 29% /boot

/dev/sdb5 989M 18M 921M 2% /newdir

把 /dev/sdb5 挂载到 /newdir 后,原来在 /newdir 下的 newfile.txt 被覆盖了,通过 df -h 可以看到刚刚挂载的分区,我们也可以使用LABEL的方式挂载分区:

[root@localhost ~]# umount /newdir/

[root@localhost ~]# df -h

文件系统 容量 已用 可用 已用%% 挂载点

/dev/sda3 14G 1.5G 12G 11% /

tmpfs 160M 0 160M 0% /dev/shm

/dev/sda1 97M 27M 66M 29% /boot

[root@localhost ~]# mount LABEL=TEST /newdir

[root@localhost ~]# df -h

文件系统 容量 已用 可用 已用%% 挂载点

/dev/sda3 14G 1.5G 12G 11% /

tmpfs 160M 0 160M 0% /dev/shm

/dev/sda1 97M 27M 66M 29% /boot

/dev/sdb5 989M 18M 921M 2% /newdir

本例中用到了 “umount” 命令,这个是用来卸载磁盘分区的,稍后阿铭介绍。mount 命令常用的选项有:’-a’, ‘-t’, ‘-o’. 在讲 ‘-a’ 选项前,我们有必要先了解一下这个文件 /etc/fstab.

[root@localhost ~]# cat /etc/fstab

#

# /etc/fstab

# Created by anaconda on Tue May 7 17:51:27 2013

#

# Accessible filesystems, by reference, are maintained under '/dev/disk'

# See man pages fstab(5), findfs(8), mount(8) and/or blkid(8) for more info

#

UUID=95297b81-538d-4d96-870a-de90255b74f5 / ext4 defaults 1 1

UUID=a593ff68-2db7-4371-8d8c-d936898e9ac9 /boot ext4 defaults 1 2

UUID=ff042a91-b68f-4d64-9759-050c51dc9e8b swap swap defaults 0 0

tmpfs /dev/shm tmpfs defaults 0 0

devpts /dev/pts devpts gid=5,mode=620 0 0

sysfs /sys sysfs defaults 0 0

proc /proc proc defaults 0 0

这个文件是系统启动时,需要挂载的各个分区。第一列就是分区的标识,可以写分区的LABEL,也可以写分区的UUID(等会阿铭会着重讲一下这个概念),当然也可以写分区名(/dev/sda1);第二列是挂载点;第三列是分区的格式;第四列则是mount的一些挂载参数,等下会详细介绍一下有哪些参数,一般情况下,直接写defaults即可;第五列的数字表示是否被dump备份,是的话这里就是1,否则就是0;第六列是开机时是否自检磁盘。1,2都表示检测,0表示不检测,在Redhat/CentOS中,这个1,2还有个说法,/ 分区必须设为1,而且整个fstab中只允许出现一个1,这里有一个优先级的说法。1比2优先级高,所以先检测1,然后再检测2,如果有多个分区需要开机检测那么都设置成2吧,1检测完了后会同时去检测2。下面该说说第四列中常用到的参数了。

“async/sync” : async表示和磁盘和内存不同步,系统每隔一段时间把内存数据写入磁盘中,而sync则会时时同步内存和磁盘中数据;

“auto/noauto” : 开机自动挂载/不自动挂载;

“default” : 按照大多数永久文件系统的缺省值设置挂载定义,它包含了rw, suid, dev, exec, auto, nouser, async

“ro” : 按只读权限挂载 ;

“rw” : 按可读可写权限挂载 ;

“exec/noexec” : 允许/不允许可执行文件执行,但千万不要把根分区挂载为noexec,那就无法使用系统了,连mount命令都无法使用了,这时只有重新做系统了;

“user/nouser” : 允许/不允许root外的其他用户挂载分区,为了安全考虑,请用nouser ;

“suid/nosuid” : 允许/不允许分区有suid属性,一般设置nosuid ;

“usrquota” : 启动使用者磁盘配额模式,磁盘配额相关内容在后续章节会做介绍;

“grquota” : 启动群组磁盘配额模式;

学完这个/etc/fstab后,我们就可以自己修改这个文件,增加一行来挂载新增分区。例如,阿铭增加了这样一行:

LABEL=TEST /newdir ext4 defaults 0 0

然后卸载掉刚才我们已经挂载的/dev/sdb5

[root@localhost ~]# umount /dev/sdb5

[root@localhost ~]# df -h

文件系统 容量 已用 可用 已用%% 挂载点

/dev/sda3 14G 1.5G 12G 11% /

tmpfs 160M 0 160M 0% /dev/shm

/dev/sda1 97M 27M 66M 29% /boot

使用 df -h 查看已经成功卸载 /dev/sdb5 下面执行命令 mount -a

[root@localhost ~]# mount -a

[root@localhost ~]# df -h

文件系统 容量 已用 可用 已用%% 挂载点

/dev/sda3 14G 1.5G 12G 11% /

tmpfs 160M 0 160M 0% /dev/shm

/dev/sda1 97M 27M 66M 29% /boot

/dev/sdb5 989M 18M 921M 2% /newdir

此时,多出来一个 /dev/sdb5 挂载到了 /newfir 下。这就是 mount -a 命令执行的结果,这个 ‘-a’ 选项会把/etc/fstab中出现的所有磁盘分区挂载上。

[root@localhost ~]# umount /newdir

[root@localhost ~]# mount -t ext4 /dev/sdb5 /newdir

[root@localhost ~]# df -h

文件系统 容量 已用 可用 已用%% 挂载点

/dev/sda3 14G 1.5G 12G 11% /

tmpfs 160M 0 160M 0% /dev/shm

/dev/sda1 97M 27M 66M 29% /boot

/dev/sdb5 989M 18M 921M 2% /newdir

‘-t’ 选项用来指定挂载的分区类型,默认不指定会自动识别。

‘-o’ 选项用来指定挂载的分区有哪些特性,即上面 “/etc/fatab” 配置文件中第四列的那些。阿铭经常这样使用这个 ‘-o’ 选项:

[root@localhost ~]# mkdir /newdir/dir1

[root@localhost ~]# mount -o remount,ro,sync,noauto /dev/sdb5 /newdir

[root@localhost ~]# mkdir /newdir/dir2

mkdir: 无法创建目录 "/newdir/dir2": 只读文件系统

由于指定了 ‘ro’ 参数,所以该分区只读了。通过 mount 命令也可以看到 /dev/sdb5 有 ‘ro’ 选项

[root@localhost ~]# mount

/dev/sda3 on / type ext4 (rw)

proc on /proc type proc (rw)

sysfs on /sys type sysfs (rw)

devpts on /dev/pts type devpts (rw,gid=5,mode=620)

tmpfs on /dev/shm type tmpfs (rw)

/dev/sda1 on /boot type ext4 (rw)

none on /proc/sys/fs/binfmt_misc type binfmt_misc (rw)

/dev/sdb5 on /newdir type ext4 (ro,sync)

下面阿铭重新挂载,让它恢复读写。

[root@localhost ~]# mount -o remount /dev/sdb5 /newdir

[root@localhost ~]# mkdir /newdir/dir2

[root@localhost ~]# ls /newdir/

dir1 dir2 lost+found

命令 : blkid

阿铭在日常的运维工作中遇到过这样的情况,一台服务器上新装了两块磁盘,磁盘a(在服务器上显示为sdc)和磁盘b(在服务器上显示为sdd),有一次把这两块磁盘都拔掉了,然后再重新插上,重启机器,结果磁盘编号调换了,a变成了sdd,b变成了sdc(这是因为把磁盘插错了插槽),问题来了。通过上边的学习,你挂载磁盘是通过/dev/hdb1 这样的分区名字来挂载的,如果先前加入到了/etc/fstab 中,结果系统启动后则会挂载错分区。那么怎么样避免这样的情况发生?

这就用到了UUID,可以通过 blkid 命令获取各分区的UUID:

/dev/sda1: UUID="a593ff68-2db7-4371-8d8c-d936898e9ac9" TYPE="ext4"

/dev/sda2: UUID="ff042a91-b68f-4d64-9759-050c51dc9e8b" TYPE="swap"

/dev/sda3: UUID="95297b81-538d-4d96-870a-de90255b74f5" TYPE="ext4"

/dev/sdb5: LABEL="TEST" UUID="c61117ca-9176-4d0b-be4d-1b0f434359a7" TYPE="ext4"

/dev/sdb6: UUID="c271cb5a-cb46-42f4-9eb4-d2b1a5028e18" SEC_TYPE="ext2" TYPE="ext3"

这样可以获得全部磁盘分区的UUID,如果格式化的时候指定了 LABEL 则该命令也会显示LABEL值,甚至连文件系统类型也会显示。当然这个命令后面也可以指定哪个分区:

[root@localhost ~]# blkid /dev/sdb5

/dev/sdb5: LABEL="TEST" UUID="c61117ca-9176-4d0b-be4d-1b0f434359a7" TYPE="ext4"

获得UUID后,如何使用它呢?

[root@localhost ~]# umount /newdir

[root@localhost ~]# mount UUID="c61117ca-9176-4d0b-be4d-1b0f434359a7" /newdir

[root@localhost ~]# df -h

文件系统 容量 已用 可用 已用%% 挂载点

/dev/sda3 14G 1.5G 12G 11% /

tmpfs 160M 0 160M 0% /dev/shm

/dev/sda1 97M 27M 66M 29% /boot

/dev/sdb5 989M 18M 921M 2% /newdir

也可以把下面这行写到 /etc/fstab 中

UUID=c61117ca-9176-4d0b-be4d-1b0f434359a7 /newdir ext4 defaults 0 0

如果想让某个分区开机后就自动挂载,有两个办法可以实现:

- 在 /etc/fstab 中添加一行,如上例中那行;

- 把挂载命令写到 /etc/rc.d/rc.local 文件中去,阿铭会经常把想要开机启动的命令加到这个文件中。系统启动完后会执行这个文件中的命令,所以只要你想开机后运行什么命令统统写入到这个文件下面吧,直接放到最后面即可,阿铭把挂载的命令放到该文件的最后一行了:

[root@localhost ~]# cat /etc/rc.d/rc.local

#!/bin/sh

#

# This script will be executed *after* all the other init scripts.

# You can put your own initialization stuff in here if you don't

# want to do the full Sys V style init stuff.

touch /var/lock/subsys/local

mount UUID="c61117ca-9176-4d0b-be4d-1b0f434359a7" /newdir

以上两种方法,任选其一,阿铭介绍第二种方法其实也是教给你一个小知识,如何让一些操作行为随系统启动而自动执行。另外,阿铭需要给你一个小建议,那就是挂载磁盘分区的时候,尽量使用UUID或者LABEL这两种方法。

命令 : umount

在上面的小实验中,阿铭多次用到这个命令,这个命令也简单的很,后边可以跟挂载点,也可以跟分区名(/dev/hdb1), 但是不可以跟LABEL和UUID.

[root@localhost ~]# umount /dev/sdb5

[root@localhost ~]# mount UUID="c61117ca-9176-4d0b-be4d-1b0f434359a7" /newdir

[root@localhost ~]# umount /newdir

[root@localhost ~]# mount UUID="c61117ca-9176-4d0b-be4d-1b0f434359a7" /newdir

umount 命令有一个非常有用的选项那就是 ‘-l’, 有时候你会遇到不能卸载的情况:

[root@localhost newdir]# umount /newdir

umount: /newdir: device is busy.

(In some cases useful info about processes that use

the device is found by lsof(8) or fuser(1))

这是因为当前目录为要卸载的分区上,解决办法有两种,一是到其他目录,二是使用 ‘-l’ 选项:

[root@localhost newdir]# umount -l /newdir

[root@localhost newdir]# df -h

文件系统 容量 已用 可用 已用%% 挂载点

/dev/sda3 14G 1.5G 12G 11% /

tmpfs 160M 0 160M 0% /dev/shm

/dev/sda1 97M 27M 66M 29% /boot

建立一个swap文件增加虚拟内存

从装系统时就接触过这个swap了,它类似与windows的虚拟内存,分区的时候一般大小为内存的2倍,如果你的内存超过8G,那么你分16G似乎是没有必要了。分16G足够日常交换了。然而,还会有虚拟内存不够用的情况发生。如果真遇到了,莫非还要重新给磁盘分区?当然不能,那我们就增加一个虚拟的磁盘出来。基本的思路就是:建立swapfile -> 格式化为swap格式 -> 启用该虚拟磁盘。

[root@localhost ~]# dd if=/dev/zero of=/tmp/newdisk bs=4k count=102400

记录了102400+0 的读入

记录了102400+0 的写出

419430400字节(419 MB)已复制,2.59193 秒,162 MB/秒

“dd” 这个命令阿铭经常用到,所以请你也要掌握它的使用方法,其实也不难,用 “if” 指定源,基本上除了 “/dev/zero” 外基本上不会写别的,而/dev/zero 是UNIX系统特有的一个文件,它可以提供源源不断的 “0”, 关于它的其他信息请你在网上查一下资料。 “of” 指定目标文件, “bs” 定义块的大小, “count” 定义块的数量,这两个参数的多少决定了目标文件的大小,目标文件大小 = bs x count. 阿铭用dd建了一个大小为400M的文件,然后格式化成swap格式:

[root@localhost ~]# mkswap -f /tmp/newdisk

Setting up swapspace version 1, size = 409596 KiB

no label, UUID=29832cab-04b9-4083-a667-9a5795a5d490

格式化完后,就可以挂载上使用了:

[root@localhost ~]# free -m

total used free shared buffers cached

Mem: 318 314 4 0 5 278

-/+ buffers/cache: 30 288

Swap: 2047 0 2047

[root@localhost ~]# swapon /tmp/newdisk

[root@localhost ~]# free -m

total used free shared buffers cached

Mem: 318 314 4 0 5 278

-/+ buffers/cache: 31 287

Swap: 2447 0 2447

前后对比swap分区多了400M空间。其中 “free” 这个命令用来查看内存使用情况, “-m” 表示以M为单位显示,阿铭会在后面介绍该命令。

磁盘配额

磁盘配合其实就是给每个用户分配一定的磁盘额度,只允许他使用这个额度范围内的磁盘空间。在linux系统中,是多用户多任务的环境,所以会有很多人共用一个磁盘的情况。针对每个用户去限定一定量的磁盘空间是有必要的,这样才显得公平。随着硬件成本的降低,服务器上的磁盘资源似乎不再刻意的去限制了,所以磁盘配额也就可有可无了,但是你也需要了解一下这部分内容,用到时必须会操作。

在linux中,用来管理磁盘配额的东西就是quota了。如果你的linux上没有quota,则需要你安装这个软件包 quota-3.13-5.el5.RPM (其实版本是多少无所谓了,关键是这个软件包)。quota在实际应用中是针对整个分区进行限制的。比如,如果我们限制了/dev/sdb1这个分区,而/dev/sdb1 是挂载在/home 目录下的,那么/home 所有目录都会受到限制。

quota 这个模块主要分为quota quotacheck quotaoff quotaon quotastats edquota setquota warnquota repquota这几个命令,下面就分别介绍这些命令。

命令 : quota

“quota” 用来显示某个组或者某个使用者的限额。

语法:quota [-guvs] [user,group]

“-g” 显示某个组的限额

“-u” 显示某个用户的限额

“-v” 显示的意思

“-s” 选择inod或硬盘空间来显示

命令 : quotacheck

“quotacheck” 用来扫描某一个磁盘的quota空间。

语法:quotacheck [-auvg] /path

“-a” 扫描所有已经mount的具有quota支持的磁盘

“-u” 扫描某个使用者的文件以及目录

“-g” 扫描某个组的文件以及目录

“-v” 显示扫描过程

“-m” 强制进行扫描

命令 : edquota

“edquota” 用来编辑某个用户或者组的quota值。

语法:edquota [-u user] [-g group] [-t]

“-u” 编辑某个用户的quota

“-g” 编辑某个组的quota

“-t” 编辑宽限时间

“-p” 拷贝某个用户或组的quota到另一个用户或组

当运行 edquota -u user 时,系统会打开一个文件,你会看到这个文件中有7列,它们分别代表的含义是:

“Filesystem” 磁盘分区,如/dev/sdb5

“blocks” 当前用户在当前的Filesystem中所占用的磁盘容量,单位是Kb。该值请不要修改。

“soft/hard” 当前用户在该Filesystem内的quota值,soft指的是最低限额,可以超过这个值,但必须要在宽限时间内将磁盘容量降低到这个值以下。hard指的是最高限额,即不能超过这个值。当用户的磁盘使用量高于soft值时,系统会警告用户,提示其要在宽限时间内把使用空间降低到soft值之下。

“inodes” 目前使用掉的inode的状态,不用修改。

命令 : quotaon

“quotaon” 用来启动quota,在编辑好quota后,需要启动才能是quota生效

语法:quotaon [-a] [-uvg directory]

“-a” 全部设定的quota启动

“-u” 启动某个用户的quota

“-g” 启动某个组的quota

“-s” 显示相关信息

命令 : quotaoff

“quotaoff” 用来关闭quota, 该命令常用只有一种情况 quotaoff -a 关闭全部的quota.

以上讲了很多quota的相关命令,那么接下来阿铭教你如何在实践应用中去做这个磁盘配额。整个执行过程如下:

首先先确认一下,你的/home目录是不是单独的挂载在一个分区下,用df 查看即可。如果不是则需要你跟我一起做。否则这一步即可省略。

文件系统 1K-块 已用 可用 已用% 挂载点

/dev/sda3 14347632 1899376 11719424 14% /

tmpfs 163308 0 163308 0% /dev/shm

/dev/sda1 99150 26808 67222 29% /boot

阿铭的linux系统中,/home并没有单独占用一个分区。所以需要把/home目录挂载在一个单独的分区下,因为quota是针对分区来限额的。下面阿铭把 /dev/sdb5 挂载到/home 目录下, 编辑 /etc/fstab 把刚才添加的那行修改为:

UUID=c61117ca-9176-4d0b-be4d-1b0f434359a7 /home ext4 defaults 0 0

保存 /etc/fstab 后,运行 mount -a 命令挂载全部的分区。

[root@localhost ~]# mount -a

[root@localhost ~]# df -h

文件系统 容量 已用 可用 已用%% 挂载点

/dev/sda3 14G 1.9G 12G 14% /

tmpfs 160M 0 160M 0% /dev/shm

/dev/sda1 97M 27M 66M 29% /boot

/dev/sdb5 989M 18M 921M 2% /home

此时的 /home 为一个单独分区了。

- 建立测试账户

首先建立一个test用户,则同时建立了一个test组。其中uid和gid都为511 ,然后又建立一个test1账号,使其加入test组,查看/etc/passwd文件发现test和test1用户的gid都为511.

[root@localhost ~]# useradd test

[root@localhost ~]# grep test /etc/passwd

test:x:511:511::/home/test:/bin/bash

[root@localhost ~]# useradd -g 511 test1

[root@localhost ~]# grep test1 /etc/passwd

test1:x:512:511::/home/test1:/bin/bash

- 打开磁盘的quota功能

默认linux并没有对任何分区做quota的支持,所以需要我们手动打开磁盘的quota功能,你是否记得,在前面内容中分析/etc/fstab文件的第四列时讲过这个quota选项(usrquota, grpquota),没错,要想打开这个磁盘的quota支持就是需要修改这个第四列的。用vi编辑/etc/fstab 编辑刚才加的那一行,如下:

UUID=c61117ca-9176-4d0b-be4d-1b0f434359a7 /home ext4 defaults,usrquota,grpquota 0 0

保存 /etc/fstab 后,重新挂载/home分区。

[root@localhost ~]# umount /home/

[root@localhost ~]# mount -a

[root@localhost ~]# mount

/dev/sda3 on / type ext4 (rw)

proc on /proc type proc (rw)

sysfs on /sys type sysfs (rw)

devpts on /dev/pts type devpts (rw,gid=5,mode=620)

tmpfs on /dev/shm type tmpfs (rw)

/dev/sda1 on /boot type ext4 (rw)

none on /proc/sys/fs/binfmt_misc type binfmt_misc (rw)

/dev/sdb5 on /home type ext4 (rw,usrquota,grpquota)

使用 mount 命令可以查看到 /home 分区已经加上了 “usrquota,grpquota” 两个配额相关的参数。

- 扫描磁盘的使用者使用状况,并产生重要的aquota.group与aquota.user

这一步就需要用到quotacheck了,aquota.group与aqouta.user分别是组以及用户磁盘配额需要的配置文件。如果没有这两个文件,则磁盘配额是不会生效的。

[root@localhost ~]# quotacheck -augv

可能会有一些错误信息,不要管它。看一看你的/home分区下是否多了两个文件(aquota.group, aquota.user)

[root@localhost ~]# ll /home/

总用量 44

-rw------- 1 root root 7168 5月 12 02:07 aquota.group

-rw------- 1 root root 8192 5月 12 02:07 aquota.user

drwxr-xr-x 2 root root 4096 5月 12 00:11 dir1

drwx------ 2 root root 16384 5月 11 23:18 lost+found

drwx------ 3 test test 4096 5月 12 01:59 test

drwx------ 3 test1 test 4096 5月 12 02:00 test1

如果有了,则可以进入下一步了。

- 启动quota配额

[root@localhost ~]# quotaon -av

/dev/sdb5 [/home]: group quotas turned on

/dev/sdb5 [/home]: user quotas turned on

- 编辑用户磁盘配额

先来设定test账户的配额,然后直接把test的配额拷贝给test1即可。这里就需要用到edquota了。

[root@localhost ~]# edquota -u test

将下面内容

/dev/sdb5 20 0 0 5 0 0

修改为:

/dev/sdb5 20 20000 30000 5 0 0

其中单位是Kb,所以soft 值大约为20Mb,hard值为30Mb,保存这个文件,保存的方式跟vi一个文件的方式一样的。下面将test的配额复制给test1.

[root@localhost ~]# edquota -p test test1

下面继续设定宽限时间:

[root@localhost ~]# edquota -t

将7days 改为 1days

/dev/sdb5 1days 1days

下面查看一下test以及test1用户的配额吧。

[root@localhost ~]# quota -uv test test1

Disk quotas for user test (uid 511):

Filesystem blocks quota limit grace files quota limit grace

/dev/sdb5 20 20000 30000 5 0 0

Disk quotas for user test1 (uid 512):

Filesystem blocks quota limit grace files quota limit grace

/dev/sdb5 20 20000 30000 5 0 0

- 编辑组磁盘配额

[root@localhost ~]# edquota -g test

修改为:

/dev/sdb5 40 40000 50000 10 0 0

设定组test的soft配额值为40M,hard值为50M。下面查看组test的配额。

[root@localhost ~]# quota -gv test

Disk quotas for group test (gid 511):

Filesystem blocks quota limit grace files quota limit grace

/dev/sdb5 40 40000 50000 10 0 0

- 设定开机启动

前面已经讲到启动磁盘配额的命令是 quotaon -aug 所以要想开机启动,只需将这条命令加入到 /etc/rc.d/rc.local文件即可。

[root@localhost ~]# echo "quotaon -aug" >> /etc/rc.d/rc.local

阿铭建议你最好再扩展学习一下: http://www.aminglinux.com/bbs/thread-5424-1-1.html

教程答疑: 请移步这里.

欢迎你加入 阿铭学院 和阿铭一起学习Linux,让阿铭成为你Linux生涯中永远的朋友吧!

| [1] | (1, 2) 磁盘分区有三种形式:主分区、扩展分区和逻辑分区。主分区最多可以有四个,如果想再多分分区,则需要先分三个主分区,然后第四个分为扩展分区,然后再把扩展分区分成若干个逻辑分区,逻辑分区最多可以分多少个?之前阿铭使用ide接口的磁盘尝试过(hda, hdb这样的磁盘),最多可以分10个,至于scsi接口的磁盘(sda, sdb)最多可以分多少个,阿铭没有做实验,这留给你来做吧。 |

第10章 文本编辑工具vim

学习Linux请加QQ群: 群1(163262181) 群2(148412746) 群3(246401509) 群4(173884211)

跟阿铭学Linux邀请函 (http://www.aminglinux.com),猿课已上线,请加微信aminglinux84索要配套视频教程。

前面多次提到过vi这个命令,它是linux中必不可少的一个工具。没有它很多工作都无法完成。早期的Unix都是使用的vi作为系统默认的编辑器的。你也许会有疑问,vi与vim有什么区别?可以这样简单理解,vim是vi的升级版。很多linux系统管理员都习惯用vi,那是因为他们接触linux的时候用的就是vi,vim后来才比较流行。所以,无所谓用vi和vim,只要你能达到你想要的目的即可。

在阿铭看来vi 和vim最大的区别就是编辑一个文本时,vi不会显示颜色,而vim会显示颜色。显示颜色更易于用户进行编辑。其他功能没有什么区别。所以在linux系统下,使用vi还是vim完全取决你的个人爱好而已。阿铭从一开始学linux就一直使用vim,所以也会一直以vim的角色来教授给你。

也许你刚刚安装的CentOS系统上没有这个命令,请这样安装它 yum install -y vim-enhanced

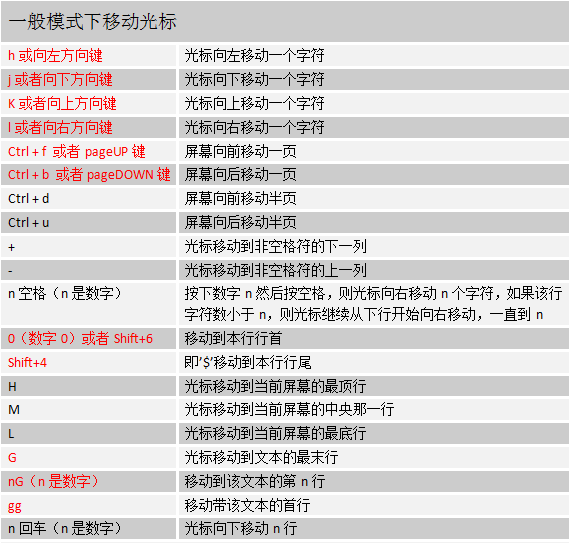

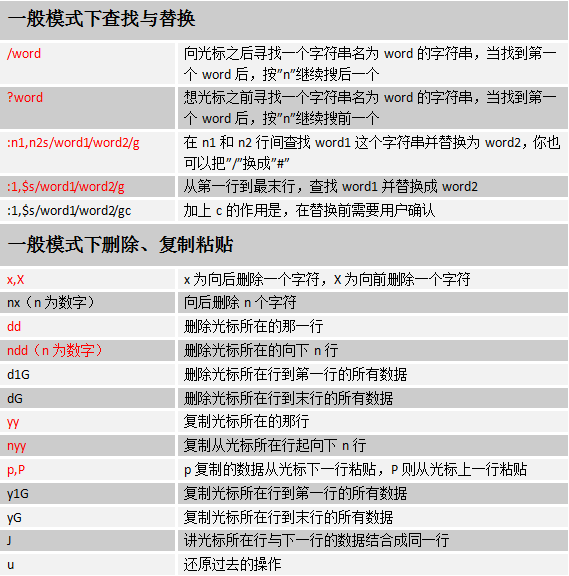

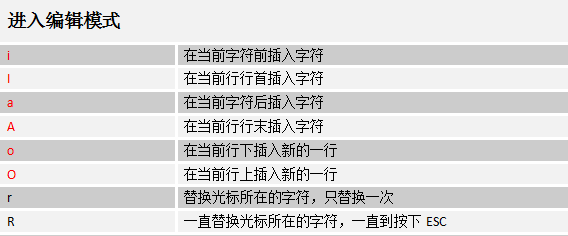

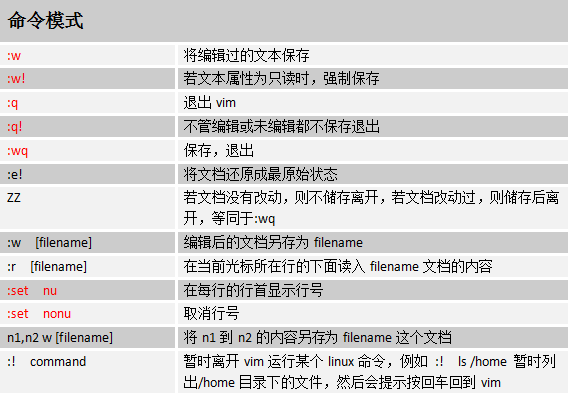

vim的三种模式:一般模式、编辑模式、命令模式。这需要你牢记的,因为以前阿铭刚刚从事linux工作的时候去面试,很多单位的笔试题就有这个知识点。

- 一般模式: 当你vim filename 编辑一个文件时,一进入该文件就是一般模式了。在这个模式下,你可以做的操作有,上下移动光标;删除某个字符;删除某行;复制、粘贴一行或者多行。

- 编辑模式:一般模式下,是不可以修改某一个字符的,只能到编辑模式了。从一般模式进入编辑模式,只需你按一个键即可(i, I, a, A, o, O, r, R)。当进入编辑模式时,会在屏幕的最下一行出现“INSERT或REPLACE”的字样。从编辑模式回到一般模式只需要按一下键盘左上方的ESC键即可。

- 命令模式:在一般模式下,输入 ”:” 或者 “/” 即可进入命令模式。在该模式下,你可以搜索某个字符或者字符串,也可以保存、替换、退出、显示行号等等。

下面阿铭教你如何在一个空白文档中写入一段文字,然后保存。

[root@localhost ~]# vim test.txt

输入vim test.txt直接回车进入一般模式。然后按 “i” 字母进入编辑模式,在窗口的左下角会显示 “– 插入 –” 或者 “– INSERT –” 这说明进入插入模式,可以编辑文档。下面阿铭随便写一段文字:

This is a test file.

And this is the first time to using "vim".

It's easy to use "vim".

I like to using it, do you like it?

如果你编辑完了,想保存的话,需要先按一下键盘左上角的 “Esc” 键,此时 “– 插入 –” 或者 “– INSERT –” 消失,然后输入 ”:wq” 回车就会保存刚才的文字了。

This is a test file.

And this is the first time to using "vim".

It's easy to use "vim".

I like to using it, do you like it?

~

~

:wq

这时,看一下test.txt文档的内容吧:

[root@localhost ~]# cat test.txt

This is a test file.

And this is the first time to using "vim".

It's easy to use "vim".

I like to using it, do you like it?

其实 “vim” 为全键盘操作的编辑器,所以在各个模式下都有很多功能键。下面列举一下,其中阿铭认为常用的会用红色标出,需要你多加练习,另外不常用的你也需要知道。

暂时就讲这么多了。如果你能全部掌握,那你一定是vim高手啦。如果你觉得太多,只要记住阿铭标红部分即可,其他的用时再过来查就ok啦。下面阿铭给你留一个小作业,希望你能认真完成!

- 请把/etc/init.d/iptables 复制到/root/目录下,并重命名为test.txt

- 用vim打开test.txt并设置行号

- 分别向下、向右、向左、向右移动5个字符

- 分别向下、向上翻两页

- 把光标移动到第49行

- 让光标移动到行末,再移动到行首

- 移动到test.txt文件的最后一行

- 移动到文件的首行

- 搜索文件中出现的 iptables 并数一下一共出现多少个

- 把从第一行到第三行出现的iptables 替换成iptable

- 还原上一步操作

- 把整个文件中所有的iptables替换成iptable

- 把光标移动到25行,删除字符 “$”

- 还原上一步操作

- 删除第50行

- 还原上一步操作

- 删除从37行到42行的所有内容

- 还原上一步操作

- 复制48行并粘贴到52行下面

- 还原上一步操作(按两次u)

- 复制从37行到42行的内容并粘贴到44行上面

- 还原上一步操作(按两次u)

- 把37行到42行的内容移动到19行下面

- 还原上一步操作(按两次u)

- 光标移动到首行,把/bin/sh 改成 /bin/bash

- 在第一行下面插入新的一行,并输入”# Hello!”

- 保存文档并退出

阿铭建议你最好再扩展学习一下: http://www.aminglinux.com/bbs/thread-5434-1-1.html

教程答疑: 请移步这里.

欢迎你加入 阿铭学院 和阿铭一起学习Linux,让阿铭成为你Linux生涯中永远的朋友吧!

第11章 文档的压缩与打包

学习Linux请加QQ群: 群1(163262181) 群2(148412746) 群3(246401509) 群4(173884211)

跟阿铭学Linux邀请函 (http://www.aminglinux.com),猿课已上线,请加微信aminglinux84索要配套视频教程。

在windows下我们接触最多的压缩文件就是.rar格式的了。但在linux下这样的格式是不能识别的,它有自己所特有的压缩工具。但有一种文件在windows和linux下都能使用那就是.zip格式的文件了。压缩的好处不用阿铭介绍相信你也晓得吧,它不仅能节省磁盘空间而且在传输的时候还能节省网络带宽呢。

在linux下最常见的压缩文件通常都是以.tar.gz 为结尾的,除此之外还有.tar, .gz, .bz2, .zip等等。以前也介绍过linux系统中的后缀名其实要不要无所谓,但是对于压缩文件来讲必须要带上。这是为了判断压缩文件是由哪种压缩工具所压缩,而后才能去正确的解压缩这个文件。以下介绍常见的后缀名所对应的压缩工具。

.gz gzip 压缩工具压缩的文件

.bz2 bzip2 压缩工具压缩的文件

.tar tar 打包程序打包的文件(tar并没有压缩功能,只是把一个目录合并成一个文件)

.tar.gz 可以理解为先用tar打包,然后再gzip压缩

.tar.bz2 同上,先用tar打包,然后再bzip2压缩

gzip压缩工具

语法: gzip [-d#] filename 其中#为1-9的数字

“-d” : 解压缩时使用

“-#” : 压缩等级,1压缩最差,9压缩最好,6为默认

[root@localhost ~]# [ -d test ] && rm -rf test

[root@localhost ~]# mkdir test

[root@localhost ~]# mv test.txt test

[root@localhost ~]# cd test

[root@localhost test]# ls

test.txt

[root@localhost test]# gzip test.txt

[root@localhost test]# ls

test.txt.gz

你对第一条命令也许很陌生,其实这是两条命令,[ ] 内是一个判断,”-d test” 判断test目录是否存在,’&&’ 为一个连接命令符号,当前面的命令执行成功后,后面的命令才执行。关于这两块内容阿铭会在后面详细讲解。gzip 后面直接跟文件名,就在当前目录下把该文件压缩了,而原文件也会消失。

[root@localhost test]# gzip -d test.txt.gz

[root@localhost test]# ls

test.txt

“gzip -d” 后面跟压缩文件,会解压压缩文件。gzip 是不支持压缩目录的。

[root@localhost ~]# gzip test

gzip: test is a directory -- ignored

[root@localhost ~]# ls test

test/ test1 test2/ test3

[root@localhost ~]# ls test

test.txt

至于 “-#” 选项,平时很少用,使用默认压缩级别足够了。

bzip2压缩工具

语法: bzip2 [-dz] filename

bzip2 只有两个选项需要你掌握。

“-d” : 解压缩

“-z” : 压缩

压缩时,可以加 “-z” 也可以不加,都可以压缩文件,”-d” 则为解压的选项:

[root@localhost ~]# cd test

[root@localhost test]# bzip2 test.txt

[root@localhost test]# ls

test.txt.bz2

[root@localhost test]# bzip2 -d test.txt.bz2

[root@localhost test]# bzip2 -z test.txt

[root@localhost test]# ls

test.txt.bz2

bzip2 同样也不可以压缩目录:

[root@localhost test]# cd ..

[root@localhost ~]# bzip2 test

bzip2: Input file test is a directory.

tar压缩工具

tar 本身为一个打包工具,可以把目录打包成一个文件,它的好处是它把所有文件整合成一个大文件整体,方便拷贝或者移动。

语法:tar [-zjxcvfpP] filename tar 命令有多个选项,其中不常用的阿铭做了标注。

“-z” : 同时用gzip压缩

“-j” : 同时用bzip2压缩

“-x” : 解包或者解压缩

“-t” : 查看tar包里面的文件

“-c” : 建立一个tar包或者压缩文件包

“-v” : 可视化

“-f” : 后面跟文件名,压缩时跟 “-f 文件名”,意思是压缩后的文件名为filename, 解压时跟 “-f 文件名”,意思是解压filename. 请注意,如果是多个参数组合的情况下带有 “-f”,请把 “-f” 写到最后面。

“-p” : 使用原文件的属性,压缩前什么属性压缩后还什么属性。(不常用)

“-P” : 可以使用绝对路径。(不常用)

--exclude filename : 在打包或者压缩时,不要将filename文件包括在内。(不常用)

[root@localhost ~]# cd test

[root@localhost test]# mkdir test111

[root@localhost test]# touch test111/test2.txt

[root@localhost test]# echo "nihao" > !$

echo "nihao" > test111/test2.txt

[root@localhost test]# ls

test111 test.txt.bz2

[root@localhost test]# tar -cvf test111.tar test111

test111/

test111/test2.txt

[root@localhost test]# ls

test111 test111.tar test.txt.bz2

首先在test目录下建立test111目录,然后在test111目录下建立test2.txt, 并写入 “nihao” 到test2.txt中,接着是用tar把test111打包成test111.tar. 请记住 “-f” 参数后跟的是打包后的文件名, 然后再是要打包的目录或者文件。tar 打包后,原文件不会消失,而依旧存在。在上例中,阿铭使用一个特殊的符号 ”!$” 它表示上一条命令的最后一个参数,比如在本例中,它表示”test111/test2.txt”. tar 不仅可以打包目录也可以打包文件,打包的时候也可以不加 “-v” 选项表示,表示不可视化。

[root@localhost test]# rm -f test111.tar

[root@localhost test]# tar -cf test.tar test111 test.txt.bz2

[root@localhost test]# ls

test111 test.tar test.txt.bz2

删除原来的test111目录,然后解包test.tar,不管是打包还是解包,原来的文件是不会删除的,而且它会覆盖当前已经存在的文件或者目录。

[root@localhost test]# rm -rf test111

[root@localhost test]# ls

test.tar test.txt.bz2

[root@localhost test]# tar -xvf test.tar

test111/

test111/test2.txt

test.txt.bz2

打包的同时使用gzip压缩

tar命令非常好用的一个功能就是可以在打包的时候直接压缩,它支持gzip压缩和bzip2压缩。

[root@localhost test]# tar -czvf test111.tar.gz test111

test111/

test111/test2.txt

[root@localhost test]# ls

test111 test111.tar.gz test.tar test.txt.bz2

“-tf” 可以查看包或者压缩包的文件列表:

[root@localhost test]# tar -tf test111.tar.gz

test111/

test111/test2.txt

[root@localhost test]# tar -tf test.tar

test111/

test111/test2.txt

test.txt.bz2

“-zxvf” 用来解压.tar.gz的压缩包

[root@localhost test]# rm -rf test111

[root@localhost test]# ls

test111.tar.gz test.tar test.txt.bz2

[root@localhost test]# tar -zxvf test111.tar.gz

test111/

test111/test2.txt

[root@localhost test]# ls

test111 test111.tar.gz test.tar test.txt.bz2

打包的同时使用bzip2压缩

和gzip压缩不同的是,这里使用 “-cjvf” 选项来压缩

[root@localhost test]# tar -cjvf test111.tar.bz2 test111

test111/

test111/test2.txt

[root@localhost test]# ls

test111 test111.tar.bz2 test111.tar.gz test.tar test.txt.bz2

同样可以使用 “-tf” 来查看压缩包文件列表

[root@localhost test]# tar -tf test111.tar.bz2

test111/

test111/test2.txt

解压.tar.bz2 的压缩包也很简单

[root@localhost test]# tar -jxvf test111.tar.bz2

test111/

test111/test2.txt

下面介绍一下 --exclude 这个选项的使用,因为在日常的管理工作中你也许会用到它。

[root@localhost test]# tar -cvf test111.tar --exclude test3.txt test111

test111/

test111/test4.txt

test111/test2.txt

test111/test5/

请注意上条命令中,test111.tar 是放到了 --exclude 选项的前面。除了可以排除文件,也可以排除目录:

[root@localhost test]# rm -f test111.tar

[root@localhost test]# tar -cvf test111.tar --exclude test5 test111

test111/

test111/test4.txt

test111/test3.txt

test111/test2.txt

第12章 安装RPM包或者安装源码包

学习Linux请加QQ群: 群1(163262181) 群2(148412746) 群3(246401509) 群4(173884211)

跟阿铭学Linux邀请函 (http://www.aminglinux.com),猿课已上线,请加微信aminglinux84索要配套视频教程。

在windows下安装一个软件很轻松,只要双击.exe的文件,安装提示连续 “下一步” 即可,然而linux系统下安装一个软件似乎并不那么轻松了,因为我们不是在图形界面下。所以你要学会如何在linux下安装一个软件。

在前面的内容中多次提到的yum, 这个yum是Redhat所特有的安装RPM程序包的工具,使用起来相当方便。因为使用RPM安装某一个程序包有可能会因为该程序包依赖另一个程序包而无法安装。而使用yum工具就可以连同依赖的程序包一起安装。当然CentOS同样可以使用yum工具,而且在CentOS中你可以免费使用yum,但Redhat中只有当你付费后才能使用yum,默认是无法使用yum的。在介绍yum之前先说一说RPM相关的东西。

RPM工具

RPM是 “Redhat Package Manager” 的缩写,根据名字也能猜到这是Redhat公司开发出来的。RPM 是以一种数据库记录的方式来将你所需要的套件安装到你的Linux 主机的一套管理程序。也就是说,你的linux系统中存在着一个关于RPM的数据库,它记录了安装的包以及包与包之间依赖相关性。RPM包是预先在linux机器上编译好并打包好的文件,安装起来非常快捷。但是也有一些缺点,比如安装的环境必须与编译时的环境一致或者相当;包与包之间存在着相互依赖的情况;卸载包时需要先把依赖的包卸载掉,如果依赖的包是系统所必须的,那就不能卸载这个包,否则会造成系统崩溃。

如果你的光驱中还有系统安装盘的话,我们可以通过 mount /dev/cdrom /mnt 命令把光驱挂载到/mnt目录下,那么你会在/mnt/Packages目录下看到很多.rpm的文件,这就是RPM包了。

[root@localhost ~]# mount /dev/cdrom /mnt/

mount: block device /dev/sr0 is write-protected, mounting read-only

[root@localhost ~]# ls /mnt/

CentOS_BuildTag Packages RPM-GPG-KEY-CentOS-Security-6

EULA RELEASE-NOTES-en-US.html RPM-GPG-KEY-CentOS-Testing-6

GPL repodata TRANS.TBL

images RPM-GPG-KEY-CentOS-6

isolinux RPM-GPG-KEY-CentOS-Debug-6

[root@localhost ~]# ls /mnt/Packages/|head

389-ds-base-1.2.11.15-11.el6.i686.rpm

389-ds-base-libs-1.2.11.15-11.el6.i686.rpm

abrt-2.0.8-15.el6.centos.i686.rpm

abrt-addon-ccpp-2.0.8-15.el6.centos.i686.rpm

abrt-addon-kerneloops-2.0.8-15.el6.centos.i686.rpm

abrt-addon-python-2.0.8-15.el6.centos.i686.rpm

abrt-cli-2.0.8-15.el6.centos.i686.rpm

abrt-desktop-2.0.8-15.el6.centos.i686.rpm

abrt-gui-2.0.8-15.el6.centos.i686.rpm

abrt-libs-2.0.8-15.el6.centos.i686.rpm

每一个rpm包的名称都由 - 和 . 分成了若干部分。就拿 “abrt-cli-2.0.8-15.el6.centos.i686.rpm” 这个包来解释一下, “abrt-cli” 为包名, “2.0.8” 则为版本信息, “15.el6.centos” 为发布版本号, “i686” 为运行平台。其中运行平台常见的有i386, i586, i686, x86_64 ,需要你注意的是cpu目前是分32位和64位的,i386,i586和i686都为32位平台,x86_64则代表为64位的平台。另外有些rpm包并没有写具体的平台而是noarch,这代表这个rpm包没有硬件平台限制。例如 “alacarte-0.10.0-1.fc6.noarch.rpm”. 下面介绍一下rpm常用的命令。

- 安装一个rpm包

[root@localhost ~]# rpm -ivh /mnt/Packages/libjpeg-turbo-devel-1.2.1-1.el6.i686.rpm

Preparing... ########################################### [100%]

1:libjpeg-turbo-devel ########################################### [100%]

“-i” : 安装的意思

“-v” : 可视化

“-h” : 显示安装进度

另外在安装一个rpm包时常用的附带参数有:

--force : 强制安装,即使覆盖属于其他包的文件也要安装

--nodeps : 当要安装的rpm包依赖其他包时,即使其他包没有安装,也要安装这个包

- 升级一个rpm包

命令 rpm -Uvh filename

“-U” : 即升级的意思

- 卸载一个rpm包

命令 rpm -e filename

这里的filename是通过rpm的查询功能所查询到的,稍后会作介绍。

[root@localhost ~]# rpm -qa |grep libjpeg-turbo-devel

libjpeg-turbo-devel-1.2.1-1.el6.i686

[root@localhost ~]# rpm -e libjpeg-turbo-devel

卸载时后边跟的filename和安装时的是有区别的,安装时是把一个存在的文件作为参数,而卸载时只需要包名即可。

- 查询一个包是否安装

命令 rpm -q rpm包名 (这里的包名,是不带有平台信息以及后缀名的)

[root@localhost ~]# rpm -q libjpeg-turbo-devel

package libjpeg-turbo-devel is not installed

[root@localhost ~]# rpm -ivh /mnt/Packages/libjpeg-turbo-devel-1.2.1-1.el6.i686.rpm

Preparing... ########################################### [100%]

1:libjpeg-turbo-devel ########################################### [100%]

[root@localhost ~]# rpm -q libjpeg-turbo-devel

libjpeg-turbo-devel-1.2.1-1.el6.i686

我们可以使用 rpm -qa 查询当前系统所有安装过的rpm包,限于篇幅,阿铭只列出前十个。

[root@localhost ~]# rpm -qa |head

plymouth-core-libs-0.8.3-27.el6.centos.i686

xml-common-0.6.3-32.el6.noarch

sgpio-1.2.0.10-5.el6.i686

iso-codes-3.16-2.el6.noarch

gnome-vfs2.2.27.2-6.el6.i686

libX11-common-1.5.0-4.el6.noarch

curl-7.19.7-35.el6.i686

ca-certificates-2010.63-3.el6_1.5.noarch

cups-libs-1.4.2-48.el6_3.3.i686

kbd-misc-1.15-11.el6.noarch

- 得到一个已安装rpm包的相关信息

命令 rpm -qi 包名 (同样不需要加平台信息与后缀名)

[root@localhost ~]# rpm -qi libjpeg-turbo-devel

Name : libjpeg-turbo-devel Relocations: (not relocatable)

Version : 1.2.1 Vendor: CentOS

Release : 1.el6 Build Date: 2013年02月22日 星期五 06时49分08秒

Install Date: 2013年05月13日 星期一 01时37分48秒 Build Host: c6b9.bsys.dev.centos.org

Group : Development/Libraries Source RPM: libjpeg-turbo-1.2.1-1.el6.src.rpm

Size : 321085 License: wxWidgets

Signature : RSA/SHA1, 2013年02月24日 星期日 01时53分55秒, Key ID 0946fca2c105b9de

Packager : CentOS BuildSystem <http://bugs.centos.org>

URL : http://sourceforge.net/projects/libjpeg-turbo

Summary : Headers for the libjpeg-turbo library

Description :

This package contains header files necessary for developing programs which

will manipulate JPEG files using the libjpeg-turbo library.

- 列出一个rpm包安装的文件

命令 rpm -ql 包名

[root@localhost ~]# rpm -ql libjpeg-turbo-devel

/usr/include/jconfig.h

/usr/include/jerror.h

/usr/include/jmorecfg.h

/usr/include/jpeglib.h

/usr/lib/libjpeg.so

/usr/share/doc/libjpeg-turbo-devel-1.2.1

/usr/share/doc/libjpeg-turbo-devel-1.2.1/coderules.txt

/usr/share/doc/libjpeg-turbo-devel-1.2.1/example.c

/usr/share/doc/libjpeg-turbo-devel-1.2.1/jconfig.txt

/usr/share/doc/libjpeg-turbo-devel-1.2.1/libjpeg.txt

/usr/share/doc/libjpeg-turbo-devel-1.2.1/structure.txt

通过上面的命令可以看出文件 “/usr/lib/libjpeg.so” 是通过安装 “libjpeg-turbo-devel” 这个rpm包得来的。那么反过来如何通过一个文件去查找是由安装哪个rpm包得来的?

- 列出某一个文件属于哪个rpm包

命令 rpm -qf 文件的绝对路径

[root@localhost ~]# rpm -qf /usr/lib/libjpeg.so

libjpeg-turbo-devel-1.2.1-1.el6.i686

yum工具

在前面的章节中,阿铭多次提到yum工具,今天终于该讲它了。这个工具比rpm工具好用多了,当然前提是你使用的linux系统是支持yum的。yum最大的优势在于可以联网去下载所需要的rpm包,然后自动安装,在这个工程中如果要安装的rpm包有依赖关系,yum会帮你解决掉这些依赖关系依次安装所有rpm包。下面阿铭介绍常用的yum 命令。

- 列出所有可用的rpm包 “yum list”

[root@localhost ~]# yum list |head -n 20

Loaded plugins: fastestmirror, security

Loading mirror speeds from cached hostfile

* base: mirrors.btte.net

* extras: mirrors.btte.net

* updates: mirrors.btte.net

Installed Packages

ConsoleKit.i686 0.4.1-3.el6 @anaconda-CentOS-201303020136.i386/6.4

ConsoleKit-libs.i686 0.4.1-3.el6 @anaconda-CentOS-201303020136.i386/6.4

ConsoleKit-x11.i686 0.4.1-3.el6 @anaconda-CentOS-201303020136.i386/6.4

GConf2.i686 2.28.0-6.el6 @anaconda-CentOS-201303020136.i386/6.4

MAKEDEV.i686 3.24-6.el6 @anaconda-CentOS-201303020136.i386/6.4

ORBit2.i686 2.14.17-3.2.el6_3 @anaconda-CentOS-201303020136.i386/6.4

abrt.i686 2.0.8-15.el6.cento @anaconda-CentOS-201303020136.i386/6.4

abrt-addon-ccpp.i686 2.0.8-15.el6.cento @anaconda-CentOS-201303020136.i386/6.4

abrt-addon-kerneloops.i686 2.0.8-15.el6.cento @anaconda-CentOS-201303020136.i386/6.4

abrt-addon-python.i686 2.0.8-15.el6.cento @anaconda-CentOS-201303020136.i386/6.4

abrt-cli.i686 2.0.8-15.el6.centos @anaconda-CentOS-201303020136.i386/6.4

abrt-libs.i686 2.0.8-15.el6.centos @anaconda-CentOS-201303020136.i386/6.4

abrt-tui.i686 2.0.8-15.el6.centos @anaconda-CentOS-201303020136.i386/6.4

acl.i686 2.2.49-6.el6 @anaconda-CentOS-201303020136.i386/6.4

限于篇幅,阿铭只列举出来前14个包信息。从上例中可以看到有 “mirrors.btte.net” 信息出现,这是在告诉用户,它是从mirrors.btte.net这里下载到的rpm包资源。从上面的例子中你还可以看到最左侧是rpm包名字,中间是版本信息,最右侧是安装信息,如果安装了就显示类似 “@anaconda-CentOS”, “@base” 或者 “@extras”, 他们前面都会有一个 “@” 符号,这很好区分。未安装则显示base或者extras, 如果是该rpm包已安装但需要升级则显示updates. 如果你看的仔细会发现,”yum list” 会先列出已经安装的包(Installed Packages) 然后再列出可以安装的包(Available Packages)

- 搜索一个rpm包

命令 yum search [相关关键词]

[root@localhost ~]# yum search vim

Loaded plugins: fastestmirror, security

Loading mirror speeds from cached hostfile

* base: mirrors.btte.net

* extras: mirrors.btte.net

* updates: mirrors.btte.net

=========================================== N/S Matched: vim ======================================

vim-X11.i686 : The VIM version of the vi editor for the X Window System

vim-common.i686 : The common files needed by any version of the VIM editor

vim-enhanced.i686 : A version of the VIM editor which includes recent enhancements

vim-minimal.i686 : A minimal version of the VIM editor

Name and summary matches only, use "search all" for everything.

除了这样搜索外,阿铭常用的是利用grep来过滤

[root@localhost ~]# yum list |grep 'vim'

vim-common.i686 2:7.2.411-1.8.el6 @anaconda-CentOS-201303020136.i386/6.4

vim-enhanced.i686 2:7.2.411-1.8.el6 @anaconda-CentOS-201303020136.i386/6.4

vim-minimal.i686 2:7.2.411-1.8.el6 @anaconda-CentOS-201303020136.i386/6.4

vim-X11.i686 2:7.2.411-1.8.el6 base

我们同样可以找到相应的rpm包。

- 安装一个rpm包

命令 yum install [-y] [rpm包名]

如果不加 “-y” 选项,则会以与用户交互的方式安装,首先是列出需要安装的rpm包信息,然后会问用户是否需要安装,输入y则安装,输入n则不安装。而阿铭嫌这样太麻烦,所以直接加上 “-y” 选项,这样就省略掉了问用户是否安装的那一步。

[root@localhost ~]# yum install vim-X11

Loaded plugins: fastestmirror, security

Loading mirror speeds from cached hostfile

* base: mirrors.btte.net

* extras: mirrors.btte.net

* updates: mirrors.btte.net

Setting up Install Process

Resolving Dependencies

--> Running transaction check

---> Package vim-X11.i686 2:7.2.411-1.8.el6 will be installed

--> Finished Dependency Resolution

Dependencies Resolved

================================================================================

Package Arch Version Repository Size

================================================================================

Installing:

vim-X11 i686 2:7.2.411-1.8.el6 base 975 k

Transaction Summary

================================================================================

Install 1 Package(s)

Total download size: 975 k

Installed size: 2.1 M

Is this ok [y/N]: y

Downloading Packages:

vim-X11-7.2.411-1.8.el6.i686.rpm | 975 kB 00:03

Running rpm_check_debug

Running Transaction Test

Transaction Test Succeeded

Running Transaction

Installing : 2:vim-X11-7.2.411-1.8.el6.i686 1/1

Verifying : 2:vim-X11-7.2.411-1.8.el6.i686 1/1

Installed:

vim-X11.i686 2:7.2.411-1.8.el6

Complete!

- 卸载一个rpm包

命令 yum remove [-y] [rpm包名]

[root@localhost ~]# yum remove vim-X11

Loaded plugins: fastestmirror, security

Setting up Remove Process

Resolving Dependencies

--> Running transaction check

---> Package vim-X11.i686 2:7.2.411-1.8.el6 will be erased

--> Finished Dependency Resolution

Dependencies Resolved

================================================================================

Package Arch Version Repository Size

================================================================================

Removing:

vim-X11 i686 2:7.2.411-1.8.el6 @base 2.1 M

Transaction Summary

================================================================================

Remove 1 Package(s)

Installed size: 2.1 M

Is this ok [y/N]: y

Downloading Packages:

Running rpm_check_debug

Running Transaction Test

Transaction Test Succeeded

Running Transaction

Erasing : 2:vim-X11-7.2.411-1.8.el6.i686 1/1

Verifying : 2:vim-X11-7.2.411-1.8.el6.i686 1/1

Removed:

vim-X11.i686 2:7.2.411-1.8.el6

Complete!

卸载和安装一样,也可以直接加上 “-y” 选项来省略掉和用户交互的步骤。在这里阿铭要提醒一下,卸载某个rpm包一定要看清楚了,不要连其他重要的rpm包一起卸载了,以免影响正常的业务。

- 升级一个rpm包

命令 yum update [-y] [rpm包]

[root@localhost ~]# yum update libselinux

Loaded plugins: fastestmirror, security

Loading mirror speeds from cached hostfile

* base: mirrors.btte.net

* extras: mirrors.btte.net

* updates: mirrors.btte.net

Setting up Update Process

Resolving Dependencies

--> Running transaction check

---> Package libselinux.i686 0:2.0.94-5.3.el6 will be updated

--> Processing Dependency: libselinux = 2.0.94-5.3.el6 for package: libselinux-utils-2.0.94-5.3.el6.i686

---> Package libselinux.i686 0:2.0.94-5.3.el6_4.1 will be an update

--> Running transaction check

---> Package libselinux-utils.i686 0:2.0.94-5.3.el6 will be updated

---> Package libselinux-utils.i686 0:2.0.94-5.3.el6_4.1 will be an update

--> Finished Dependency Resolution

Dependencies Resolved

================================================================================

Package Arch Version Repository Size

================================================================================

Updating:

libselinux i686 2.0.94-5.3.el6_4.1 updates 108 k

Updating for dependencies:

libselinux-utils i686 2.0.94-5.3.el6_4.1 updates 81 k

Transaction Summary

================================================================================

Upgrade 2 Package(s)

Total download size: 189 k

Is this ok [y/N]: y

Downloading Packages:

(1/2): libselinux-2.0.94-5.3.el6_4.1.i686.rpm | 108 kB 00:00

(2/2): libselinux-utils-2.0.94-5.3.el6_4.1.i686.rpm | 81 kB 00:00

--------------------------------------------------------------------------------

Total 1.0 MB/s | 189 kB 00:00

Running rpm_check_debug

Running Transaction Test

Transaction Test Succeeded

Running Transaction

Updating : libselinux-2.0.94-5.3.el6_4.1.i686 1/4

Updating : libselinux-utils-2.0.94-5.3.el6_4.1.i686 2/4

Cleanup : libselinux-utils-2.0.94-5.3.el6.i686 3/4

Cleanup : libselinux-2.0.94-5.3.el6.i686 4/4

Verifying : libselinux-utils-2.0.94-5.3.el6_4.1.i686 1/4

Verifying : libselinux-2.0.94-5.3.el6_4.1.i686 2/4

Verifying : libselinux-2.0.94-5.3.el6.i686 3/4

Verifying : libselinux-utils-2.0.94-5.3.el6.i686 4/4

Updated:

libselinux.i686 0:2.0.94-5.3.el6_4.1

Dependency Updated:

libselinux-utils.i686 0:2.0.94-5.3.el6_4.1

Complete!

以上介绍了如何使用yum搜索、安装、卸载以及升级一个rpm包,如果你掌握了这些那么你就已经可以解决日常工作中遇到的与rpm包相关问题了。当然yum工具还有好多其他好用的命令,阿铭不再列举出来,如果你感兴趣就去man 一下吧。除此之外,阿铭还会教你一些关于yum的小应用。

使用本地的光盘来制作一个yum源

有时候你的linux系统不能联网,当然就不能很便捷的使用联网的yum源了,这时候就需要你自己会利用linux系统光盘制作一个yum源。具体步骤如下:

a)挂载光盘

[root@localhost ~]# mount /dev/cdrom /mnt

b)删除/etc/yum.repos.d目录所有的repo文件

[root@localhost ~]# rm -rf /etc/yum.repos.d/*

c) 创建新文件dvd.repo

[root@localhost ~]# vim /etc/yum.repos.d/dvd.repo

加入以下内容:

[dvd]

name=install dvd

baseurl=file:///mnt

enabled=1

gpgcheck=0

d) 刷新 repos 生成缓存

[root@localhost ~]# yum makecache

然后就可以使用yum命令安装你所需要的软件包了

利用yum工具下载一个rpm包

有时,我们需要下载一个rpm包,只是下载下来,拷贝给其他机器使用,前面也介绍过yum安装rpm包的时候,首先得下载这个rpm包然后再去安装,所以使用yum完全可以做到只下载而不安装。

a)首先要安装 yum-downloadonly

[root@localhost ~]# yum install -y yum-plugin-downloadonly.noarch

如果你的CentOS是5.x版本,则需要安装yum-downloadonly.noarch这个包。

b)下载一个rpm包而不安装

[root@localhost ~]# yum install 包名 -y --downloadonly

这样虽然下载了,但是并没有保存到我们想要的目录下,那么如何指定目录呢?

c)下载到指定目录

[root@localhost ~]# yum install 包名 -y --downloadonly --downloaddir=/usr/local/src

下面阿铭下载一个rpm包:

[root@localhost ~]# yum install -y yum-presto.noarch --downloadonly --downloaddir=/usr/local/src/

Loaded plugins: downloadonly, fastestmirror, security

Loading mirror speeds from cached hostfile

* base: mirrors.btte.net

* extras: mirrors.btte.net

* updates: mirrors.btte.net

Setting up Install Process

Resolving Dependencies

--> Running transaction check

---> Package yum-presto.noarch 0:0.6.2-1.el6 will be installed

--> Processing Dependency: deltarpm >= 3.4-2 for package: yum-presto-0.6.2-1.el6.noarch

--> Running transaction check

---> Package deltarpm.i686 0:3.5-0.5.20090913git.el6 will be installed

--> Finished Dependency Resolution

Dependencies Resolved

================================================================================

Package Arch Version Repository Size

================================================================================

Installing:

yum-presto noarch 0.6.2-1.el6 base 32 k

Installing for dependencies:

deltarpm i686 3.5-0.5.20090913git.el6 base 73 k

Transaction Summary

================================================================================

Install 2 Package(s)

Total download size: 105 k

Installed size: 257 k

Downloading Packages:

--------------------------------------------------------------------------------

Total 43 MB/s | 105 kB 00:00

exiting because --downloadonly specified

[root@localhost ~]# ls /usr/local/src/

deltarpm-3.5-0.5.20090913git.el6.i686.rpm yum-presto-0.6.2-1.el6.noarch.rpm

安装源码包

其实,在linux下面安装一个源码包是最常用的,阿铭在日常的管理工作中,大部分软件都是通过源码安装的。安装一个源码包,是需要我们自己把源代码编译成二进制的可执行文件。如果你读得懂这些源代码,那么你就可以去修改这些源代码自定义功能,然后再去编译成你想要的。使用源码包的好处除了可以自定义修改源代码外还可以定制相关的功能,因为源码包在编译的时候是可以附加额外的选项的。

源码包的编译用到了linux系统里的编译器,常见的源码包一般都是用C语言开发的,这也是因为C语言为linux上最标准的程序语言。Linux上的C语言编译器叫做gcc,利用它就可以把C语言变成可执行的二进制文件。所以如果你的机器上没有安装gcc就没有办法去编译源码。你可以使用 yum install -y gcc 来完成安装。

安装一个源码包,通常需要三个步骤:

1)./configure

在这一步可以定制功能,加上相应的选项即可,具有有什么选项可以通过 ./configure --help 命令来查看。在这一步会自动检测你的linux系统与相关的套件是否有编译该源码包时需要的库,因为一旦缺少某个库就不能完成编译。只有检测通过后才会生成一个Makefile文件。

2) make

使用这个命令会根据Makefile文件中预设的参数进行编译,这一步其实就是gcc在工作了。

3) make install

安装步骤,生成相关的软件存放目录和配置文件的过程。

上面介绍的3步并不是所有的源码包软件都一样的,阿铭以前也曾经遇到过,安装步骤并不是这样,也就是说源码包的安装并非具有一定的标准安装步骤。这就需要你拿到源码包解压后,然后进入到目录找相关的帮助文档,通常会以INSTALL或者README为文件名。所以,你一定要去看一下。下面阿铭会编译安装一个源码包来帮你更深刻的去理解如何安装源码包。

- 下载一个源码包

下载源码包一定要去官方站点去下载,不要在网上随便下载,那样很不安全。因为你下载到的源码包很有可能是被人修改过的。

[root@localhost src]# cd /usr/local/src/

[root@localhost src]# wget http://mirrors.hust.edu.cn/apache/httpd/httpd-2.2.27.tar.bz2

阿铭提供的下载地址为apache官方网站上提供的一个镜像,下载速度还可以。在下载之前,阿铭进入到了 “/usr/local/src” 目录,这是因为阿铭习惯把源码包都放到这个目录下,这样做的好处是,方便自己和其他管理员维护,所以阿铭给你一个建议,以后下载的源码包都统一放到这个目录下吧。

- 解压源码包

[root@localhost src]# tar jxvf httpd-2.2.27.tar.bz2

- 配置相关的选项,并生成Makefile

[root@localhost src]# cd httpd-2.2.27

[root@localhost httpd-2.2.27]# ./configure --help |less

`configure' configures this package to adapt to many kinds of systems.

Usage: ./configure [OPTION]... [VAR=VALUE]...

To assign environment variables (e.g., CC, CFLAGS...), specify them as

VAR=VALUE. See below for descriptions of some of the useful variables.

Defaults for the options are specified in brackets.

Configuration:

-h, --help display this help and exit

--help=short display options specific to this package

--help=recursive display the short help of all the included packages

-V, --version display version information and exit

-q, --quiet, --silent do not print `checking ...' messages

--cache-file=FILE cache test results in FILE [disabled]

-C, --config-cache alias for `--cache-file=config.cache'

-n, --no-create do not create output files

--srcdir=DIR find the sources in DIR [configure dir or `..']

后面的内容阿铭省略掉了,阿铭使用 ./configure --help 命令查看可以使用的选项。一般常用的有 --prefix=PREFIX 这个选项的意思是定义软件包安装到哪里。到这里,阿铭再提一个小小的建议,通常源码包都是安装在/usr/local/目录下的。比如,我们把apache安装在/usr/local/apache2下,那么这里就应该这样写--prefix=/usr/local/apache2 其他还有好多选项,如果你有耐心可以挨个去看一看都有什么作用。

[root@localhost httpd-2.2.27]# ./configure --prefix=/usr/local/apache2

checking for chosen layout... Apache

checking for working mkdir -p... yes

checking build system type... i686-pc-linux-gnu

checking host system type... i686-pc-linux-gnu

checking target system type... i686-pc-linux-gnu

Configuring Apache Portable Runtime library ...

checking for APR... reconfig

configuring package in srclib/apr now

checking build system type... i686-pc-linux-gnu

checking host system type... i686-pc-linux-gnu

checking target system type... i686-pc-linux-gnu

Configuring APR library

Platform: i686-pc-linux-gnu

checking for working mkdir -p... yes

APR Version: 1.4.6

checking for chosen layout... apr

checking for gcc... no

checking for cc... no

checking for cl.exe... no

configure: error: in `/usr/local/src/httpd-2.2.27/srclib/apr':

configure: error: no acceptable C compiler found in $PATH

See `config.log' for more details

configure failed for srclib/apr

不幸的是,阿铭一开始就报错了,因为没有gcc编译器,需要先安装一下。

[root@localhost httpd-2.2.27]# yum install -y gcc

由于gcc依赖的包很多,所以安装时间会长一些。安装完后,再继续上面的步骤。

tcode:

[root@localhost httpd-2.2.27]# ./configure --prefix=/usr/local/apache2

验证这一步是否成功的命令是:

[root@localhost httpd-2.2.27]# echo $?

0

返回值如果是 “0” 则执行成功,否则就是没有成功。此时就成功生成 Makefile 了。

[root@localhost httpd-2.2.27]# ls -l Makefile

-rw-r--r-- 1 root root 8954 5月 13 12:02 Makefile

- 进行编译

[root@localhost httpd-2.2.27]# make

-bash: make: command not found

又发生错误了,提示 “make” 命令没有发现,解决办法是安装make工具。

[root@localhost httpd-2.2.27]# yum install -y make

继续make

[root@localhost httpd-2.2.27]# make

Making all in srclib

make[1]: Entering directory `/usr/local/src/httpd-2.2.27/srclib'

Making all in apr

make[2]: Entering directory `/usr/local/src/httpd-2.2.27/srclib/apr'

make[3]: Entering directory `/usr/local/src/httpd-2.2.27/srclib/apr'

/bin/sh /usr/local/src/httpd-2.2.27/srclib/apr/libtool --silent --mode=compile gcc -g -O2 -pthread -DHAVE_CONFIG_H -DLINUX=2 -D_REENTRANT -D_GNU_SOURCE -D_LARGEFILE64_SOURCE -I./include -I/usr/local/src/httpd-2.2.27/srclib/apr/include/arch/unix -I./include/arch/unix -I/usr/local/src/httpd-2.2.27/srclib/apr/include/arch/unix -I/usr/local/src/httpd-2.2.27/srclib/apr/include -o passwd/apr_getpass.lo -c passwd/apr_getpass.c && touch passwd/apr_getpass.lo

编译的时候,就会出现类似这么多乱七八糟的信息,编译的时间比较长,CPU使用率会很高,这是因为CPU高速计算,编译完后,再使用 echo $? 验证一下是否正常成功。

[root@localhost httpd-2.2.27]# echo $?

0

如果是0的话,就可以执行最后一步了。

- 安装

[root@localhost httpd-2.2.27]# make install

Making install in srclib

make[1]: Entering directory `/usr/local/src/httpd-2.2.27/srclib'

Making install in apr

make[2]: Entering directory `/usr/local/src/httpd-2.2.27/srclib/apr'

make[3]: Entering directory `/usr/local/src/httpd-2.2.27/srclib/apr'

make[3]: Nothing to be done for `local-all'.

make[3]: Leaving directory `/usr/local/src/httpd-2.2.27/srclib/apr'

当然你也可以使用 echo $? 看看有没有正确安装,执行完这一步,则会在 “/usr/local/apache2” 目录下增加了很多目录。

[root@localhost httpd-2.2.27]# ls /usr/local/apache2/

bin cgi-bin error icons lib man modules

build conf htdocs include logs manual

到此,apache源码的安装就完成了,其实在日常的源码安装工作中,并不是谁都像阿铭这样顺利完成安装的,遇到错误不能完成安装的情况是很多的。通常都是因为缺少某一个库文件导致的。这就需要你仔细琢磨报错信息或者查看当前目录下的 “config.log” 去得到相关的信息。另外,如果自己不能解决那就去网上google一下吧,通常你会得到想要的答案。

第13章 学习 shell脚本之前的基础知识

学习Linux请加QQ群: 群1(163262181) 群2(148412746) 群3(246401509) 群4(173884211)

跟阿铭学Linux邀请函 (http://www.aminglinux.com),猿课已上线,请加微信aminglinux84索要配套视频教程。

日常的linux系统管理工作中必不可少的就是shell脚本,如果不会写shell脚本,那么你就不算一个合格的管理员。目前很多单位在招聘linux系统管理员时,shell脚本的编写是必考的项目。有的单位甚至用shell脚本的编写能力来衡量这个linux系统管理员的经验是否丰富。阿铭讲这些的目的只有一个,那就是让你认真对待shell脚本,从一开始就要把基础知识掌握牢固,然后要不断的练习,只要你shell脚本写的好,相信你的linux求职路就会轻松的多。阿铭在这一章中并不会多么详细的介绍shell脚本,而只是带你进入shell脚本的世界,如果你很感兴趣那么请到网上下载相关的资料或者到书店购买相关书籍吧。

在学习shell 脚本之前,需要你了解很多关于shell的知识,这些知识是编写shell脚本的基础,所以希望你能够熟练的掌握。

什么是shell

简单点理解,就是系统跟计算机硬件交互时使用的中间介质,它只是系统的一个工具。实际上,在shell和计算机硬件之间还有一层东西那就是系统内核了。打个比方,如果把计算机硬件比作一个人的躯体,而系统内核则是人的大脑,至于shell,把它比作人的五官似乎更加贴切些。回到计算机上来,用户直接面对的不是计算机硬件而是shell,用户把指令告诉shell,然后shell再传输给系统内核,接着内核再去支配计算机硬件去执行各种操作。

阿铭接触的linux发布版本(Redhat/CentOS)系统默认安装的shell叫做bash,即Bourne Again Shell,它是sh(Bourne Shell)的增强版本。Bourn Shell 是最早行起来的一个shell,创始人叫Steven Bourne,为了纪念他所以叫做Bourn Shell,检称sh。那么这个bash有什么特点呢?

- 记录命令历史

我们敲过的命令,linux是会有记录的,预设可以记录1000条历史命令。这些命令保存在用户的家目录中的.bash_history文件中。有一点需要你知道的是,只有当用户正常退出当前shell时,在当前shell中运行的命令才会保存至.bash_history文件中。

与命令历史有关的有一个有意思的字符那就是 ‘!’ 了。常用的有这么几个应用:

1) !! 连续两个 ‘!’, 表示执行上一条指令;

[root@localhost ~]# pwd

/root

[root@localhost ~]# !!

pwd

/root

2) !n 这里的n是数字,表示执行命令历史中第n条指令,例如 !1002 表示执行命令历史中第1002个命令;

[root@localhost ~]# history |grep 1002

1002 pwd

1015 history |grep 1002

[root@localhost ~]# !1002

pwd

/root

history 命令如果未改动过环境变量,默认可以把最近1000条命令历史打印出来。

3) !字符串 (字符串大于等于1),例如 !pw 表示执行命令历史中最近一次以 ‘pw’ 为开头的指令。

[root@localhost ~]# !pw

pwd

/root

- 指令和文件名补全

最开始阿铭就介绍过这个功能了,记得吗?它就是按tab键,它可以帮你补全一个指令,也可以帮你补全一个路径或者一个文件名。连续按两次tab键,系统则会把所有的指令或者文件名都列出来。

- 别名

前面也出现过alias的介绍,这个就是bash所特有的功能之一了。我们可以通过alias把一个常用的并且很长的指令别名一个简洁易记的指令。如果不想用了,还可以用unalias解除别名功能。直接敲alias会看到目前系统预设的alias.

系统预设的alias指令也就这几个而已,你也可以自定义你想要的指令别名。alias语法很简单, alias [命令别名]=['具体的命令']

[root@localhost ~]# alias aming='pwd'

[root@localhost ~]# aming

/root

[root@localhost ~]# unalias aming

[root@localhost ~]# aming

bash: aming: command not found

使用 unalias 命令别名 就可以把设置的别名给解除了。

- 通配符

在bash下,可以使用 * 来匹配零个或多个字符,而用 ? 匹配一个字符。

[root@localhost ~]# ls -d test*

test1.txt test2 test3 test.pl test.txt

[root@localhost ~]# ls -d test?

test2 test3

- 输入输出重定向

输入重定向用于改变命令的输入,输出重定向用于改变命令的输出。输出重定向更为常用,它经常用于将命令的结果输入到文件中,而不是屏幕上。输入重定向的命令是<,输出重定向的命令是>,另外还有错误重定向2>,以及追加重定向>>,稍后会详细介绍。

- 管道符

前面已经提过过管道符 “|”, 就是把前面的命令运行的结果丢给后面的命令。

- 作业控制

当运行一个进程时,你可以使它暂停(按Ctrl+z),然后使用fg命令恢复它,利用bg命令使他到后台运行,你也可以使它终止(按Ctrl+c)。

[root@localhost ~]# vi test1.txt

testtestsstststst

阿铭使用 “vi” 编辑test1.txt, 随便输入一些内容,按 “ESC” 后, 使用 “Ctrl + z” 使任务暂停:

[root@localhost ~]# vi test1.txt

[1]+ Stopped vi test1.txt

可以看到提示 “vi test1.txt” 已经停止了,然后使用fg命令恢复它,此时又进入刚才的 “vi” 窗口了。再次使其暂停,然后输入 jobs, 可以看到在被暂停或者在后台运行的任务:

[root@localhost ~]# jobs

[1]+ Stopped vi test1.txt

如果想把暂停的任务丢在后台跑起来,就使用bg命令:

[root@localhost ~]# bg

[1]+ vi test1.txt &

[1]+ Stopped vi test1.txt

但是 vi 似乎并不支持在后台运行,那阿铭换一个其他的命令:

[root@localhost ~]# vmstat 1 > /tmp/1.log

^Z

[2]+ Stopped vmstat 1 > /tmp/1.log

[root@localhost ~]# jobs

[1]- Stopped vi test1.txt

[2]+ Stopped vmstat 1 > /tmp/1.log

[root@localhost ~]# bg 2

[2]+ vmstat 1 > /tmp/1.log &

在上面的例子中,又有一个新的知识点需要你知道,那就是多个被暂停的任务会有编号,使用 jobs 命令可以看到两个任务,那么使用bg或者fg的时候,就需要在后面加一个编号了,阿铭使用 bg 2 把第二个被暂停的任务丢到后台跑起来了,丢入后台需要使用在命令后边加一个 & 符号,中间有个空格。本例中的 vmstat 1 这个是用来观察系统状态的一个命令,后面章节阿铭再介绍。

丢到后台的任务如何关掉呢?如果你没有退出刚才的shell, 那么先使用 fg 编号 把任务调到前台,然后使用 “Ctrl + c” 结束任务:

[root@localhost ~]# fg 2

vmstat 1 > /tmp/1.log

^C

另一种情况则是,关闭到当前的shell, 再次打开另一个shell时,使用jobs命令并不会显示在后台运行或者被暂停的任务,要想停掉它的话,则需要先知道其pid, 然后使用kill命令杀死那个进程。

[root@localhost ~]# vmstat 1 > /tmp/1.log &

[1] 9433

[root@localhost ~]# ps aux |grep vmstat

root 9433 0.0 0.0 6180 516 pts/2 S 09:57 0:00 vmstat 1

root 9435 0.0 0.0 103308 848 pts/2 S+ 09:58 0:00 grep vmstat

使用 & 把任务丢入后台运行,它会显示pid信息,如果忘记这个pid,我们还可以使用 ps aux 命令找到那个进程,关于 ps 这个命令阿铭会在后面讲解的。想结束掉该进程,需要使用 kill 命令:

[root@localhost ~]# kill 9433

[1]+ 已终止 vmstat 1 > /tmp/1.log

kill命令语法很简单,直接在后面加pid即可,如果遇到杀不死的进程时,可以在kill 后面加一个选项: kill-9 [pid]

变量

前面章节中阿铭曾经介绍过环境变量PATH,这个环境变量就是shell预设的一个变量,通常shell预设的变量都是大写的。变量,说简单点就是使用一个较简单的字符串来替代某些具有特殊意义的设定以及数据。就拿PATH来讲,这个PATH就代替了所有常用命令的绝对路径的设定。因为有了PATH这个变量,所以我们运行某个命令时不再去输入全局路径,直接敲命令名即可。你可以使用echo命令显示变量的值。

[root@localhost ~]# echo $PATH

/usr/local/sbin:/usr/local/bin:/sbin:/bin:/usr/sbin:/usr/bin:/root/bin

[root@localhost ~]# echo $HOME

/root

[root@localhost ~]# echo $PWD

/root

[root@localhost ~]# echo $LOGNAME

root

除了PATH, HOME, LOGNAME外,系统预设的环境变量还有哪些呢?

[root@localhost ~]# env

HOSTNAME=localhost.localdomain

TERM=xterm

SHELL=/bin/bash

HISTSIZE=1000

SSH_CLIENT=10.72.137.107 50947 22

SSH_TTY=/dev/pts/0

USER=root

LS_COLORS=rs=0:di=01;34:ln=01;36:mh=00:pi=40;33:so=01;35:do=01;35:bd=40;33;01:cd=40;33;01:or=40;31;01:mi=01;05;37;41:su=37;41:sg=30;43:ca=30;41:tw=30;42:ow=34;42:st=37;44:ex=01;32:*.tar=01;31:*.tgz=01;31:*.arj=01;31:*.taz=01;31:*.lzh=01;31:*.lzma=01;31:*.tlz=01;31:*.txz=01;31:*.zip=01;31:*.z=01;31:*.Z=01;31:*.dz=01;31:*.gz=01;31:*.lz=01;31:*.xz=01;31:*.bz2=01;31:*.tbz=01;31:*.tbz2=01;31:*.bz=01;31:*.tz=01;31:*.deb=01;31:*.rpm=01;31:*.jar=01;31:*.rar=01;31:*.ace=01;31:*.zoo=01;31:*.cpio=01;31:*.7z=01;31:*.rz=01;31:*.jpg=01;35:*.jpeg=01;35:*.gif=01;35:*.bmp=01;35:*.pbm=01;35:*.pgm=01;35:*.ppm=01;35:*.tga=01;35:*.xbm=01;35:*.xpm=01;35:*.tif=01;35:*.tiff=01;35:*.png=01;35:*.svg=01;35:*.svgz=01;35:*.mng=01;35:*.pcx=01;35:*.mov=01;35:*.mpg=01;35:*.mpeg=01;35:*.m2v=01;35:*.mkv=01;35:*.ogm=01;35:*.mp4=01;35:*.m4v=01;35:*.mp4v=01;35:*.vob=01;35:*.qt=01;35:*.nuv=01;35:*.wmv=01;35:*.asf=01;35:*.rm=01;35:*.rmvb=01;35:*.flc=01;35:*.avi=01;35:*.fli=01;35:*.flv=01;35:*.gl=01;35:*.dl=01;35:*.xcf=01;35:*.xwd=01;35:*.yuv=01;35:*.cgm=01;35:*.emf=01;35:*.axv=01;35:*.anx=01;35:*.ogv=01;35:*.ogx=01;35:*.aac=01;36:*.au=01;36:*.flac=01;36:*.mid=01;36:*.midi=01;36:*.mka=01;36:*.mp3=01;36:*.mpc=01;36:*.ogg=01;36:*.ra=01;36:*.wav=01;36:*.axa=01;36:*.oga=01;36:*.spx=01;36:*.xspf=01;36:

MAIL=/var/spool/mail/root

PATH=/usr/local/sbin:/usr/local/bin:/sbin:/bin:/usr/sbin:/usr/bin:/root/bin

PWD=/root

LANG=zh_CN.UTF-8

HISTCONTROL=ignoredups

SHLVL=1

HOME=/root

LOGNAME=root

SSH_CONNECTION=10.72.137.107 50947 10.72.137.159 22

LESSOPEN=|/usr/bin/lesspipe.sh %s

G_BROKEN_FILENAMES=1

_=/bin/env

使用 env 命令即可全部列出系统预设的全部系统变量了。不过登录的用户不一样这些环境变量的值也不一样。当前显示的就是root这个账户的环境变量了。下面阿铭简单介绍一下常见的环境变量:

PATH 决定了shell将到哪些目录中寻找命令或程序 HOME 当前用户主目录 HISTSIZE 历史记录数 LOGNAME 当前用户的登录名 HOSTNAME 指主机的名称 SHELL 前用户Shell类型 LANG 语言相关的环境变量,多语言可以修改此环境变量 MAIL 当前用户的邮件存放目录 PWD 当前目录

env命令显示的变量只是环境变量,系统预设的变量其实还有很多,你可以使用set命令把系统预设的全部变量都显示出来。

[root@localhost ~]# set

BASH=/bin/bash

BASHOPTS=checkwinsize:cmdhist:expand_aliases:extquote:force_fignore:hostcomplete:interactive_comments:login_shell:progcomp:promptvars:sourcepath

BASH_ALIASES=()

BASH_ARGC=()

BASH_ARGV=()

BASH_CMDS=()

BASH_LINENO=()

BASH_SOURCE=()

BASH_VERSINFO=([0]="4" [1]="1" [2]="2" [3]="1" [4]="release" [5]="i386-redhat-linux-gnu")

BASH_VERSION='4.1.2(1)-release'

COLORS=/etc/DIR_COLORS

COLUMNS=168

DIRSTACK=()

EUID=0

GROUPS=()

G_BROKEN_FILENAMES=1

HISTCONTROL=ignoredups

HISTFILE=/root/.bash_history

HISTFILESIZE=1000

HISTSIZE=1000

HOME=/root

HOSTNAME=localhost.localdomain

HOSTTYPE=i386

ID=0

IFS=$' \t\n'

LANG=zh_CN.UTF-8

LESSOPEN='|/usr/bin/lesspipe.sh %s'

LINES=44

LOGNAME=root

LS_COLORS='rs=0:di=01;34:ln=01;36:mh=00:pi=40;33:so=01;35:do=01;35:bd=40;33;01:cd=40;33;01:or=40;31;01:mi=01;05;37;41:su=37;41:sg=30;43:ca=30;41:tw=30;42:ow=34;42:st=37;44:ex=01;32:*.tar=01;31:*.tgz=01;31:*.arj=01;31:*.taz=01;31:*.lzh=01;31:*.lzma=01;31:*.tlz=01;31:*.txz=01;31:*.zip=01;31:*.z=01;31:*.Z=01;31:*.dz=01;31:*.gz=01;31:*.lz=01;31:*.xz=01;31:*.bz2=01;31:*.tbz=01;31:*.tbz2=01;31:*.bz=01;31:*.tz=01;31:*.deb=01;31:*.rpm=01;31:*.jar=01;31:*.rar=01;31:*.ace=01;31:*.zoo=01;31:*.cpio=01;31:*.7z=01;31:*.rz=01;31:*.jpg=01;35:*.jpeg=01;35:*.gif=01;35:*.bmp=01;35:*.pbm=01;35:*.pgm=01;35:*.ppm=01;35:*.tga=01;35:*.xbm=01;35:*.xpm=01;35:*.tif=01;35:*.tiff=01;35:*.png=01;35:*.svg=01;35:*.svgz=01;35:*.mng=01;35:*.pcx=01;35:*.mov=01;35:*.mpg=01;35:*.mpeg=01;35:*.m2v=01;35:*.mkv=01;35:*.ogm=01;35:*.mp4=01;35:*.m4v=01;35:*.mp4v=01;35:*.vob=01;35:*.qt=01;35:*.nuv=01;35:*.wmv=01;35:*.asf=01;35:*.rm=01;35:*.rmvb=01;35:*.flc=01;35:*.avi=01;35:*.fli=01;35:*.flv=01;35:*.gl=01;35:*.dl=01;35:*.xcf=01;35:*.xwd=01;35:*.yuv=01;35:*.cgm=01;35:*.emf=01;35:*.axv=01;35:*.anx=01;35:*.ogv=01;35:*.ogx=01;35:*.aac=01;36:*.au=01;36:*.flac=01;36:*.mid=01;36:*.midi=01;36:*.mka=01;36:*.mp3=01;36:*.mpc=01;36:*.ogg=01;36:*.ra=01;36:*.wav=01;36:*.axa=01;36:*.oga=01;36:*.spx=01;36:*.xspf=01;36:'

MACHTYPE=i386-redhat-linux-gnu

MAIL=/var/spool/mail/root

MAILCHECK=60

OLDPWD=/root

OPTERR=1

OPTIND=1

OSTYPE=linux-gnu

PATH=/usr/local/sbin:/usr/local/bin:/sbin:/bin:/usr/sbin:/usr/bin:/root/bin

PIPESTATUS=([0]="0")

PPID=27377

PROMPT_COMMAND='printf "\033]0;%s@%s:%s\007" "${USER}" "${HOSTNAME%%.*}" "${PWD/#$HOME/~}"'

PS1='[\u@\h \W]\$ '

PS2='> '

PS4='+ '

PWD=/root

SHELL=/bin/bash

SHELLOPTS=braceexpand:emacs:hashall:histexpand:history:interactive-comments:monitor

SHLVL=1

SSH_CLIENT='10.72.137.107 50947 22'

SSH_CONNECTION='10.72.137.107 50947 10.72.137.159 22'

SSH_TTY=/dev/pts/0