Spark记录(二):Spark程序的生命周期

本文以Spark执行模式中最常见的集群模式为例,详细的描述一下Spark程序的生命周期(YARN作为集群管理器)。

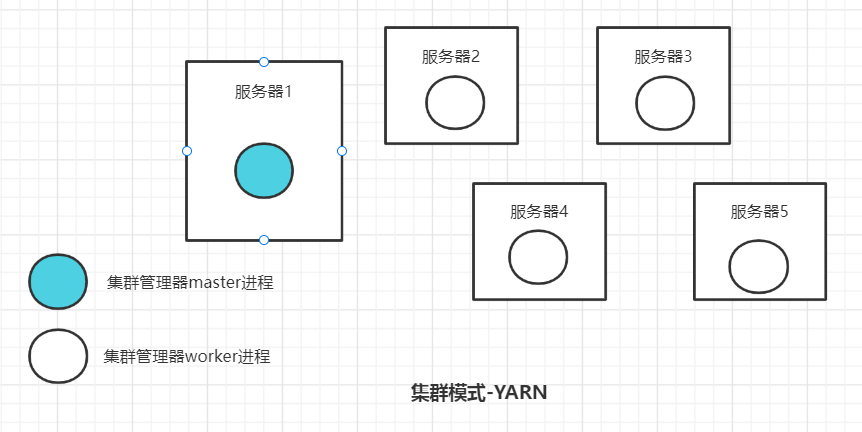

1、集群节点初始化

集群刚初始化的时候,或者之前的Spark任务完成之后,此时集群中的节点都处于空闲状态,每个服务器(节点)上,只有YARN的进程在运行(环境进程不在此考虑范围内),集群状态如下所示:

每个节点服务器上都有一个YARN的管理器进程在检测着服务器的状态。蓝色的是YARN主节点。

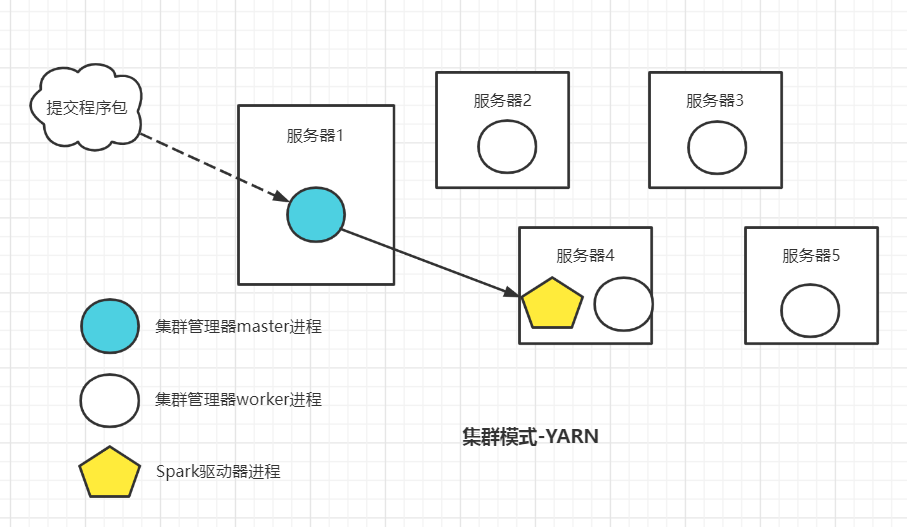

2、创建Spark驱动器进程

如上图所示,客户端将程序包(jar包或代码库)提交到集群管理器的驱动节点(即master节点),此时驱动节点会给Spark驱动器进程申请资源,并将其在某一个节点服务器上启动起来。程序包也发给Spark驱动器。

注意此时只有Spark的驱动器Driver进程,执行器Executor进程还未创建。

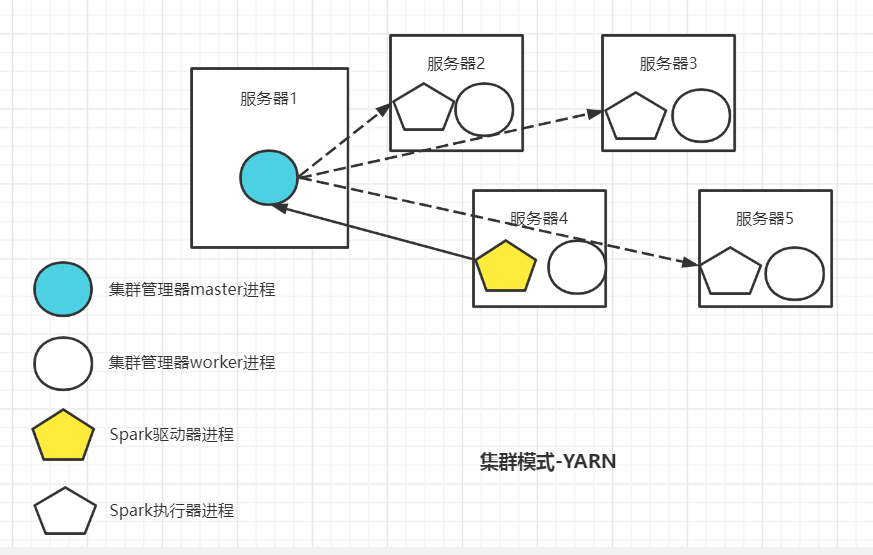

3、创建Spark集群

Spark的Driver进程启动后,开始执行用户代码。用户代码中会先初始化包含Spark集群信息的SparkSession,该SparkSession中就存有执行器所需资源的配置信息,它会与集群管理器的master进程通信(下图实线箭头),要求集群管理器在集群上启动所需要Spark的Executor(下图虚线箭头)。集群管理器按要求启动完Executor之后,会将启动的Executor及其所在节点信息发送给Spark的Driver进程,后面将由Spark的Driver对所有的Executor进程进行操控。这就构建出来了一个Spark集群。

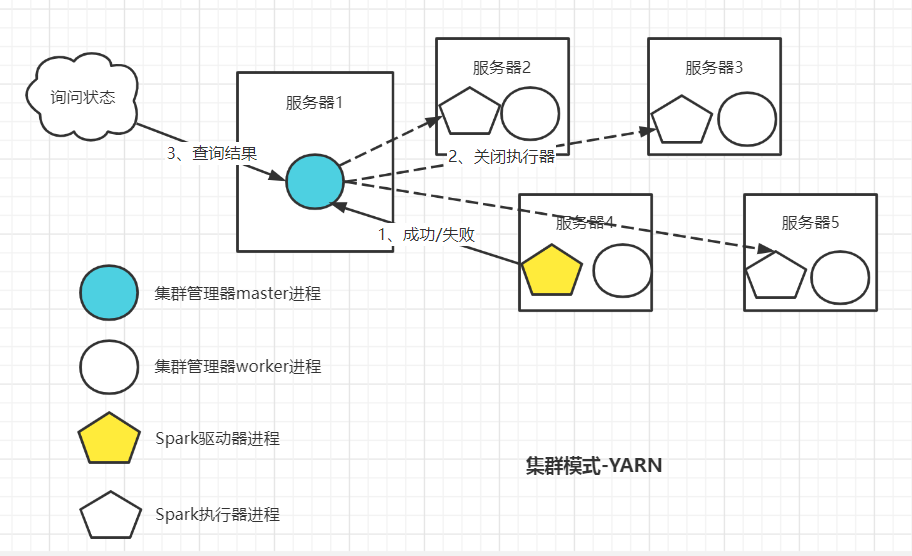

4、执行Spark程序

由于Spark的Driver进程已经从集群管理器处获取到了所有可以调度的Executor信息,下面就开始执行代码了,如下图所示。

Spark的Driver进程与Executor进程互相通信,下发task和反馈执行结果,直到程序代码执行完成或异常退出。

5、结束运行

当Spark程序执行完成之后,Driver进程会发消息给集群管理器的Master节点告知执行结果(下图箭头1),集群管理器会关闭该Spark驱动器对应的Executor进程。至此,资源全部被回收,Spark集群完成本次任务,用户可以通过集群管理器得到Spark任务的执行结果。

Spark集群资源完全释放之后,就又进入了第一步中的集群节点初始化的状态,等待下一个Spark任务的到来。

浙公网安备 33010602011771号

浙公网安备 33010602011771号