从最大似然到EM算法浅解

从最大似然到EM算法浅解

机器学习十大算法之中的一个:EM算法。能评得上十大之中的一个,让人听起来认为挺NB的。什么是NB啊,我们一般说某个人非常NB,是由于他能解决一些别人解决不了的问题。神为什么是神,由于神能做非常多人做不了的事。那么EM算法能解决什么问题呢?或者说EM算法是由于什么而来到这个世界上,还吸引了那么多世人的目光。

我希望自己能通俗地把它理解或者说明确,可是,EM这个问题感觉真的不太好用通俗的语言去说明确,由于它非常easy,又非常复杂。简单在于它的思想,简单在于其仅包括了两个步骤就能完毕强大的功能,复杂在于它的数学推理涉及到比較繁杂的概率公式等。假设仅仅讲简单的,就丢失了EM算法的精髓,假设仅仅讲数学推理,又过于枯燥和生涩,但还有一方面,想把两者结合起来也不是件easy的事。所以,我也没法期待我能把它讲得如何。希望各位不吝指导。

一、最大似然

扯了太多,得入正题了。如果我们遇到的是以下这种问题:

如果我们须要调查我们学校的男生和女生的身高分布。你怎么做啊?你说那么多人不可能一个一个去问吧,肯定是抽样了。如果你在校园里随便地活捉了100个男生和100个女生。他们共200个人(也就是200个身高的样本数据,为了方便表示,以下,我说“人”的意思就是相应的身高)都在教室里面了。那下一步怎么办啊?你開始喊:“男的左边,女的右边,其它的站中间!”。然后你就先统计抽样得到的100个男生的身高。如果他们的身高是服从高斯分布的。可是这个分布的均值u和方差∂2我们不知道,这两个參数就是我们要预计的。记作θ=[u, ∂]T。

用数学的语言来说就是:在学校那么多男生(身高)中,我们独立地依照概率密度p(x|θ)抽取100了个(身高),组成样本集X,我们想通过样本集X来预计出未知參数θ。这里概率密度p(x|θ)我们知道了是高斯分布N(u,∂)的形式,当中的未知參数是θ=[u, ∂]T。抽到的样本集是X={x1,x2,…,xN},当中xi表示抽到的第i个人的身高,这里N就是100,表示抽到的样本个数。

由于每一个样本都是独立地从p(x|θ)中抽取的,换句话说这100个男生中的不论什么一个,都是我随便捉的,从我的角度来看这些男生之间是没有关系的。那么,我从学校那么多男生中为什么就恰好抽到了这100个人呢?抽到这100个人的概率是多少呢?由于这些男生(的身高)是服从同一个高斯分布p(x|θ)的。那么我抽到男生A(的身高)的概率是p(xA|θ),抽到男生B的概率是p(xB|θ),那由于他们是独立的,所以非常明显,我同一时候抽到男生A和男生B的概率是p(xA|θ)* p(xB|θ),同理,我同一时候抽到这100个男生的概率就是他们各自概率的乘积了。用数学家的口吻说就是从分布是p(x|θ)的整体样本中抽取到这100个样本的概率,也就是样本集X中各个样本的联合概率,用下式表示:

这个概率反映了,在概率密度函数的參数是θ时,得到X这组样本的概率。由于这里X是已知的,也就是说我抽取到的这100个人的身高能够測出来,也就是已知的了。而θ是未知了,则上面这个公式仅仅有θ是未知数,所以它是θ的函数。这个函数放映的是在不同的參数θ取值下,取得当前这个样本集的可能性,因此称为參数θ相对于样本集X的似然函数(likehood function)。记为L(θ)。

这里出现了一个概念,似然函数。还记得我们的目标吗?我们须要在已经抽到这一组样本X的条件下,预计參数θ的值。怎么预计呢?似然函数有啥用呢?那咱们先来了解下似然的概念。

直接举个样例:

某位同学与一位猎人一起外出打猎,一仅仅野兔从前方窜过。仅仅听一声枪响,野兔应声到下,假设要你猜測,这一发命中的子弹是谁打的?你就会想,仅仅发一枪便打中,因为猎人命中的概率一般大于这位同学命中的概率,看来这一枪是猎人射中的。

这个样例所作的判断就体现了极大似然法的基本思想。

再比如:下课了,一群男女同学分别去厕所了。然后,你闲着无聊,想知道课间是男生上厕所的人多还是女生上厕所的人比較多,然后你就跑去蹲在男厕和女厕的门口。蹲了五分钟,突然一个美女走出来,你狂喜,跑过来告诉我,课间女生上厕所的人比較多,你要不相信你能够进去数数。呵呵,我才没那么蠢跑进去数呢,到时还不得上头条。我问你是怎么知道的。你说:“5分钟了,出来的是女生,女生啊,那么女生出来的概率肯定是最大的了,或者说比男生要大,那么女厕所的人肯定比男厕所的人多”。看到了没,你已经运用最大似然预计了。你通过观察到女生先出来,那么什么情况下,女生会先出来呢?肯定是女生出来的概率最大的时候了,那什么时候女生出来的概率最大啊,那肯定是女厕所比男厕所多人的时候了,这个就是你预计到的參数了。

从上面这两个样例,你得到了什么结论?

回到男生身高那个样例。在学校那么男生中,我一抽就抽到这100个男生(表示身高),而不是其它人,那是不是表示在整个学校中,这100个人(的身高)出现的概率最大啊。那么这个概率怎么表示?哦,就是上面那个似然函数L(θ)。所以,我们就仅仅须要找到一个參数θ,其相应的似然函数L(θ)最大,也就是说抽到这100个男生(的身高)概率最大。这个叫做θ的最大似然预计量,记为:

有时,能够看到L(θ)是连乘的,所以为了便于分析,还能够定义对数似然函数,将其变成连加的:

好了,如今我们知道了,要求θ,仅仅须要使θ的似然函数L(θ)极大化,然后极大值相应的θ就是我们的预计。这里就回到了求最值的问题了。怎么求一个函数的最值?当然是求导,然后让导数为0,那么解这个方程得到的θ就是了(当然,前提是函数L(θ)连续可微)。那假设θ是包括多个參数的向量那怎么处理啊?当然是求L(θ)对全部參数的偏导数,也就是梯度了,那么n个未知的參数,就有n个方程,方程组的解就是似然函数的极值点了,当然就得到这n个參数了。

最大似然预计你能够把它看作是一个反推。多数情况下我们是依据已知条件来推算结果,而最大似然预计是已经知道了结果,然后寻求使该结果出现的可能性最大的条件,以此作为预计值。比方,假设其它条件一定的话,抽烟者发生肺癌的危急时不抽烟者的5倍,那么假设如今我已经知道有个人是肺癌,我想问你这个人抽烟还是不抽烟。你怎么推断?你可能对这个人一无所知,你所知道的仅仅有一件事,那就是抽烟更easy发生肺癌,那么你会推測这个人不抽烟吗?我相信你更有可能会说,这个人抽烟。为什么?这就是“最大可能”,我仅仅能说他“最有可能”是抽烟的,“他是抽烟的”这一预计值才是“最有可能”得到“肺癌”这种结果。这就是最大似然预计。

好了,极大似然预计就说到这,总结一下:

极大似然预计,仅仅是一种概率论在统计学的应用,它是參数预计的方法之中的一个。说的是已知某个随机样本满足某种概率分布,可是当中详细的參数不清楚,參数预计就是通过若干次试验,观察其结果,利用结果推出參数的大概值。最大似然预计是建立在这种思想上:已知某个參数能使这个样本出现的概率最大,我们当然不会再去选择其它小概率的样本,所以干脆就把这个參数作为预计的真实值。

求最大似然函数预计值的一般步骤:

(1)写出似然函数;

(2)对似然函数取对数,并整理;

(3)求导数,令导数为0,得到似然方程;

(4)解似然方程,得到的參数即为所求;

二、EM算法

好了,又一次回到上面那个身高分布预计的问题。如今,通过抽取得到的那100个男生的身高和已知的其身高服从高斯分布,我们通过最大化其似然函数,就能够得到了相应高斯分布的參数θ=[u, ∂]T了。那么,对于我们学校的女生的身高分布也能够用相同的方法得到了。

再回到样例本身,假设没有“男的左边,女的右边,其它的站中间!”这个步骤,或者说我抽到这200个人中,某些男生和某些女生一见钟情,已经好上了,纠缠起来了。咱们也不想那么残忍,硬把他们拉扯开。那如今这200个人已经混到一起了,这时候,你从这200个人(的身高)里面随便给我指一个人(的身高),我都无法确定这个人(的身高)是男生(的身高)还是女生(的身高)。也就是说你不知道抽取的那200个人里面的每个人究竟是从男生的那个身高分布里面抽取的,还是女生的那个身高分布抽取的。用数学的语言就是,抽取得到的每个样本都不知道是从哪个分布抽取的。

这个时候,对于每个样本或者你抽取到的人,就有两个东西须要推測或者预计的了,一是这个人是男的还是女的?二是男生和女生相应的身高的高斯分布的參数是多少?

仅仅有当我们知道了哪些人属于同一个高斯分布的时候,我们才可以对这个分布的參数作出靠谱的预測,比如刚開始的最大似然所说的,但如今两种高斯分布的人混在一块了,我们又不知道哪些人属于第一个高斯分布,哪些属于第二个,所以就没法预计这两个分布的參数。反过来,仅仅有当我们对这两个分布的參数作出了准确的预计的时候,才干知道究竟哪些人属于第一个分布,那些人属于第二个分布。

这就成了一个先有鸡还是先有蛋的问题了。鸡说,没有我,谁把你生出来的啊。蛋不服,说,没有我,你从哪蹦出来啊。(呵呵,这是一个哲学问题。当然了,后来科学家说先有蛋,由于鸡蛋是鸟蛋进化的)。为了解决这个你依赖我,我依赖你的循环依赖问题,总得有一方要先打破僵局,说,无论了,我先随便整一个值出来,看你怎么变,然后我再依据你的变化调整我的变化,然后如此迭代着不断互相推导,终于就会收敛到一个解。这就是EM算法的基本思想了。

不知道大家是否能理解当中的思想,我再来啰嗦一下。事实上这个思想无处在不啊。

比如,小时候,老妈给一大袋糖果给你,叫你和你姐姐等分,然后你懒得去点糖果的个数,所以你也就不知道每一个人究竟该分多少个。咱们一般怎么做呢?先把一袋糖果目測的分为两袋,然后把两袋糖果拿在左右手,看哪个重,假设右手重,那非常明显右手这代糖果多了,然后你再在右手这袋糖果中抓一把放到左手这袋,然后再感受下哪个重,然后再从重的那袋抓一小把放进轻的那一袋,继续下去,直到你感觉两袋糖果差点儿相同相等了为止。呵呵,然后为了体现公平,你还让你姐姐先选了。

EM算法就是这样,如果我们想预计知道A和B两个參数,在開始状态下二者都是未知的,但如果知道了A的信息就能够得到B的信息,反过来知道了B也就得到了A。能够考虑首先赋予A某种初值,以此得到B的预计值,然后从B的当前值出发,又一次预计A的取值,这个过程一直持续到收敛为止。

EM的意思是“Expectation Maximization”,在我们上面这个问题里面,我们是先随便猜一下男生(身高)的正态分布的參数:如均值和方差是多少。比如男生的均值是1米7,方差是0.1米(当然了,刚開始肯定没那么准),然后计算出每一个人更可能属于第一个还是第二个正态分布中的(比如,这个人的身高是1米8,那非常明显,他最大可能属于男生的那个分布),这个是属于Expectation一步。有了每一个人的归属,或者说我们已经大概地按上面的方法将这200个人分为男生和女生两部分,我们就能够依据之前说的最大似然那样,通过这些被大概分为男生的n个人来又一次预计第一个分布的參数,女生的那个分布相同方法又一次预计。这个是Maximization。然后,当我们更新了这两个分布的时候,每一个属于这两个分布的概率又变了,那么我们就再须要调整E步……如此往复,直到參数基本不再发生变化为止。

这里把每一个人(样本)的完整描写叙述看做是三元组yi={xi,zi1,zi2},当中,xi是第i个样本的观測值,也就是相应的这个人的身高,是能够观測到的值。zi1和zi2表示男生和女生这两个高斯分布中哪个被用来产生值xi,就是说这两个值标记这个人究竟是男生还是女生(的身高分布产生的)。这两个值我们是不知道的,是隐含变量。确切的说,zij在xi由第j个高斯分布产生时值为1,否则为0 。比如一个样本的观測值为1.8,然后他来自男生的那个高斯分布,那么我们能够将这个样本表示为{1.8, 1, 0}。假设zi1和zi2的值已知,也就是说每一个人我已经标记为男生或者女生了,那么我们就能够利用上面说的最大似然算法来预计他们各自高斯分布的參数。可是它们未知,因此我们仅仅能用EM算法。

咱们如今不是由于那个恶心的隐含变量(抽取得到的每一个样本都不知道是从哪个分布抽取的)使得本来简单的能够求解的问题变复杂了,求解不了吗。那怎么办呢?人类解决这个问题的思路都是想是否能把复杂的问题简单化。好,那么如今把这个复杂的问题逆回来,我如果已经知道这个隐含变量了,哎,那么求解那个分布的參数是不是非常easy了,直接按上面说的最大似然预计就好了。那你就问我了,这个隐含变量是未知的,你怎么就来一个如果说已知呢?你这样的如果是没有依据的。呵呵,我知道,所以我们能够先给这个给分布弄一个初始值,然后求这个隐含变量的期望,当成是这个隐含变量的已知值,那么如今就能够用最大似然求解那个分布的參数了吧,那如果这个參数比之前的那个随机的參数要好,它更能表达真实的分布,那么我们再通过这个參数确定的分布去求这个隐含变量的期望,然后再最大化,得到还有一个更优的參数,……迭代,就能得到一个皆大欢喜的结果了。

这时候你就不服了,说你老迭代迭代的,你咋知道新的參数的预计就比原来的好啊?为什么这样的方法行得通呢?有没有失效的时候呢?什么时候失效呢?用到这种方法须要注意什么问题呢?呵呵,一下子抛出那么多问题,搞得我适应只是来了,只是这证明了你有非常好的搞研究的潜质啊。呵呵,事实上这些问题就是数学家须要解决的问题。在数学上是能够稳当的证明的或者得出结论的。那咱们用数学来把上面的问题又一次描写叙述下。(在这里能够知道,无论多么复杂或者简单的物理世界的思想,都须要通过数学工具进行建模抽象才得以使用并发挥其强大的作用,并且,这里面蕴含的数学往往能带给你很多其它想象不到的东西,这就是数学的精妙所在啊)

三、EM算法推导

如果我们有一个样本集{x(1),…,x(m)},包括m个独立的样本。但每一个样本i相应的类别z(i)是未知的(相当于聚类),也即隐含变量。故我们须要预计概率模型p(x,z)的參数θ,可是因为里面包括隐含变量z,所以非常难用最大似然求解,但如果z知道了,那我们就非常easy求解了。

对于參数预计,我们本质上还是想获得一个使似然函数最大化的那个參数θ,如今与最大似然不同的仅仅是似然函数式中多了一个未知的变量z,见下式(1)。也就是说我们的目标是找到适合的θ和z让L(θ)最大。那我们或许会想,你就是多了一个未知的变量而已啊,我也能够分别对未知的θ和z分别求偏导,再令其等于0,求解出来不也一样吗?

本质上我们是须要最大化(1)式(对(1)式,我们回顾下联合概率密度下某个变量的边缘概率密度函数的求解,注意这里z也是随机变量。对每个样本i的全部可能类别z求等式右边的联合概率密度函数和,也就得到等式左边为随机变量x的边缘概率密度),也就是似然函数,可是能够看到里面有“和的对数”,求导后形式会很复杂(自己能够想象下log(f1(x)+ f2(x)+ f3(x)+…)复合函数的求导),所以非常难求解得到未知參数z和θ。那OK,我们可否对(1)式做一些改变呢?我们看(2)式,(2)式仅仅是分子分母同乘以一个相等的函数,还是有“和的对数”啊,还是求解不了,那为什么要这么做呢?咱们先无论,看(3)式,发现(3)式变成了“对数的和”,那这样求导就easy了。我们注意点,还发现等号变成了不等号,为什么能这么变呢?这就是Jensen不等式的大显神威的地方。

Jensen不等式:

设f是定义域为实数的函数,假设对于全部的实数x。假设对于全部的实数x,f(x)的二次导数大于等于0,那么f是凸函数。当x是向量时,假设其hessian矩阵H是半正定的,那么f是凸函数。假设仅仅大于0,不等于0,那么称f是严格凸函数。

Jensen不等式表述例如以下:

假设f是凸函数,X是随机变量,那么:E[f(X)]>=f(E[X])

特别地,假设f是严格凸函数,当且仅当X是常量时,上式取等号。

假设用图表示会非常清晰:

图中,实线f是凸函数,X是随机变量,有0.5的概率是a,有0.5的概率是b。(就像掷硬币一样)。X的期望值就是a和b的中值了,图中能够看到E[f(X)]>=f(E[X])成立。

当f是(严格)凹函数当且仅当-f是(严格)凸函数。

Jensen不等式应用于凹函数时,不等号方向反向。

回到公式(2),由于f(x)=log x 为凹函数(其二次导数为-1/x2<0)。

(2)式中 的期望,(考虑到E(X)=∑x*p(x),f(X)是X的函数,则E(f(X))=∑f(x)*p(x)),又

的期望,(考虑到E(X)=∑x*p(x),f(X)是X的函数,则E(f(X))=∑f(x)*p(x)),又 ,所以就能够得到公式(3)的不等式了(若不明确,请拿起笔,呵呵):

,所以就能够得到公式(3)的不等式了(若不明确,请拿起笔,呵呵):

OK,到这里,如今式(3)就easy地求导了,可是式(2)和式(3)是不等号啊,式(2)的最大值不是式(3)的最大值啊,而我们想得到式(2)的最大值,那怎么办呢?

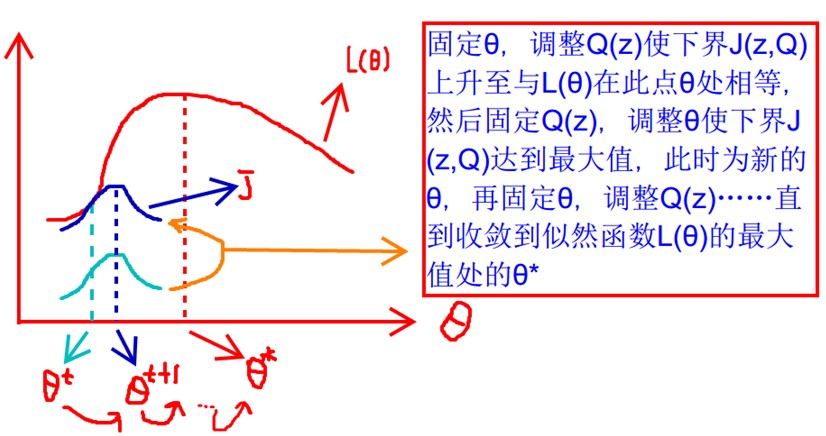

如今我们就须要一点想象力了,上面的式(2)和式(3)不等式能够写成:似然函数L(θ)>=J(z,Q),那么我们能够通过不断的最大化这个下界J,来使得L(θ)不断提高,终于达到它的最大值。

见上图,我们固定θ,调整Q(z)使下界J(z,Q)上升至与L(θ)在此点θ处相等(绿色曲线到蓝色曲线),然后固定Q(z),调整θ使下界J(z,Q)达到最大值(θt到θt+1),然后再固定θ,调整Q(z)……直到收敛到似然函数L(θ)的最大值处的θ*。这里有两个问题:什么时候下界J(z,Q)与L(θ)在此点θ处相等?为什么一定会收敛?

首先第一个问题,在Jensen不等式中说到,当自变量X是常数的时候,等式成立。而在这里,即:

再推导下,由于 (由于Q是随机变量z(i)的概率密度函数),则能够得到:分子的和等于c(分子分母都对全部z(i)求和:多个等式分子分母相加不变,这个觉得每一个例子的两个概率比值都是c),则:

(由于Q是随机变量z(i)的概率密度函数),则能够得到:分子的和等于c(分子分母都对全部z(i)求和:多个等式分子分母相加不变,这个觉得每一个例子的两个概率比值都是c),则:

至此,我们推出了在固定參数θ后,使下界拉升的Q(z)的计算公式就是后验概率,攻克了Q(z)怎样选择的问题。这一步就是E步,建立L(θ)的下界。接下来的M步,就是在给定Q(z)后,调整θ,去极大化L(θ)的下界J(在固定Q(z)后,下界还能够调整的更大)。那么一般的EM算法的过程例如以下:

EM算法(Expectation-maximization):

期望最大算法是一种从不全然数据或有数据丢失的数据集(存在隐含变量)中求解概率模型參数的最大似然预计方法。

EM的算法流程:

初始化分布參数θ;

反复下面步骤直到收敛:

E步骤:依据參数初始值或上一次迭代的模型參数来计算出隐性变量的后验概率,事实上就是隐性变量的期望。作为隐藏变量的现预计值:

M步骤:将似然函数最大化以获得新的參数值:

这个不断的迭代,就能够得到使似然函数L(θ)最大化的參数θ了。那就得回答刚才的第二个问题了,它会收敛吗?

感性的说,由于下界不断提高,所以极大似然预计单调添加,那么终于我们会到达最大似然预计的最大值。理性分析的话,就会得到以下的东西:

详细怎样证明的,看推导过程參考:Andrew Ng 《The EM algorithm》

http://www.cnblogs.com/jerrylead/archive/2011/04/06/2006936.html

四、EM算法还有一种理解

坐标上升法(Coordinate ascent):

图中的直线式迭代优化的路径,能够看到每一步都会向最优值前进一步,并且前进路线是平行于坐标轴的,由于每一步仅仅优化一个变量。

这宛如在x-y坐标系中找一个曲线的极值,然而曲线函数不能直接求导,因此什么梯度下降方法就不适用了。但固定一个变量后,另外一个能够通过求导得到,因此能够使用坐标上升法,一次固定一个变量,对另外的求极值,最后逐步逼近极值。相应到EM上,E步:固定θ,优化Q;M步:固定Q,优化θ;交替将极值推向最大。

五、EM的应用

EM算法有非常多的应用,最广泛的就是GMM混合高斯模型、聚类、HMM等等。详细能够參考JerryLead的cnblog中的Machine Learning专栏:

混合高斯模型(Mixtures of Gaussians)和EM算法

K-means聚类算法

没有鸡和蛋的先后之争,由于他们都知道“没有你就没有我”。从此他们一起过上了幸福美好的生活。

浙公网安备 33010602011771号

浙公网安备 33010602011771号