2023ICCV_Generalized Lightness Adaptation with Channel Selective Normalization

一. Motivatetion

跨域效果不好:在已知亮度的数据集上表现良好,在未知亮度的数据集上表现不好,泛化性能较差。

挑战:如何识别和亮度相关的通道并进行选择,并且获得泛化能力

归一化:从给定特征中提取不变的良好的良好特性,特别对于亮度分量

[ 归一化和亮度相关的特性:

1. 亮度一致性: 实例归一化可以确保每个通道的均值接近零,从而有助于提高特征图的亮度一致性。这意味着特征图的不同通道之间不会有很大的亮度差异,有助于模型更好地理解图像的亮度特性。

2. 对比度增强: 实例归一化可以确保每个通道的标准差接近一,从而有助于提高特征图的对比度。这意味着特征图的像素值将更接近归一化的均值,使得特征更加突出,提高了对图像细节的捕捉能力。

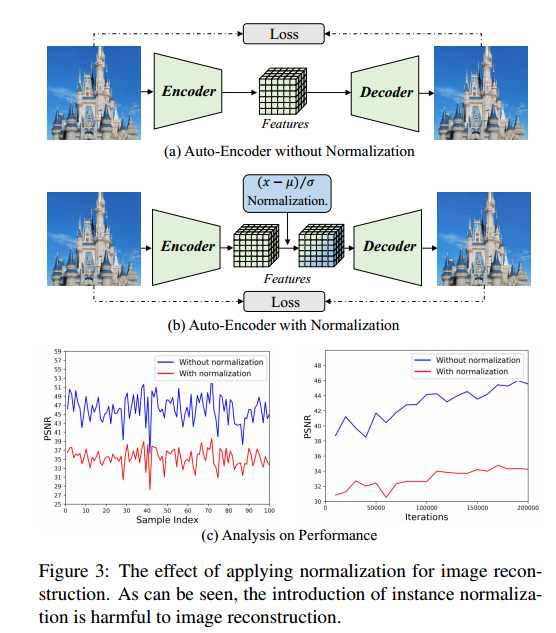

但是归一化不可避免的会造成信息丢失]

所以,必须找到和亮度变化敏感的通道进行归一化并保持其他通道不变,增强了泛化能力并保持特征的辨别能力。

信息丢失:

二. Contribution

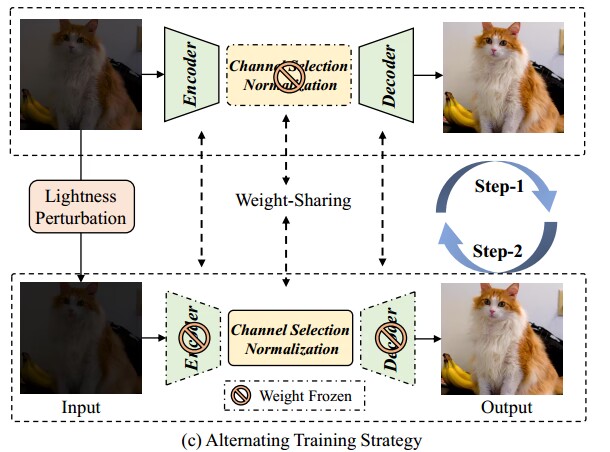

(1)对于如何识别与亮度相关通道,作者设计了交替训练策略

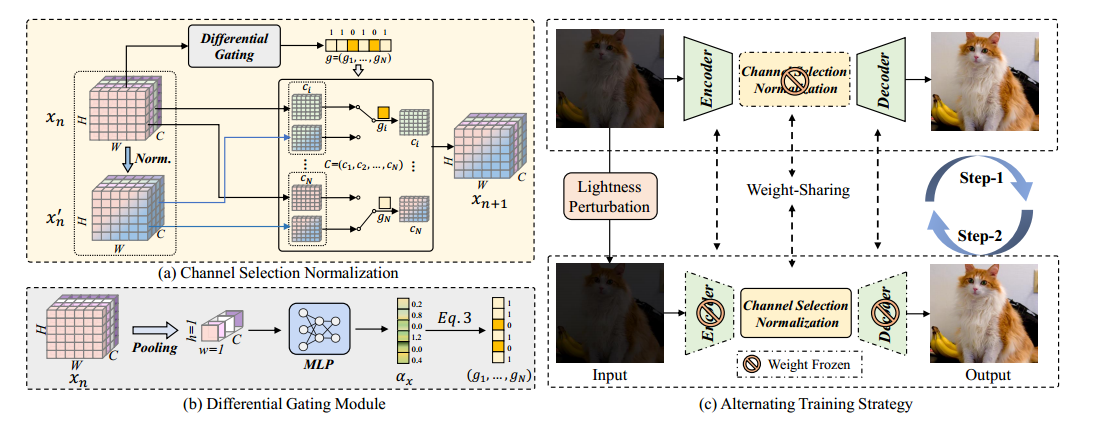

(2)对于和亮度相关的通道,作者设计了Channel Selection Normalization(CSNorm)

三. Network

1. CSNorm包括两部分(1)Normalization (2)Differential Gating Module

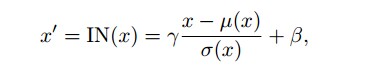

对于Normalization:实例归一化是对每个样本沿着通道方向独立对各个通道进行计算

# nn.InstanceNorm2d(1, affine=True) 通道归一化 nn.InstanceNorm2d(1, affine=True)

:µ(x)和σ(x)是在每个通道和实例的空间维度上独立计算的

:µ(x)和σ(x)是在每个通道和实例的空间维度上独立计算的

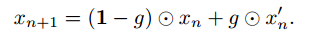

此时Xn是512层,对每层进行Gating设置

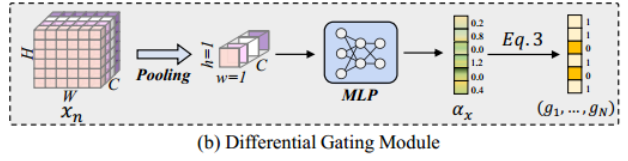

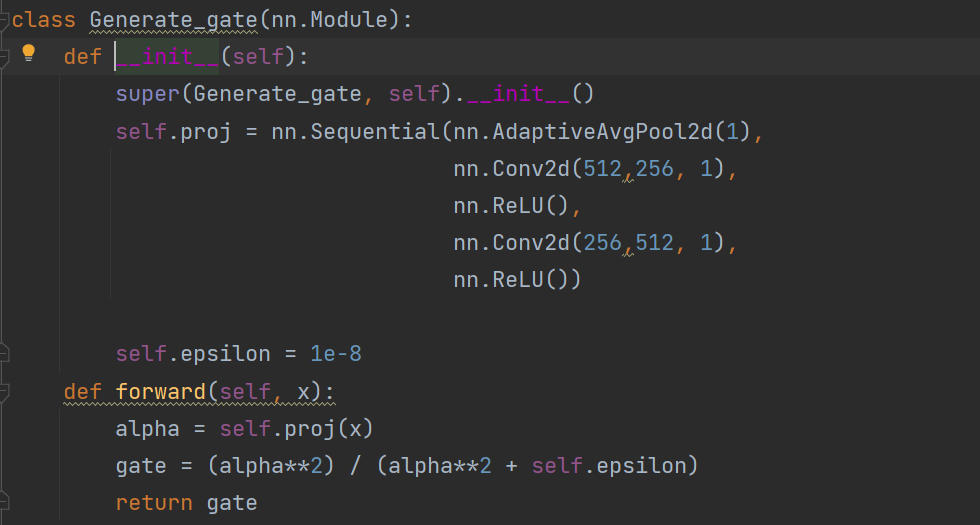

2. Differentiable Gating Module

H×W×C的特征经过自适应平均池化输入H×W×1,再经过两层的MLP,最后经过公式![]() 输出接近[0,1]的二进制数值

输出接近[0,1]的二进制数值

(1)当![]()

![]()

(2)当![]()

![]()

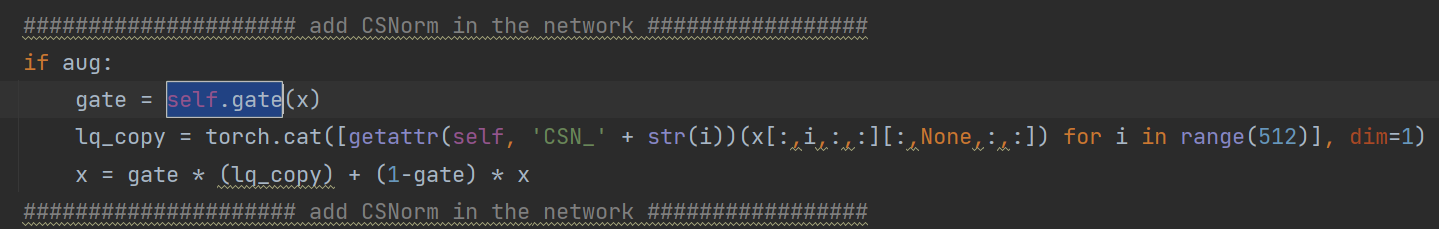

3. 将Normalization的每一层与Gating进行线性组合组织CSNorm

4. 交替训练策略

训练分为两个阶段:

Step-1:常规训练,输入低光图像,输出增强后的效果,此时不使用CSNorm,损失L1损失![]()

Step-2:增加CSNorm,输入扰动图像,输出增强后的效果,此时不更新编码器和解码器的梯度,损失常规L1+振幅的L1![]()

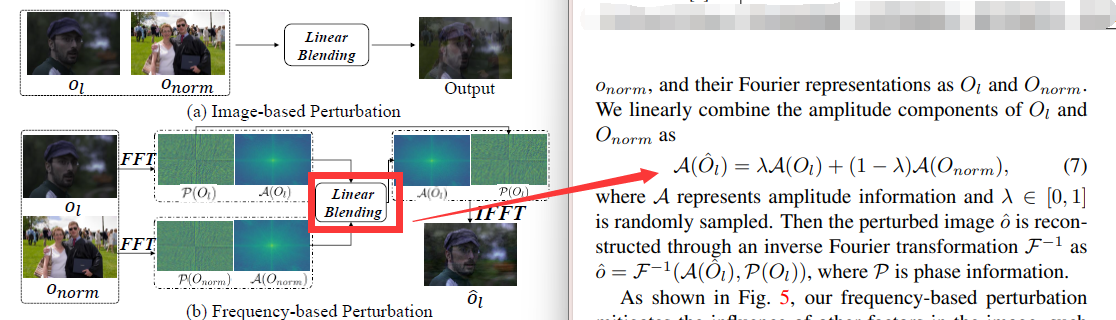

对于扰动图像的获取:使用低光和正常光图像线性组合他们的振幅产生新振幅,相位使用低光图像的相位,新振幅和相位使用逆傅里叶变换到空域

扰动图像展示的时候用的两张背景不同的照片,在代码中是low和gt振幅的线性组合

注:(1)CSNorm关注的是提高网络指标,而不是刷SOTA

(2)CSNorm可以作为trick,即插即用

浙公网安备 33010602011771号

浙公网安备 33010602011771号