集成学习3-Boosting

1 boosting集成原理

1.1 什么是boosting

- 随着学习的积累从弱到强,每新加入一个弱学习器,整体能力就会得到提升。

- 代表算法:Adaboost,GBDT,XGBoost

1.2 实现过程

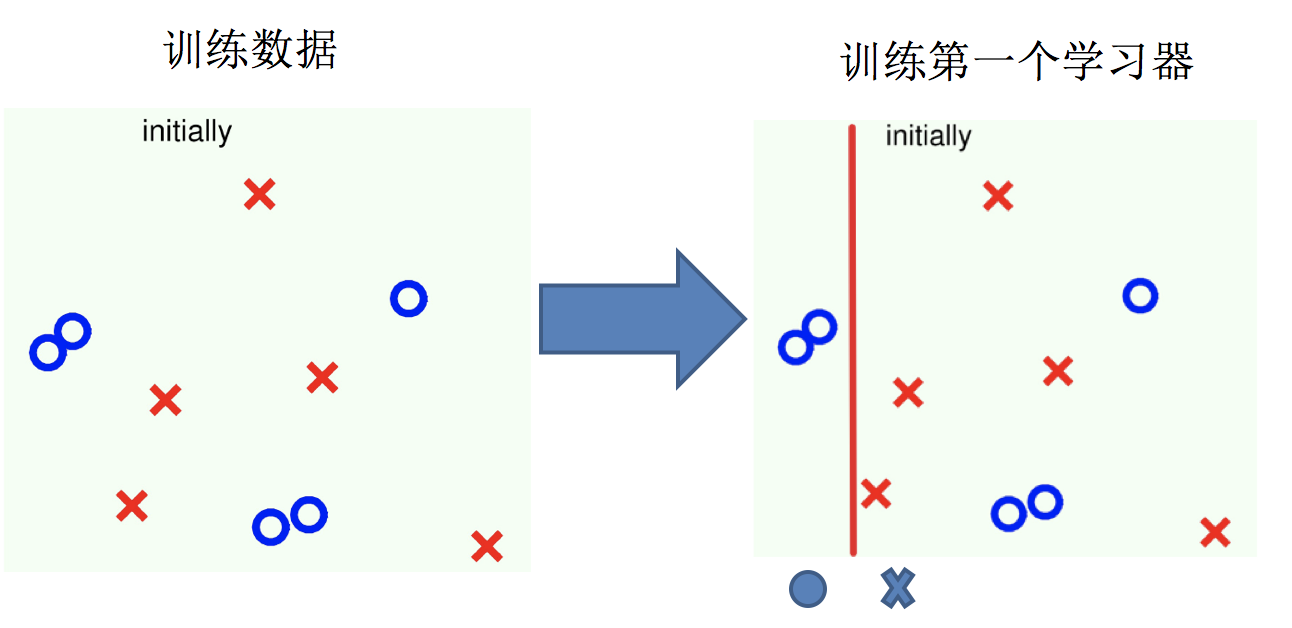

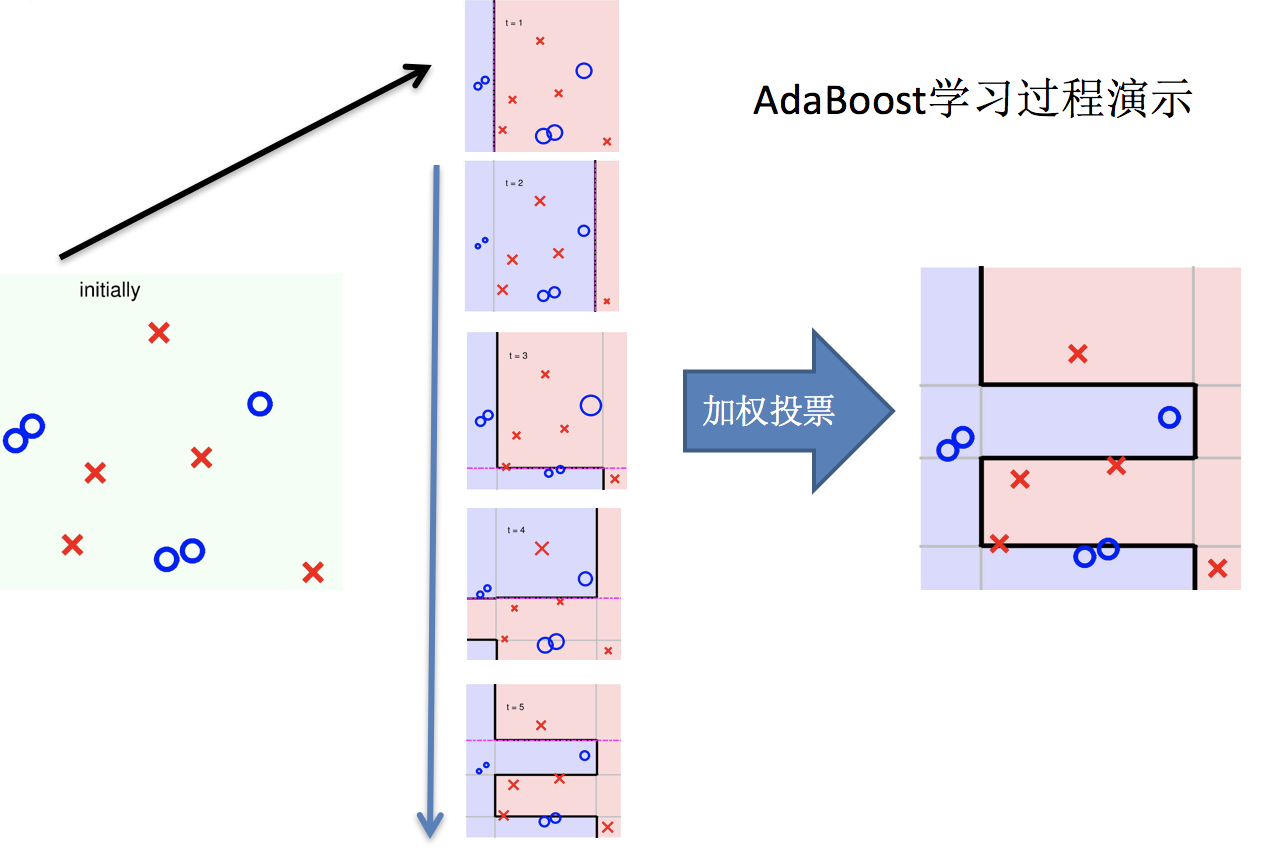

- 1.训练第一个学习器

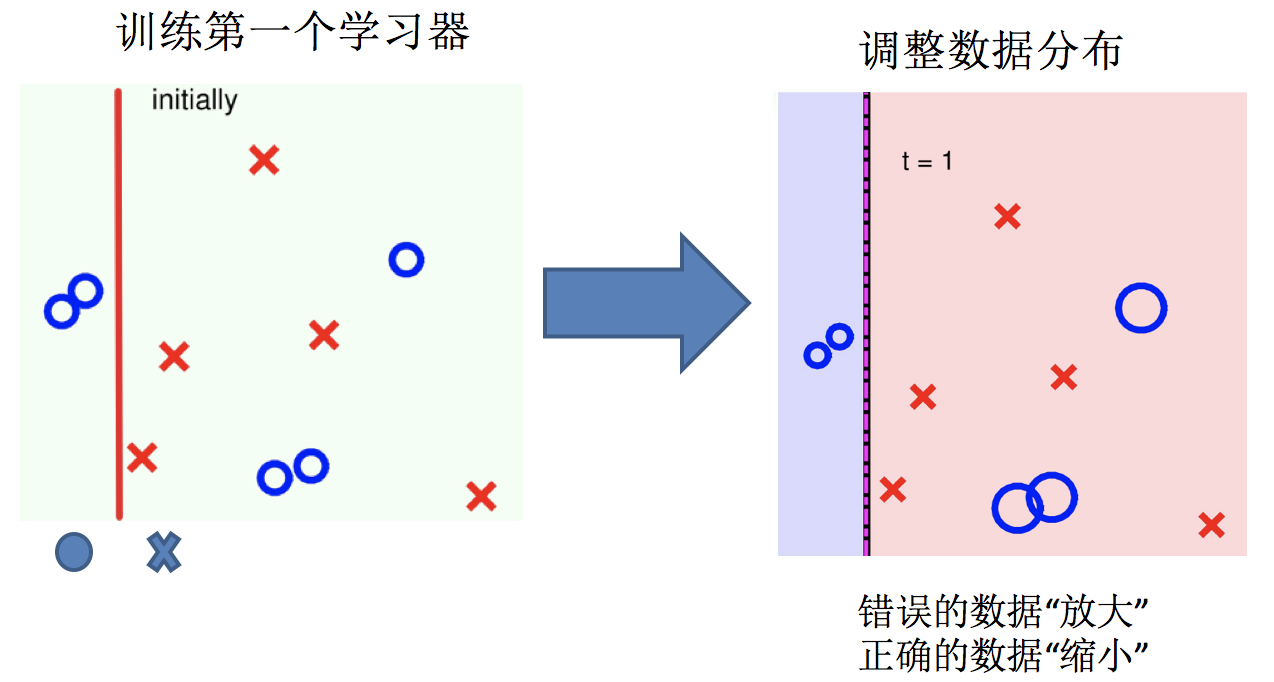

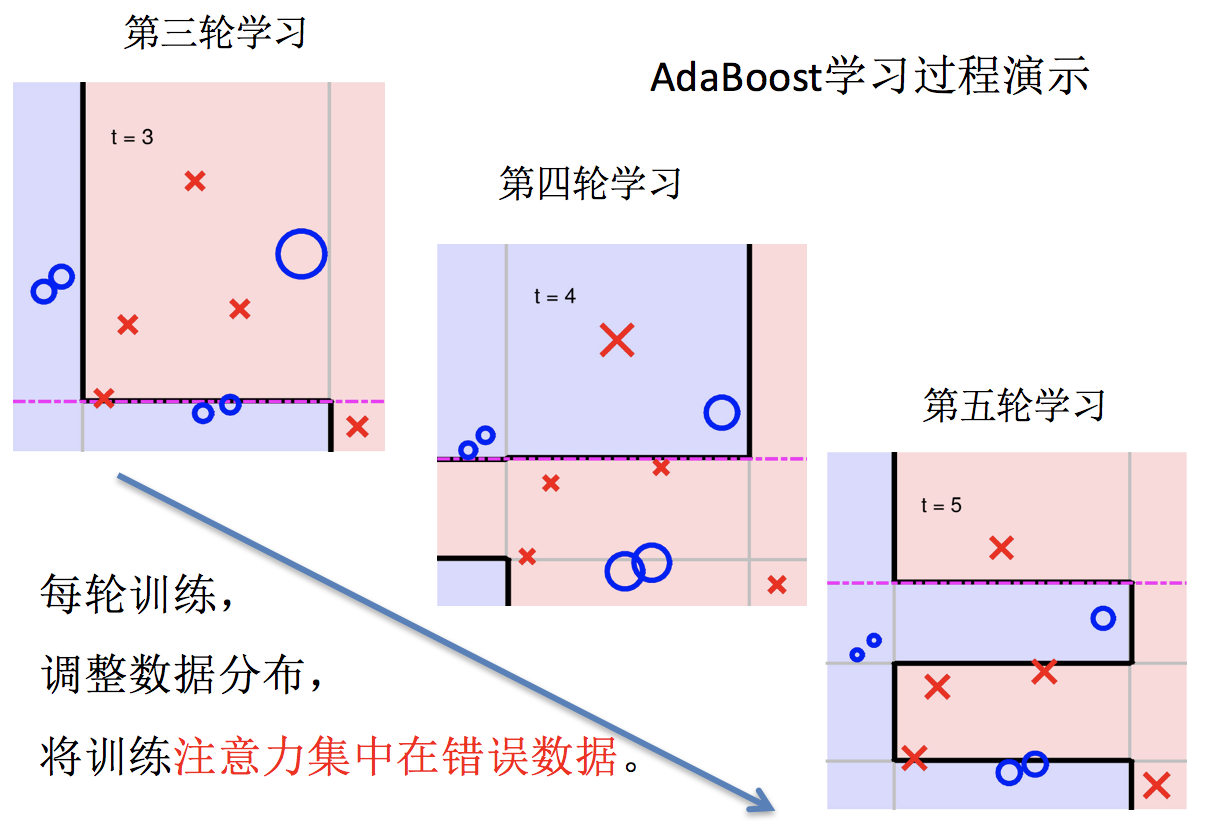

- 2.调整数据分布

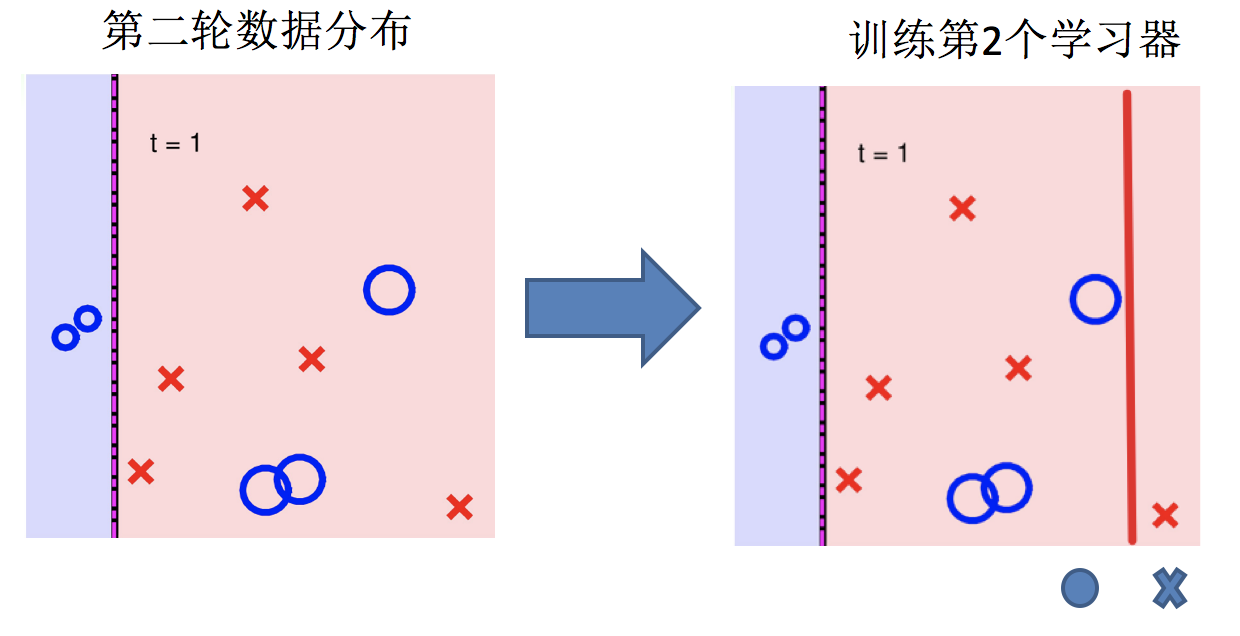

- 3.训练第二个学习器

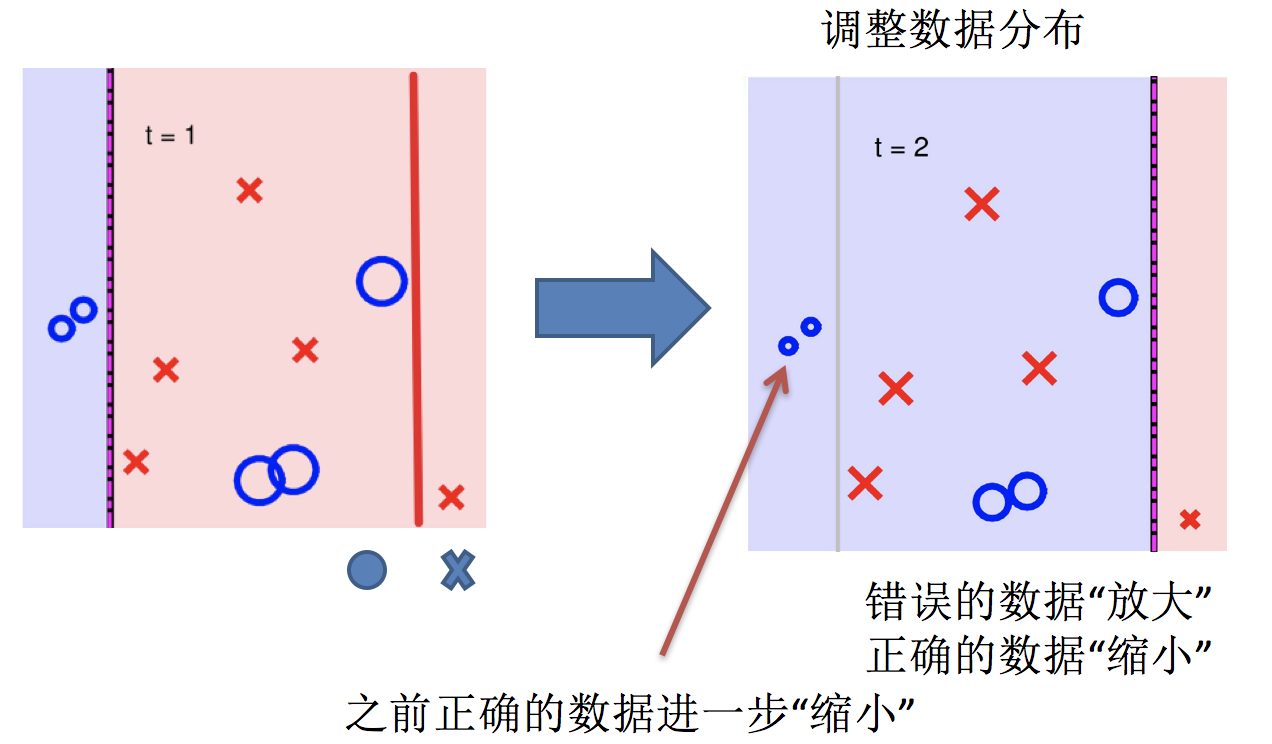

- 4.再次调整数据分布

- 5.依次训练学习器,调整数据分布

- 6.整体过程实现

总结:

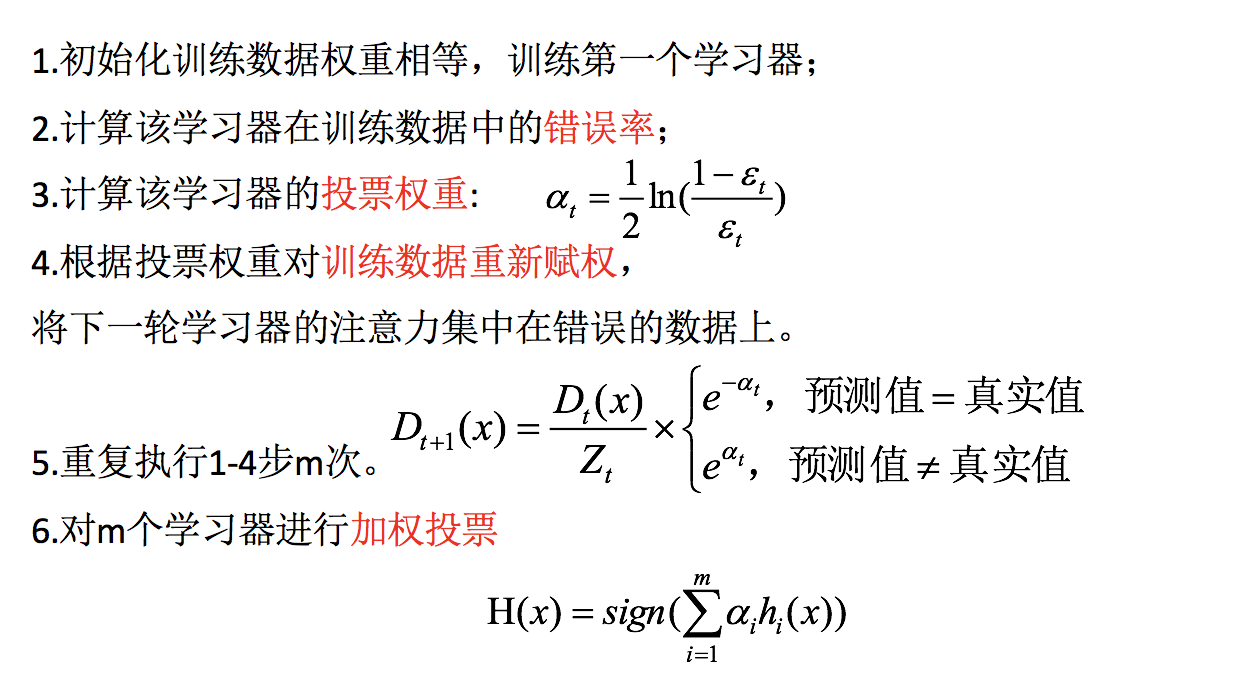

1.初始化训练数据权重,初始权重是相等的

2.通过这个学习器,计算错误率

3.计算这个学习器的投票权重

4.对每个样本进行重新赋权

5.重复前面1-4

6.对构建后的最后的学习器进加权投票

1.3 关键点:

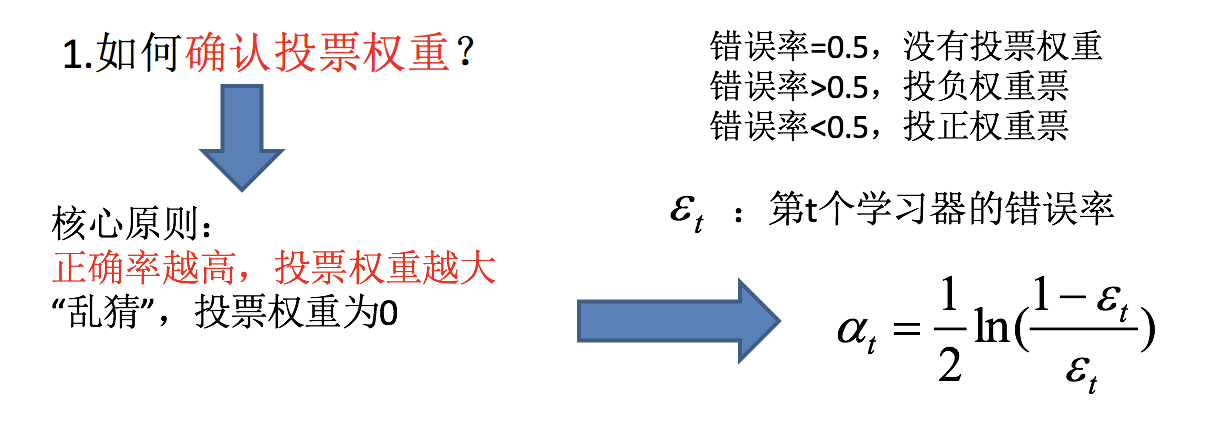

- 如何确认投票权重?

- 如何调整数据分布?

1.4 AdaBoost的构造过程小结

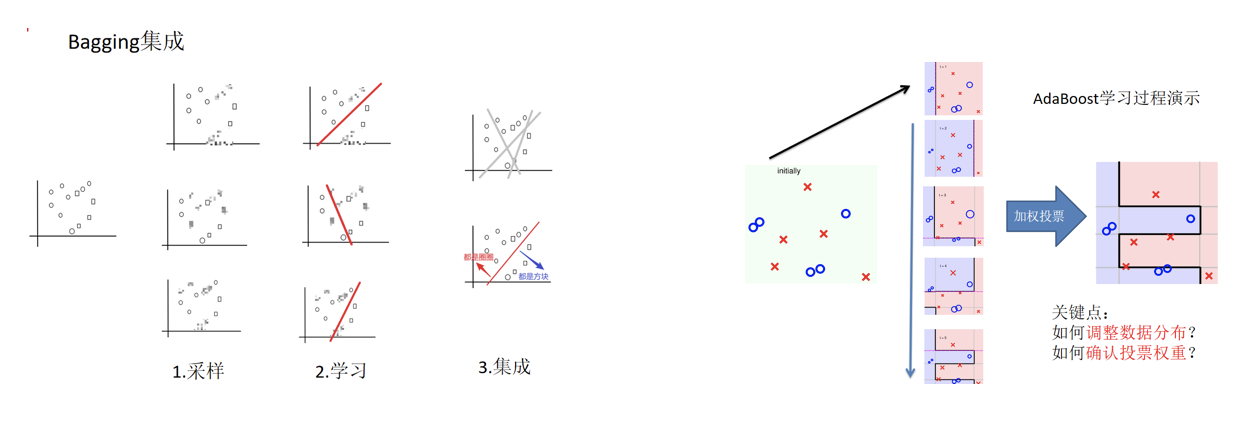

1.5 bagging集成与boosting集成的区别:

- 数据方面:

- bagging:重新采样

- boosting:对数据进行权重调整

- 投票方面:

- bagging:平权

- boosting:加权

- 学习顺序方面:

- bagging:并行

- boosting:串行

- 主要作用:

- bagging:过拟合

- boosting:欠拟合

1.6 api介绍

- from sklearn.ensemble import AdaBoostClassifier

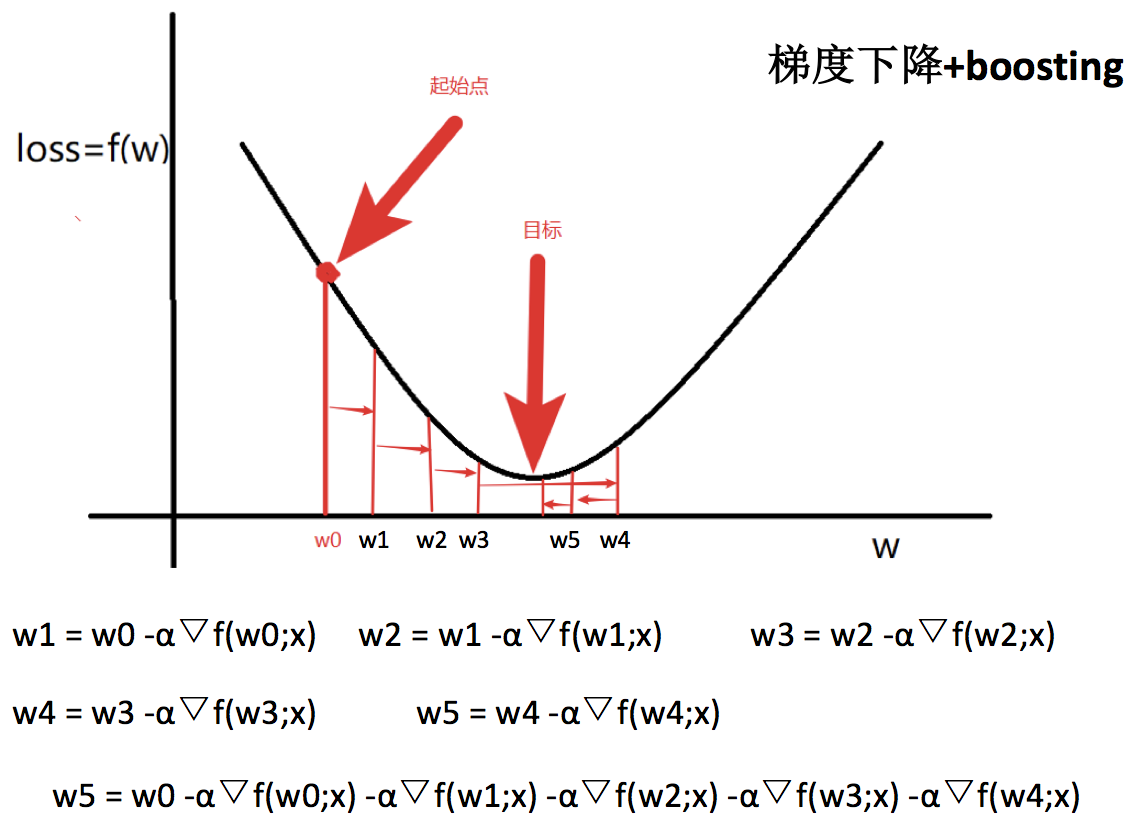

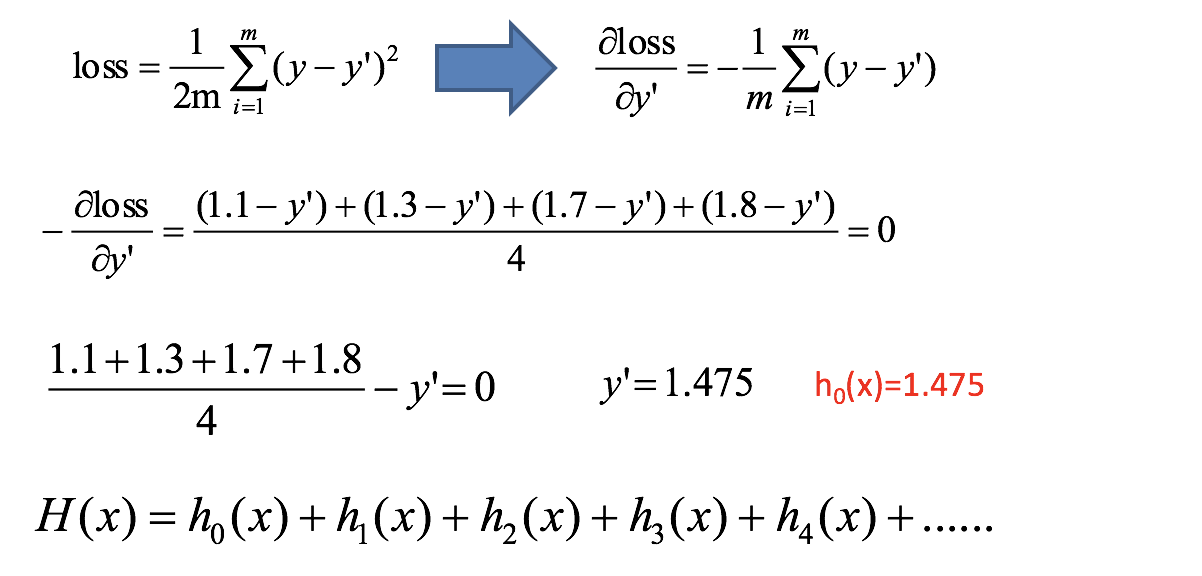

2 梯度提升决策树(GBDT Gradient Boosting Decision Tree)

- GBDT = 梯度下降 + Boosting + 决策树

2.1 GBDT执行流程

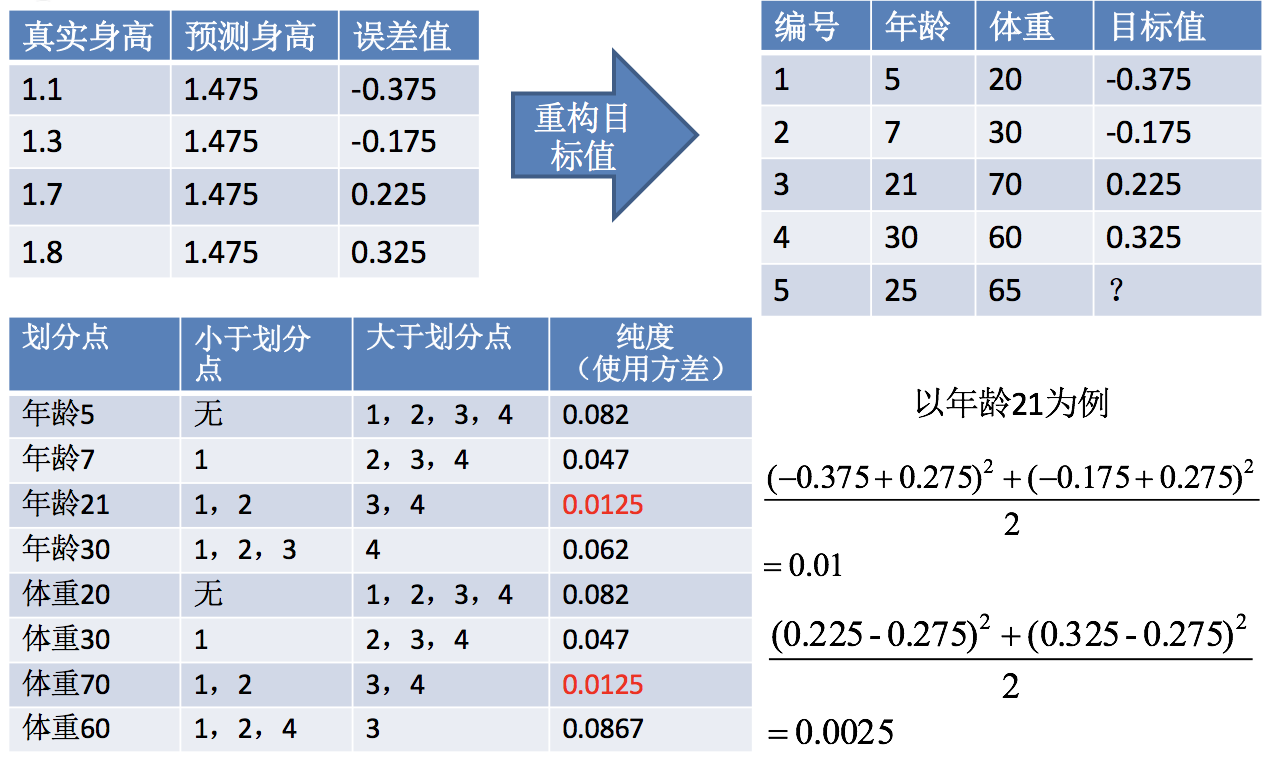

2.2 案例

预测编号5的身高:

| 编号 | 年龄(岁) | 体重(KG) | 身高(M) |

|---|---|---|---|

| 1 | 5 | 20 | 1.1 |

| 2 | 7 | 30 | 1.3 |

| 3 | 21 | 70 | 1.7 |

| 4 | 30 | 60 | 1.8 |

| 5 | 25 | 65 | ? |

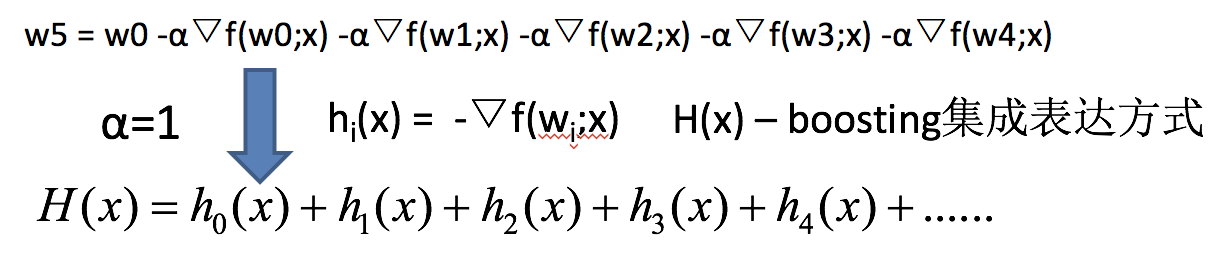

- 第一步:计算损失函数,并求出第一个预测值:

- 第二步:求解划分点

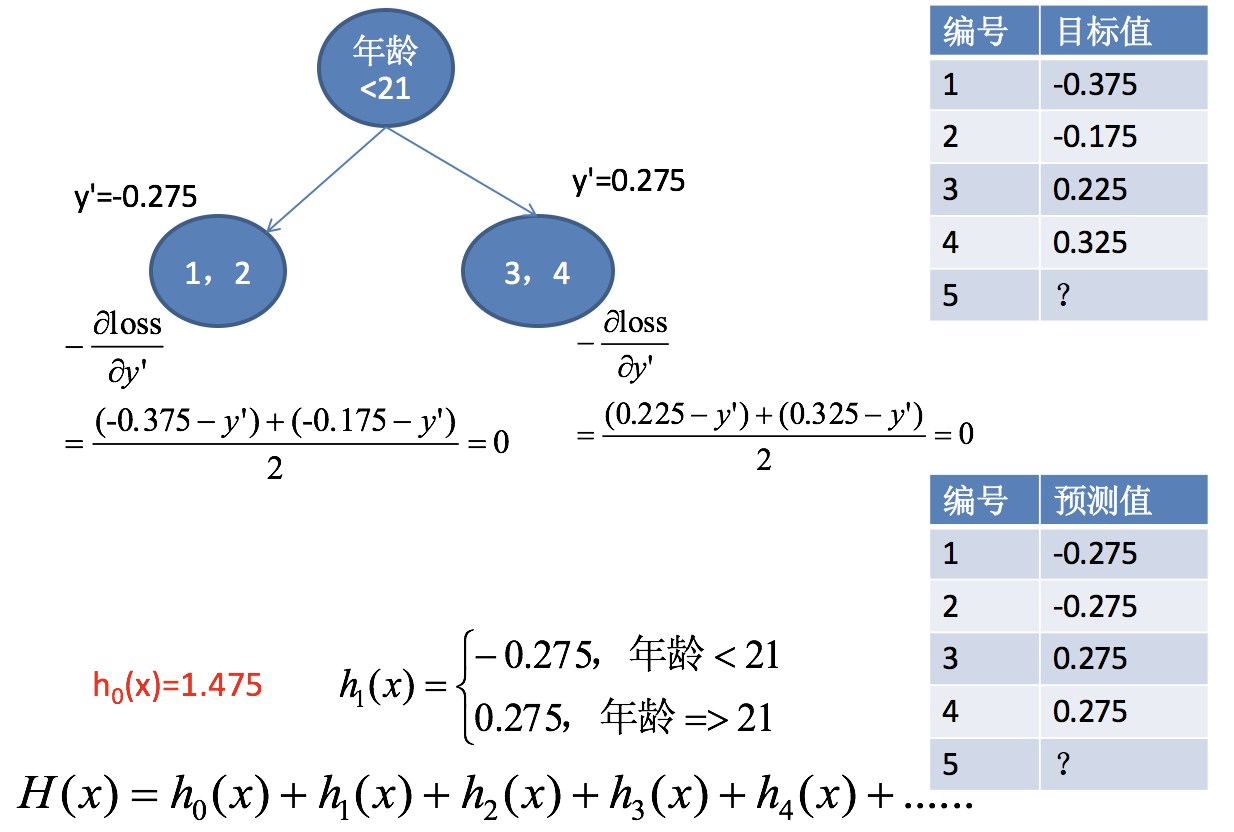

得出:年龄21为划分点的方差=0.01+0.0025=0.0125 - 第三步:通过调整后目标值,求解得出h1(x)

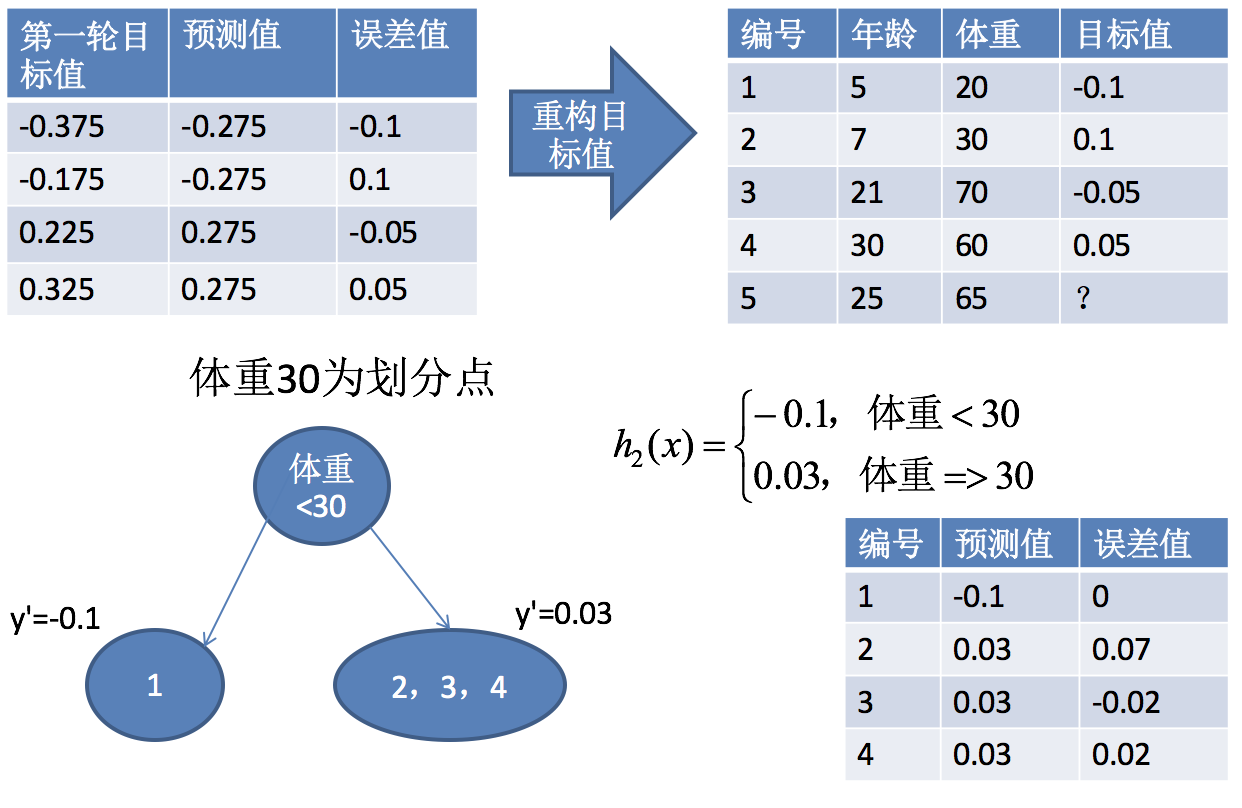

- 第四步:求解h2(x)

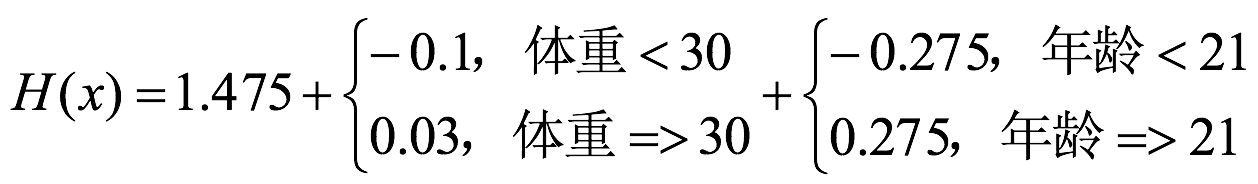

- 得出结果:

编号5身高 = 1.475 + 0.03 + 0.275 = 1.78

2.3 GBDT主要执行思想

1.使用梯度下降法优化代价函数;

2.使用一层决策树作为弱学习器,负梯度作为目标值;

3.利用boosting思想进行集成。

3 XGBoost

XGBoost= 二阶泰勒展开+boosting+决策树+正则化

-

Boosting:XGBoost使用Boosting提升思想对多个弱学习器进行迭代式学习

-

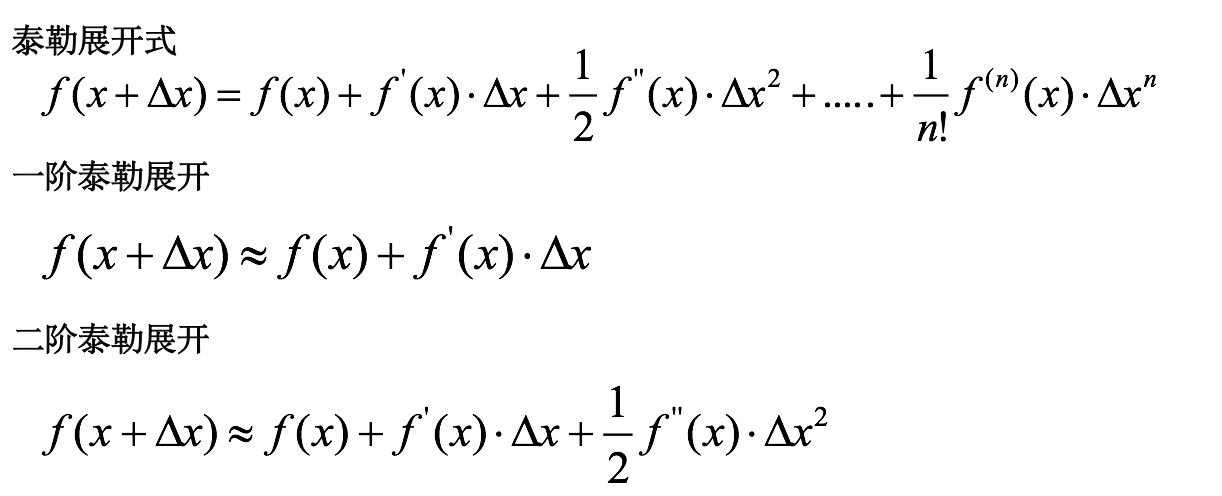

二阶泰勒展开:每一轮学习中,XGBoost对损失函数进行二阶泰勒展开,使用一阶和二阶梯度进行优化。

-

决策树:在每一轮学习中,XGBoost使用决策树算法作为弱学习进行优化。

-

正则化:在优化过程中XGBoost为防止过拟合,在损失函数中加入惩罚项,限制决策树的叶子节点个数以及决策树叶子节点的值。

4 什么是泰勒展开式

泰勒展开越多,计算结果越精确

浙公网安备 33010602011771号

浙公网安备 33010602011771号