06 Spark SQL 及其DataFrame的基本操作

1.Spark SQL出现的 原因是什么?

Spark SQL的前身是 Shark,它运行在Spark系统之上,Shark重用了Hive的工作机制,并直接继承了Hive的各个组件, Shark将SQL语句的转换从MapReduce作业替换成了Spark作业,虽然这样提高了计算效率,但由于 Shark过于依赖Hive,因此在版本迭代时很难添加新的优化策略,从而限制了Spak的发展.SparkSQL产生的根本原因是为了完全脱离Hive限制

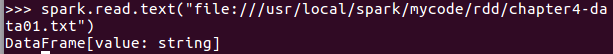

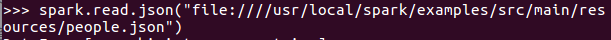

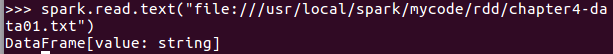

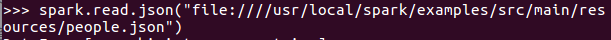

2.用spark.read 创建DataFrame

spark.read.text(file)

spark.read.json(file)

3.观察从不同类型文件创建DataFrame有什么异同?

4.观察Spark的DataFrame与Python pandas的DataFrame有什么异同?

Spark SQL DataFrame的基本操作

spark.read.text()

spark.read.json()

打印数据

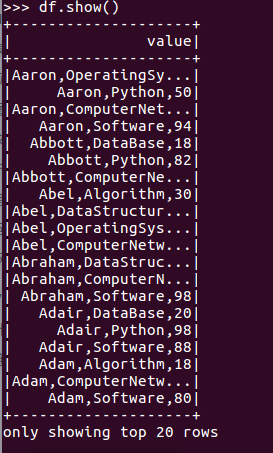

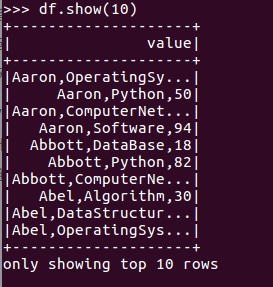

df.show()默认打印前20条数据,df.show(n)

text:

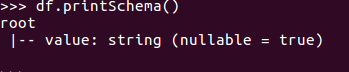

打印概要

df.printSchema()

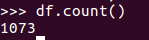

查询总行数

df.count()

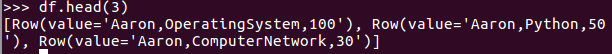

df.head(3) #list类型,list中每个元素是Row类

输出全部行

df.collect() #list类型,list中每个元素是Row类

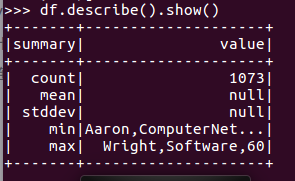

查询概况

df.describe().show()

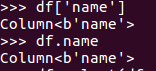

取列

df[‘name’]

df.name

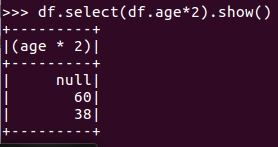

df.select()

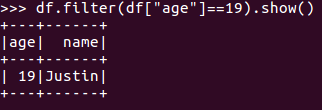

df.filter()

df.groupBy()

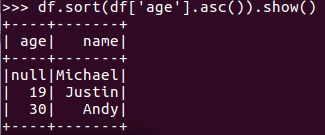

df.sort()

浙公网安备 33010602011771号

浙公网安备 33010602011771号