23.4.23 文献总结——Image Restoration

Image Restoration

CVPR23 DDT: Dual-branch Deformable Transformer for Image Denoising

主要贡献如下:

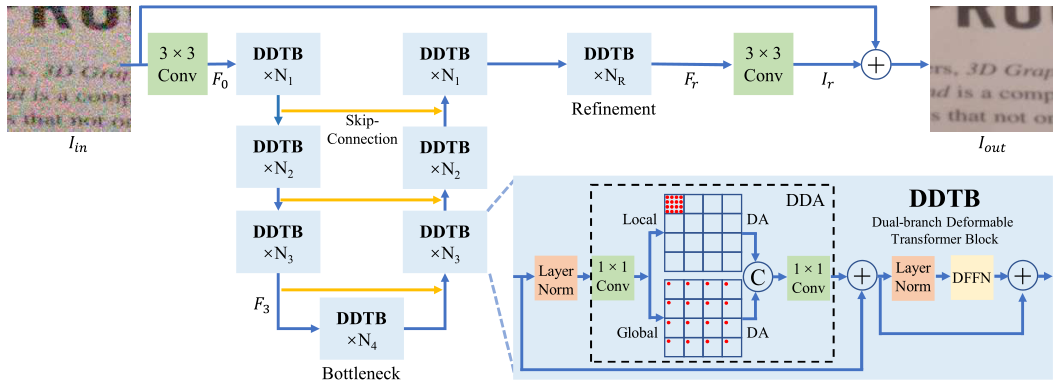

1.提出一个高效的双分支可形变的transformer去噪网络,能够以线性复杂度处理高分辨率的噪声图像。

采用了类似unet的网络结构,如下图所示。在计算注意力图的时候分两路,一路顾及局部的注意力,一路顾及全局的注意力,从而能够以线性复杂度处理高分辨率图像。

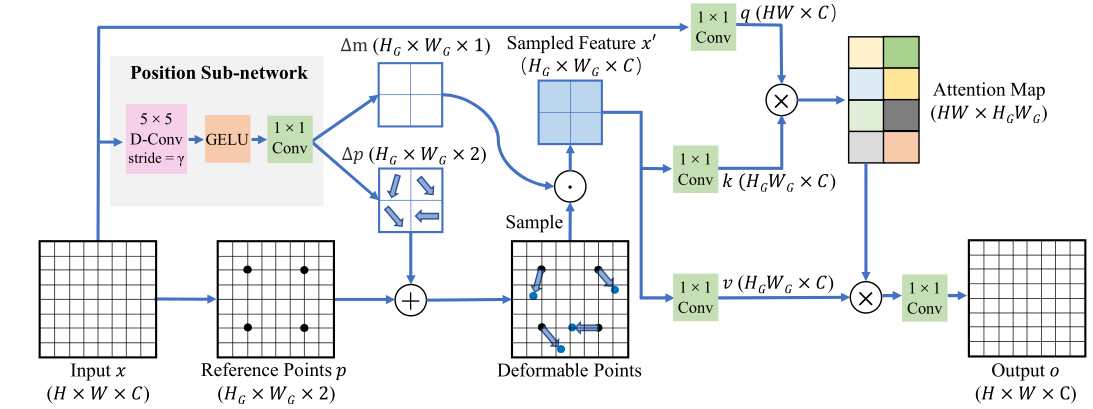

2.引入可形变注意力机制来减少冗余的计算,并且关注具有更有信息的区域。

在计算注意图时使用可形变注意力机制,如下图所示。

3.该方法在计算成本更少的同时获得了比sota方法更好的性能。

CVPR23 Efficient and Explicit Modelling of Image Hierarchies for Image Restoration

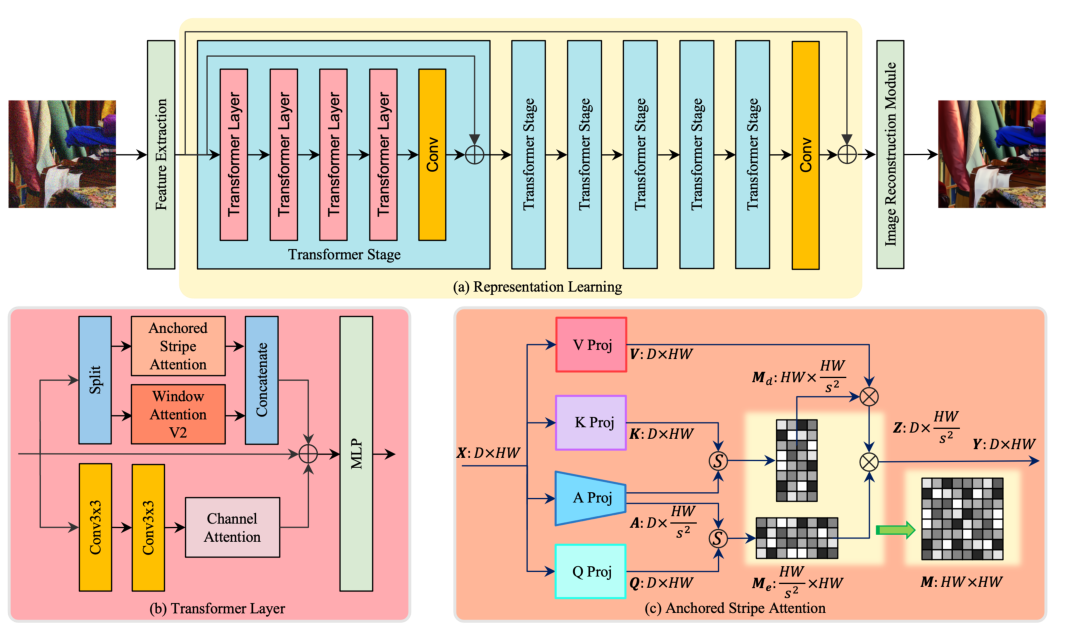

利用了自然图像的两个特性:1.跨尺度相似性;2.各向异性的图像特征,从而提出了anchored stripe attention。

网络结构如下图所示。anchored stripe attention相对于传统的qkv多增加了一个a,q和k先分别与a算相似度。多路不同的注意力机制相加获得最终的注意力图。

CVPR22 Restormer: Efficient Transformer for High-Resolution Image Restoration

主要贡献如下:

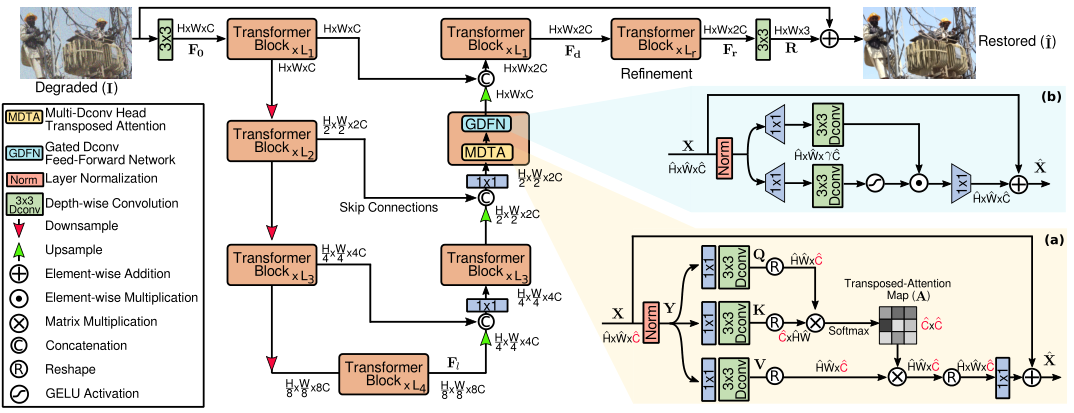

1.提出了可处理高分辨率图像的多尺度局部-全局表示学习的restormer,而不像swin transformer一样使用局部窗口的注意力。

网络结构如下图所示。

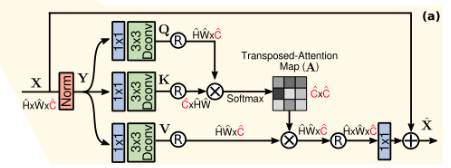

2.提出multi-Dconv head transposed attention(MDTA),能够聚合局部和非局部的信息交互。

先用卷积聚合信息再计算注意力图。

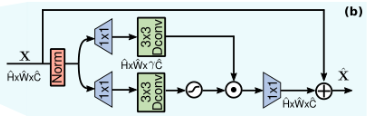

3.提出gated-Dconv feed-forward network (GDFN) ,能够抑制信息较少的特征,只允许有用信息在网络结构中传递。

激活函数作为门控。

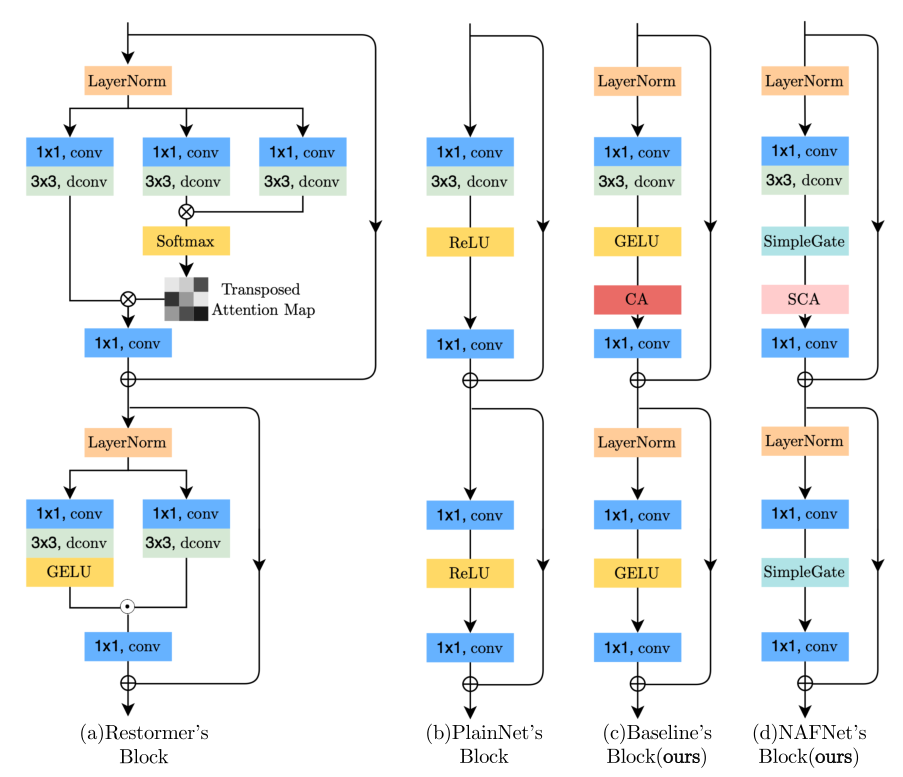

ECCV22 Simple Baselines for Image Restoration

主要贡献如下:

1.在几个图像修复任务上获得了SOTA表现的同时大大减少了系统复杂度。

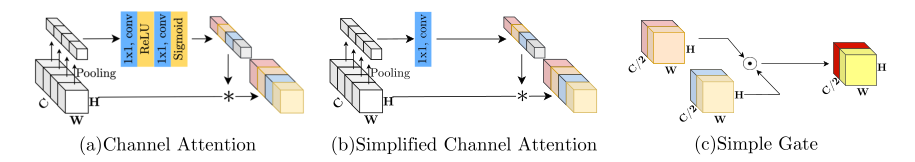

2.基于通道注意力提出了简化的通道注意力。

3.在网络中去掉了所有的非线性激活函数,第一次证明了非线性激活函数对于SOTA的CV模型来说并不是必要的。

浙公网安备 33010602011771号

浙公网安备 33010602011771号