23.4.3 文献总结——杂读

2017 CVPR Enhanced Deep Residual Networks for Single Image Super-Resolution

主要贡献如下:

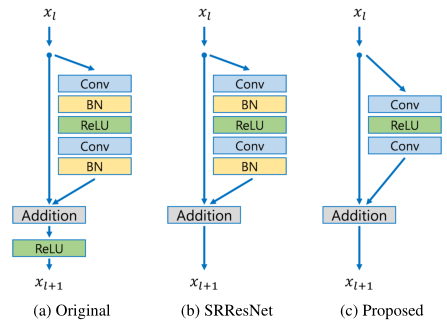

1.针对SR任务,提出了enhanced deep super-resolution network (EDSR),去掉residual block中不必要的模块从而提高性能,只能进行单尺度的SR任务。

从网络中去除了BN,因为BN对feature进行了归一化,从而失去了网络特征的灵活度。

网络结构图如下图所示。

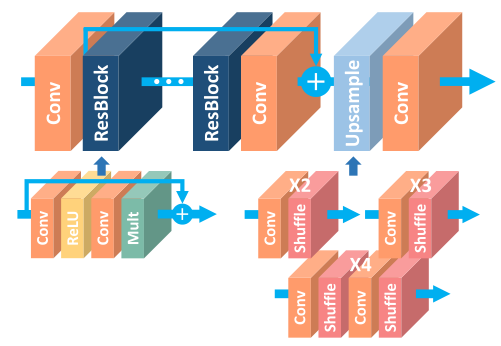

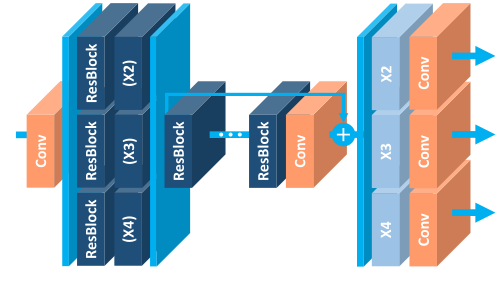

2.提出multi-scale deep super-resolution system (MDSR),可以进行多尺度的SR任务。

网络结构如下图所示。

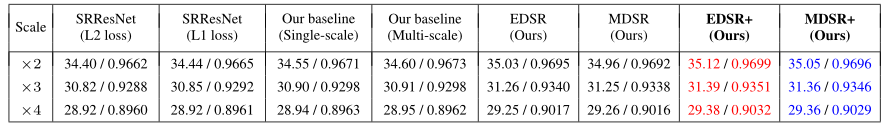

3.提出self-ensemble方法。在推理时对输入图像进行旋转,再分别输入网络,最后对输出进行与输入相反的旋转,再多个输出取平均,获得了性能上的提升。

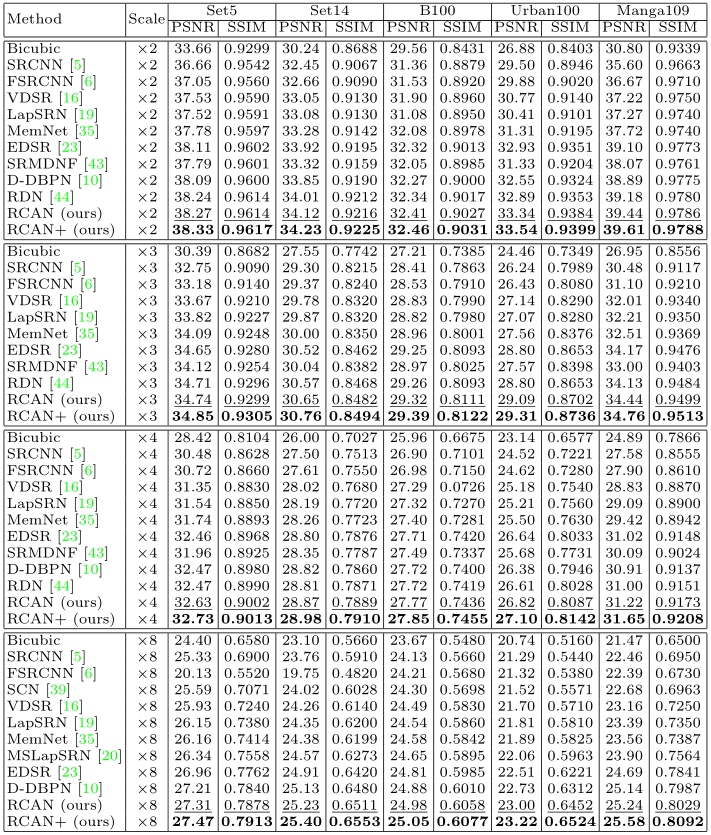

实验结果如下图所示。使用了随机90°旋转和水平翻转的数据增强。后缀为+代表使用了self-ensemble。

2017 CVPR Image Super-Resolution via Deep Recursive Residual Network

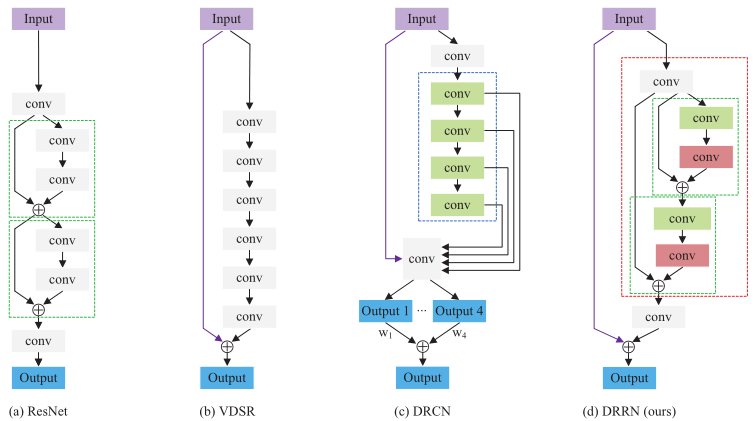

针对SR任务,提出了Deep Recursive Residual Network (DRRN),网络结构如下图(d)所示。

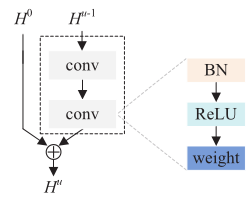

DRRN的残差单元的组成如下图所示。

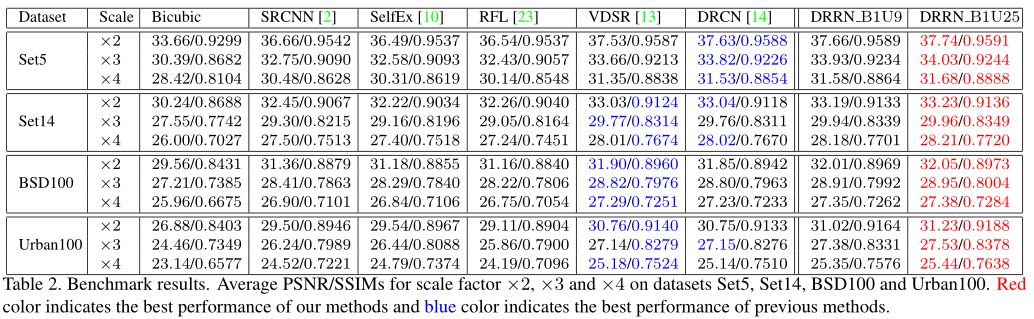

实验结果如下图所示。

2018 ECCV Image Super-Resolution Using Very Deep Residual Channel Attention Networks

主要贡献如下:

1.针对SR任务,提出very deep residual channel attention networks (RCAN)。

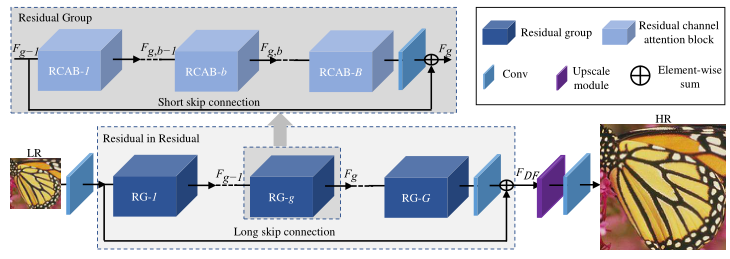

网络结构如下图所示。

2.提出residual in residual (RIR) 结构来构建深度网络。

3.使用通道注意力机制,自适应地调整特征的权重。

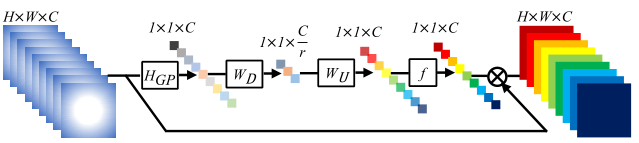

通道注意力的计算过程如下图所示。

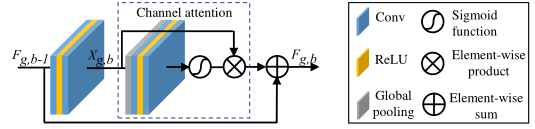

RCAN块如下图所示。

实验结果如下图所示。使用了随机90°,180°,270°旋转和水平翻转的数据增强。

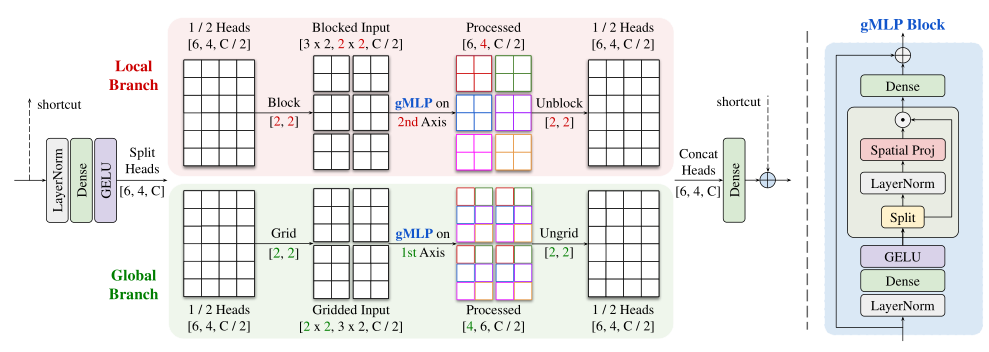

2022 CVPR MAXIM: Multi-Axis MLP for Image Processing

前言:MLP-Mixer采用了简单的混合MLP来代替ViT中的自注意力,形成了一个纯MLP的架构。gMLP在visual tokens中使用了空间门限单元。ResMLP采用了Affine transformation来代替Layer Normalization。FNet和GFNet证明了简单的傅里叶变换就可以作为自注意力或者MLP的有力替代。MAXIM正是基于以上研究。

主要贡献如下:

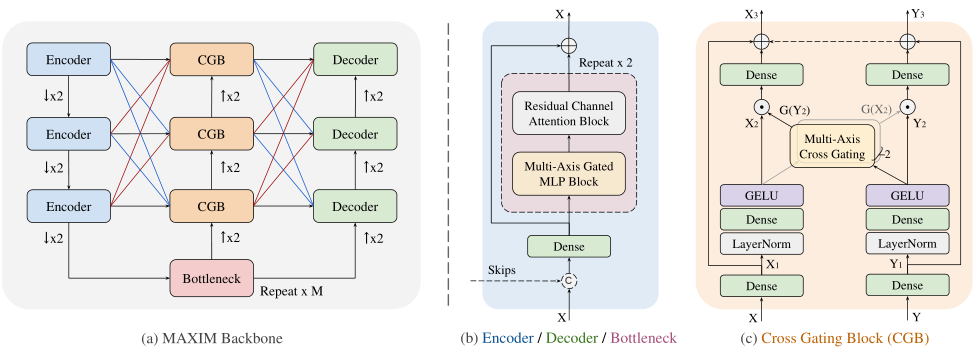

1.针对去噪、去模糊、去雾、去雾和增强等一系列low-level图像处理任务,提出了MAXIM,以编码器和解码器的堆叠为主干。

2.提出了multi-axis gated MLP module,具有全局视野,同时随图像大小的增加,计算复杂度呈线性增加而不是平方增加。

两路MLP,Local Branch在通道维上做MLP,Global Branch在亚像素维做MLP,最后将二者concat。

3.提出了cross gating block。

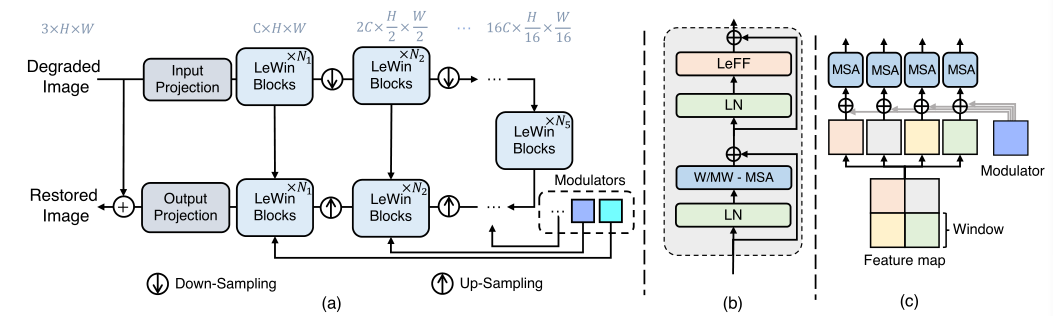

2022 CVPR Uformer: A General U-Shaped Transformer for Image Restoration

针对图像去噪,运动去模糊,离焦去模糊和去伪等一系列任务,提出了Uformer。网络结构如下图所示。

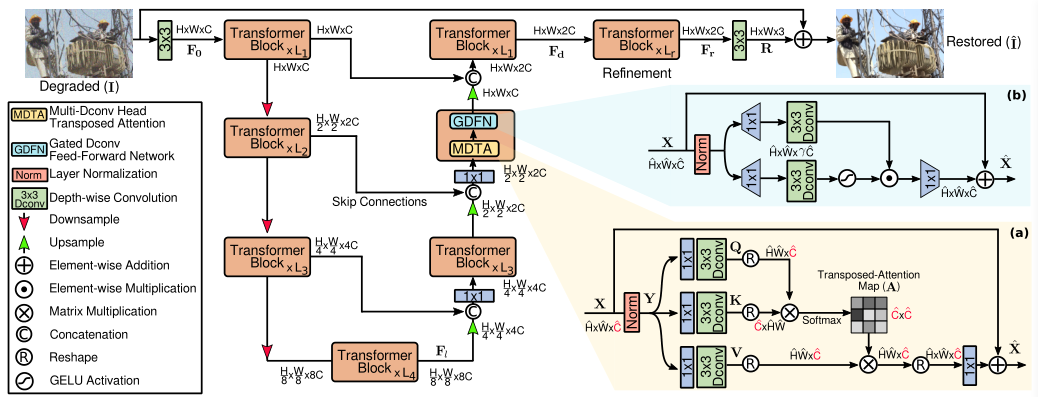

2022 CVPR Restormer: Efficient Transformer for High-Resolution Image Restoration

针对图像去雨、单幅图像运动去模糊、散焦去模糊(单幅图像和双像素数据)和图像去噪(高斯灰度/颜色去噪和真实图像去噪),提出了Restormer。

浙公网安备 33010602011771号

浙公网安备 33010602011771号