ES原理:集群读写

Lucene:一个开源的搜索库

Engine:屏蔽 Lucene 操作细节的抽象层

Http:对外提供 restful api,让不同开发语言的应用都可以接入

空节点

现在我们屏蔽 Elasticsearch 的底层实现,其实一个 Elasticsearch 实例对于我们来说,就是一个节点,一个可以提供数据搜索和探寻能力的节点:

加点东西

Mysql 往数据库插入数据之前,需要先创建表,指定字段、主键等等,Elasticsearch 也需要创建“表”。

在 Elasticsearch 的领域语言里,「表」被称为「索引」,「行数据」被称为「文档」。

现在我们往节点里面定义一个「索引」blog:

PUT /blogs

{

"settings" : {

"number_of_shards" : 3,

"number_of_replicas" : 1

}

}

你会发现,和 Mysql 不同,我们并没有定义这个“表”里有什么字段,这就是 nosql 的好处,你可以在之后插入的文档里,随时给这个“表”添加新的字段。

我们定义的是两个配置:

number_of_shards:主分片数。

shards,分片,分片有「主分片」和「副本分片」,这里指的是「主分片」,默认是 5 个主分片,这里指定为 3,即 blog 索引的数据,会被分散到 3 个分片里面,

起到控制每个分片里文档数量个数的作用,提供查询和搜索效率,可以理解为 Mysql 里的分表。

number_of_replicas:副本分片数。

replicas,副本,也就是上面说的「副本分片」。

副本分片只是一个主分片的拷贝,作为硬件故障时保护数据不丢失的冗余备份,并为搜索和返回文档等读操作提供服务。

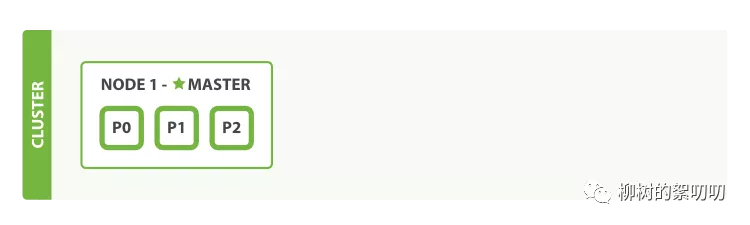

现在我们的节点,不再是空空如也,而是这样:

P0、P1、P2 就是 blog 索引的 3 个主分片。

为什么没有副本分片?

因为对于单节点的架构来说,进行冗余备份就毫无意义的,只会浪费内存和磁盘。

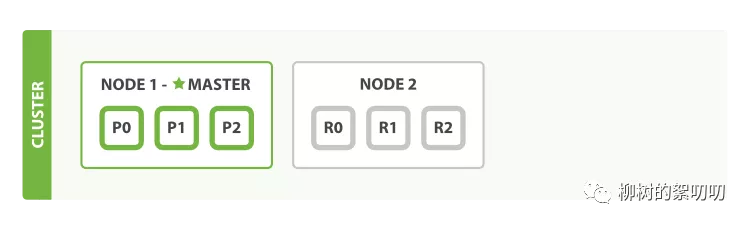

再加个节点

现在我们往集群里添加第二个节点,很简单,只要它和第一个节点有同样的 cluster.name 配置,它就会自动发现集群并加入到其中:

原先被雪藏起来的三个副本分片,现在都在这个新增的节点上,被激活了。

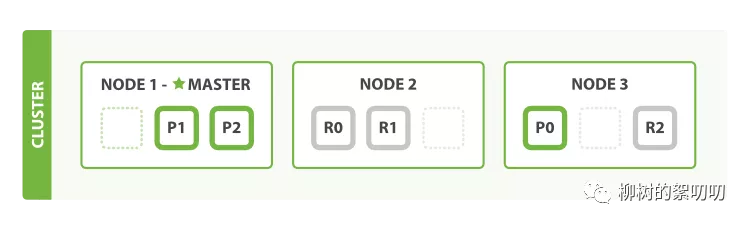

水平扩容

这套架构,用着用着,我们发现两个节点的 CPU 、RAM 等硬件资源都十分紧张,随时可能奔溃,怎么办?

没有什么是加一套机器不能解决的,如果有,那就加两套:

甚至你还能把副本分片的数量调整到 2:

在我们加了一个节点进去后,Elasticsearch 集群自动的帮我们重新平均分布所有的数据。

Elasticsearch 前面的这个 elastic,果然名不虚传。

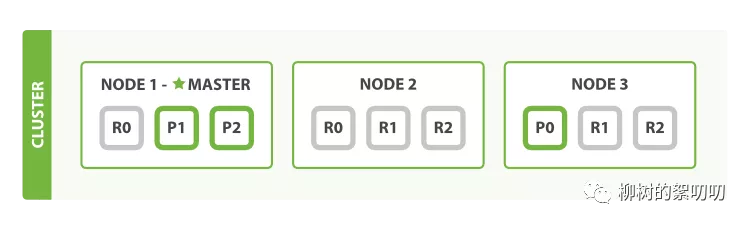

故障处理

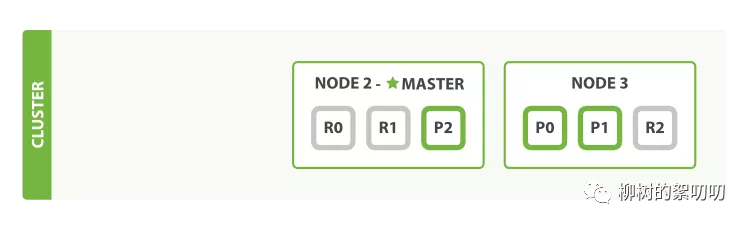

这套架构是高可靠的,假设 Master 节点 Node1 突然奔溃了,这时候集群会选举出一个新的节点。

这还不够,我们失去 Node 的同时,也失去了原来 Node 1 上的两个主分片,P1 和 P2,幸运的是,Node 2 和 Node 3 上有对应的副本分片,集群会把对应的副本分片提升为主分片:

通过自己封装的 Engine 层,屏蔽了 Lucene 的底层复杂的操作;

什么是Elasticsearch?

Elasticsearch is a real-time, distributed storage, search, and analytics engine

Elasticsearch 是一个实时的分布式存储、搜索、分析的引擎。

介绍那儿有几个关键字:

- 实时

- 分布式

- 搜索

- 分析

为什么要用Elasticsearch

为什么要使用Elasticsearch呢?我们在日常开发中,数据库也能做到(实时、存储、搜索、分析)。

相对于数据库,Elasticsearch的强大之处就是可以模糊查询

有的同学可能就会说:我数据库怎么就不能模糊查询了??我反手就给你写一个SQL:

select * from user where name like '%公众号Java3y%'

的确,这样做的确可以。但是要明白的是:name like %Java3y%这类的查询是不走索引的,不走索引意味着:只要你的数据库的量很大(1亿条),你的查询肯定会是秒级别的

而且,即便给你从数据库根据模糊匹配查出相应的记录了,那往往会返回大量的数据给你,往往你需要的数据量并没有这么多,可能50条记录就足够了。

还有一个就是:用户输入的内容往往并没有这么的精确,比如我从Google输入ElastcSeach(打错字),但是Google还是能估算我想输入的是Elasticsearch

而Elasticsearch是专门做搜索的,就是为了解决上面所讲的问题而生的,换句话说:

Elasticsearch对模糊搜索非常擅长(搜索速度很快)

从Elasticsearch搜索到的数据可以根据评分过滤掉大部分的,只要返回评分高的给用户就好了(原生就支持排序)

没有那么准确的关键字也能搜出相关的结果(能匹配有相关性的记录)

Elasticsearch的数据结构

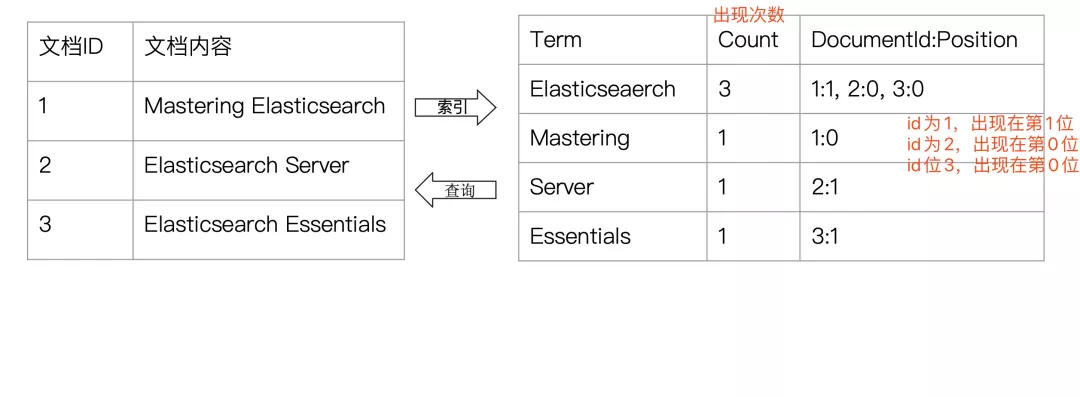

我们根据“完整的条件”查找一条记录叫做正向索引;我们一本书的章节目录就是正向索引,通过章节名称就找到对应的页码。

首先我们得知道为什么Elasticsearch为什么可以实现快速的“模糊匹配”/“相关性查询”,实际上是你写入数据到Elasticsearch的时候会进行分词。

众所周知,世界上有这么多的语言,那Elasticsearch怎么切分这些词呢?,Elasticsearch内置了一些分词器

- Standard Analyzer 。按词切分,将词小写

- Simple Analyzer。按非字母过滤(符号被过滤掉),将词小写

- WhitespaceAnalyzer。按照空格切分,不转小写

….等等等

Elasticsearch分词器主要由三部分组成:

Character Filters(文本过滤器,去除HTML)

Tokenizer(按照规则切分,比如空格)

TokenFilter(将切分后的词进行处理,比如转成小写)

显然,Elasticsearch是老外写的,内置的分词器都是英文类的,而我们用户搜索的时候往往搜的是中文,现在中文分词器用得最多的就是IK。

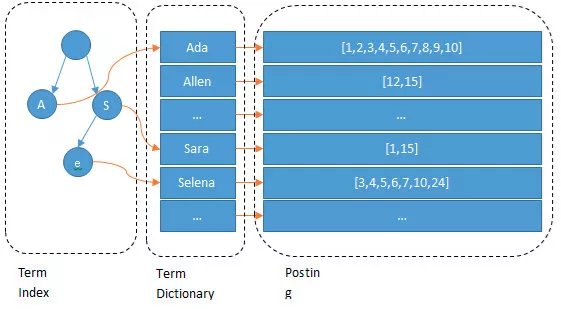

扯了一大堆,那Elasticsearch的数据结构是怎么样的呢?看下面的图:

我们输入一段文字,Elasticsearch会根据分词器对我们的那段文字进行分词(也就是图上所看到的Ada/Allen/Sara..),这些分词汇总起来我们叫做Term Dictionary,

而我们需要通过分词找到对应的记录,这些文档ID保存在PostingList

在Term Dictionary中的词由于是非常非常多的,所以我们会为其进行排序,等要查找的时候就可以通过二分来查,不需要遍历整个Term Dictionary

由于Term Dictionary的词实在太多了,不可能把Term Dictionary所有的词都放在内存中,

于是Elasticsearch还抽了一层叫做Term Index,这层只存储 部分 词的前缀,Term Index会存在内存中(检索会特别快)

Term Index在内存中是以FST(Finite State Transducers)的形式保存的,其特点是非常节省内存。FST有两个优点:

1)空间占用小。通过对词典中单词前缀和后缀的重复利用,压缩了存储空间;

2)查询速度快。O(len(str))的查询时间复杂度。

前面讲到了Term Index是存储在内存中的,且Elasticsearch用FST(Finite State Transducers)的形式保存(节省内存空间)。

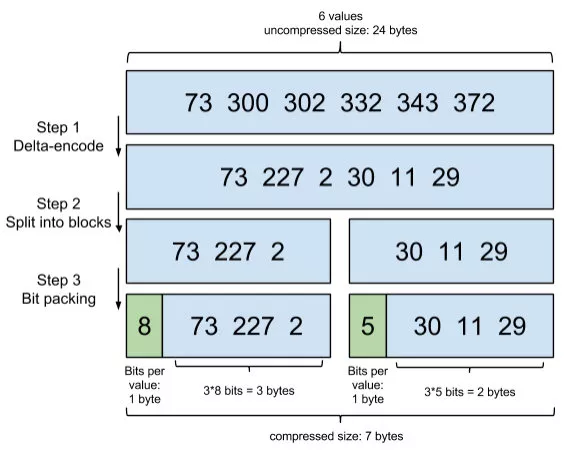

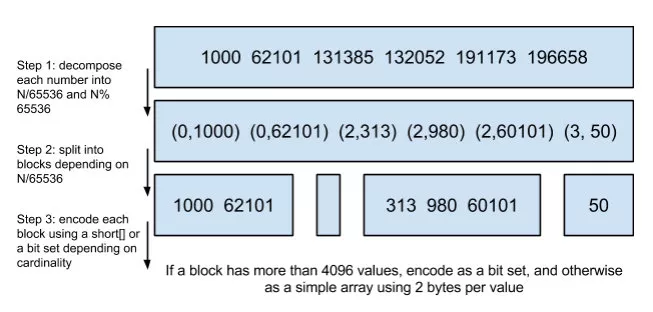

Term Dictionary在Elasticsearch也是为他进行排序(查找的时候方便),其实PostingList也有对应的优化。

PostingList会使用Frame Of Reference(FOR)编码技术对里边的数据进行压缩,节约磁盘空间。

PostingList里边存的是文档ID,我们查的时候往往需要对这些文档ID做交集和并集的操作(比如在多条件查询时),PostingList使用Roaring Bitmaps来对文档ID进行交并集操作。

使用Roaring Bitmaps的好处就是可以节省空间和快速得出交并集的结果。

所以到这里我们总结一下Elasticsearch的数据结构有什么特点

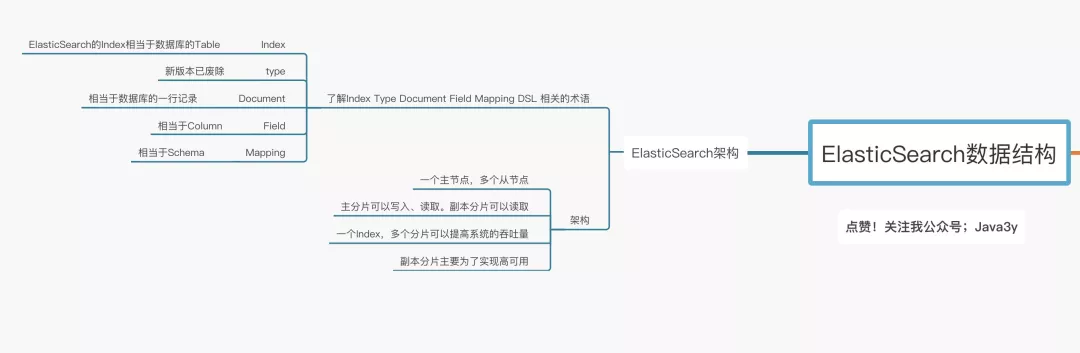

Elasticsearch的术语和架构

从官网的介绍我们已经知道Elasticsearch是分布式存储的,如果看过我的文章的同学,对分布式这个概念应该不陌生了。

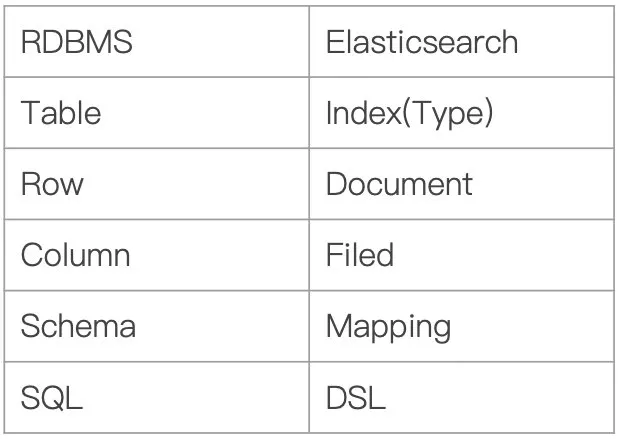

在讲解Elasticsearch的架构之前,首先我们得了解一下Elasticsearch的一些常见术语。

Index:Elasticsearch的Index相当于数据库的Table

Type:这个在新的Elasticsearch版本已经废除(在以前的Elasticsearch版本,一个Index下支持多个Type--有点类似于消息队列一个topic下多个group的概念)

Document:Document相当于数据库的一行记录

Field:相当于数据库的Column的概念

Mapping:相当于数据库的Schema的概念

DSL:相当于数据库的SQL(给我们读取Elasticsearch数据的API)

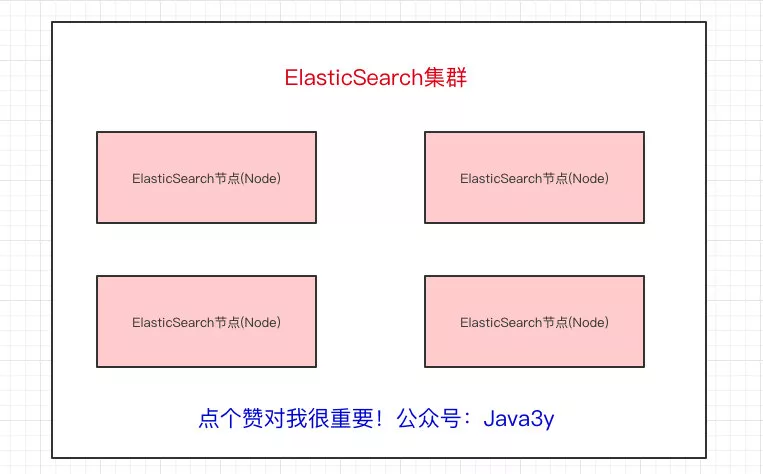

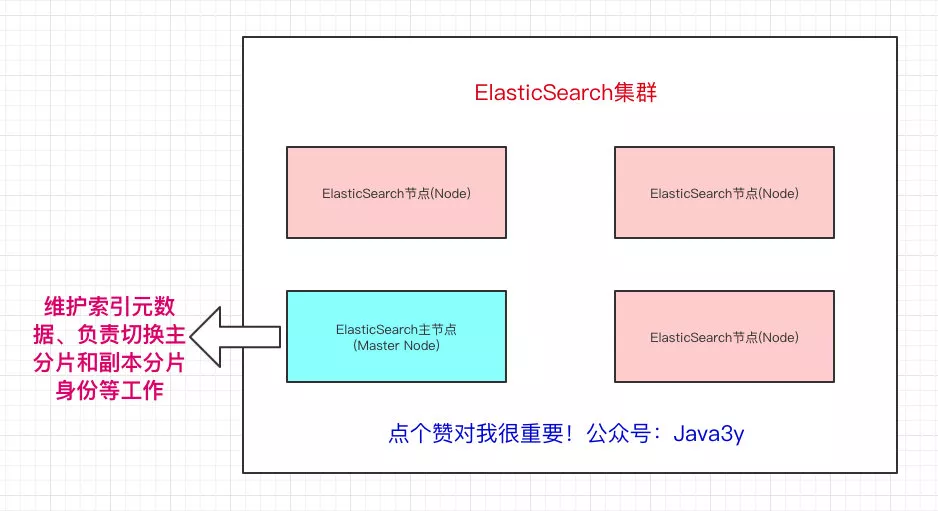

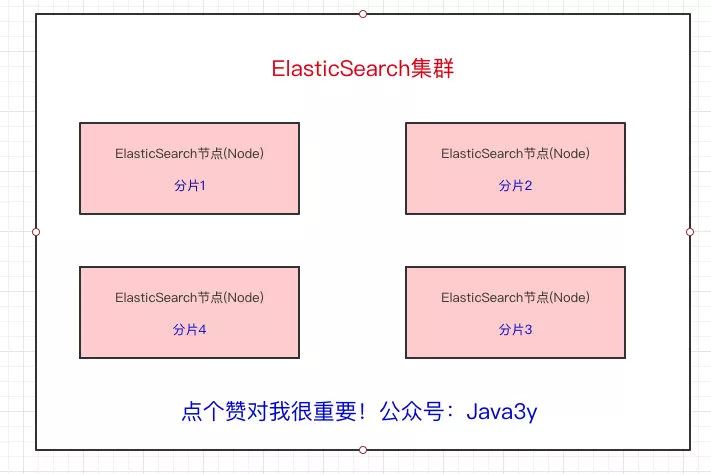

一个Elasticsearch集群会有多个Elasticsearch节点,所谓节点实际上就是运行着Elasticsearch进程的机器。

在众多的节点中,其中会有一个Master Node,它主要负责维护索引元数据、负责切换主分片和副本分片身份等工作(后面会讲到分片的概念),

如果主节点挂了,会选举出一个新的主节点。

从上面我们也已经得知,Elasticsearch最外层的是Index(相当于数据库 表的概念);一个Index的数据我们可以分发到不同的Node上进行存储,这个操作就叫做分片。

比如现在我集群里边有4个节点,我现在有一个Index,想将这个Index在4个节点上存储,那我们可以设置为4个分片。这4个分片的数据合起来就是Index的数据

为什么要分片?原因也很简单:

如果一个Index的数据量太大,只有一个分片,那只会在一个节点上存储,随着数据量的增长,一个节点未必能把一个Index存储下来。

多个分片,在写入或查询的时候就可以并行操作(从各个节点中读写数据,提高吞吐量)

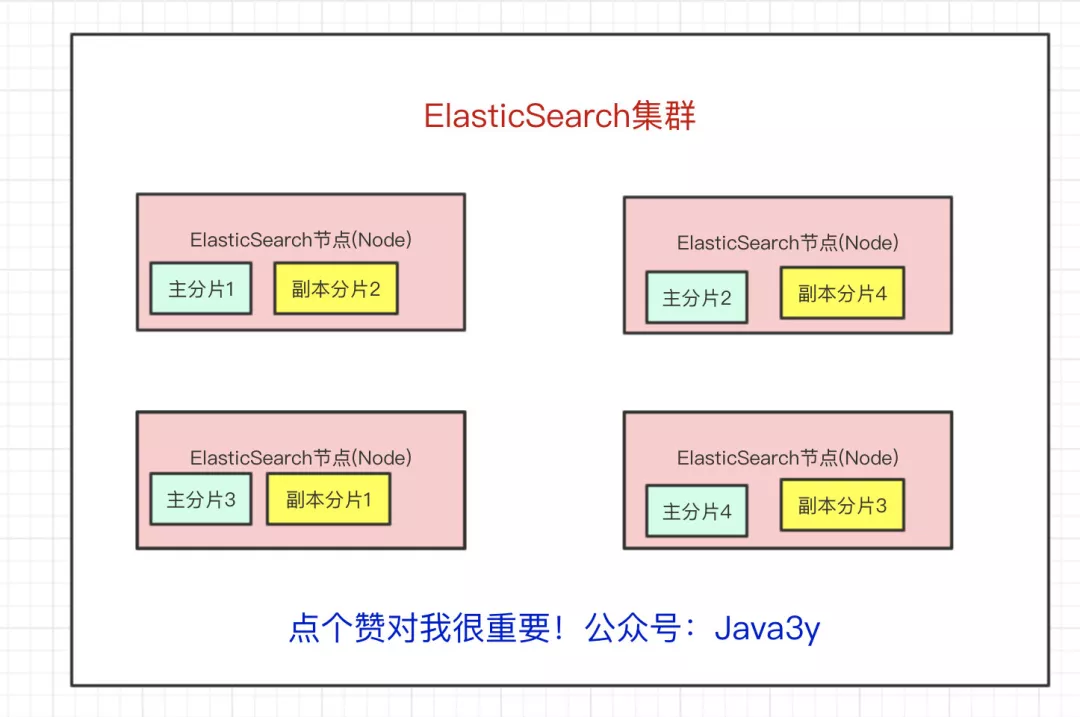

现在问题来了,如果某个节点挂了,那部分数据就丢了吗?显然Elasticsearch也会想到这个问题,所以分片会有主分片和副本分片之分(为了实现高可用)

数据写入的时候是写到主分片,副本分片会复制主分片的数据,读取的时候主分片和副本分片都可以读。

Index需要分为多少个主分片和副本分片都是可以通过配置设置的

如果某个节点挂了,前面所提高的Master Node就会把对应的副本分片提拔为主分片,这样即便节点挂了,数据就不会丢。

到这里我们可以简单总结一下Elasticsearch的架构了:

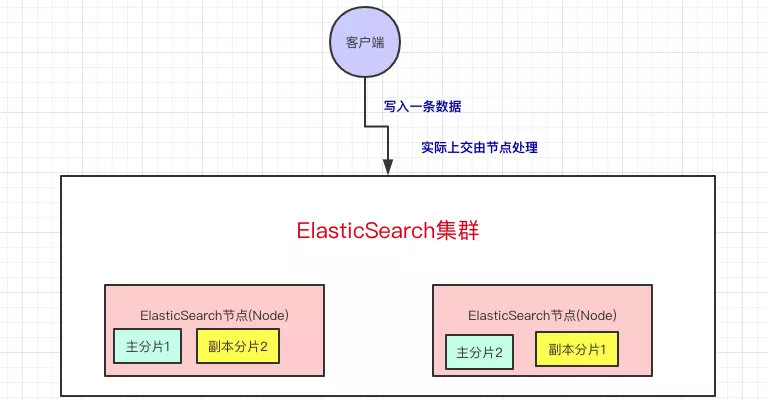

Elasticsearch 写入的流程

上面我们已经知道当我们向Elasticsearch写入数据的时候,是写到主分片上的,我们可以了解更多的细节。

客户端写入一条数据,到Elasticsearch集群里边就是由节点来处理这次请求:

集群上的每个节点都是coordinating node(协调节点),协调节点表明这个节点可以做路由。比如节点1接收到了请求,但发现这个请求的数据应该是由节点2处理(因为主分片在节点2上),所以会把请求转发到节点2上。

coodinate(协调)节点通过hash算法可以计算出是在哪个主分片上,然后路由到对应的节点

shard = hash(document_id) % (num_of_primary_shards)

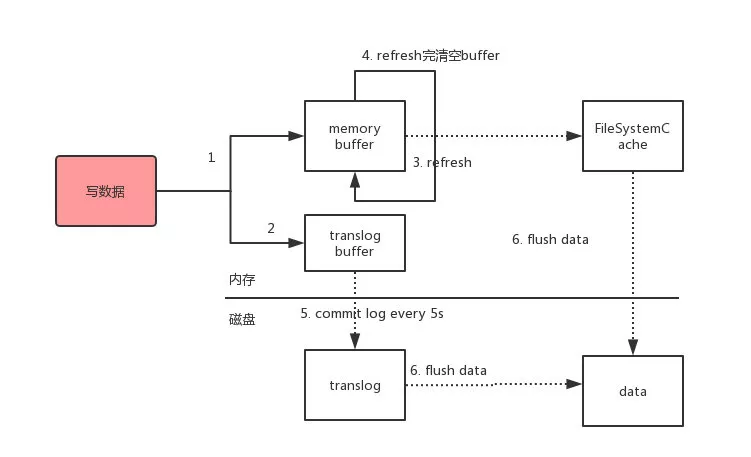

路由到对应的节点以及对应的主分片时,会做以下的事:

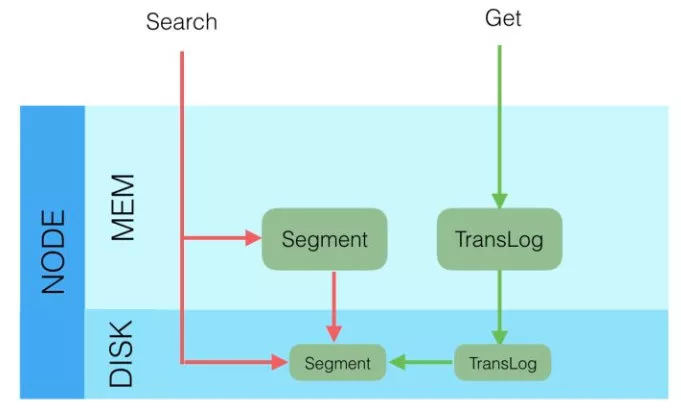

将数据写到内存缓存区

然后将数据写到translog缓存区

每隔1s数据从buffer中refresh到FileSystemCache中,生成segment文件,一旦生成segment文件,就能通过索引查询到了

refresh完,memory buffer就清空了。

每隔5s中,translog 从buffer flush到磁盘中

定期/定量从FileSystemCache中,结合translog内容flush index到磁盘中。

解释一下:

Elasticsearch会把数据先写入内存缓冲区,然后每隔1s刷新到文件系统缓存区(当数据被刷新到文件系统缓冲区以后,数据才可以被检索到)。

所以:Elasticsearch写入的数据需要1s才能查询到

为了防止节点宕机,内存中的数据丢失,Elasticsearch会另写一份数据到日志文件上,但最开始的还是写到内存缓冲区,每隔5s才会将缓冲区的刷到磁盘中。

所以:Elasticsearch某个节点如果挂了,可能会造成有5s的数据丢失。

等到磁盘上的translog文件大到一定程度或者超过了30分钟,会触发commit操作,将内存中的segement文件异步刷到磁盘中,完成持久化操作。

说白了就是:写内存缓冲区(定时去生成segement,生成translog),能够让数据能被索引、被持久化。最后通过commit完成一次的持久化。

等主分片写完了以后,会将数据并行发送到副本集节点上,等到所有的节点写入成功就返回ack给协调节点,协调节点返回ack给客户端,完成一次的写入。

Elasticsearch更新和删除

Elasticsearch的更新和删除操作流程:

给对应的doc记录打上.del标识,如果是删除操作就打上delete状态,如果是更新操作就把原来的doc标志为delete,然后重新新写入一条数据

前面提到了,每隔1s会生成一个segement 文件,那segement文件会越来越多越来越多。

Elasticsearch会有一个merge任务,会将多个segement文件合并成一个segement文件。

在合并的过程中,会把带有delete状态的doc给物理删除掉。

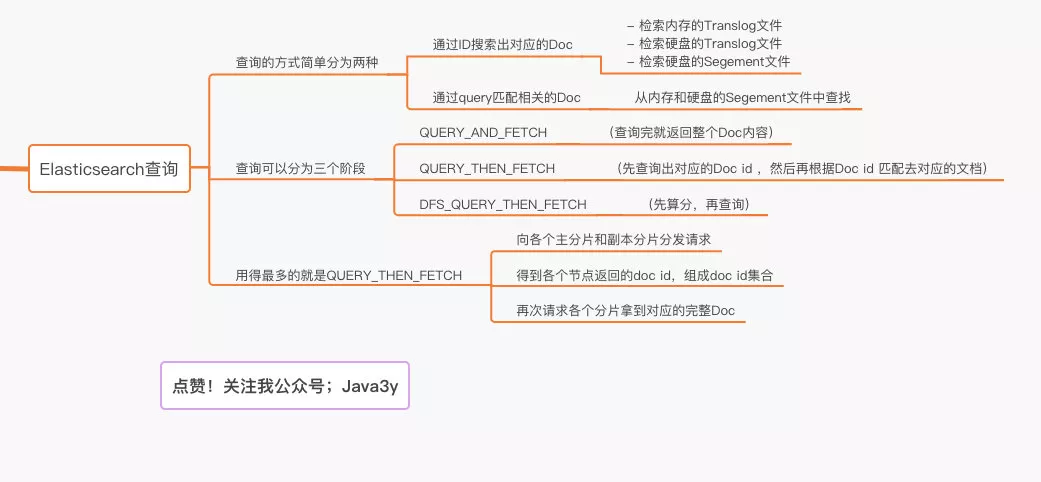

Elasticsearch查询

查询我们最简单的方式可以分为两种:

根据ID查询doc

根据query(搜索词)去查询匹配的doc

public TopDocs search(Query query, int n);

public Document doc(int docID);

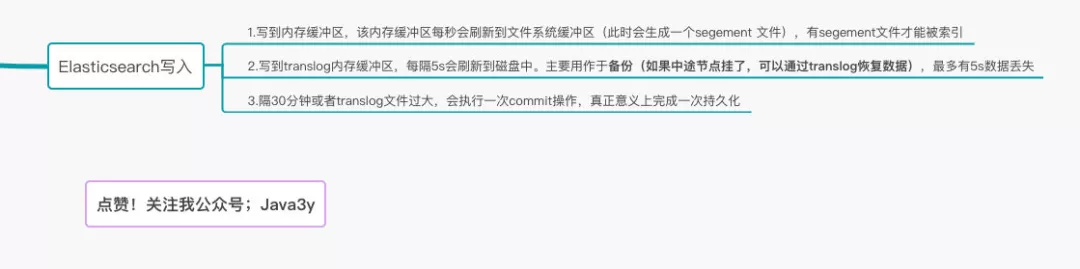

根据ID去查询具体的doc的流程是:

检索内存的Translog文件

检索硬盘的Translog文件

检索硬盘的Segement文件

根据query去匹配doc的流程是:

同时去查询内存和硬盘的Segement文件

从上面所讲的写入流程,我们就可以知道:Get(通过ID去查Doc是实时的),Query(通过query去匹配Doc是近实时的)

因为segement文件是每隔一秒才生成一次的

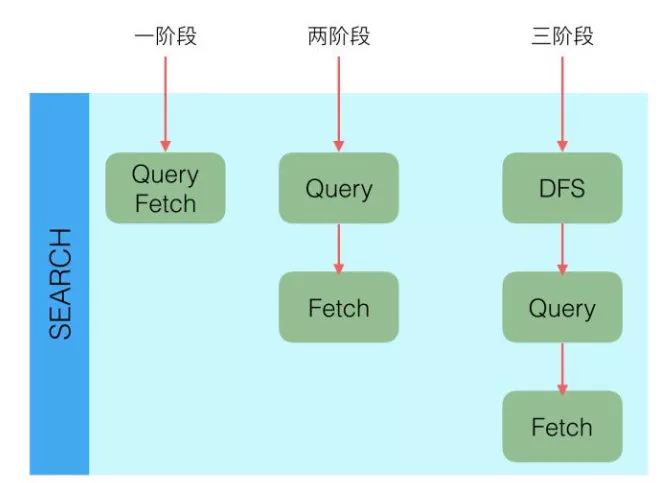

Elasticsearch查询又分可以为三个阶段:

QUERY_AND_FETCH(查询完就返回整个Doc内容)

QUERY_THEN_FETCH(先查询出对应的Doc id ,然后再根据Doc id 匹配去对应的文档)

DFS_QUERY_THEN_FETCH(先算分,再查询)

「这里的分指的是 词频率和文档的频率(Term Frequency、Document Frequency)众所周知,出现频率越高,相关性就更强」

一般我们用得最多的就是QUERY_THEN_FETCH,第一种查询完就返回整个Doc内容(QUERY_AND_FETCH)只适合于只需要查一个分片的请求。

QUERY_THEN_FETCH总体的流程流程大概是:

客户端请求发送到集群的某个节点上。集群上的每个节点都是coordinate node(协调节点)

然后协调节点将搜索的请求转发到所有分片上(主分片和副本分片都行)

每个分片将自己搜索出的结果(doc id)返回给协调节点,由协调节点进行数据的合并、排序、分页等操作,产出最终结果。

接着由协调节点根据 doc id 去各个节点上拉取实际的 document 数据,最终返回给客户端。

Query Phase阶段时节点做的事:

协调节点向目标分片发送查询的命令(转发请求到主分片或者副本分片上)

数据节点(在每个分片内做过滤、排序等等操作),返回doc id给协调节点

Fetch Phase阶段时节点做的是:

协调节点得到数据节点返回的doc id,对这些doc id做聚合,然后将目标数据分片发送抓取命令(希望拿到整个Doc记录)

数据节点按协调节点发送的doc id,拉取实际需要的数据返回给协调节点

主流程我相信大家也不会太难理解,说白了就是:由于Elasticsearch是分布式的,所以需要从各个节点都拉取对应的数据,然后最终统一合成给客户端

只是Elasticsearch把这些活都干了,我们在使用的时候无感知而已。

参考:

浙公网安备 33010602011771号

浙公网安备 33010602011771号