Google AI All In One

Google AI All In One

Making AI helpful for everyone

Gemma

Gemma 是谷歌开发的

一系列轻量级、先进的开放模型。以下是关于 Gemma 大模型的一些关键信息:

- Gemma 模型系列:

Gemma 系列包括不同大小的模型,旨在满足各种计算需求。

Gemma 2B,Gemma 7B,Gemma 27B 是 Gemma系列模型里的一部分。

Gemma 系列还包括专门的模型和研究模型,例如 CodeGemma 和 PaliGemma,它们针对特定任务进行了优化。

Gemma 模型有预训练(PT)和指令调整(IT)的变体。指令调整后的模型特别擅长遵循人类指令。

- Gemma 3模型概况:

Gemma 3 模型有4种参数大小,5种精度级别,从32位全精度到4位最低精度。

Gemma 3 1B,Gemma 3 4B,Gemma 3 12B,Gemma 3 27B,是 Gemma 3系列模型里不同参数大小的模型。

不同的大小和精度代表了AI应用的一组权衡。

参数和位数(精度)越高,模型的功能通常越强大,但在处理周期、内存开销和功耗方面,运行成本也越高。

参数和位数较少(精度较低)的模型功能较弱,但可能足以胜任您的AI任务。

- Gemma 的特点和优势:

开放性: Gemma 模型是开放的,允许开发者和研究人员自由使用和修改。

轻量级: 这些模型设计得相对较小,使其能够在各种硬件上运行,包括笔记本电脑和移动设备。

高性能: 尽管体积小,Gemma 模型在各种基准测试中都表现出了强大的性能。

多功能性: Gemma 模型可以用于各种自然语言处理任务,例如文本生成、问答和代码生成。

- Gemma 的应用:

Gemma 模型可以用于构建各种AI应用程序,包括聊天机器人、虚拟助手和内容生成工具。

它们还可以用于研究目的,例如探索新的自然语言处理技术。

如果您想深入了解 Gemma 模型,可以访问 Google AI for Developers 网站,那里提供了详细的文档和教程。

Gemma 模型概览

Gemma 是一系列先进的轻量级开放模型, 研发创新型企业所用的研究和技术,Gemini模型。

Gemma 由 Google DeepMind 和其他 Google 团队开发,其名字以 拉丁语 gemma,意思是宝石。

Gemma 模型的权重 通过用于促进创新、协作和 负责任地使用人工智能 (AI)。

Gemma 模型可以在 以及你的硬件、移动设备或托管服务中。您 也可以使用调优方法自定义这些模型, 执行对您和您的用户至关重要的特定任务。

Gemma 模型绘画 从 Gemini 系列模型中汲取的灵感和技术沿袭,

预训练模型和指令调优模型

您可以通过额外训练来修改 Gemma 模型的行为 使模型在特定任务中表现更好。此过程称为 调优,虽然这种方法可以提高模型执行 但它还会导致模型在其他任务中表现变差。对于 因此,Gemma 模型既可用于指令微调, 预训练模型:

指令微调 (IT) - 这些版本的模型使用 能够对对话输入做出响应, 聊天机器人。

预训练 (PT) - 这些版本的模型不会使用任何模型 Gemma 核心数据训练集之外的特定任务或说明。您 如果不执行某些任务,则不应在应用中部署这些模型 调整。

https://ai.google.dev/gemma/docs?hl=zh-cn

Gemma 模型列表

下表列出了 Gemma 模型系列的主要变体及其预期部署平台:

https://ai.google.dev/gemma/docs/get_started

https://ai.google.dev/gemma/docs/get_started?hl=zh-cn 中文翻译是一坨屎呀!

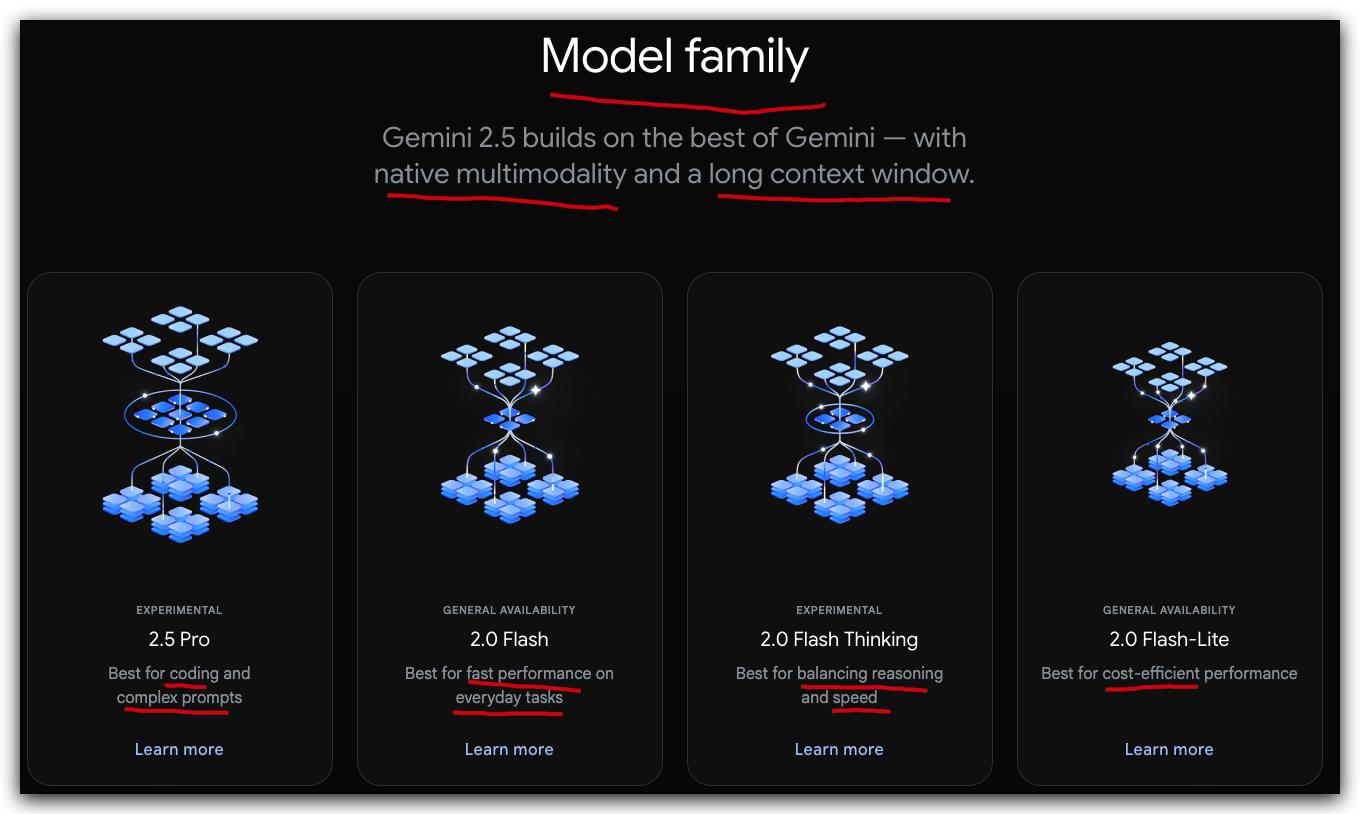

Gemini

https://deepmind.google/technologies/gemini/

Try in Google AI Studio

https://aistudio.google.com/prompts/new_chat

https://aistudio.google.com/prompts/new_chat?model=gemini-2.5-pro-exp-03-25

Gemini Developer API

from google import genai

client = genai.Client(api_key="YOUR_API_KEY")

response = client.models.generate_content(

model="gemini-2.0-flash",

contents="Explain how AI works",

)

print(response.text)

https://ai.google.dev/gemini-api/docs?hl=zh-cn#python

import { GoogleGenAI } from "@google/genai";

const ai = new GoogleGenAI({ apiKey: "YOUR_API_KEY" });

async function main() {

const response = await ai.models.generateContent({

model: "gemini-2.0-flash",

contents: "Explain how AI works",

});

console.log(response.text);

}

await main();

https://ai.google.dev/gemini-api/docs?hl=zh-cn#node.js

demos

(🐞 反爬虫测试!打击盗版⚠️)如果你看到这个信息, 说明这是一篇剽窃的文章,请访问 https://www.cnblogs.com/xgqfrms/ 查看原创文章!

Google Developers

https://developers.google.com/?hl=zh-cn

refs

©xgqfrms 2012-2021

www.cnblogs.com/xgqfrms 发布文章使用:只允许注册用户才可以访问!

原创文章,版权所有©️xgqfrms, 禁止转载 🈲️,侵权必究⚠️!

本文首发于博客园,作者:xgqfrms,原文链接:https://www.cnblogs.com/xgqfrms/p/18792972

未经授权禁止转载,违者必究!

浙公网安备 33010602011771号

浙公网安备 33010602011771号