阿里云,这次杀疯了,断档第一

微信视频号:sph0RgSyDYV47z6

快手号:4874645212

抖音号:dy0so323fq2w

小红书号:95619019828

B站1:UID:3546863642871878

B站2:UID: 3546955410049087

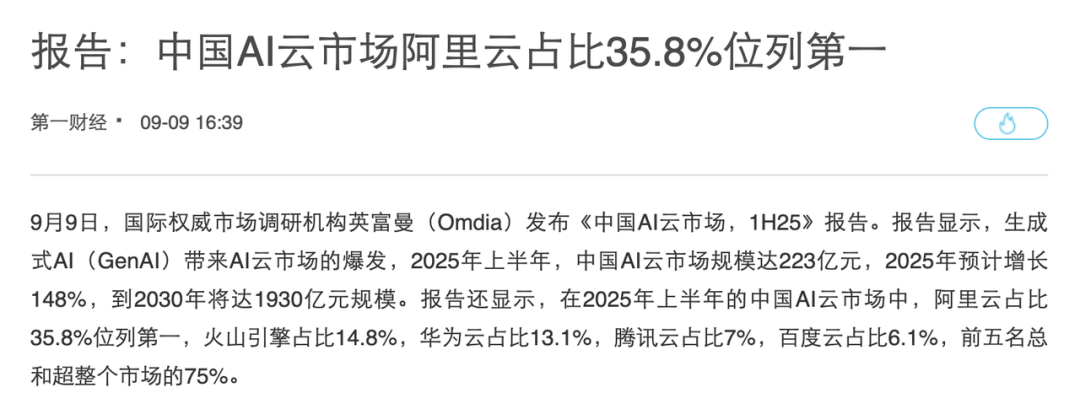

上班路上刷朋友圈,看到有人转了一篇文章,标题很直接:

阿里云拿下中国 AI 云市场第一。

说实话,这对我并不意外,毕竟阿里云这些年一直是国内的头部玩家。

但点进去细看,我一下子愣住了,没想到啊:

阿里云在 AI 云市场上,已经断层式领先,份额比第二名到第四名加起来还多

添加图片注释,不超过 140 字(可选)

转头又想,这个报告权威吗?不会是野鸡报告吧?我赶紧用 ChatGPT 深度研究了下。

添加图片注释,不超过 140 字(可选)

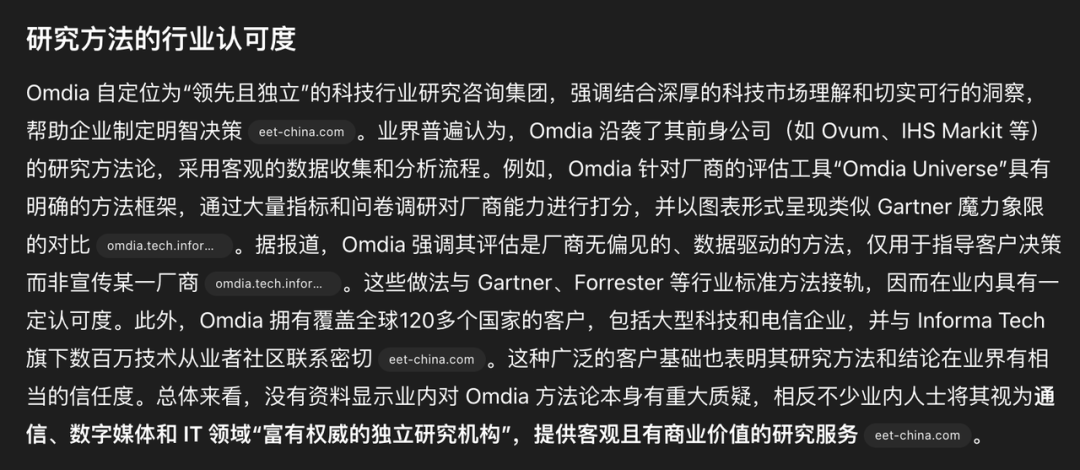

下面是 GPT 给我返回的结果截图——这下放心了,Omdia 的研究方法还是比较客观。

添加图片注释,不超过 140 字(可选)

所以今天就写写这事。

为什么是 AI 云?

不知道你有没有注意到,这份报告里的口径是 AI 云,而不是大家更熟悉的云计算。

其实这只是技术重点在变,正如前几年行业都在讲云原生一样。我从自己的角度,简单捋一下这十多年的演进。

最早一代的云,是把线下 IT 服务搬到线上。

过去公司做业务,要自己买服务器、建机房、雇运维,还要为业务峰谷调服务器数量。

后来有了虚拟机,一台物理机可以跑好几台虚拟服务器,算力和存储都能被抽象出来,企业可以更灵活地使用。

再后来,像 AWS 和阿里云这样的平台,把成千上万台服务器集中到自己的数据中心,企业不用再买机器,而是像交水电费一样,按需租用资源。

2010 年我在一家互联网公司做运维,经常半夜和同事去机房检查机器,有了云之后,再也没有这种烦恼。

2015 年前后,Docker 和Kubernetes 出现,云计算进入第二阶段:云原生。

如果说云计算解决的是「有云可用」的问题,那么云原生解决的是「应用怎么真正长在云里」的问题。

传统应用虽然能跑在云上,但骨子里还是机房思维,只是换了个环境;

而云原生应用一出生就长在云里,设计逻辑就是为了充分利用云的能力——生在云里,长在云里。

再后来,大模型的爆发让需求再次升级。

企业发现光有灵活的架构还不够。

他们不仅想让应用跑得稳,还想让它更智能。

要有现成模型可以直接调用,最好还能一站式搞定训练、微调、推理等工作,不需要再投入大量资源去重复造轮子。

再往前一步,企业希望的不只是模型,而是配套的智能能力。比如开箱即用的知识库,把内部文档、业务数据和大模型打通。再比如支持文本、图片、语音、视频等多模态处理

这就是AI 云。

它和之前最大的不一样是:

不只是卖算力,而是把智能打包成一条龙服务。

企业接入之后,就能在业务里落地 AI。

从用户视角看,过去十年:

最先是买硬件,后来是买应用环境,现在是买智能。

阿里云做了什么?

在朋友圈还看到一个挺有意思的梗图,不禁让我好奇:

为什么在 AI 云市场上,阿里云能占据这么高的份额?

后面几家也都是大厂,同样在重兵投入。

添加图片注释,不超过 140 字(可选)

我查到一个资料,中国有一半以上的大模型公司都跑在阿里云上,像 Kimi、百川智能、智谱 AI、vivo,还有复旦大学等,训练模型时用的也是阿里云。

再加上阿里自己的通义大模型,可以说中国大模型的半壁江山都已经在阿里云上。

三层能力

行业里一般会把 AI 云拆成三层:

最底层是 IaaS(AI 基础设施),中间是 PaaS(AI 开发平台),最上层是 MaaS(AI 模型服务)。

这三层不是并列的产品,而更像是一栋楼的结构:地基、脚手架、装修,自下而上层层搭起来。

IaaS是地基。

它提供算力、存储、网络这些最底层的资源,相当于把钢筋水泥备齐。

企业不用再自己买显卡、建机房、雇运维,可以直接获得大规模算力和稳定的运行环境,为后续模型训练打下基础。

PaaS是脚手架。

有了硬件,还得有一整套能把流程组织起来的工具。

它提供数据处理、模型训练、推理部署等平台服务,企业不必从零搭环境、调框架,可以更高效地把模型跑起来,让研发周期变得可控。

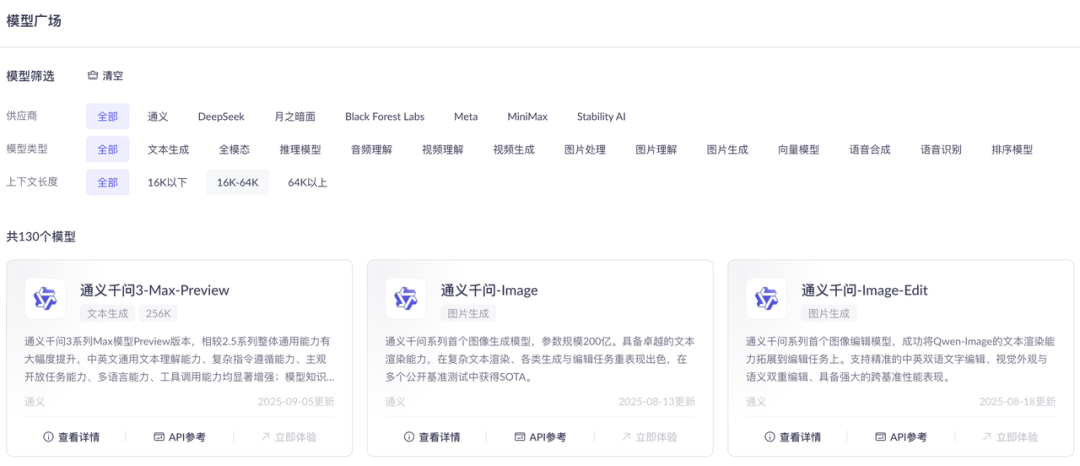

MaaS是装修。

这一层把模型和智能能力打包成服务,比如通义系列模型、DeepSeek、Kimi 等大模型,企业可以在平台上调用接口、搭建RAG、应用开发,不需要再从头训练,就能把 AI 能力嵌进自己的业务。

添加图片注释,不超过 140 字(可选)

全栈 AI 的意义

阿里云 AI 云全栈,其实就是沿着这三层一路往上搭的,做到底层设施、模型开发、模型服务全链路打通。

在 IaaS 层,它不只是提供算力,还在做底层架构的长期打磨,比如多种形态的GPU弹性算力、灵骏大规模AI训练集群、智能算力编排调度的容器服务。

并且拥有高性能存储 CPFS 和高性能网络 HPN7.0,这些 AI 基础设施提供稳定的算力,为模型的性能突破保驾护航。

PaaS 层的人工智能平台 PAI、大数据计算 MaxCompute、推理服务 EAS 等,覆盖主流AI框架,可以在页面上选几个参数,配置,就能够轻松模型训练、数据处理和模型部署,不用再去造轮子写代码。

MaaS 层的百炼平台等,提供开箱即用的模型能力与一体化的AI应用开发平台,极大地降低了人工智能技术的应用门槛。

用户无需深入模型训练、调参或底层部署等复杂环节,只需聚焦于自身业务场景的需求,即可快速构建和迭代AI应用。

这套全栈体系带来的是一条打通的流水线。

数据可以直接在云上完成清洗、存储、训练,一键部署为模型服务,再通过接口接入到应用中间层。

企业不再需要频繁跨系统搬运,也不用担心兼容性问题。

做 AI,不再是自己拼零件,而是在一条现成的生产线上组装。

同时,全栈也意味着统一的使用体验。

算力调度、模型训练、推理部署、应用调用这些环节都在同一个控制面内,权限、计费、监控、告警可以贯通,团队协作和成本管理的复杂度显著降低。

相比早期那种单点采购+自行整合的模式,全栈体系让云真正从卖算力、卖工具,走向了卖智能。真应了互联网圈那句经典的产品金句:把复杂留给自己,把简单留给用户。也符合阿里巴巴的口号:让天下没有难做的生意!

也许这就是为什么,在 AI 云这个阶段,阿里云能有这么高的市场占有率。

想想这十几年,云的角色在悄悄变:

一开始大家买的是机器,后来买的是环境,现在买的已经是智能。

AI 云的出现,就像是按下了电力化的开关:智能不再是少数人的专属,而是可以像电力一样,被大规模分发和被任何业务即取即用,并随着各种应用,走进千家万户。

阿里云,正在把智能,做成家家户户所需要的新型“电力”。

微信视频号:sph0RgSyDYV47z6

快手号:4874645212

抖音号:dy0so323fq2w

小红书号:95619019828

B站1:UID:3546863642871878

B站2:UID: 3546955410049087

参考文献链接

人工智能芯片与自动驾驶

浙公网安备 33010602011771号

浙公网安备 33010602011771号