【机器学习】KNN简单原理

建议使用jupyter打印一步一步进行理解

上代码:

import numpy as np import pandas as pd # 这里直接引入sklearn里的数据集,iris鸢尾花 from sklearn.datasets import load_iris from sklearn.model_selection import train_test_split # 切分数据集为训练集和测试集 from sklearn.metrics import accuracy_score # 计算分类预测的准确率

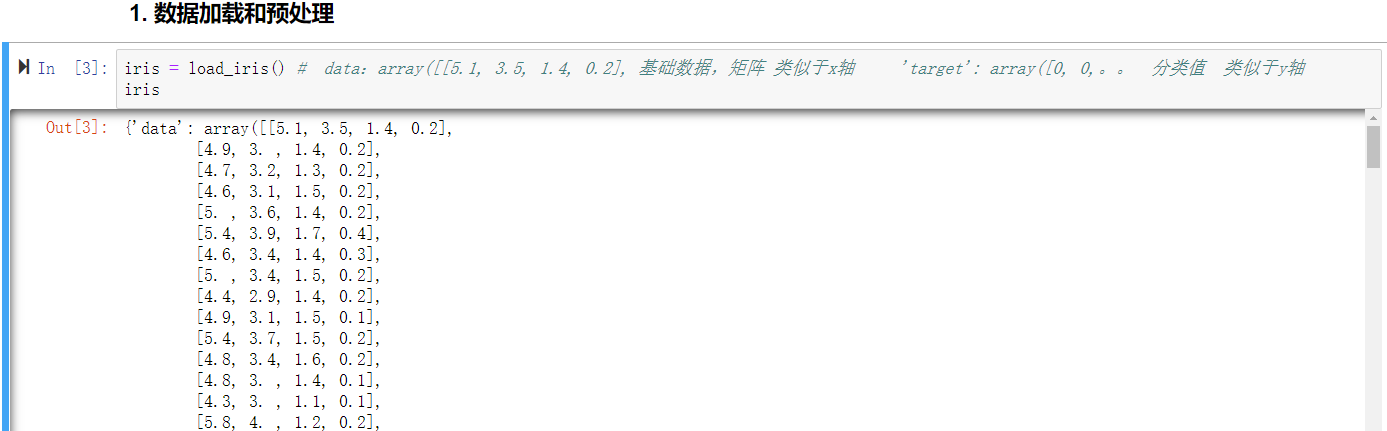

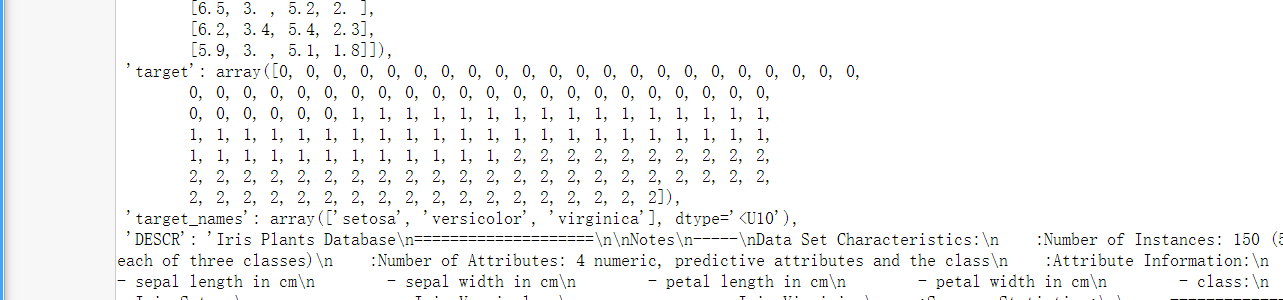

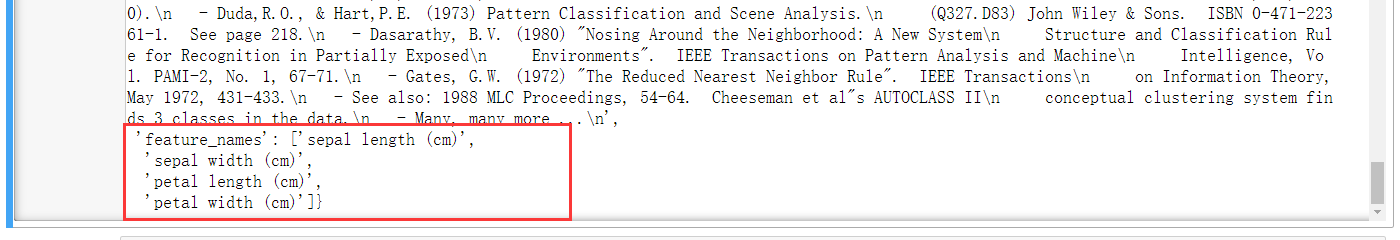

iris = load_iris() # data:array([[5.1, 3.5, 1.4, 0.2], 基础数据,矩阵 类似于x轴 'target': array([0, 0,。。 分类值 类似于y轴 iris

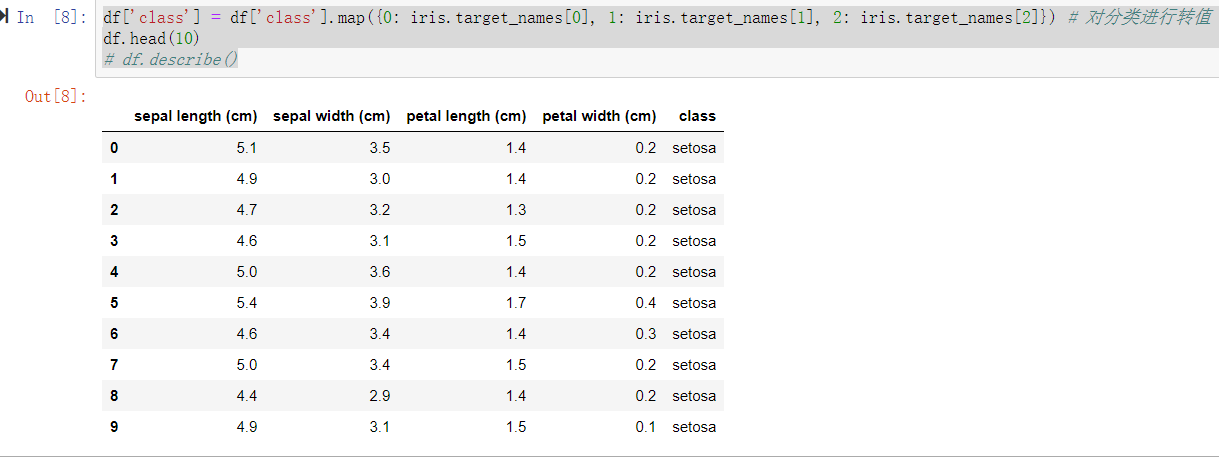

df = pd.DataFrame(data = iris.data, columns = iris.feature_names) df['class'] = iris.target # 分类 # df['class'] iris.target

df['class'] = df['class'].map({0: iris.target_names[0], 1: iris.target_names[1], 2: iris.target_names[2]}) # 对分类进行转值 df.head(10) # df.describe()

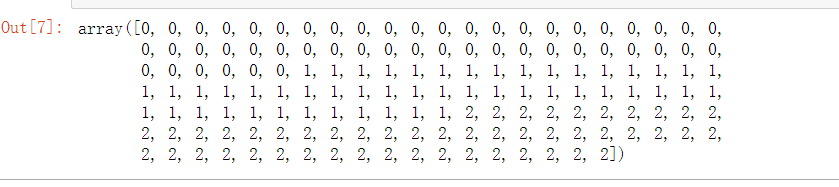

x = iris.data y = iris.target.reshape(-1,1) # 一唯数组转成二唯数组 列向量 print(y) print(x.shape, y.shape)

# 划分训练集和测试集 random_state 随机划分个数 stratify 按照y的比例 test_size 1为总数 划分训练集与测试集的数量 x_train, x_test, y_train, y_test = train_test_split(x, y, test_size=0.3, random_state=35, stratify=y) print(y_train) print(x_train.shape, y_train.shape) print(x_test.shape, y_test.shape)

2:核心算法实现 # 距离函数定义 np.abs计算绝对值 sqrt求根 def l1_distance(a, b): return np.sum(np.abs(a-b), axis=1) def l2_distance(a, b): return np.sqrt( np.sum((a-b) ** 2, axis=1) ) # 分类器实现 class kNN(object): # 定义一个初始化方法,__init__ 是类的构造方法 def __init__(self, n_neighbors = 1, dist_func = l1_distance): self.n_neighbors = n_neighbors self.dist_func = dist_func # 训练模型方法 def fit(self, x, y): self.x_train = x self.y_train = y # 模型预测方法 def predict(self, x): # 初始化预测分类数组 y_pred = np.zeros( (x.shape[0], 1), dtype=self.y_train.dtype ) # 遍历输入的x数据点,取出每一个数据点的序号i和数据x_test for i, x_test in enumerate(x): # x_test跟所有训练数据计算距离 distances = self.dist_func(self.x_train, x_test) # 得到的距离按照由近到远排序,取出索引值 nn_index = np.argsort(distances) # 选取最近的k个点,保存它们对应的分类类别 nn_y = self.y_train[ nn_index[:self.n_neighbors] ].ravel() # 统计类别中出现频率最高的那个,赋给y_pred[i] y_pred[i] = np.argmax( np.bincount(nn_y) ) return y_pred

3:测试(不理解算法的人,只要会使用就OK了,sklean其实已经帮我们封装好了),与一下测试实例调用差不多

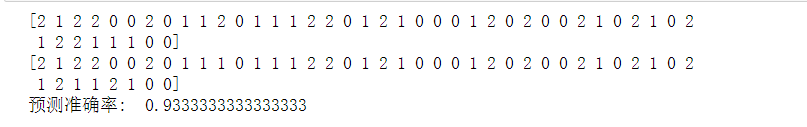

# 定义一个knn实例 knn = kNN(n_neighbors = 3) # 训练模型 knn.fit(x_train, y_train) # 传入测试数据,做预测 y_pred = knn.predict(x_test) print(y_test.ravel()) print(y_pred.ravel()) # 求出预测准确率 accuracy = accuracy_score(y_test, y_pred) print("预测准确率: ", accuracy)

总结:其实sklean里面的调用都是差不多的,将数据分为训练集数据跟测试数据(测试数据只是验证测试的x对应的y未知数是否正确),设置临近数分类为n,将训练数据放入fit函数进行训练,计算对应的公式,训练后再将需要预测的x轴值调用predict函数进行计算。最后得出

预测值

Python全栈(后端、数据分析、脚本、爬虫、EXE客户端) / 前端(WEB,移动,H5) / Linux / SpringBoot / 机器学习

浙公网安备 33010602011771号

浙公网安备 33010602011771号