2024-03-03 - 大语言模型为什么要微调 - 吴恩达

摘要

2024-03-03 周日 杭州 🌤

小记: 钱塘江边的樱花还没有开呀!不过阳光是真的灿烂。

课程内容

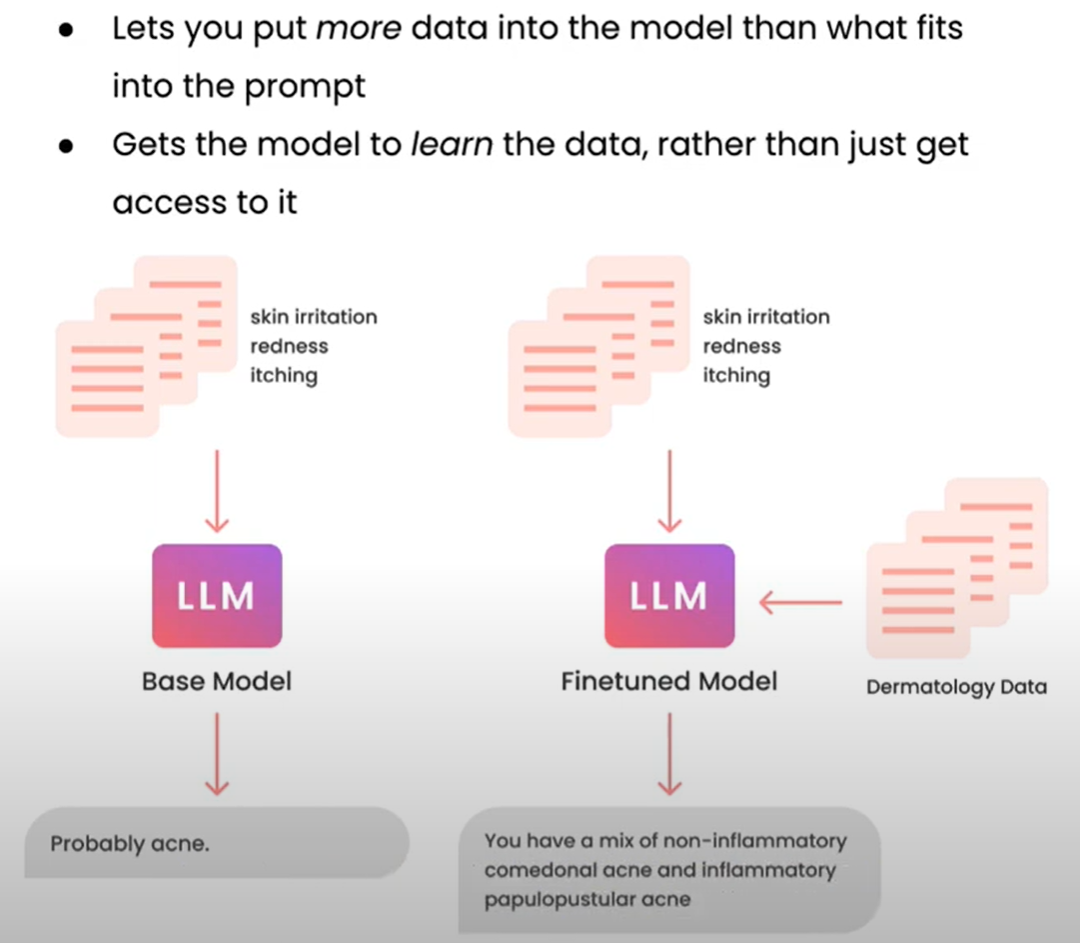

1. 什么是 finetuning ?

心得: 基础大模型就是高中毕业前的我们,还没有分专业,所以大模型拥有的是通用的基础能力。微调就像基于对有天赋的孩子的一场专业化训练,微调完成以后的模型就是对于特定领域的专家里手,把他教好或者教坏都是可以的,后面肯定会有法律出台对于大模型训练导向的限制。

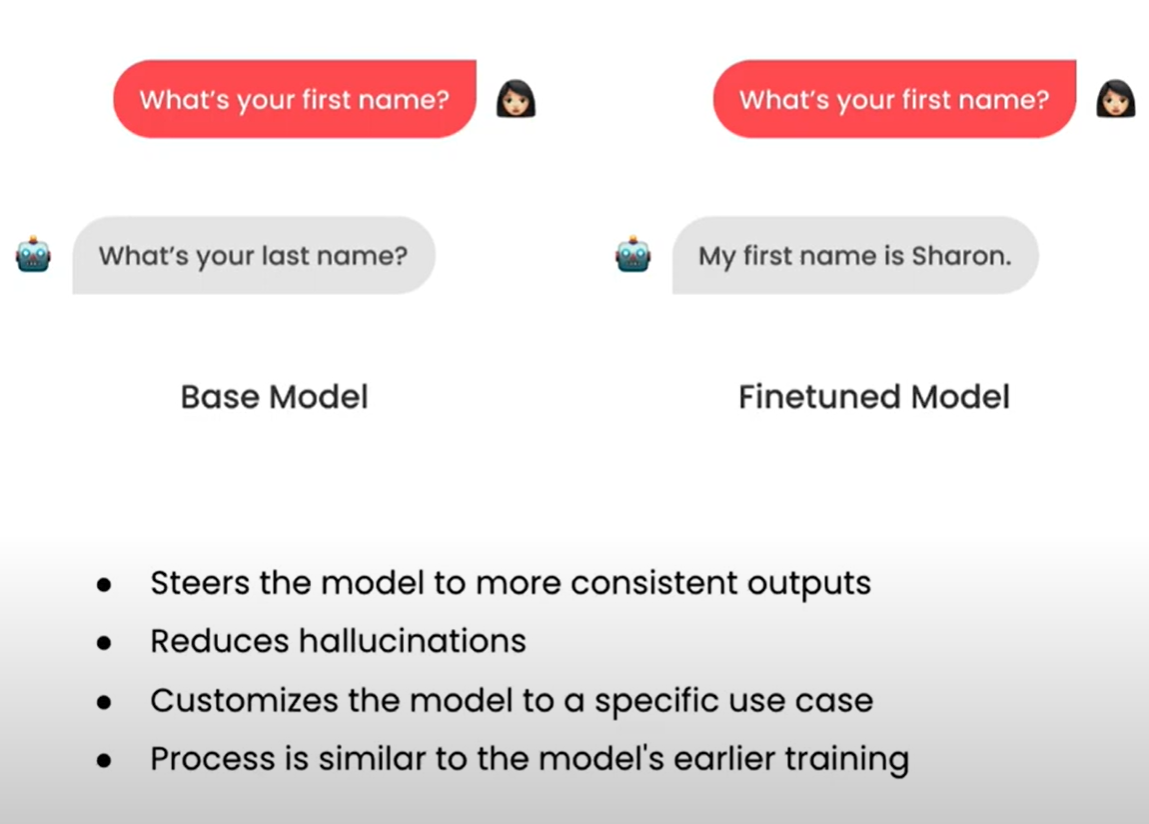

2. finetuning 对模型干了啥 ?

小结: 微调的实质就是通过喂养大模型符合自己预期的数据使其成为特定领域的专业人员,通过微调可以指定语气,对话范围,专业领域的特定技能,但是对于对错的判断标准是人,所以很多标准是满足人的喜好下的一种讨好。

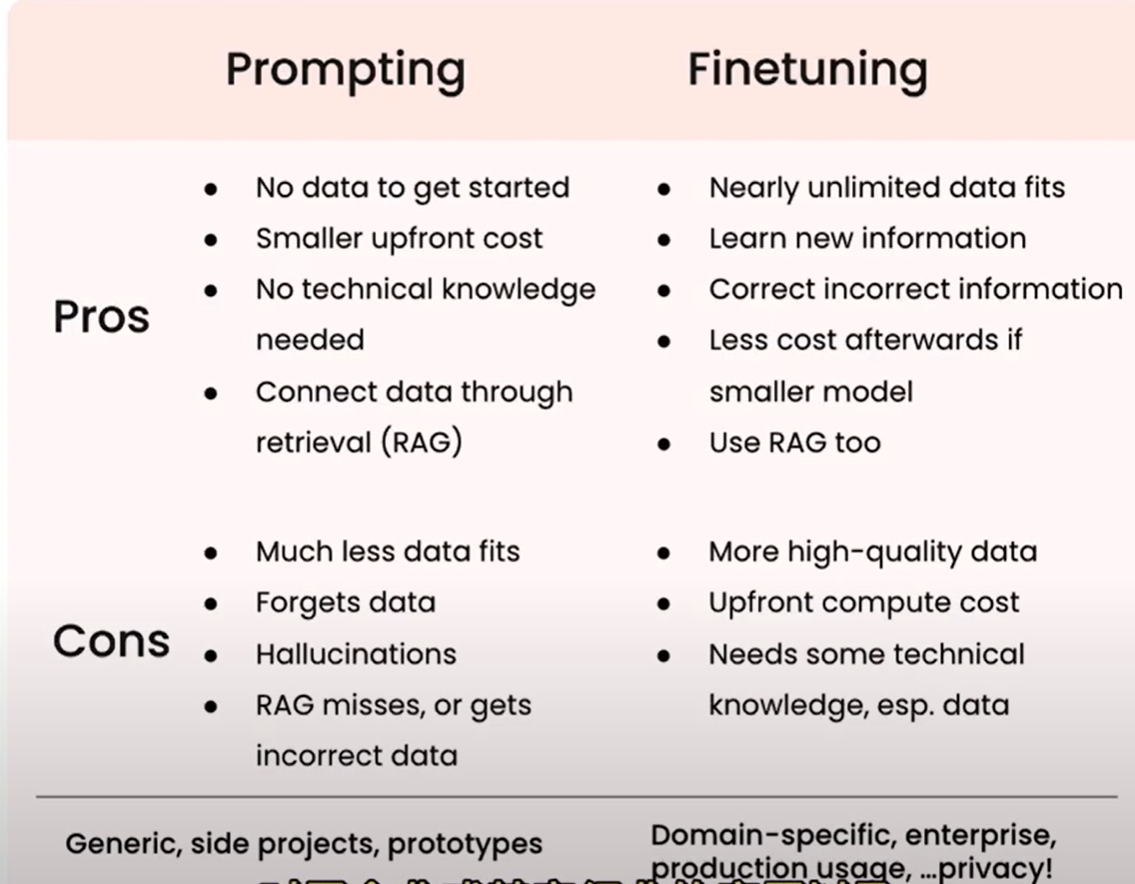

3. 提示工程 vs finetuning

小结: 提示工程更为通用,一般应用于快速落地的产品应用可以进行快速的开发和设计;finetuning 可以训练出来更加符合专业领域知识的助手,两者各有侧重,需要结合实际应用场景进行合理选择。

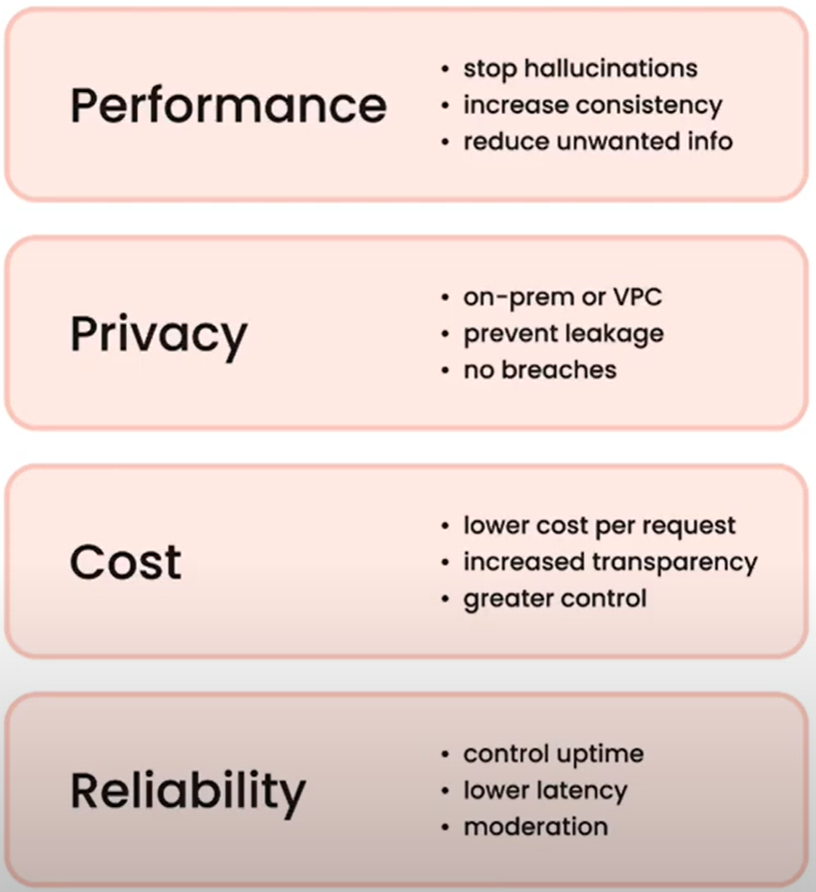

4. finetuning 的优势

小结: 微调的优势包括,专业,隐私保护,花费少,审查可控,如果自己微调的模型无法通过审查那么整个项目就会废掉的。

5. 微调的工具

心得: 三行代码微调大模型不是梦,这个世界就是被不断标准化的一个过程。

总结

再部署一个 llama 大模型进行微调开发测试。

后会无期,未来可期!

浙公网安备 33010602011771号

浙公网安备 33010602011771号