All of statistics 预习笔记

Chapter 1

-

一个概率函数 \(P\) 是一个从全体事件集合 \(\Omega\) 到 \(\mathbb{R}\) 的映射,满足:

- \(\forall A\), \(\mathbb{P}(A)\ge 0\)

- \(\mathbb{P}(\Omega)=1\)

- 对任意两两不相交的事件集合 \(A_1,A_2,\cdots,A_k\),\(\mathbb{P}(\cup_{i=1}^kA_i)=\sum\limits_{i=1}^k\mathbb{P}(A_i)\)。

-

称两事件 \(A,B\) 互相独立,当且仅当 \(\mathbb{P}(AB)=\mathbb{P}(A)\mathbb{P}(B)\)。

-

若 \(A,B\) 为两事件,其中 \(\mathbb{P}(B)>0\),则定义条件概率 \(\mathbb{P}(A|B)=\dfrac{\mathbb{P}(AB)}{\mathbb{P}(B)}\),其实际含义为已知 \(B\) 发生时 \(A\) 发生的概率。

-

若 \(A_1,A_2,\cdots,A_k\) 为 \(\Omega\) 的一组划分,则对任意事件 \(B\),都有 \(\mathbb{P}(B)=\sum\limits_{i=1}^k\mathbb{P}(B|A_i)\mathbb{P}(A_i)\)。

-

Bayes 公式:若 \(A_1,A_2,\cdots,A_k\) 为 \(\Omega\) 的一组划分,满足 \(\forall 1\le i\le k,\mathbb{P}(A_i)>0\),\(B\) 为一满足 \(\mathbb{P}(B)>0\) 的事件,则 \(\mathbb{P}(A_i|B)=\dfrac{\mathbb{P}(B|A_i)\mathbb{P}(A_i)}{\sum_j\mathbb{P}(B|A_j)\mathbb{P}(A_j)}\)。

Chapter 2

-

对于随机变量 \(X\),定义其 CDF \(F_X(x)=\mathbb{P}(X\le x)\)。

-

若 \(F\) 为一 \(\mathbb{R}\to[0,1]\) 的映射,则 \(F\) 是某随机变量的 CDF 当且仅当:

- \(\forall x_1<x_2,F(x_1)\le F(x_2)\)。

- \(\lim\limits_{x\to-\infty}F(x)=0,\lim\limits_{x\to+\infty}F(x)=1\)。

- \(\forall x,F(x)=F(x^+)\)。

-

称一随机变量 \(X\) 为离散型随机变量,当且仅当其可能的取值只有有限种或者可数无穷多种。对离散型随机变量而言,定义其 probability mass function \(f_X(x)=\mathbb{P}(X=x)\)。

-

称一随机变量 \(X\) 为连续型随机变量,当且仅当存在函数 \(f_X(x)\),满足 \(\int_{-\infty}^{+\infty}f_X(x)\mathrm dx=1\),且 \(\forall a\le b\),都有 \(\mathbb{P}(a<X<b)=\int_a^bf_X(x)\mathrm dx\)。这一函数 \(f_X(x)\) 被称为其 probability density function。\(\forall x\in\mathbb{R}\),都有 \(f_X(x)=F'_X(x)\)。

-

常见的离散型概率分布:

- 点质量分布(point mass distribution):随机变量 \(X\sim\delta_a\),当且仅当 \(\mathbb{P}(X=a)=1\),此时其 CDF 为 \(F(x)=\begin{cases}0&x<a\\1&x\ge a\end{cases}\)。

- 离散均匀分布(discrete uniform distribution):称随机变量 \(X\) 服从 \(\{1,2,3,\cdots,k\}\) 上的离散均匀分布,当且仅当 \(\mathbb{P}(X=i)=\dfrac{1}{k}(i\in\{1,2,3,\cdots,k\})\)。

- 伯努利分布(Bernoulli distribution):给定参数 \(p\in[0,1]\),随机变量 \(X\sim\text{Bernouli}(p)\),当且仅当 \(\mathbb{P}(X=1)=p,\mathbb{P}(X=0)=1-p\),其中 \(p\in[0,1]\)。

- 二项分布(binomial distribution):给定参数 \(n\ge 0,p\in[0,1]\),随机变量 \(X\sim\text{Binomial}(n,p)\),当且仅当 \(\mathbb{P}(X=x)=\dbinom{n}{x}p^x(1-p)^{n-x}\),其中 \(0\le x\le n\),其组合意义为掷 \(n\) 次正面朝上概率为 \(p\) 的硬币,正面朝上的次数的概率分布。伯努利分布可以视作 \(n=1\) 的二项分布。若 \(X_1\sim\text{Binomial}(n_1,p),X_2\sim\text{Binomial}(n_2,p)\),则 \(X_1+X_2\sim\text{Binomial}(n_1+n_2,p)\)。

- 几何分布(geometric distribution):给定参数 \(p\in[0,1]\),随机变量 \(X\sim\text{Geom}(p)\),当且仅当 \(\mathbb{P}(X=k)=p(1-p)^{k-1}\),其中 \(k\ge 1\)。其组合意义为掷正面朝上概率为 \(p\) 的硬币,第一次掷到正面的时刻的概率分布。

- 泊松分布(poisson distribution):给定参数 \(\lambda\),随机变量 \(X\sim\text{Poisson}(\lambda)\),当且仅当 \(\mathbb{P}(X=x)=e^{-\lambda}\dfrac{\lambda^x}{x!}\)。若 \(X_1\sim\text{Poisson}(\lambda_1),X_2\sim\text{Poisson}(\lambda_2)\),则 \(X_1+X_2\sim\text{Poisson}(\lambda_1+\lambda_2)\)。

-

常见的连续性概率分布:

-

均匀分布(uniform distribution):对于 \([a,b]\) 上的均匀分布,其概率密度函数满足 \(f(x)=\dfrac{1}{b-a}\),其中 \(x\in[a,b]\)。

-

正态分布(normal distribution):给定参数 \(\mu,\sigma\),若 \(X\) 服从期望为 \(\mu\),方差为 \(\sigma^2\) 的正态分布,则其概率密度函数满足 \(f(x)=\dfrac{1}{\sigma\sqrt{2\pi}}\exp(-\dfrac{1}{2\sigma^2}(x-\mu)^2)\),记作 \(X\sim N(\mu,\sigma^2)\)。

称 \(\mu=0,\sigma=1\) 的正态分布为标准正态分布。若 \(X\) 服从期望为 \(\mu\),方差为 \(\sigma^2\) 的正态分布,则 \(\dfrac{X-\mu}{\sigma}\) 服从标准正态分布。若 \(X_i\sim N(\mu_i,\sigma^2_i)\),则 \(\sum\limits_{i=1}^nX_i\sim(\sum\limits_{i=1}^n\mu_i,\sum\limits_{i=1}^n\sigma^2_i)\)。

-

指数分布(exponential distribution):给定参数 \(\beta>0\),若 \(X\sim\text{Exp}(\beta)\),则其概率密度函数 \(f(x)=\dfrac{1}{\beta}e^{-\frac{x}{\beta}}\),其中 \(x>0\)。

-

Gamma 分布(Gamma distribution):给定参数 \(\alpha,\beta>0\),若 \(X\sim\text{Gamma}(\alpha,\beta)\),则其概率密度函数 \(f(x)=\dfrac{1}{\beta^{\alpha}\Gamma(\alpha)}x^{\alpha-1}e^{-\frac{x}{\beta}}\),其中 \(\Gamma(\alpha)=\int_0^{\infty}y^{\alpha-1}e^{-y}\mathrm dy\)。

-

Beta 分布(Beta distribution):给定参数 \(\alpha,\beta>0\),若 \(X\sim\text{Beta}(\alpha,\beta)\),则其概率密度函数 \(f(x)=\dfrac{\Gamma(\alpha+\beta)}{\Gamma(\alpha)\Gamma(\beta)}x^{\alpha-1}(1-x)^{\beta-1}\)。

-

-

CDF/PDF 还可以扩展到多维的情况。marginal mass function 是对多维的 probability mass function 投到某一维的结果。同理有 marginal density function。

-

称两个随机变量 \(X,Y\) 独立,当且仅当 \(\forall A,B\),都有 \(\mathbb{P}(X\in A,Y\in B)=\mathbb{P}(X\in A)\mathbb{P}(Y\in B)\)。若 \(X,Y\) 都是连续变量,这等价于 \(\forall x,y\),都有 \(f(x,y)=f_X(x)f_y(y)\),其中 \(f,f_X,f_Y\) 分别表示 \(x,y\) 的 joint distribution、\(x\) 自身、\(y\) 自身的 PDF。

-

称若干变量 IID,当且仅当仅当他们服从同一概率分布且互相独立。

-

给定变量 \(X\),若变量 \(Y=r(x)\),则对于某一 \(y\) 找出 \(A_y=\{x|r(x)\le y\}\),算出 \(\int_{A_y}f_X(x)\mathrm dx\) 即可算出 \(Y\) 的概率分布。

Chapter 3

-

对于随机变量 \(X\),定义其期望为 \(\sum_xxf(x)\)(离散变量)或 \(\int xf(x)\mathrm dx\)(连续变量),其中 \(f(x)\) 为其 PMF 或者 PDF。

-

The Rule of Lazy Statistician:对于 \(Y=r(X)\),则 \(\mathbb{E}(Y)=\mathbb{E}(r(X))=\int r(x)f(x)\mathrm dx\),不必算出 \(Y\) 的概率分布再积分。

-

若 \(X_1,X_2,\cdots,X_n\) 为随机变量,\(a_i\in\mathbb{R}\),则 \(\mathbb{E}(\sum\limits_{i=1}^na_iX_i)=\sum\limits_{i=1}^na_i\mathbb{E}(x_i)\)。

-

若 \(X_1,X_2,\cdots,X_n\) 互相独立,则 \(\mathbb{E}(\prod\limits_{i=1}^nX_i)=\prod\limits_{i=1}^n\mathbb{E}(X_i)\)。

-

若随机变量 \(X\) 的期望为 \(\mu\),则定义其方差 \(\mathbb{V}(X)=\sigma^2=\mathbb{E}((X-\mu)^2)=\int(x-\mu)^2f(x)\mathrm dx\),其标准差定义为方差的算术平方根。

- \(\mathbb{V}(X)=\mathbb{E}(X^2)-\mu^2\)。

- 若 \(a,b\) 为常数则 \(\mathbb{V}(aX+b)=a^2\mathbb{V}(X)\)。

- 若 \(X_1,X_2,\cdots,X_n\) 互相独立且 \(a_1,a_2,\cdots,a_n\) 为常数,则 \(\mathbb{V}(\sum\limits_{i=1}^na_iX_i)=\sum\limits_{i=1}^na_i^2\mathbb{V}(X_i)\)。

-

若随机变量 \(X,Y\),期望分别为 \(\mu_X,\mu_Y\),标准差分别为 \(\sigma_X,\sigma_Y\)。则定义他们的协方差 \(\text{Cov}(X,Y)=\mathbb{E}((X-\mu_X)(Y-\mu_Y))\),相关系数 \(\rho_{X,Y}=\dfrac{\text{Cov}(X,Y)}{\sigma_X\sigma_Y}\)。

-

对任意 \(X,Y\),都有 \(-1\le\rho_{X,Y}\le 1\)。若 \(X,Y\) 独立则 \(\text{Cov}(X,Y)=0\)。

-

若 \(Y=aX+b\),则若 \(a>0\) 则 \(\rho_{X,Y}=1\),若 \(a<0\) 则 \(\rho_{X,Y}=-1\)。

证明:\(\text{Cov}(X,Y)=\mathbb{E}(XY)-\mu_X\mu_Y=\mathbb{E}(X(aX+b))-\mu_X(a\mu_X+b)=a\mathbb{E}(X^2)-a\mu^2_X=a\mathbb{V}(X)\),\(\rho_{X,Y}=\dfrac{a\mathbb{V}(X)}{\sigma_X·\sigma_Y}=\dfrac{a\mathbb{V}(X)}{\sigma_X·|a\sigma_X|}=\text{sgn}(a)\)。

-

\(\mathbb{V}(X+Y)=\mathbb{V}(X)+\mathbb{V}(Y)+2\text{Cov}(X,Y),\mathbb{V}(X-Y)=\mathbb{V}(X)+\mathbb{V}(Y)-2\text{Cov}(X,Y)\)。更一般地,\(\mathbb{V}(\sum a_iX_i)=\sum\limits_{i=1}^n\sum\limits_{j=1}^na_ia_j\text{Cov}(X_i,X_j)\)。

证明:\(\mathbb{V}(\sum a_iX_i)=\mathbb{E}((\sum a_iX_i)^2)-(\sum a_iE(X_i))^2=\sum\limits_{i=1}^n\sum\limits_{j=1}^na_ia_j(\mathbb{E}(X_iX_j)-\mathbb{E}(X_i)\mathbb{E}(X_j))=\sum\limits_{i=1}^n\sum\limits_{j=1}^na_ia_j\text{Cov}(X_i,X_j)\)。

-

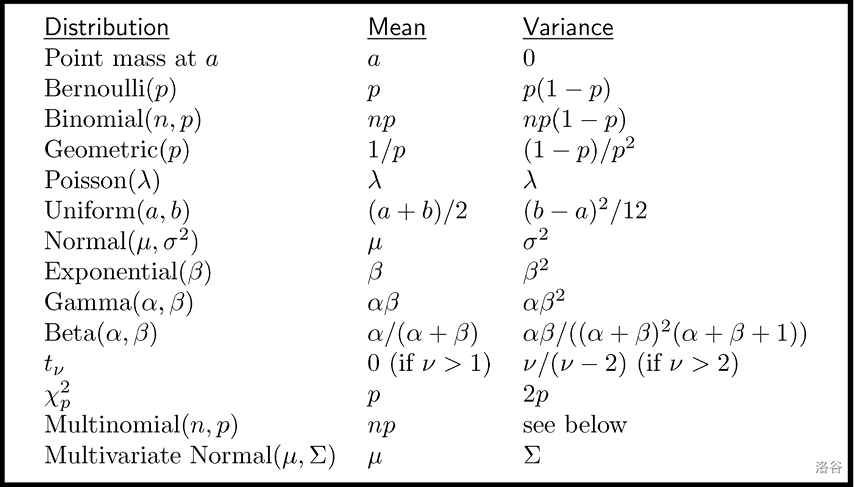

常见概率分布的期望和方差:

-

对随机变量 \(X\) 而言,定义其矩量生成函数(moment generating function)为 \(\psi_X(t)=\mathbb{E}(e^{tX})=\int e^{tx}f(x)\mathrm dx\)。若 \(\psi_X(t)\) 在 \(t=0\) 的某个邻域中有定义且可微,则 \(\psi'(0)=[\dfrac{\mathrm d}{\mathrm dt}\mathbb{E}e^{tx}]_{t=0}=\mathbb{E}[\dfrac{\mathrm d}{\mathrm dt}{e^{tx}}]_{t=0}=\mathbb{E}[Xe^{tX}]_{t=0}=\mathbb{E}[X]\),类似地可以归纳证明 \(\psi^{(k)}(0)=\mathbb{E}[X^k]\)。

-

互相独立的随机变量的和的 MGF 是它们各自的 MGF 之积。

-

若 \(\psi_X(t)\) 和 \(\psi_Y(t)\) 在 \(t=0\) 的某个邻域中相等,则 \(X,Y\) 有相同的概率分布。

-

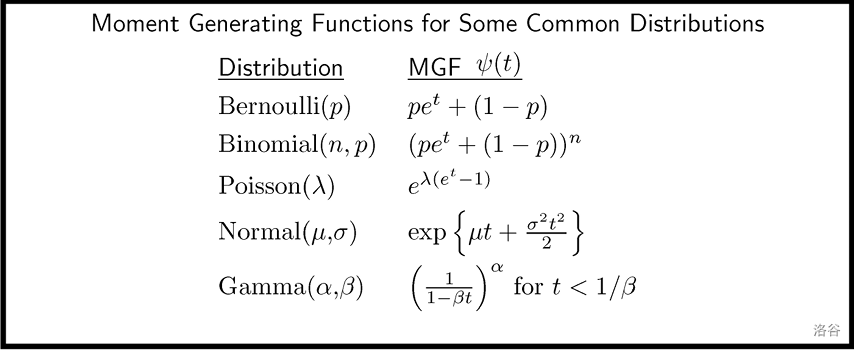

常见概率分布的 MGF:

Chapter 4

-

马尔可夫不等式:设 \(X\) 为取值非负的随机变量,\(\mathbb{E}(X)\) 存在,则 \(\forall t,\mathbb{P}(X>t)\le\dfrac{\mathbb{E}(X)}{t}\)。

证明:因为 \(X\) 取值非负,故 \(\mathbb{E}(X)\ge\mathbb{P}(X>t)t\)。

-

切比雪夫不等式:设 \(X\) 为随机变量,\(\mu=\mathbb{E}(X)\),\(\sigma^2=\mathbb{V}(X)\),则 \(\mathbb{P}(|X-\mu|\ge t)\le\dfrac{\sigma^2}{t^2}\)。

证明:对 \((X-\mu)^2\) 使用马尔可夫不等式可得 \(\mathbb{P}(|X-\mu|\ge t)=\mathbb{P}((X-\mu)^2\ge t^2)\le\dfrac{\sigma^2}{t^2}\)。

-

柯西施瓦茨不等式:对方差有限的变量 \(X,Y\),\(\mathbb{E}(XY)\le\sqrt{\mathbb{E}(X^2)\mathbb{E}(Y^2)}\)。

-

琴生不等式:对凸的 \(g\),\(\mathbb{E}(g(X))\ge g(\mathbb{E}(X))\)。

-

霍夫丁不等式引理:对于随机变量 \(X\),若 \(\mathbb{P}(X\in[a,b])=1,\mathbb{E}(X)=0\),则 \(\mathbb{E}(e^{sX})\le e^{\frac{s^2(b-a)^2}{8}}\)。

证明:因为 \(e^{sX}\) 在 \(X\in[a,b]\) 上为凸函数,故 \(e^{sX}\le\dfrac{b-X}{b-a}e^{sa}+\dfrac{X-a}{b-a}e^{sb}\),两边同时求数学期望冰带入 \(\mathbb{E}(X)=0\) 可得 \(\mathbb{E}(e^{sX})\le\dfrac{b}{b-a}e^{sa}-\dfrac{a}{b-a}e^{sb}\)。而 \(\dfrac{b}{b-a}e^{sa}-\dfrac{a}{b-a}e^{sb}=\exp(sa+\ln(\dfrac{b}{b-a}-\dfrac{a}{b-a}e^{s(b-a)}))\)。令 \(h=s(b-a),p=-\dfrac{a}{b-a}\),则式子可以写作 \(\exp(-hp+\ln(1-p+pe^h))\),考察 \(L(h)=-hp+\ln(1-p+pe^h)\) 的上界,根据泰勒公式,\(L(h)=L(0)+L'(0)h+\dfrac{L''(\xi)}{2}h^2\),其中 \(\xi\in[0,h]\),而 \(L''(h)=\dfrac{pe^h}{1-p+pe^h}(1-\dfrac{pe^h}{1-p+pe^h})\le\dfrac{1}{4}\),所以 \(L(h)\le\dfrac{h^2}{8}\),\(\mathbb{E}(e^{sX})\le e^{\frac{s^2(b-a)^2}{8}}\)。

-

霍夫丁不等式:若 \(X_1,X_2,\cdots,X_n\) 为互相独立的随机变量,\(\mathbb{E}(X_i)=0\) 且 \(a_i\le X_i\le b_i\),则对任意 \(\epsilon,t>0\),都有 \(\mathbb{P}(\sum\limits_{i=1}^nY_i\ge\epsilon)\le e^{-t\epsilon}\prod\limits_{i=1}^ne^{t^2(b_i-a_i)^2/8}\)。

证明:\(\mathbb{P}(\sum\limits_{i=1}^nY_i\ge\epsilon)=\mathbb{P}(\prod\limits_{i=1}^ne^{tY_i}\ge e^{t\epsilon})\le e^{-t\epsilon}\prod\limits_{i=1}^ne^{tY_i}\),根据霍夫丁不等式引理,\(e^{-t\epsilon}\prod\limits_{i=1}^ne^{tY_i}\le e^{-t\epsilon}\prod\limits_{i=1}^ne^{t^2(b_i-a_i)^2/8}\)。

-

推论:若 \(X_1,X_2,\cdots,X_n\) 为互相独立的随机变量,\(\mathbb{E}(X_i)=0\) 且 \(a_i\le X_i\le b_i\),则对任意 \(\epsilon>0\),都有 \(\mathbb{P}(\sum\limits_{i=1}^nY_i\ge\epsilon)\le\exp(-\dfrac{2\epsilon^2}{\sum\limits_{i=1}^n(b_i-a_i)^2})\)。

证明:考察函数 \(g(t)=-\epsilon t+\sum\limits_{i=1}^n\dfrac{1}{8}t^2(b_i-a_i)^2\),令 \(g'(t)=0\) 得 \(t^*=\dfrac{4t}{\sum\limits_{i=1}^n(b_i-a_i)^2}\),\(g(t^*)=-\dfrac{2\epsilon^2}{\sum\limits_{i=1}^n(b_i-a_i)^2}\),因此 \(\mathbb{P}(\sum\limits_{i=1}^nY_i\ge\epsilon)\le\exp(-\dfrac{2\epsilon^2}{\sum\limits_{i=1}^n(b_i-a_i)^2})\)。

-

Mill 不等式:若 \(X\sim N(0,1)\),则 \(\mathbb{P}(|X|>t)\le\sqrt{\dfrac{2}{\pi}}·\dfrac{e^{-t^2/2}}{t}\)。

浙公网安备 33010602011771号

浙公网安备 33010602011771号