windows本地部署deepseek-R1模型并接入wx

1、本地部署deepseek-R1模型

通过官网 https://ollama.com 下载安装 ollama

选择自身GPU显存适合的 模型,这里我用的8b

ollama run deepseek-r1:8b

2、hook wechat接入对话

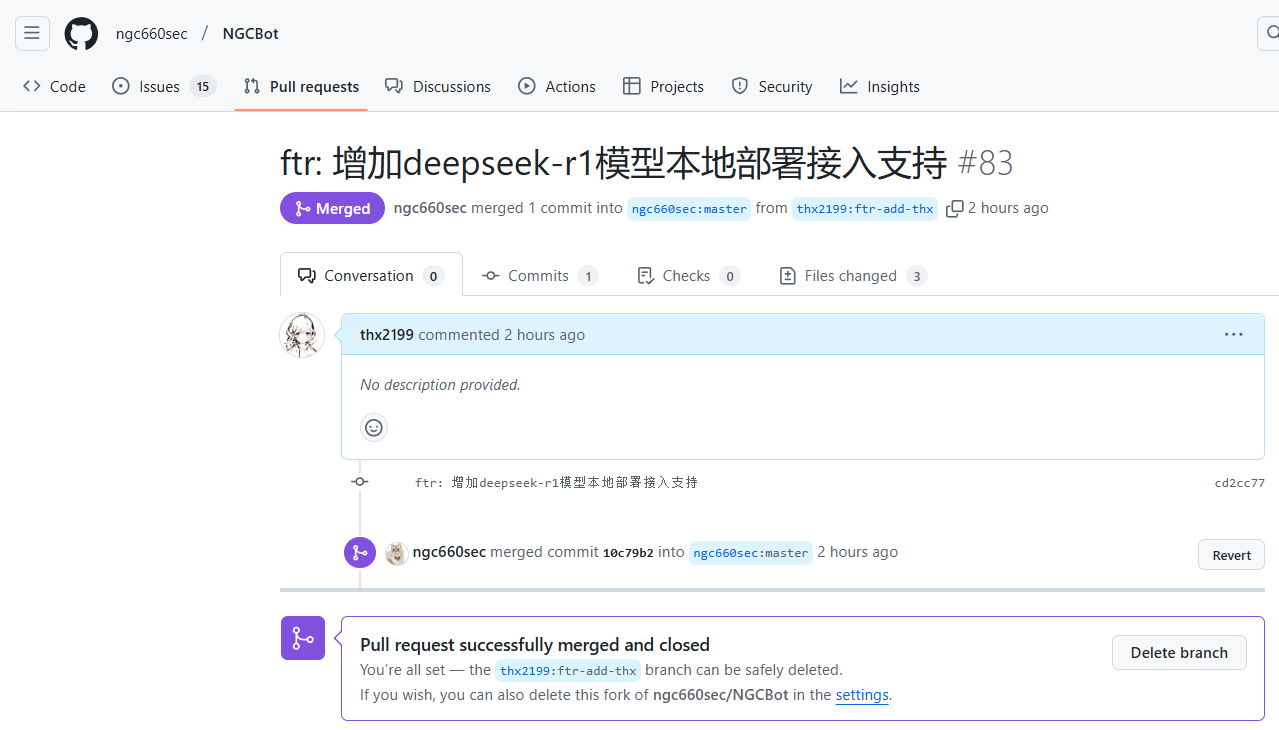

通过项目 https://github.com/ngc660sec/NGCBot hook wechat

想必这种方式会比docker+cow网页版登录的方式安全很多(问就是之前被封过)

浙公网安备 33010602011771号

浙公网安备 33010602011771号