TGRS 2025 从宏观到微观:一种用于遥感图像变化检测的轻量级交错网络

From Macro to Micro: A Lightweight Interleaved Network for Remote Sensing Image Change Detection

论文访问地址:https://ieeexplore.ieee.org/document/10912653

论文公开代码:https://github.com/Sean1005-x/M2M-LINet

论文引用信息:Y. Xu, T. Lei, H. Ning, S. Lin, T. Liu, M. Gong and A. K. Nandi, "From Macro to Micro: A Lightweight Interleaved Network for Remote Sensing Image Change Detection," in IEEE Transactions on Geoscience and Remote Sensing, vol. 63, pp. 1-14, 2025, Art no. 4406114, doi: 10.1109/TGRS.2025.3548562.

1. 概述

遥感影像变化检测作为对地监测的一项关键技术,在实际应用中面临着两大挑战:首先,由于成像条件以及变化目标不均衡,准确定位和区分变化信息变得困难,尤其在处理小目标和模糊边界时仍存在局限性。其次,多数主流变化检测方法依赖复杂的模块堆叠来提高性能,但这忽视了实际计算资源的限制。为解决这些问题,本文提出了一种基于交错结构的轻量型变化检测模型。首先,为应对复杂的不均衡变化场景,本文基于生物视觉的启发,设计了具有三阶段的变化检测框架:第一阶段是粗定位阶段(Coarse Location Stage),类似于人眼的宏观观察,通过设计Coarse Aggregation Localization Module (CALM),提取变化目标的整体趋势和大致位置;第二阶段是细节聚焦阶段(Fine Detail Focusing Stage),模拟人眼的微观观察,采用创新型轻量级CNN-Transformer交错模型,进一步捕捉更细粒度的信息;第三阶段是解码预测阶段(Decoding Prediction Stage),类似于人类对变化信息的解读,对最终的变化特征进行预测。另外,为了更好的降低模型参数量便于模型部署,在细节聚焦阶段设计了轻量级的交错结构,具体包括两个关键的轻量型组件:Lightweight Convolutional Block (LCB),用于增强图像的高频和低频信息,实现细粒度的变化定位;Lightweight Transformer Block (LTB),设计了线性的自注意力机制,有效融合多粒度信息,从而获得更加详细和准确的变化细节。在三个大型公共数据集上的实验表明,该方法在复杂不均衡变化场景中表现优异,并且轻量化设计显著减少了计算资源的消耗,提升了实际应用中的可用性。

图 1. M2M-LINet整体框架

2. 方法

2.1 Three-Stage CD Architecture

在特征编码阶段,我们采用了残差连接的可变形卷积。可变形卷积可以通过学习卷积核特征采样位置的偏移来学习不规则器官的形状信息。图2是特征编码器采取可变形卷积与标准卷积在肝脏自动分割中特征采样的比较,从图2中可以看出标准卷积核提取特征的范围无法与不规则形状的肝脏匹配,而可变形卷积则可以通过学习空间偏移量来确定在目标图像中的特征采样位置,可以较好的提取分割目标的特征,同时用残差设计来构造特征编码器能加速神经网络收敛。

(1)Coarse Location Stage

在粗定位阶段中主要设计了一种基于粗粒度定位的优化模块CALM,如图1所示,通过整合多尺度特征实现高效精准的变化检测。具体流程如下:首先,以预训练的PVT作为CoarseNet,提取富含信息的多尺度特征,为定位变化区域提供关键依据;随后,将提取的三层特征逐层上采样并与相邻上层特征拼接,聚合得到两个特征,计算其差值生成包含多尺度信息的聚合变化特征图,强化特征表达能力;接着,将聚合变化特征与第二时相图像相乘,再与原图在通道维度拼接,得到粗粒度定位特征图;最后,经非对称卷积映射至高维特征空间,进入细节聚焦阶段。

(2)Fine Detail Focusing Stage

在细节聚焦阶段,模型通过设计全新的交错结合架构,融合CNN与Transformer优势,实现细粒度特征提取与增强。该架构摒弃传统串行或并行模式,在各阶段交替混合CNN与Transformer,促进局部与全局信息交互,且双分支权重共享,不增加额外参数,有效降低模型参数量与计算复杂度。此架构包含两个关键轻量模块:Lightweight Convolutional Block(LCB)和Lightweight Transformer Block(LTB)。具体模块设计详见C小节,实验证实该架构在复杂场景下显著提升变化检测的精度与效率。

(3)Decoding Prediction Stage

在解码预测阶段,采用LTB与卷积预测头完成最终预测。鉴于图像边缘对变化检测完整性的重要性,设计边界感知增强模块(BAEM)作为辅助分支,专注于解码阶段的边缘特征增强。如图2所示,BAEM包含三个分支处理不同输入特征,具体输入为孪生编码器各层输出特征,以及边缘特征图。第一分支提取并增强变化信息,通过突出双时相图像变化区域,辅助模型识别变化位置;第二分支拼接两编码特征获取共同信息,在保留公共特征的同时强化变化区域显著性。第三分支利用边缘特征图优化增强后的变化信息,引入轻量级3-D注意力块SimAM,精准捕捉物体轮廓与细节,确保输出边缘的清晰度。三分支协同作用下,BAEM有效增强图像边缘特征,提升变化检测结果的精度与细节完整性,显著优化整体检测性能。

图2 BAEM的结构图

2.2 Lightweight Interleaved Structure

(1) Lightweight Convolutional Block

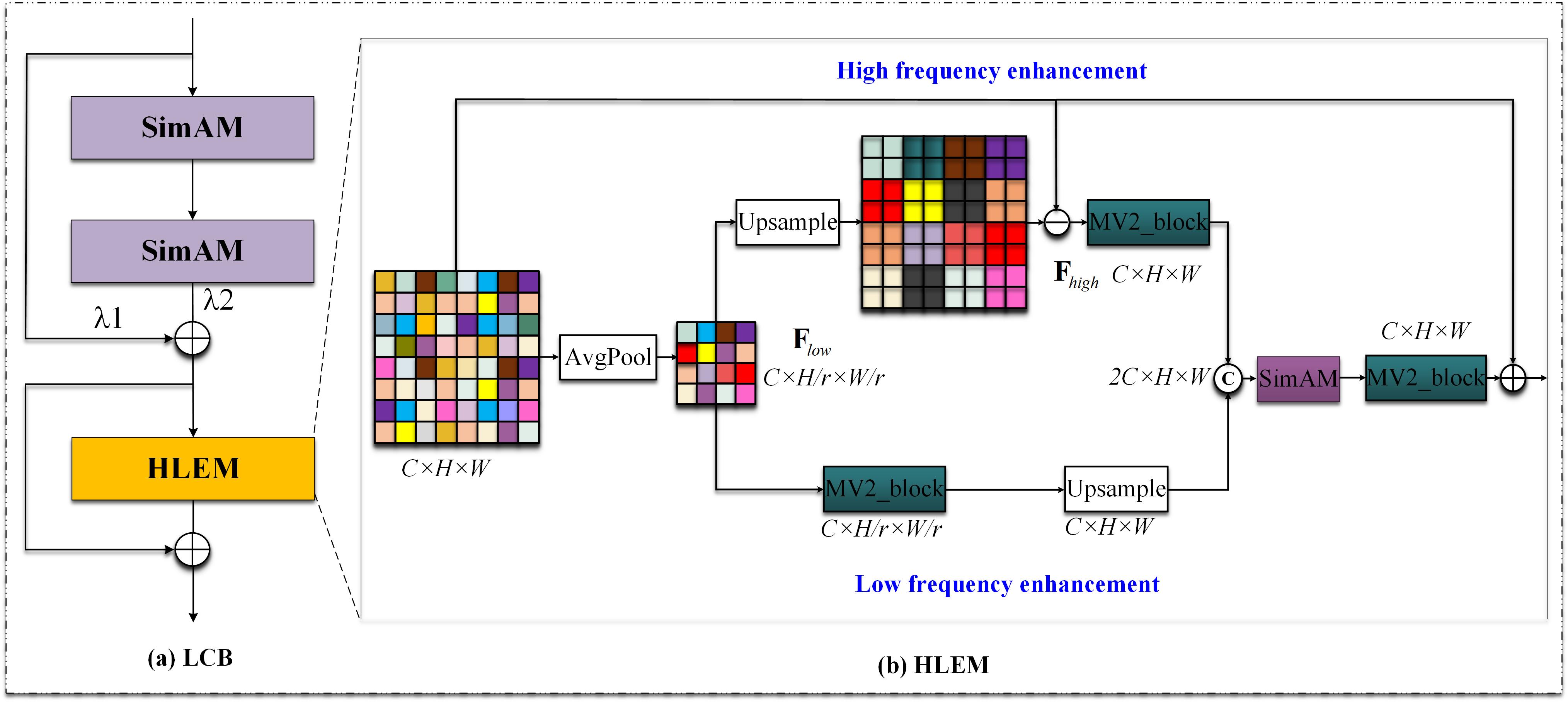

本文提出改进的轻量级卷积块LCB,如图3,通过集成注意力机制与空域增强技术提升变化检测性能。在LCB中,先利用两个轻量高效的SimAM注意力模块处理上一层信息,通过λ₁、λ₂自适应加权增强对变化区域的敏感性。为强化特征表达,引入高频-低频增强模块(HLEM)。针对频域信息提取复杂性及傅里叶变换嵌入CNN的难点,设计可微分空域增强方法实现高低频信息分离与融合。

图 3. LCB示意图

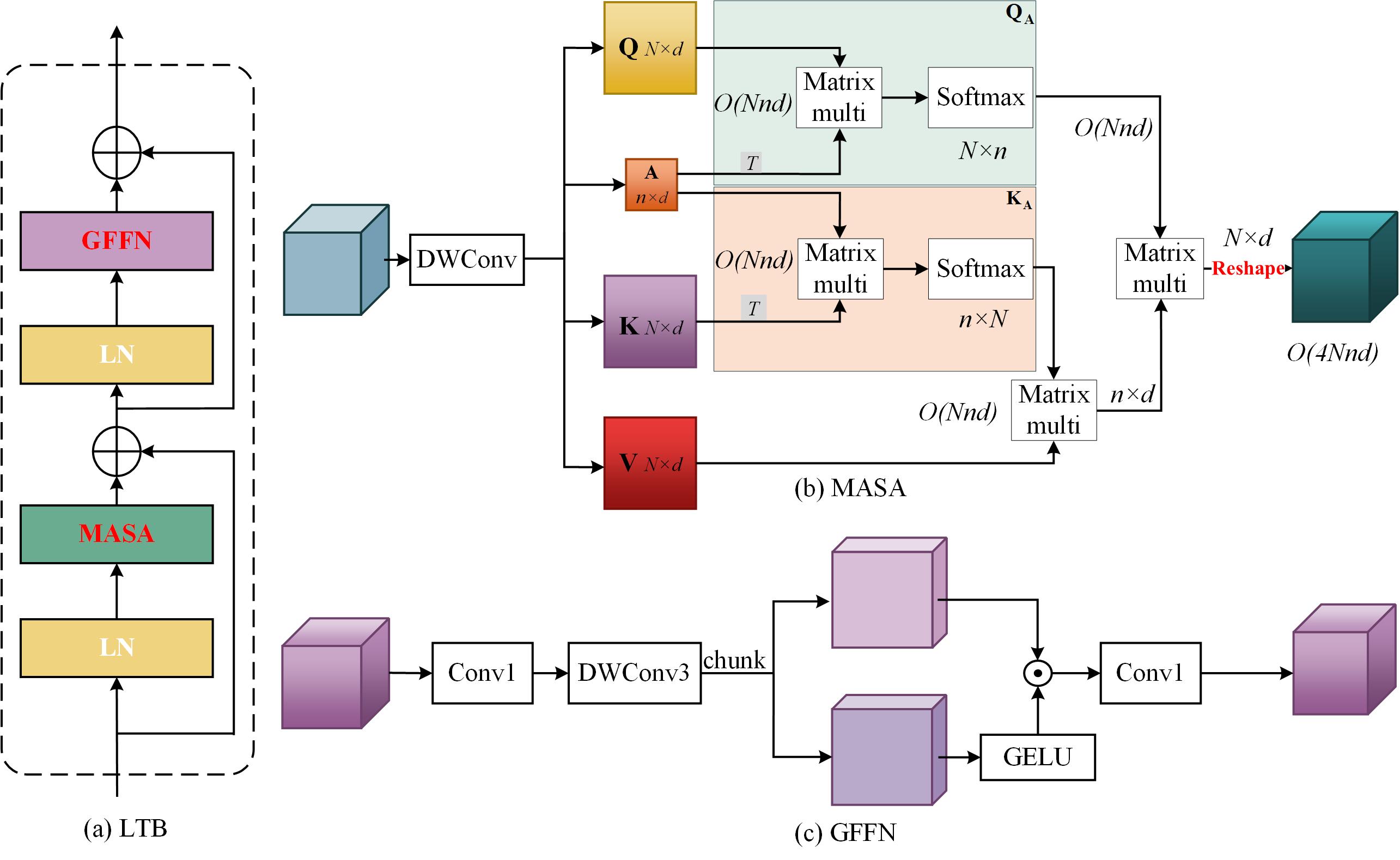

(2) Lightweight Transformer Block

LTB包含Mulit-Head Agent Self-Attention Module (MASA)和Gated Feed-Forward Network (GFFN),如图4所示。MASA通过语义代理注意力(Agent Attention),在降低计算复杂度的同时保留全局信息提取能力;GFFN通过门控机制抑制无效特征,实现特征的高效转换。针对传统自注意力计算复杂度高的问题,引入代理向量A将QKV三元组扩展为四元组,通过低维代理向量聚合全局信息,计算复杂度降至(N为查询向量数,n为代理向量数且n<<N,d为特征维度)。GFFN通过双分支结构增强特征表达:一支经GELU激活函数门控筛选重要特征,另一支直接处理局部上下文信息,实现冗余特征抑制与多尺度信息融合。通过MASA与GFFN的协同,LTB在保持高建模能力的同时实现计算效率优化,适用于遥感图像变化检测任务。

图 4. LTB示意图

3. 实验

为评估M2M-LINet的性能,本文选取SYSU-CD、WHU-CD和LEVIR-CD+三个高分辨率遥感图像变化检测数据集开展实验。将所提模型与14种主流方法(包括基于CNN、Transformer及混合架构的方法)进行对比,结果表明:M2M-LINet在三个数据集上的F1和DIP指标均显著优于对比方法,例如在SYSU-CD数据集上,F1分数比基于CNN的最佳方法DSAMNet高出5.85%,比基于Transformer的最佳方法EATDer高出3.15%,展现出更强的变化检测能力。

表1 对比实验结果

表2 消融实验结果

为验证所提出各模块的有效性,在三个数据集上进行了组件消融实验(见表2)。移除CALM模块(N02)或将其替换为ADConv卷积(N03)均导致性能显著下降,证实粗定位阶段的特征聚合对变化区域的有效定位至关重要。移除LCB模块(N04)或将其替换为普通卷积层(N07)后,三个数据集的F1分数分别下降0.82%、1.07%、1.7%,表明该模块在增强图像信息与提升检测性能中发挥关键作用。移除LTB模块(N08)、将MASA替换为线性注意力LA(N11)或GFFN替换为传统前馈网络FFN(N10),会导致F1分数下降0.43%、0.82%、2.35%,验证了其在全局信息提取与模型轻量化方面的优势。移除BAEM模块(N12)或边缘信息(N13)使F1分数下降0.75%、1.15%、1.04%,证明其在辅助解码过程中对边缘信息利用的关键作用。仅使用BCE损失(N14)或仅使用Dice损失(N15)的实验表明,混合损失函数的效果优于单一损失,能更显著提升模型性能。表3效率实验表明,M2M-LINet在实现高精度检测的同时,具有较低的计算复杂度和参数数量。与EATDer相比,尽管参数量相近,但其计算复杂度仅为后者的14%;在三个数据集上,该模型的F1分数最高,且FLOPs和Params均处于最低水平,实现了检测精度与计算效率的良好平衡,充分证明了其在遥感影像变化检测任务中的有效性和优越性。

表3 效率实验结果

4. 结论

本文提出了一种适用于遥感图像变化检测(RSICD)任务的轻量级 M2M-LINet 方法。该方法通过设计新型三阶段变化检测框架和轻量级交错架构,解决了当前 RSICD 任务中的主要问题。具体而言,三阶段框架从粗到细逐步完善变化信息:首先通过粗定位阶段获取变化的大致范围和位置;其次利用细节聚焦阶段对第一阶段的粗粒度信息进一步提取,以获得更精细的变化细节;最后通过解码预测阶段生成最终的变化检测结果。轻量级交错架构通过 LCB 和 LTB 组件实现高效的局部 - 全局信息交互,同时保持方法的轻量特性。在三个变化检测公开数据集上的实验结果表明,该方法在变化检测精度、参数数量和浮点运算量(FLOPs)方面均优于其他对比方法。

5. 参考文献

[1] R. C. Daudt, B. Le Saux, and A. Boulch, "Fully convolutional Siamese networks for change detection," in Proc. 25th IEEE Int. Conf. Image Process. (ICIP), Oct. 2018, pp. 4063-4067.

[2] T. Lei, Y. Zhang, Z. Lv, S. Li, S. Liu, and A. K. Nandi, "Landslide Inventory Mapping from Bitemporal Images Using Deep Convolutional Neural Networks," IEEE Geosci. Remote Sens. Lett., vol. 16, no. 6, pp. 982–986, Jun. 2019.

[3] H. Chen and Z. Shi, “A spatial–temporal attention-based method and a new dataset for remote sensing image change detection,” Remote Sens., vol. 12, no. 10, p. 1662, 2020.

[4] C. Zhang et al., “A deeply supervised image fusion network for change detection in high resolution bi-temporal remote sensing images,” ISPRS J. Photogramm. Remote Sens., vol. 166, pp. 183–200, Aug. 2020.

[5] M. Zhang and W. Shi, " A Feature Difference Convolutional Neural Network-Based Change Detection Method," IEEE Trans. Geosci. Remote Sens., vol. 58, no. 10, pp. 7232-7246, Oct. 2020.

[6] S. Fang, K. Li, J. Shao, and Z. Li, "SNUNet-CD: A Densely Connected Siamese Network for Change Detection of VHR Images," IEEE Geosci. Remote Sens. Lett., vol. 19, pp. 1–5, 2022.

[7] Q. Shi, M. Liu, S. Li, X. Liu, F. Wang, and L. Zhang, " A Deeply Supervised Attention Metric-Based Network and an Open Aerial Image Dataset for Remote Sensing Change Detection," IEEE Trans. Geosci.Remote Sens., vol. 60, 2022, Art. no. 5604816.

[8] H. Chen, Z. Qi, and Z. Shi, "Remote Sensing Image Change Detection with Transformers," IEEE Trans. Geosci. Remote Sens., vol. 60, pp. 1-14, 2022, Art no. 5607514.

[9] Y. Feng, H. Xu, J. Jiang, H. Liu, and J. Zheng, "ICIF-Net: Intra-Scale Cross-Interaction and Inter-Scale Feature Fusion Network for Bitemporal Remote Sensing Images Change Detection," IEEE Trans. Geosci. Remote Sens., vol. 60, pp. 1-13, 2022, Art no. 4410213.

[10] X. Tang, T. Zhang, J. Ma, X. Zhang, F. Liu, and L. Jiao, "WNet: W-Shaped Hierarchical Network for Remote-Sensing Image Change Detection," IEEE Trans. Geosci. Remote Sens., vol. 61, pp. 1-14, 2023, Art no. 5615814.

[11] D. Xue et al., "Triple Change Detection Network via Joint Multifrequency and Full-Scale Swin-Transformer for Remote Sensing Images," IEEE Trans. Geosci. Remote Sens., vol. 61, pp. 1-15, 2023, Art no. 4408415.

[12] J. Ma, J. Duan, X. Tang, X. Zhan, and L. Jiao, "EATDer: Edge-Assisted Adaptive Transformer Detector for Remote Sensing Change Detection," IEEE Trans. Geosci. Remote Sens., vol. 62, pp. 1-15, 2024, Art no. 5602015.

浙公网安备 33010602011771号

浙公网安备 33010602011771号