第三章:神经网络入门

第三章:神经网络入门

1.二分类问题

这里介绍一个二分类问题,根据电影的评论,划分正面或负面的评论。

1.1 IMDB数据集

IMDB 数据集,包含来自互联网电影数据库(IMDB)的 50 000 条严重两极分化的评论。数据集被分为用于训练的 25 000 条评论与用于测试的 25 000 条评论,训练集和测试集都包含 50% 的正面评论和 50% 的负面评论。

1.2 神经网络建模

from keras.datasets import imdb import numpy as np from keras import models from keras import layers import matplotlib.pyplot as plt #num_words=10000 的意思是仅保留训练数据中前 10 000 个最常出现的单词 #train_data和test_data 这两个变量都是评论组成的列表,每条评论又是单词索引组成 #的列表(表示一系列单词)。 train_labels 和 test_labels 都是 0 和 1 组成的列表,其中 0 #代表负面(negative), 1 代表正面(positive) (train_data, train_labels), (test_data, test_labels) = imdb.load_data(num_words=10000) def vectorize_sequences(sequences,dimension=10000): """ 把整数列表转为二进制矩阵 one-hot编码 """ results = np.zeros((len(sequences),dimension)) for i,sequence in enumerate(sequences): results[i,sequence] = 1. return results #输入数据转化为张量one-hot编码 x_train = vectorize_sequences(train_data) x_test = vectorize_sequences(test_data) #标签向量化 y_train = np.asarray(train_labels).astype('float32') y_test = np.asarray(test_labels).astype('float32') #构建网络 model = models.Sequential() model.add(layers.Dense(16,activation='relu',input_shape=(10000,))) model.add(layers.Dense(16,activation='relu')) model.add(layers.Dense(1,activation='sigmoid')) #编译模型 model.compile(optimizer='rmsprop',loss='binary_crossentropy',metrics=['accuracy']) #留出验证集 x_val = x_train[:10000] partial_x_train = x_train[10000:] y_val = y_train[:10000] partial_y_train = y_train[10000:] #训练模型 history = model.fit(partial_x_train, partial_y_train, epochs=20, batch_size=512, validation_data=(x_val,y_val)) # 绘制训练损失与经验损失 history_dict = history.history loss_values = history_dict['loss'] val_loss_values = history_dict['val_loss'] epochs = range(1, len(loss_values) + 1) plt.plot(epochs, loss_values, 'bo', label='Training loss') plt.plot(epochs, val_loss_values, 'b', label='Validation loss') plt.title('Training and validation loss') plt.xlabel('Epochs') plt.ylabel('Loss') plt.legend() plt.show() #绘制训练精度与训练精度 plt.clf() acc = history_dict['acc'] val_acc = history_dict['val_acc'] plt.plot(epochs, acc, 'bo', label='Training acc') plt.plot(epochs, val_acc, 'b', label='Validation acc') plt.title('Training and validation accuracy') plt.xlabel('Epochs') plt.ylabel('Accuracy') plt.legend() plt.show()

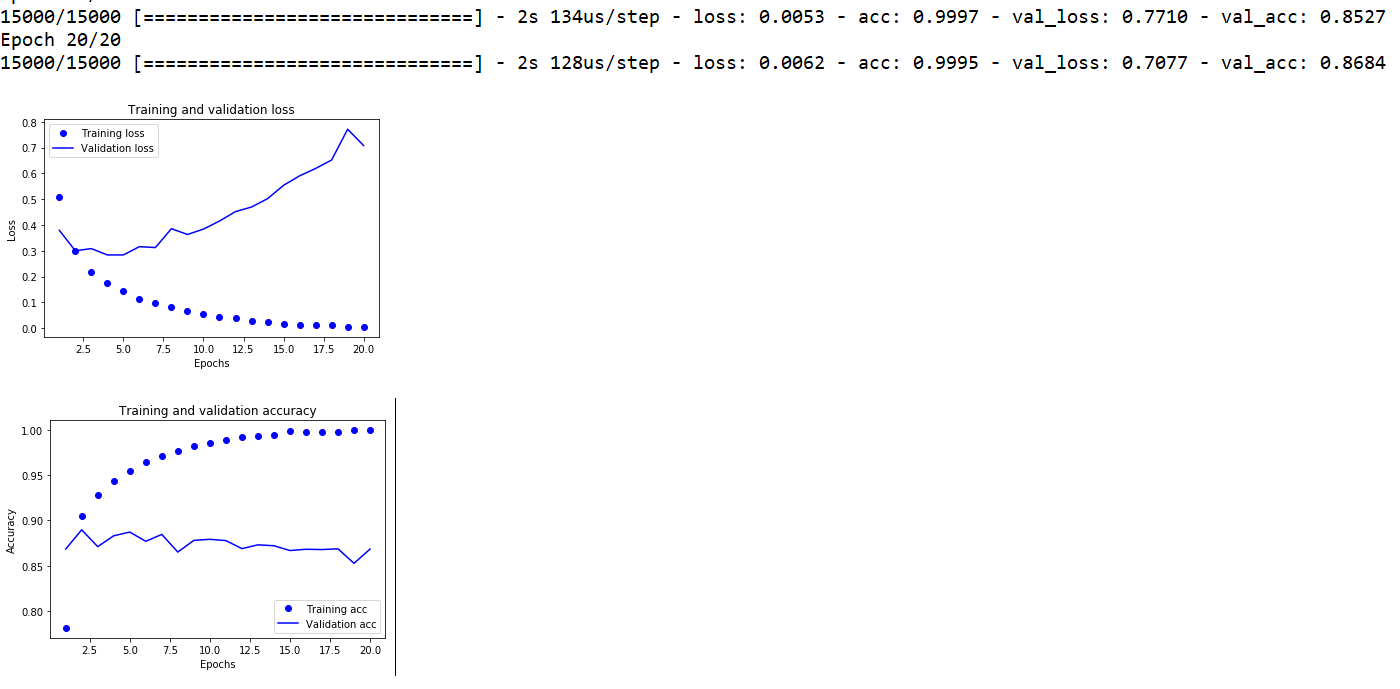

结果如下:

由上图可知,模型在第3轮之后,发生了过拟合,所以可以提前终止模型的训练

model.fit(x_train, y_train, epochs=4, batch_size=512) results = model.evaluate(x_test, y_test)

model.predict(x_test)

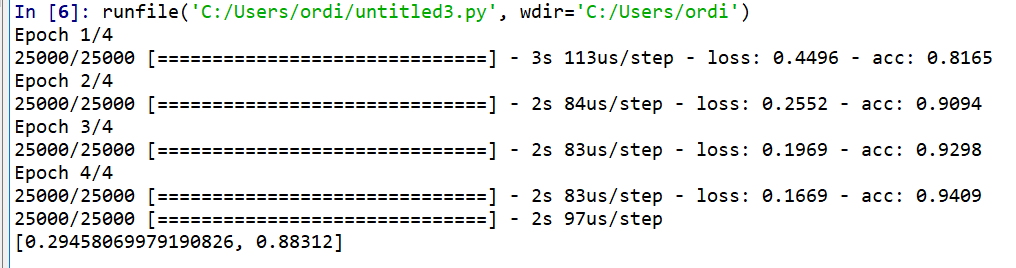

执行结果如下:

测试集上的精度是: 0.88312

1.3 神经网络建模二分类问题总结

通常需要对原始数据进行大量预处理,以便将其转换为张量输入到神经网络中。单词序列可以编码为二进制向量,但也有其他编码方式。

- 带有 relu 激活的 Dense 层堆叠,可以解决很多种问题(包括情感分类),你可能会经常用到这种模型。

- 对于二分类问题(两个输出类别),网络的最后一层应该是只有一个单元并使用 sigmoid激活的 Dense 层,网络输出应该是 0~1 范围内的标量,表示概率值。

- 对于二分类问题的 sigmoid 标量输出,你应该使用 binary_crossentropy 损失函数。

- 无论你的问题是什么, rmsprop 优化器通常都是足够好的选择。这一点你无须担心。

- 随着神经网络在训练数据上的表现越来越好,模型最终会过拟合,并在前所未见的数据上得到越来越差的结果。一定要一直监控模型在训练集之外的数据上的性能。

2.多分类问题

2.1 路透社数据集

本节使用路透社数据集,它包含许多短新闻及其对应的主题,由路透社在 1986 年发布。它是一个简单的、广泛使用的文本分类数据集。它包括 46 个不同的主题:某些主题的样本更多,

但训练集中每个主题都有至少 10 个样本

2.2神经网络构建多分类模型

python代码如下:

from keras.datasets import reuters import numpy as np from keras import models from keras import layers import matplotlib.pyplot as plt from keras.utils.np_utils import to_categorical #num_words=10000 的意思是仅保留训练数据中前 10 000 个最常出现的单词 (train_data, train_labels), (test_data, test_labels) = reuters.load_data(num_words=10000) def vectorize_sequences(sequences,dimension=10000): """ 把整数列表转为二进制矩阵 one-hot编码 """ results = np.zeros((len(sequences),dimension)) for i,sequence in enumerate(sequences): results[i,sequence] = 1. return results def to_one_hot(labels, dimension=46): """ 标签 one-hot 处理,类似于方法to_categorical """ results = np.zeros((len(labels),dimension)) for i,label in enumerate(labels): results[i,label] = 1. return results #输入数据转化为张量one-hot编码 x_train = vectorize_sequences(train_data) x_test = vectorize_sequences(test_data) #标签one-hot处理 one_hot_train_labels = to_categorical(train_labels) one_hot_test_labels = to_categorical(test_labels) #构建多分类网络 model = models.Sequential() model.add(layers.Dense(64,activation='relu',input_shape=(10000,))) model.add(layers.Dense(64,activation='relu')) model.add(layers.Dense(46,activation='softmax')) #编译模型 model.compile(optimizer='rmsprop',loss='categorical_crossentropy',metrics=['accuracy']) #留出验证集 x_val = x_train[:1000] partial_x_train = x_train[1000:] y_val = one_hot_train_labels[:1000] partial_y_train = one_hot_train_labels[1000:] #训练模型 history = model.fit(partial_x_train, partial_y_train, epochs=20, batch_size=512, validation_data=(x_val, y_val)) # 绘制训练损失与经验损失 history_dict = history.history loss_values = history_dict['loss'] val_loss_values = history_dict['val_loss'] epochs = range(1, len(loss_values) + 1) plt.plot(epochs, loss_values, 'bo', label='Training loss') plt.plot(epochs, val_loss_values, 'b', label='Validation loss') plt.title('Training and validation loss') plt.xlabel('Epochs') plt.ylabel('Loss') plt.legend() plt.show() #绘制训练精度与训练精度 plt.clf() acc = history_dict['acc'] val_acc = history_dict['val_acc'] plt.plot(epochs, acc, 'bo', label='Training acc') plt.plot(epochs, val_acc, 'b', label='Validation acc') plt.title('Training and validation accuracy') plt.xlabel('Epochs') plt.ylabel('Accuracy') plt.legend() plt.show()

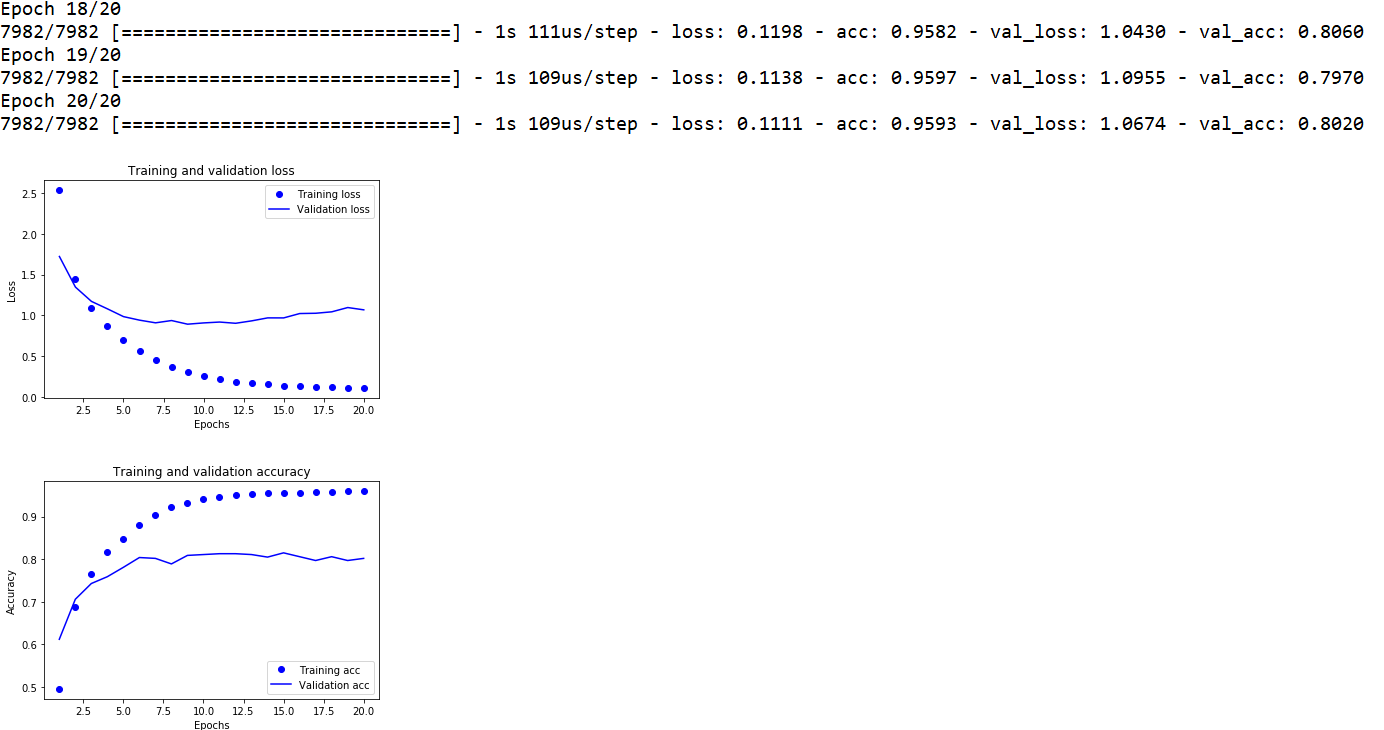

执行结果

第9轮后,过拟合了

model.compile(optimizer='rmsprop', loss='categorical_crossentropy', metrics=['accuracy']) model.fit(partial_x_train, partial_y_train, epochs=9, batch_size=512, validation_data=(x_val, y_val)) results = model.evaluate(x_test, one_hot_test_labels)

#在新数据集上预测

predictions = model.predict(x_test)

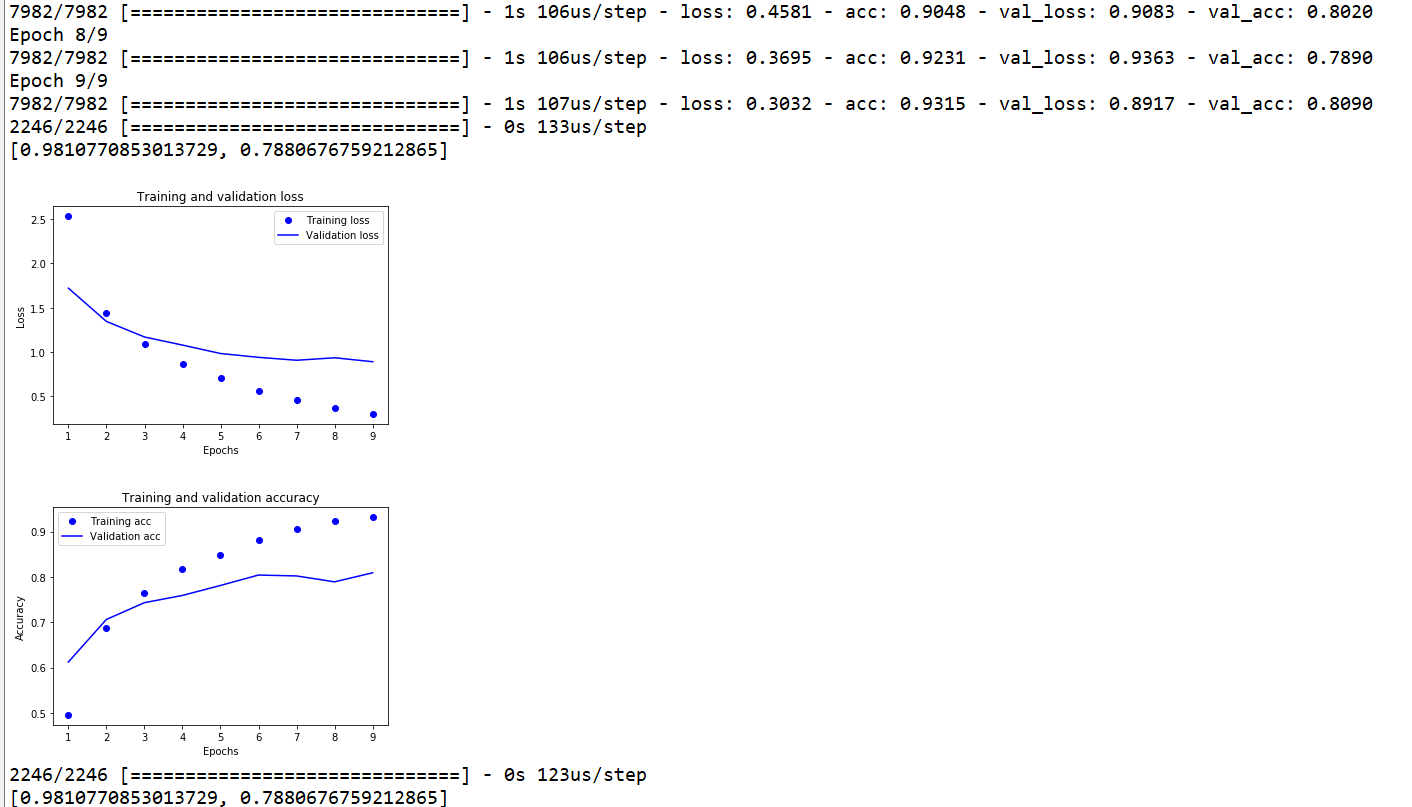

结果如下:

2.2神经网络构建多分类模型总结

- 如果要对 N 个类别的数据点进行分类,网络的最后一层应该是大小为 N 的 Dense 层。

- 对于单标签、多分类问题,网络的最后一层应该使用 softmax 激活,这样可以输出在 N个输出类别上的概率分布。

- 这种问题的损失函数几乎总是应该使用分类交叉熵。它将网络输出的概率分布与目标的真实分布之间的距离最小化。

- 处理多分类问题的标签有两种方法。

a.通过分类编码(也叫 one-hot 编码)对标签进行编码,然后使用 categorical_crossentropy 作为损失函数。

b.将标签编码为整数,然后使用 sparse_categorical_crossentropy 损失函数

- 如果你需要将数据划分到许多类别中,应该避免使用太小的中间层,以免在网络中造成信息瓶颈。

浙公网安备 33010602011771号

浙公网安备 33010602011771号