7.Spark SQL

1.请分析SparkSQL出现的原因,并简述SparkSQL的起源与发展。

关系数据库在大数据时代已经不能满足要求

首先,用户需要从不同数据源执行各种操作,包括结构化、半结构化和非结构化数据

其次,用户需要执行高级分析,比如机器学习和图像处理

在实际大数据应用中,经常需要融合关系查询和复杂分析算法(比如机器学习或图像处理),但是,缺少这样的系统

Spark SQL填补了这个鸿沟:

首先,可以提供DataFrame API,可以对内部和外部各种数据源执行各种关系型操作

其次,可以支持大数据中的大量数据源和数据分析算法

Spark SQL可以融合:传统关系数据库的结构化数据管理能力和机器学习算法的数据处理能力

2. 简述RDD 和DataFrame的联系与区别?

DataFrame的推出,让Spark具备了处理大规模 结构化数据的能力,不仅比原有的RDD转化方式更加简单易用,而且获得了更高的计算性能

RDD是分布式的 Java对象的集合,但是,对象内部结构对于RDD而言却是不可知的

DataFrame是一种以RDD为基础的分布式数据集,提供了详细的结构信息

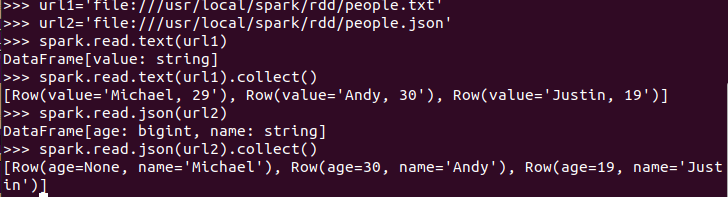

3.DataFrame的创建

spark.read.text(url)

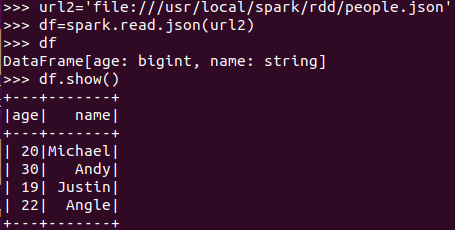

spark.read.json(url) 注意从不同文件类型生成DataFrame的区别。

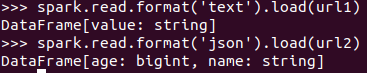

spark.read.format("text").load("people.txt")

spark.read.format("json").load("people.json")

4. PySpark-DataFrame各种常用操作

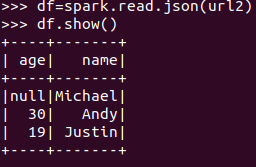

打印数据 df.show()默认打印前20条数据

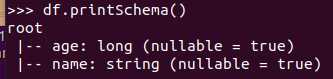

打印概要 df.printSchema()

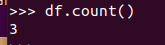

查询总行数 df.count()

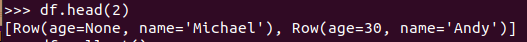

df.head(3) #list类型,list中每个元素是Row类

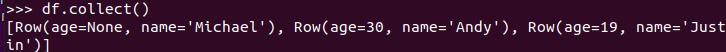

输出全部行 df.collect() #list类型,list中每个元素是Row类

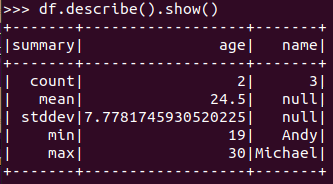

查询概况 df.describe().show()

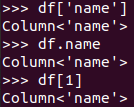

取列 df[‘name’], df.name, df[1]

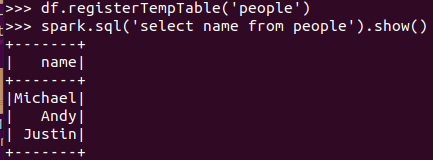

创建临时表虚拟表 df.registerTempTable('people')

spark.sql执行SQL语句 spark.sql('select name from people').show()

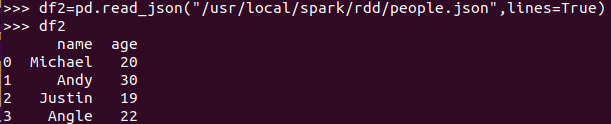

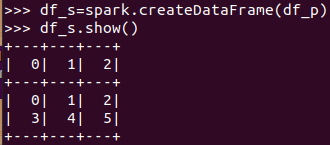

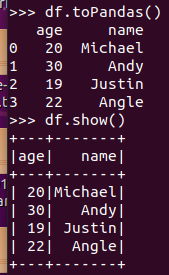

5. Pyspark中DataFrame与pandas中DataFrame

分别从文件创建DataFrame

pandas中DataFrame转换为Pyspark中DataFrame

Pyspark中DataFrame转换为pandas中DataFrame

6.从RDD转换得到DataFrame

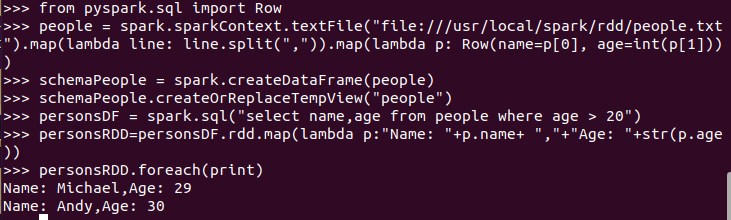

6.1 利用反射机制推断RDD模式

创建RDD sc.textFile(url).map(),读文件,分割数据项

每个RDD元素转换成 Row

由Row-RDD转换到DataFrame

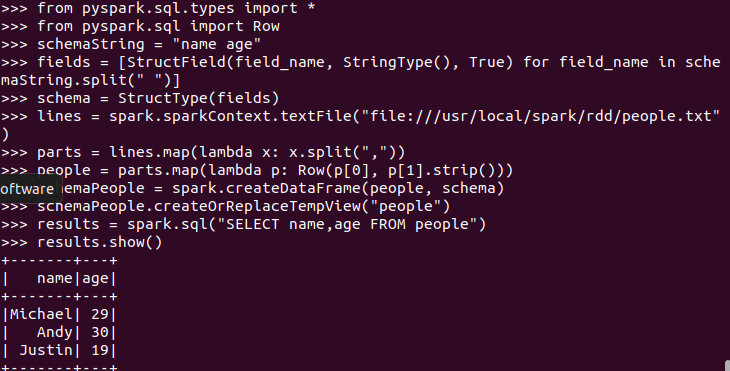

6.2 使用编程方式定义RDD模式

#下面生成“表头”

#下面生成“表中的记录”

#下面把“表头”和“表中的记录”拼装在一起

浙公网安备 33010602011771号

浙公网安备 33010602011771号