人工智能入门

确定性计算,符号主义(早期人工智能)

不确定性计算:建模、机器学习(世界的随机性、不确定性和动态性 - 需要模式识别(学习)的能力,从数据中总结规律)

智能即学习。人类的学习,是有类比思维的,得出方法论、哲学;机器的学习,只是在训练特征参数,没有灵性。

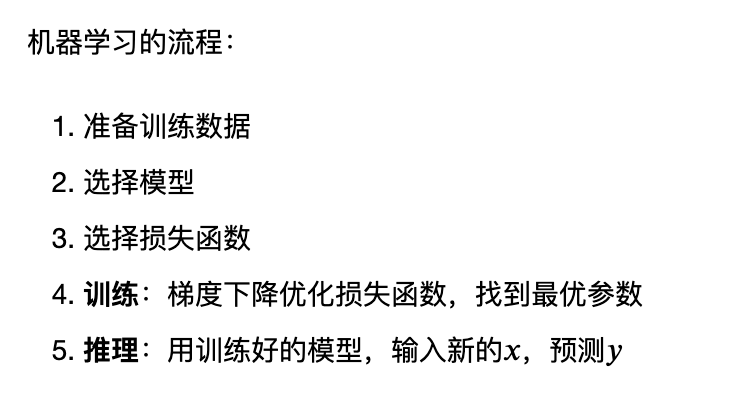

机器学习常见的问题

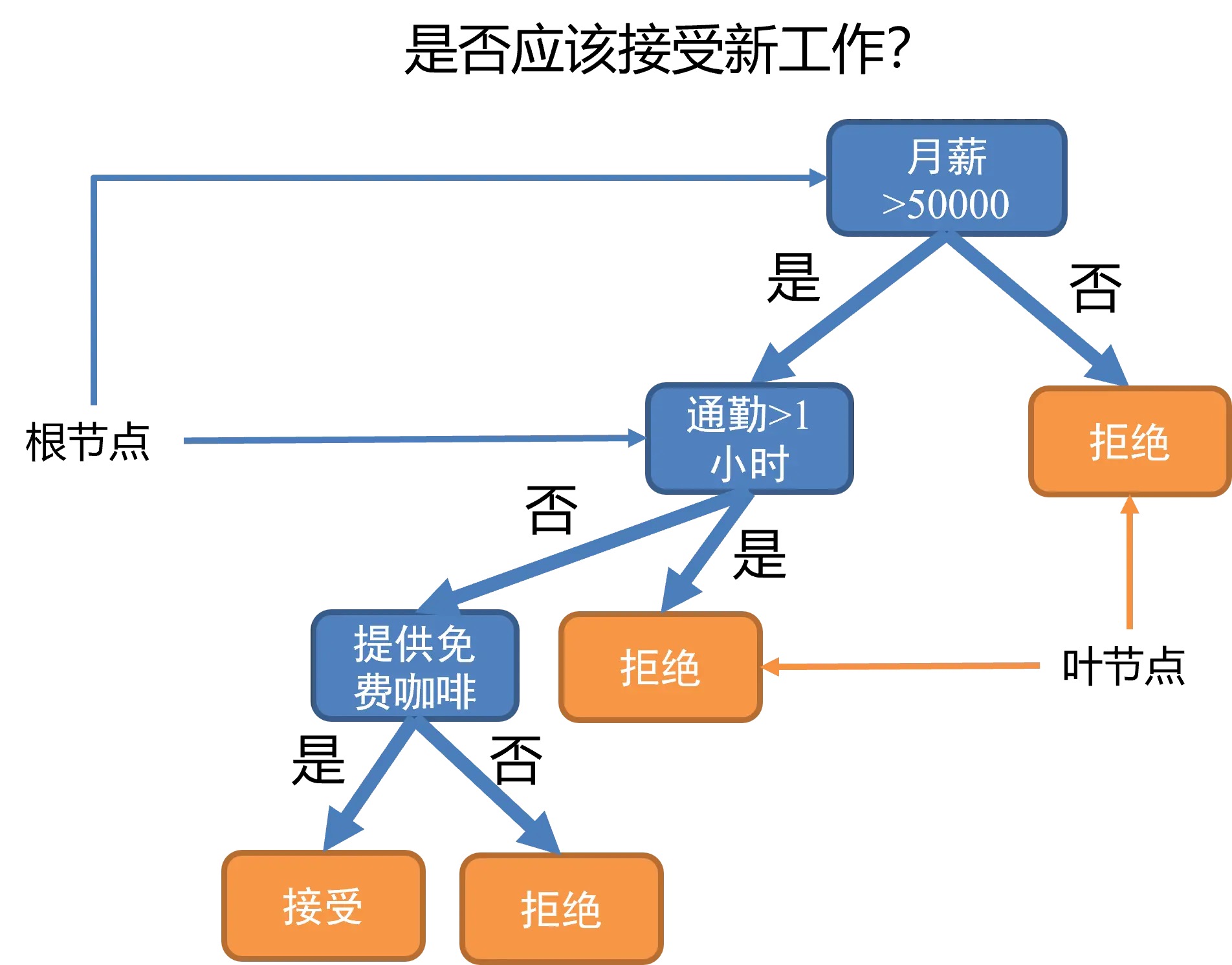

机器学习的经典模型,决策树

信息熵,表示信息量的大小。越不确定的信息,信息熵越大,信息的“纯度”越低。

信息增益,经过某个分支后,信息熵的减小量。某个分支的信息增益越大,则该分支对样本集划分所获得的“纯度”越大,信息不确定性减少的程度越大。

仿生派:如果我们想要学飞翔,就得向“飞鸟”来学习。

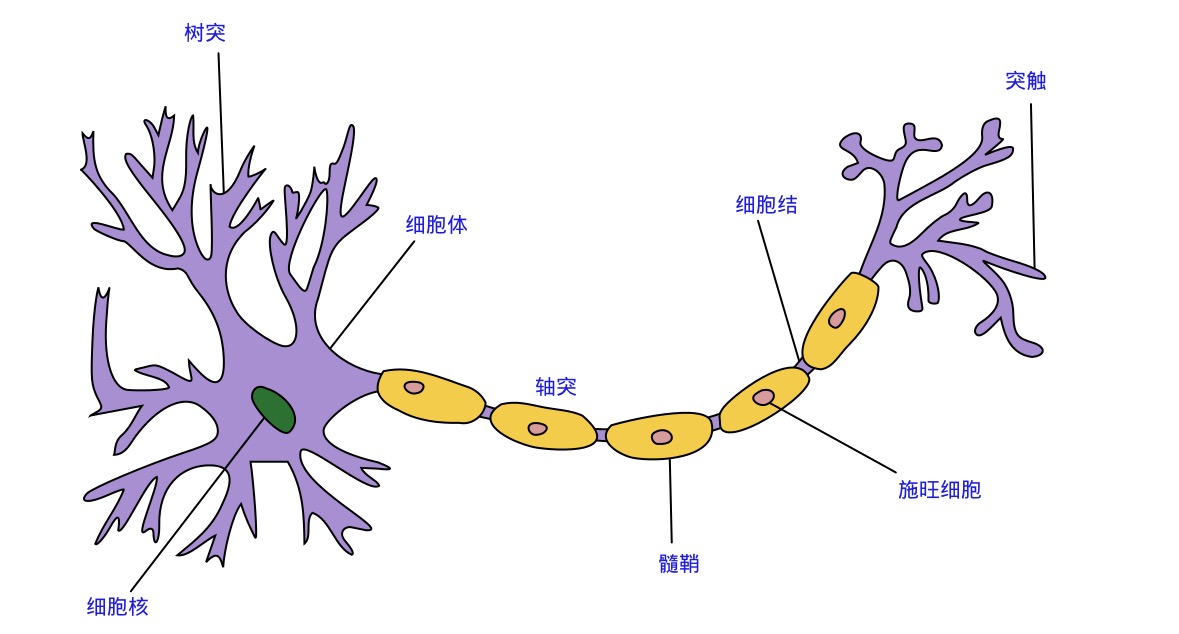

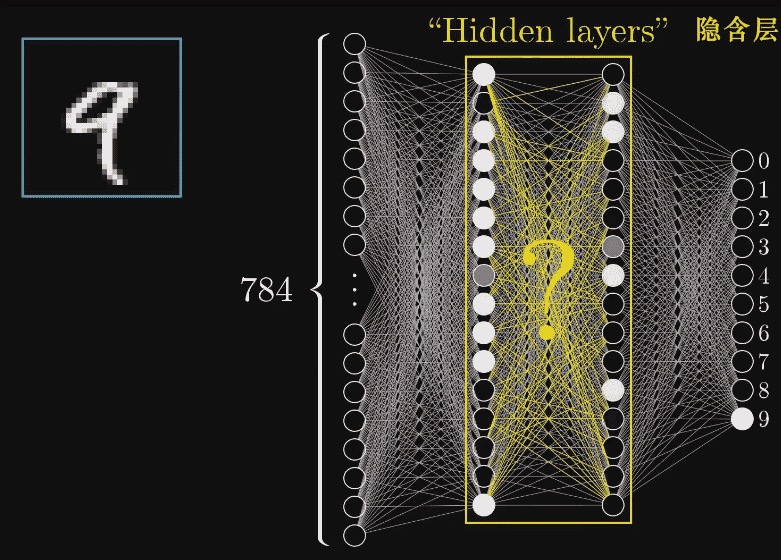

神经网络:模拟人脑神经元的连接来达到学习功能,通过逐层抽象将输入数据逐层映射为概念等高等语义。

神经网络 & 深度学习。模拟神经元信号传递,分层构建模型、分层训练学习。

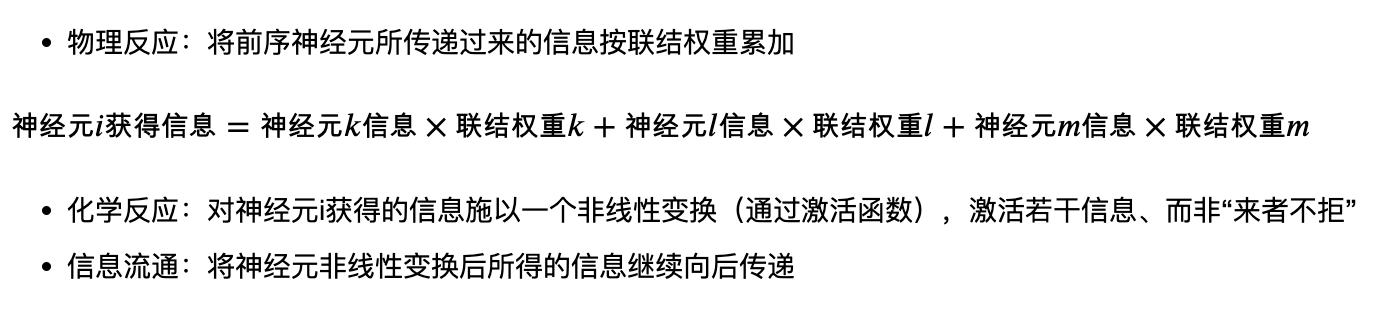

神经元的功能:

激活函数:决定激活下游的哪些神经元的函数???

在神经网络中,激活函数的作用可以类比成“开关”或“过滤器”,帮助网络决定是否应该“激活”某个神经元,以便更好地提取和处理数据的特征。

举个通俗的例子,想象一个“灯泡神经元”:假设你在一个暗房间里,有一排灯泡,每个灯泡都有一个开关。你希望灯泡亮起来的情况是它们受到适合的电压刺激。这种电压输入就像是神经元接收到的输入信号。而激活函数就好比开关的“敏感度设置”,决定电压必须达到什么程度灯泡才会亮。如果电压(即输入信号)达不到设定的激活值,灯泡就不会亮;而一旦超过这个值,灯泡才会亮起来。这样,通过“亮”或“不亮”的状态,灯泡为整个系统传递了有用的信息。

在实际的神经网络中,激活函数会引入非线性,就像设置开关的阈值,帮助神经网络处理复杂的非线性问题。例如,最常见的激活函数之一 ReLU(Rectified Linear Unit)就类似于一个“直通开关”:它会让输入大于0的信号通过,小于0的则过滤掉。这种处理方式让网络在处理图像、语音等复杂任务时更高效和准确。

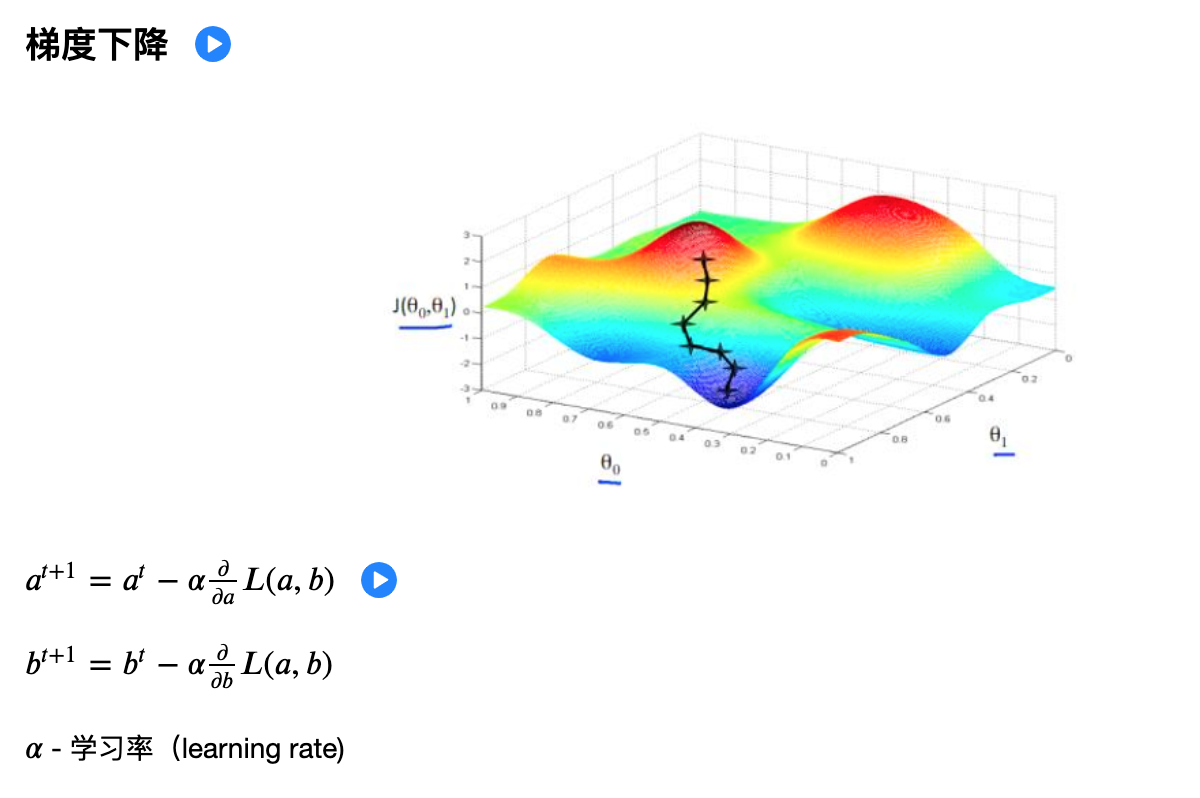

反向传播:求解出神经网络模型中权重层对代价函数的偏导数,然后我们就可以使用梯度下降法来更新模型权重。

几种经典神经网络:

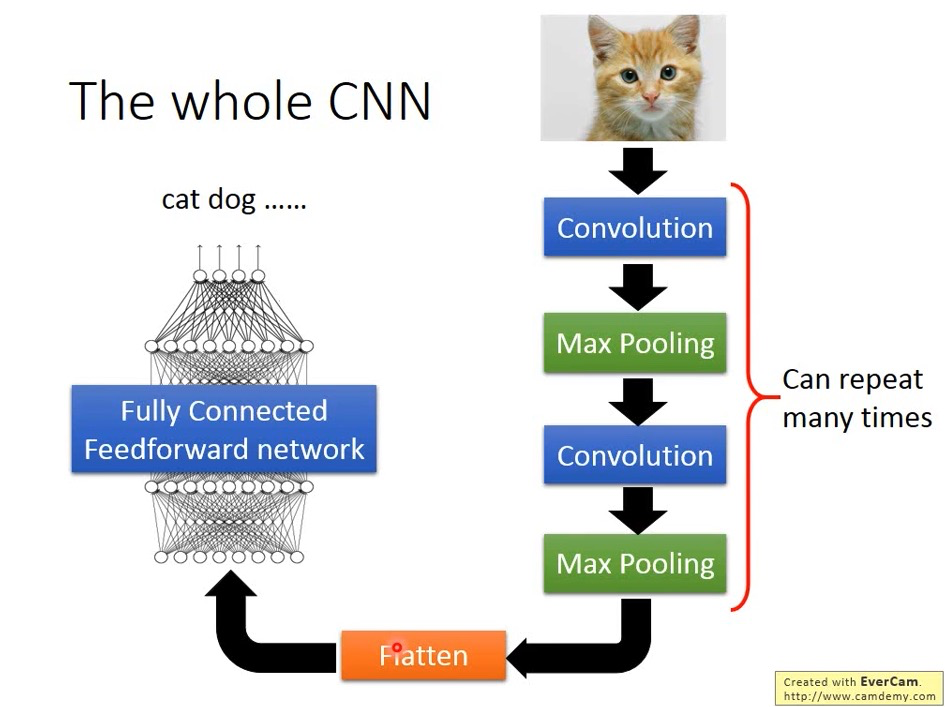

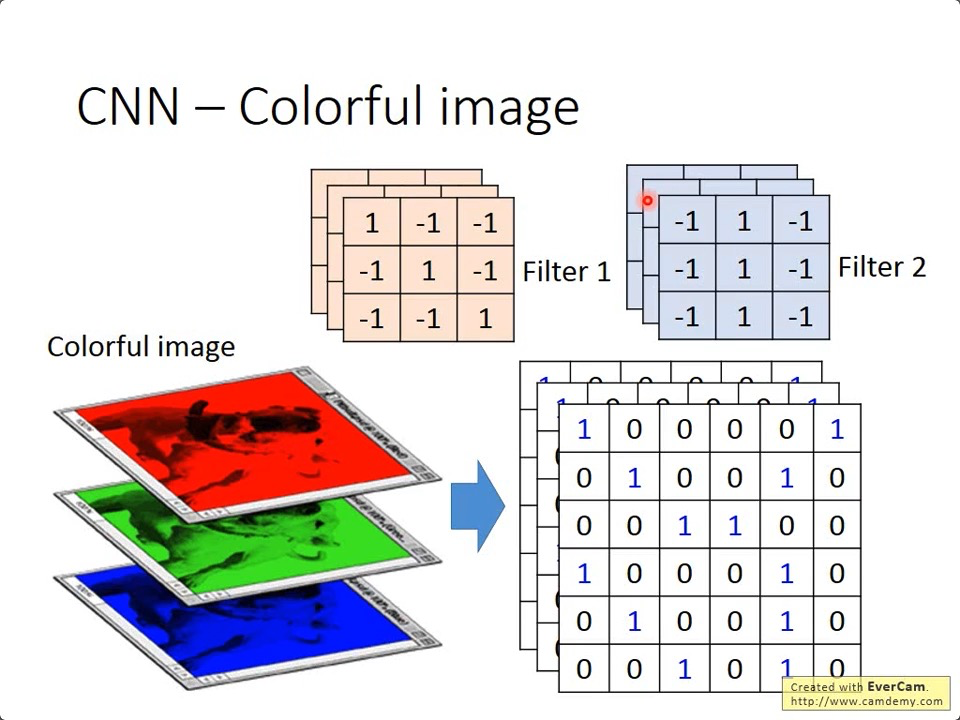

卷积神经网络(CNN),对空间拓扑相关的数据建模。一般应用是图片识别、智能驾驶等

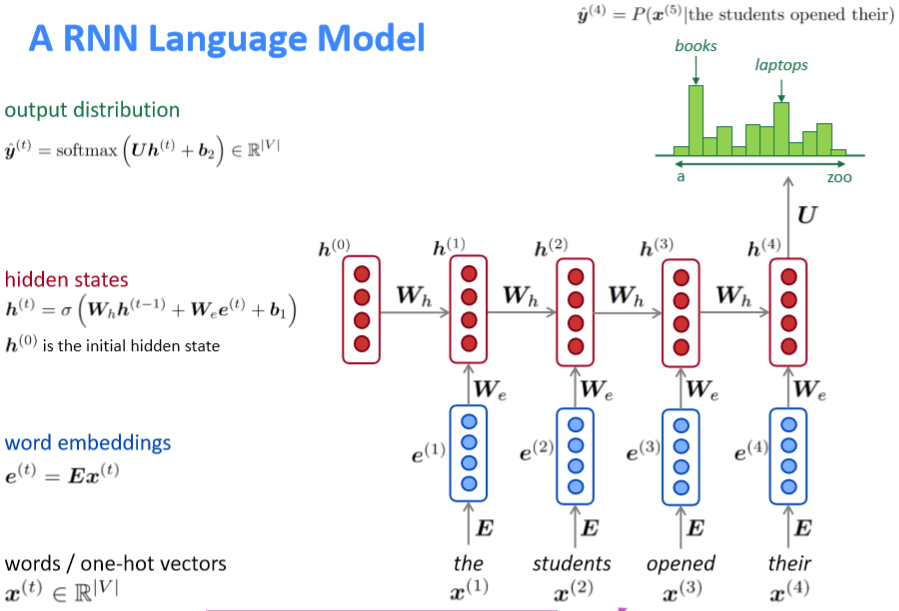

循环神经网络(RNN),对顺序敏感的序列数据进行建模。一般应用是预测计算、自然语言处理等

浙公网安备 33010602011771号

浙公网安备 33010602011771号