Spark 2.x管理与开发-Spark的算子(一)RDD基础*

1)什么是RDD?

RDD(Resilient Distributed Dataset)叫做弹性分布式数据集,是Spark中最基本的数据抽象(也就是Spark处理的数据,都是RDD),它代表一个不可变、可分区、里面的元素可并行计算的集合。

RDD具有数据流模型的特点:自动容错、位置感知性调度和可伸缩性。RDD允许用户在执行多个查询时显式地将工作集缓存在内存中,后续的查询能够重用工作集,这极大地提升了查询速度。

可以把RDD理解成:一堆数据+一堆函数就可以了。

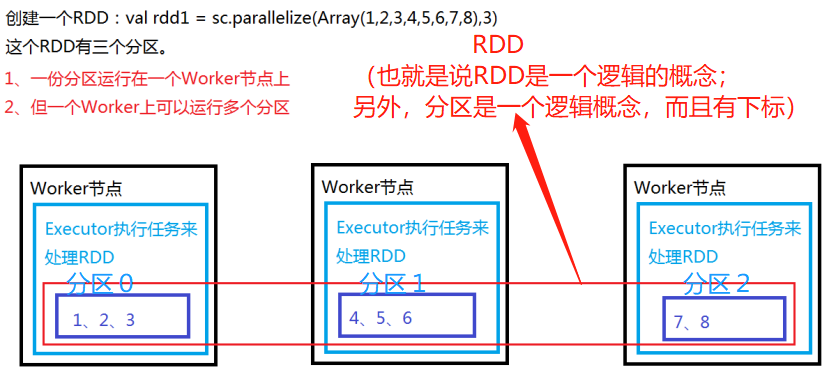

这堆函数就是用来操作这堆数据的,而这堆数据分布在分区里,分区又分布在各个节点里面,

所以RDD是一个逻辑概念,分区是一个物理概念。

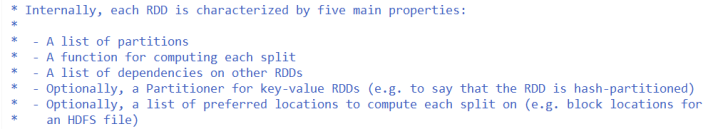

2)RDD的属性(源码中的一段话)

Spark-RDD的API:

https://spark.apache.org/docs/2.1.0/api/scala/#org.apache.spark.rdd.RDD

(1)一组分区(Partition),即数据集的基本组成单位。对于RDD来说,每个分片都会被一个计算任务处理,并决定并行计算的粒度。用户可以在创建RDD时指定RDD的分片个数,如果没有指定,那么就会采用默认值。默认值就是程序所分配到的CPU Core的数目。

理解:RDD是由分区组成(RDD就是一个分区的集合),每个分区运行在不同的worker上,通过这种方式,实现了分布式计算。

(2)一个计算每个分区的函数。Spark中RDD的计算是以分片为单位的,每个RDD都会实现compute函数以达到这个目的。compute函数会对迭代器进行复合,不需要保存每次计算的结果。

理解:在RDD中有一系列函数,用于处理计算每个分区中的数据。函数称作算子。

算子包含两部分:(1)Transformation:延时计算 lazy修饰 (重点)

(2)Action:立即执行计算 collect saveAsTextFile

(3)RDD之间的依赖关系。RDD的每次转换都会生成一个新的RDD,所以RDD之间就会形成类似于流水线一样的前后依赖关系。在部分分区数据丢失时,Spark可以通过这个依赖关系重新计算丢失的分区数据,而不是对RDD的所有分区进行重新计算。

理解:RDD之间由于不同的转换关系,彼此存在依赖关系。

(4)一个Partitioner,即RDD的分片函数。当前Spark中实现了两种类型的分片函数,一个是基于哈希的HashPartitioner,另外一个是基于范围的RangePartitioner。只有对于于key-value的RDD,才会有Partitioner,非key-value的RDD的Parititioner的值是None。Partitioner函数不但决定了RDD本身的分片数量,也决定了parent RDD Shuffle输出时的分片数量。

理解:创建RDD时,可以自定义分区规则,这类似于MapReduce中的分区。

(5)一个列表,存储存取每个Partition的优先位置(preferred location)。对于一个HDFS文件来说,这个列表保存的就是每个Partition所在的块的位置。按照“移动数据不如移动计算”的理念,Spark在进行任务调度的时候,会尽可能地将计算任务分配到其所要处理数据块的存储位置。

理解:优先选择离文件位置近的节点执行程序

3)RDD的创建方式

- 通过外部的数据文件创建,如HDFS

val rdd1 = sc.textFile(“hdfs://192.168.88.111:9000/data/data.txt”)

所以,HDFS可以视为一块巨大无比的硬盘,只是调用时的名字较为复杂。

- 通过sc.parallelize进行创建

val rdd1 = sc.parallelize(Array(1,2,3,4,5,6,7,8))

- RDD的类型:Transformation和Action

4)RDD的基本原理

浙公网安备 33010602011771号

浙公网安备 33010602011771号