5.深度学习的经典模型

-

RNN - Recurrent Neural Network

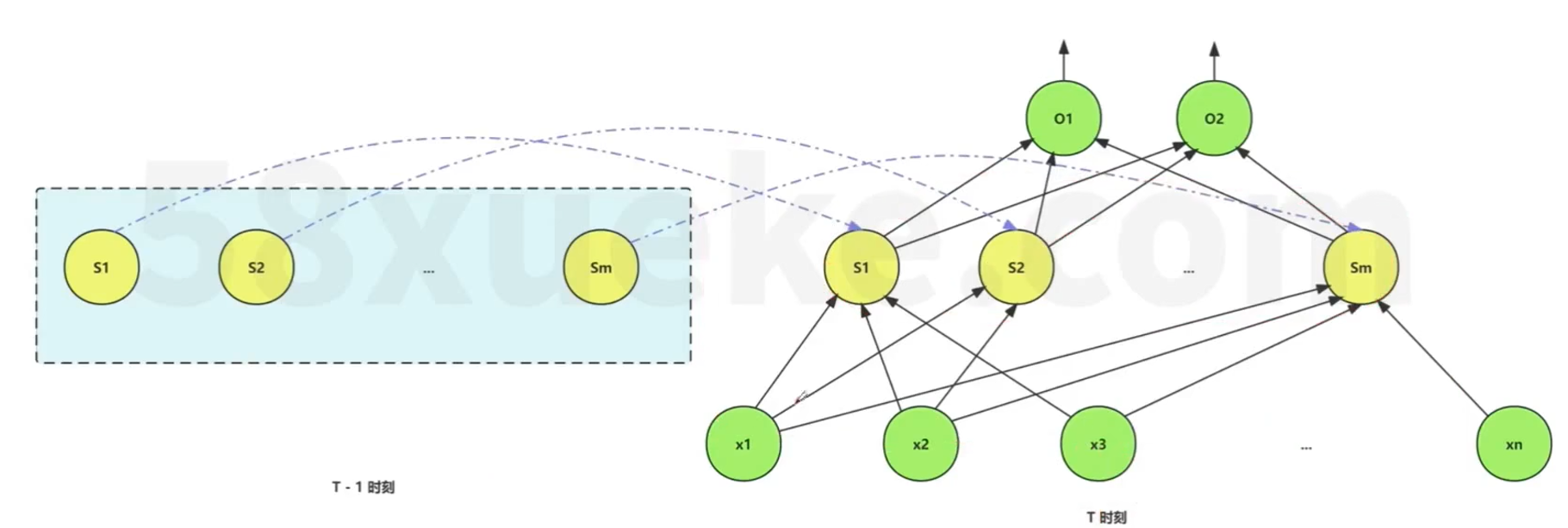

- RNN跟传统神经网络最大的区别在于每次都会将前一次的输出结果,带到下一次的隐藏层中,一起训练。也就是说,RNN前面所有的输入都会对未来的输出产生影响,就是把所有的输入都带到下一次

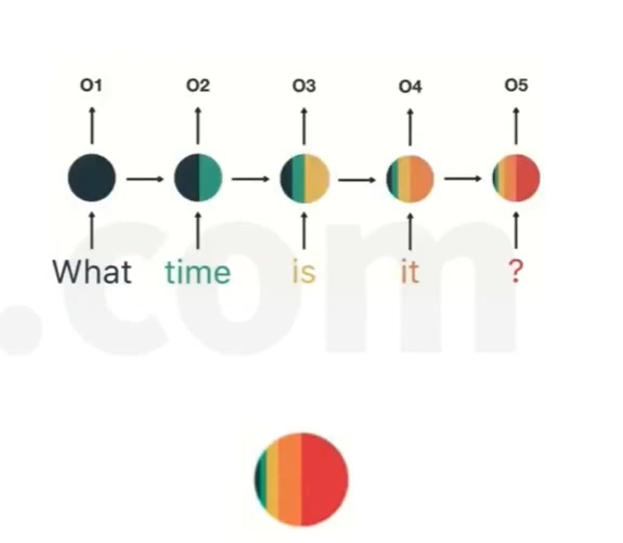

- 如下图,RNN中短期的记忆影响较大(如橙色区域),但是长期的记忆影响就很小(如黑色和绿色区域),这就是RNN存在的短期记忆问题

- RNN无法并行训练,导致训练成本较高 - 被抛弃

- 记忆不好,对长文本处理不好,前面输入的文本,越往后就越淡忘前面的文本

- RNN跟传统神经网络最大的区别在于每次都会将前一次的输出结果,带到下一次的隐藏层中,一起训练。也就是说,RNN前面所有的输入都会对未来的输出产生影响,就是把所有的输入都带到下一次

-

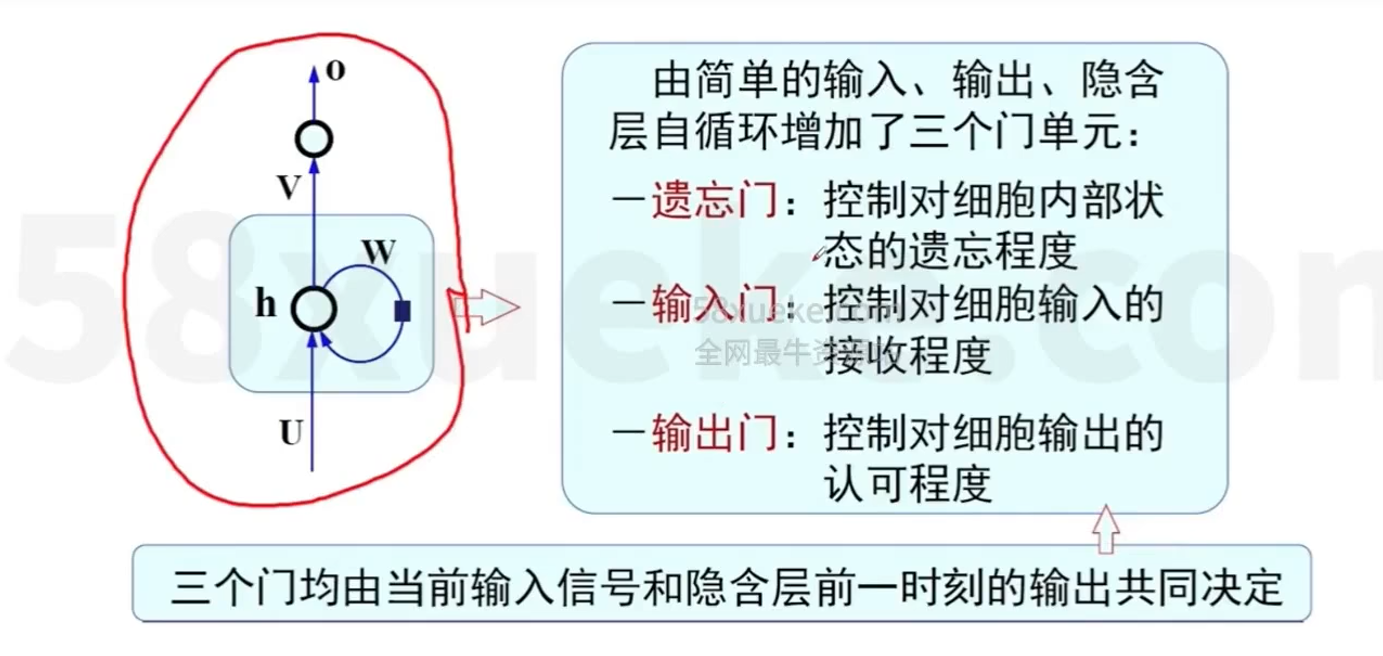

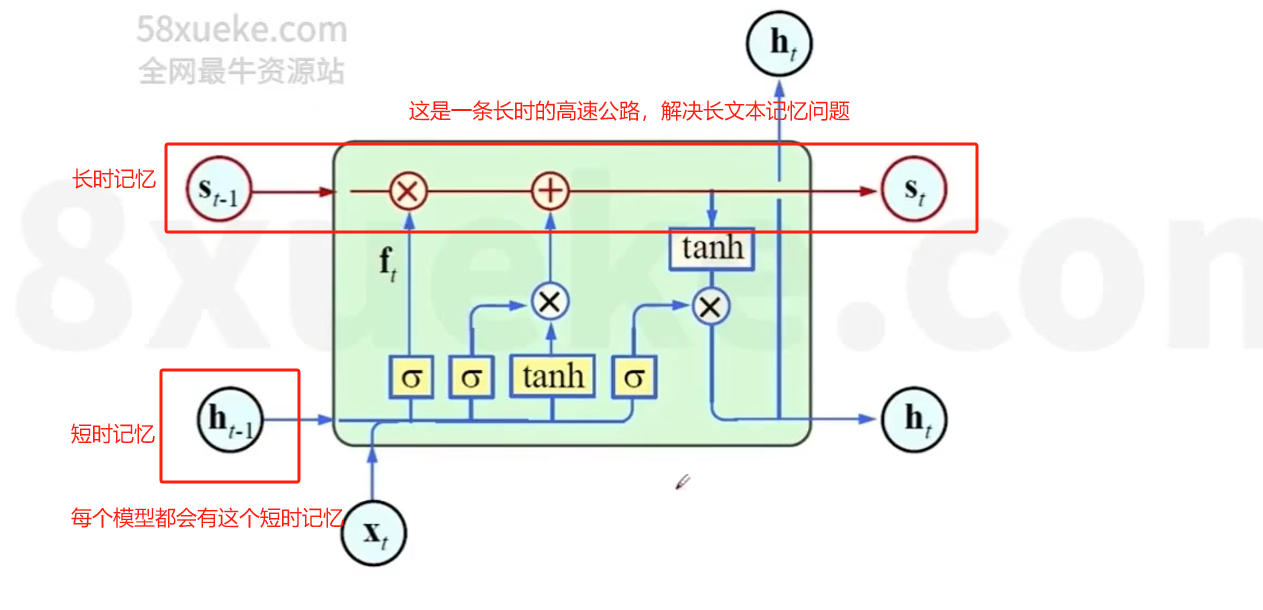

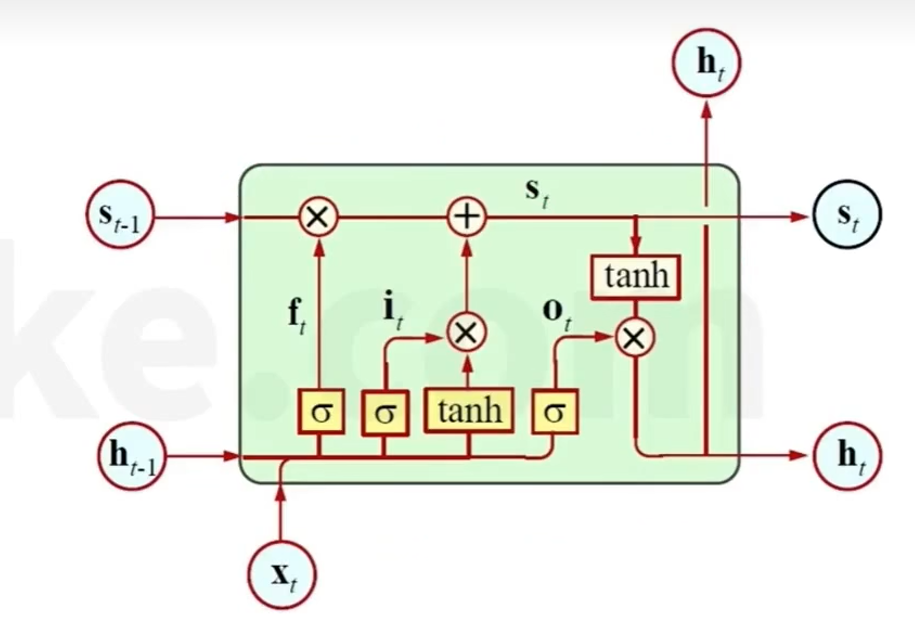

LSTM

- 代替RNN

- 解决长文本遗忘的问题

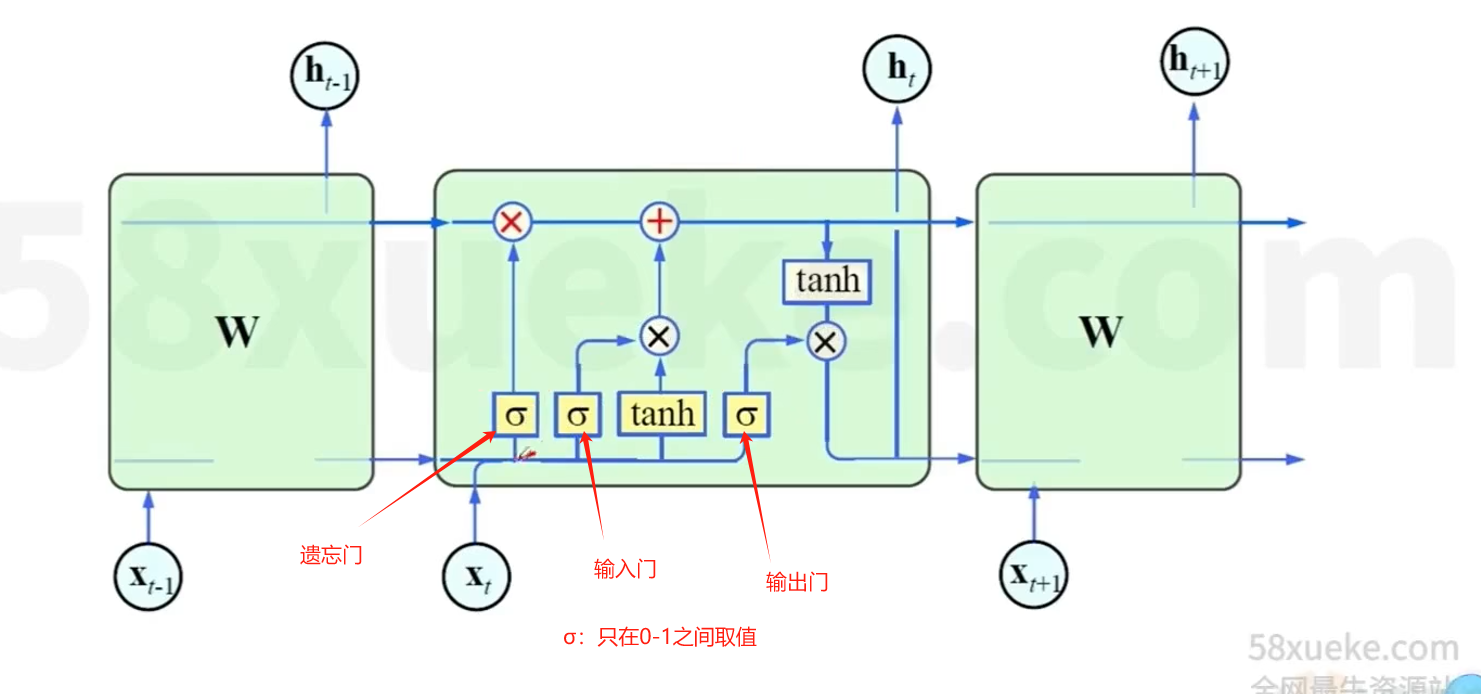

- ht-1:上一时刻的信息

- Xt:当前输入的数据

- tanh:输入后融合的信息

浙公网安备 33010602011771号

浙公网安备 33010602011771号