Weakly-supervised Video Anomaly Detection with Robust Temporal Feature Magnitude Learning

本篇论文收录于ICCV2021,主要介绍了通过弱监督学习来检测视频异常,地址如下:

以下是本人对这篇论文的大致翻译及粗浅理解,作为一个小白,难免有不少错漏之处,敬请包涵与指正。

摘要

使用弱监督视频级标签的异常检测通常被表述为一个多示例学习(MIL)问题,其中我们的目标是识别包含异常事件的片段,每个视频被表示为一个视频片段包。虽然目前的方法表现出有效的检测性能,但它们对阳性示例的识别,即异常视频中罕见的异常片段,在很大程度上受到优势负示例的影响,特别是当异常事件是细微的异常,与正常事件相比只有微小的差异时。这个问题在许多忽略了重要的视频时间依赖性的方法中更加严重。为了解决这一问题,我们引入了一种新的、理论上健全的方法,称为鲁棒时间特征幅值学习(RTFM),它训练一个特征幅值学习函数来有效地识别积极示例,大大提高了MIL方法对异常视频阴性示例的鲁棒性。RTFM还使用扩展卷积和自注意力机制来捕获长期和短期的时间依赖性,以更准确地学习特征幅值。大量的实验表明,启用RTFM的MIL模型在四个基准数据集(ShanghaiTech、UCF-Crime、XD-Violence和UCSD-Peds)上大大优于几种最先进的方法,并且显著提高了细微的异常判别性和样本效率。

1.介绍

视频异常检测由于其应用于自主监测系统的潜力而得到了深入的研究。视频异常检测的目的是识别异常事件发生时的时间窗——在监控的背景下,异常事件的例子包括欺凌、入店行窃、暴力等。虽然在一些论文中已经探索了专门使用正常视频训练的一类分类器(OCCs,也被称为无监督异常检测),但最好的执行方法是使用具有正常或异常的视频级标签注释的训练样本来探索弱监督设置。与OCC方法相比,这种弱监督设置的目标是在相对较小的人工注释花费的情况下实现更高的异常分类精度。

弱监督异常检测的主要挑战之一是如何从被标记为异常的整个视频中识别异常片段。这是由于两个原因,即:1)异常视频的大部分片段由正常事件组成,这使得训练过程变得困难并对少数异常片段的拟合提出挑战;2)异常片段可能与正常片段没有明显的区别,使正常片段和异常片段之间的明确区分具有挑战性。异常检测训练多示例学习(MIL)方法通过相同数量的异常和正常的片段来平衡训练集以减轻上述问题,正常片段随机从正常的视频中选择,异常片段是异常视频中异常得分最高的片段。虽然部分解决了上述问题,但MIL引入了四个问题:1)异常视频中的最高异常得分可能不来自异常片段;2)从正常视频中随机选择的正常片段可能相对容易拟合,这会对训练收敛造成挑战;3)如果视频有一个以上的异常片段,我们在每个视频中都错过了一个获得更有效的包含更多异常片段的训练过程的机会;4)分类分数的使用提供了一个弱的训练信号,不一定能使正常和异常片段有很好的分离。这些问题在忽略重要的时间依赖性的方法中更加严重。

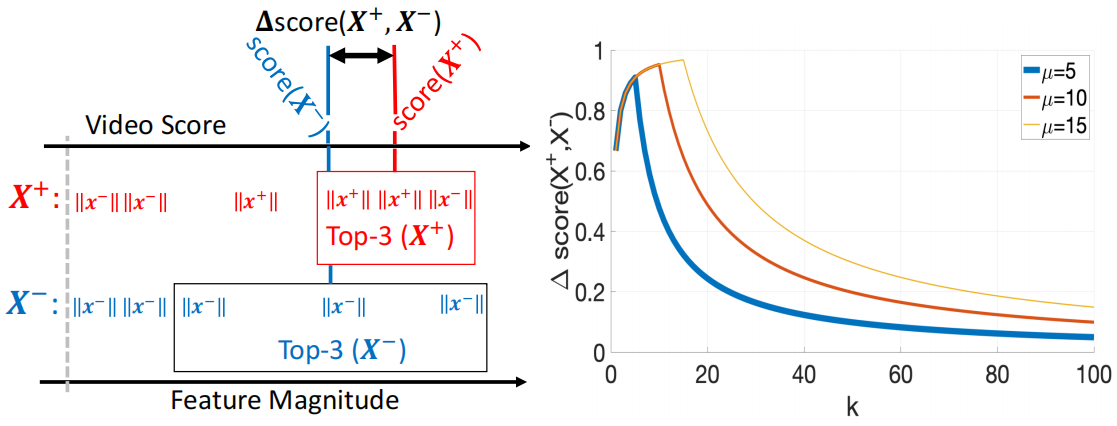

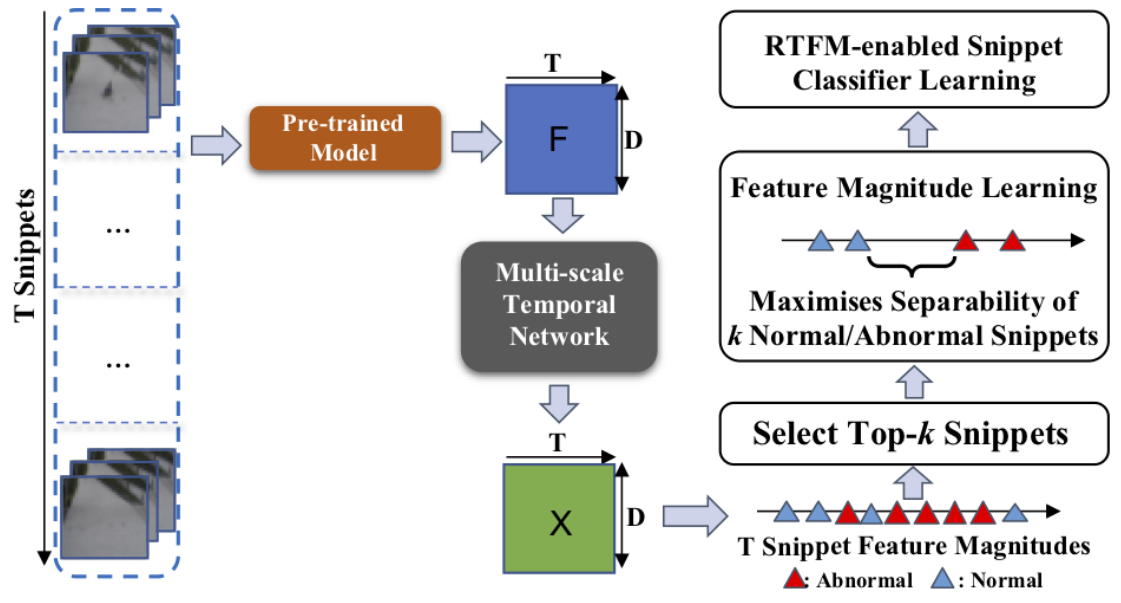

为了解决上述的MIL问题,我们提出了一种新的方法,称为鲁棒时间特征幅值(RTFM)学习。在RTFM中,我们依赖于视频片段的时间特征幅值,其中低幅值的特征代表正常(即负)片段,高幅值的特征表示异常(即正)片段。RTFM理论上是由top-k示例MIL驱动的,该MIL使用异常和正常视频中具有最高分类分数的k个示例来训练分类器,但在我们的公式中,我们假设平均特征异常片段的幅值大于正常片段的幅值,而不是假设异常片段和正常片段的分类分数之间的可分性。RTFM解决了上述MIL问题:1)从异常视频中选择异常片段的概率增加;2)从正常视频中选择的硬负正常片段更难拟合,提高训练收敛性;3)每个异常视频可以包含更多的异常片段;4)与使用分类分数的MIL方法相比,使用特征幅值来识别阳性示例是有利的,因为它支持更强的学习信号,特别是对于可以在整个训练过程中增加的异常片段,特征幅值学习可以与MIL异常分类共同优化,以在特征表示空间和异常分类输出空间上增大异常和正常片段之间的距离。图片1激励了RTFM,表明当每个异常视频有不止一个异常片段,且异常视频的平均片段特征幅值大于正常视频时,选择前k个特征(基于它们的幅值)可以更好地区分异常视频和正常视频。

图1。RTFM训练了一个特征幅值学习功能,以提高MIL方法对异常视频中的正常片段的鲁棒性,并更有效地检测异常片段。左图:异常和正常视频片段![]() 的时间特征幅值,来自异常和正常视频(X+和X−)。假设µ=3表示异常视频中异常片段的数量,我们可以最大化

的时间特征幅值,来自异常和正常视频(X+和X−)。假设µ=3表示异常视频中异常片段的数量,我们可以最大化![]() ,该分数度量了异常和正常视频分数之间的差异性,通过选择前k个(k≤µ)具有最大时间特征幅值的片段(分数是用前k个片段幅值的平均值来计算的)。右:

,该分数度量了异常和正常视频分数之间的差异性,通过选择前k个(k≤µ)具有最大时间特征幅值的片段(分数是用前k个片段幅值的平均值来计算的)。右:![]() 在k∈[1,µ]区间增大,然后在k>µ区间减少,证明了我们提出的RTF使得MIL模型可以在k≈µ时为异常和正常视频提供一个更好的分离度,即使存在一些有大特征幅值的正常片段。

在k∈[1,µ]区间增大,然后在k>µ区间减少,证明了我们提出的RTF使得MIL模型可以在k≈µ时为异常和正常视频提供一个更好的分离度,即使存在一些有大特征幅值的正常片段。

在实践中,RTFM在异常视频和正常视频中幅值最大的前k个片段特征之间产生较大的距离,这在理论上保证最大限度地分离异常和正常的视频表示。然后从正常和异常视频中选择这些前k个片段特征来训练片段分类器。为了在每个视频中无缝地合并长和短程时间依赖,我们将长和短时间依赖的学习与金字塔扩张卷积(PDC)和时间自注意力模块(TSA)结合起来。我们在四个异常检测基准数据集上验证了我们的RTFM,即ShanghaiTech、UCF-Crime、XD-Violence和UCSD-Peds。我们表明,我们的方法在使用不同的预训练特征(即C3D和I3D)的情况下,在所有基准测试上都大大优于当前的sota。我们还表明,我们的方法比流行的MIL方法具有更好的样本效率和细微的异常判别性。

2.相关工作

无监督异常检测。传统的异常检测方法只假设了正常训练数据的可用性,并使用手工制作的特征来解决了单类分类问题。随着深度学习的出现,最近的方法使用了预训练深度神经网络的特征。其他人则对正态流形的潜在空间应用约束来学习紧致正态表示。另外,一些方法依赖于使用生成模型的数据重建,通过(反向)最小化重建误差来学习正常样本的表示。这些方法假设未见过的异常视频/图像往往不能很好地重建,并认为高重建误差的样本是异常的。然而,由于缺乏对异常的先验知识,这些方法可能会过拟合训练数据,无法区分异常事件和正常事件。

弱监督的异常检测。利用一些标注的异常样本,比无监督的方法显示出了显著的性能改善。然而,获得大规模的帧级标签注释的成本太高。因此,目前的SOTA视频异常检测方法依赖于弱监督训练,使用更便宜的视频级标注训练。苏丹等人提出了视频级标签的使用,并引入了大规模的弱监督视频异常检测数据集UCF-Crime。从那时起,这个方向就引起了研究界的注意。

弱监督视频异常检测方法主要基于MIL框架。然而,大多数基于mil的方法都没有利用异常视频标签,因为当异常视频中的正常片段被错误地选为top异常事件时,会导致正包中的标签噪音对这些方法造成影响。为了解决这个问题,钟等人将该问题重新定义为有噪声标签问题下的二值分类,并使用图卷积神经(GCN)网络来清除标签噪声。虽然该方法的结果比之前的方法更准确,但GCN和MIL的训练计算代价高昂,它会导致无约束的潜在空间(即正常和异常特征可以位于特征空间的任何位置),从而导致性能不稳定。相比之下,与原始的MIL公式相比,我们的方法具有简单的计算开销。此外,我们的方法通过基于L2范数的时间特征排序损失,统一了表示学习和异常评分学习,能够更好地分离正常和异常特征表示,与以往的MIL方法相比,是对弱标签学习的进一步探索。

3.所提出的方法:RTFM

我们提出的鲁棒时间特征幅值(RTFM)方法旨在使用弱标记视频来区分异常和正常片段。给定一组弱标记训练视频D=![]() ,其中F∈

,其中F∈![]() ⊂

⊂![]() 是预先计算的来自T个视频片段的D维特征(例如I3D或C3D),y∈Y={0,1}表示视频级注释(如果Fi是正常视频则yi=0,否则yi=1)。RTFM使用的模型由rθ,

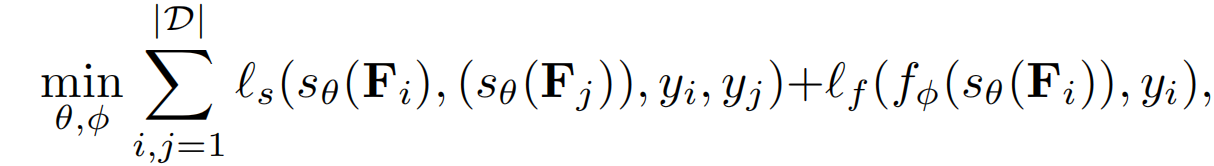

是预先计算的来自T个视频片段的D维特征(例如I3D或C3D),y∈Y={0,1}表示视频级注释(如果Fi是正常视频则yi=0,否则yi=1)。RTFM使用的模型由rθ,![]() 表示,返回一个T维特征[0,1]T,表示T个视频片段分类为异常或正常,参数θ,φ定义如下。该模型的训练包括端到端多尺度时间特征学习的联合优化,特征幅度学习和基于RTFM的MIL分类器训练,损失定义如下

表示,返回一个T维特征[0,1]T,表示T个视频片段分类为异常或正常,参数θ,φ定义如下。该模型的训练包括端到端多尺度时间特征学习的联合优化,特征幅度学习和基于RTFM的MIL分类器训练,损失定义如下

其中sθ:F→X是时间特征提取器(X⊂![]() ),fφ:X→[0,1]T是片段分类器,

),fφ:X→[0,1]T是片段分类器,![]() 表示一个损失函数,它使来自正常和异常视频的前k个片段特征之间的可分性最大化。

表示一个损失函数,它使来自正常和异常视频的前k个片段特征之间的可分性最大化。![]() 是一个用来训练片段分类器

是一个用来训练片段分类器![]() 的损失函数,它也使用来自正常和异常视频的前k个片段特征进行训练,接下来,我们将讨论我们提出RTFM的理论动机,然后详细描述该方法。

的损失函数,它也使用来自正常和异常视频的前k个片段特征进行训练,接下来,我们将讨论我们提出RTFM的理论动机,然后详细描述该方法。

3.1.RTFM的理论动机

Top-k MIL将MIL扩展到阳性包中包含最小数目的阳性样本,阴性包中也包含阳性样本但数目更少的环境中,并且它假设分类器可以分离阳性和阴性样本。我们的问题是不同的,因为阴性包不包含阳性样本,而且我们没有做出分类可分性的假设。根据上面介绍的命名法,从视频中提取的时间特征由(1)中的![]() 表示,其中代码片段特征由X的xt行表示。异常片段用

表示,其中代码片段特征由X的xt行表示。异常片段用![]() 表示,正常片段用

表示,正常片段用![]() 表示。一个异常的视频X+包含从

表示。一个异常的视频X+包含从![]() 采样的u个片段和从

采样的u个片段和从![]()

![]() 中采样的(T−µ)个片段,一个正常的视频X−包含从Px−(x)采样的总共T个片段。

中采样的(T−µ)个片段,一个正常的视频X−包含从Px−(x)采样的总共T个片段。

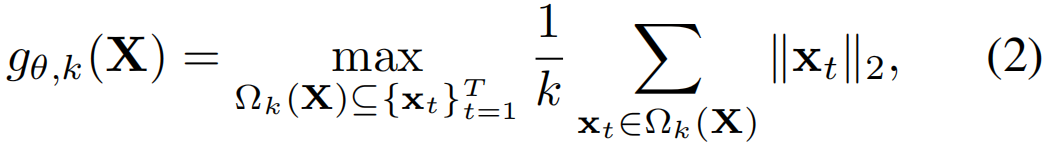

为了学习一个可以将视频和片段区分为正常或异常的函数,我们定义一个使用幅值分类片段的函数(我们使用L2范数计算特征幅值),而不是假设正常和异常片段间的分类可分性,我们做一个更温和的假设![]() 。这意味着通过从

。这意味着通过从![]() 中学习片段特征,使正常特征的幅值比异常的小,我们可以满足这个假设。为了实现这种学习,我们依赖于基于视频中前k个片段的平均特征幅值的优化,定义如下

中学习片段特征,使正常特征的幅值比异常的小,我们可以满足这个假设。为了实现这种学习,我们依赖于基于视频中前k个片段的平均特征幅值的优化,定义如下

其中,![]() 由θ参数化,以表示其对

由θ参数化,以表示其对![]() 的依赖性以生成xt,

的依赖性以生成xt,![]() 包含来自

包含来自![]() 的k个片段的子集且

的k个片段的子集且![]() 。异常视频与正常视频之间的可分性表示为

。异常视频与正常视频之间的可分性表示为

![]()

对于下面的定理,我们定义了一个来自![]() 的片段异常的概率

的片段异常的概率![]() ,

,![]() >0,以及来自正常

>0,以及来自正常![]() 异常的概率

异常的概率![]() 。这个定义意味着,在

。这个定义意味着,在![]() 中,只要k≤µ就可能会在前k个片段中发现一个异常的片段,。

中,只要k≤µ就可能会在前k个片段中发现一个异常的片段,。

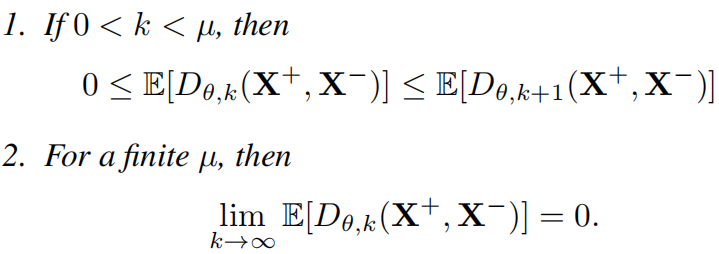

定理3.1(异常视频和正常视频之间的预期可分离性)。假设![]()

![]() ,其中X+有µ个异常样本和(T−µ)个正常样本,其中µ∈[1,T]且X−有T个正常样本。让

,其中X+有µ个异常样本和(T−µ)个正常样本,其中µ∈[1,T]且X−有T个正常样本。让![]() 为随机变量,从中得出(3)的可分性得分

为随机变量,从中得出(3)的可分性得分![]() 。

。

因此,该定理的第一部分意味着,当我们在异常视频的前k个片段中包含更多的样本时,异常视频和正常视频之间的可分性倾向于增加(即使包括一些正常样本,只要k≤µ)。该定理的第二部分意味着,当我们包含超过µ个top示例时,异常和正常视频分数变得难以区分,因为阳性和阴性包中都有大量的阴性样本。这两点都在图1中有所体现,其中![]() ,

,![]()

![]() 和

和![]() =0.4来计算

=0.4来计算![]() 。该定理表明,通过最大化来自异常和正常视频(对于k≤µ)的可分性,我们可以促进对异常视频和片段的分类。它还表明,使用top-k特征来训练片段分类器允许更有效的训练,因为异常视频中的大多数top-k个样本将是异常的,并且,通过使用top-k个最正常片段我们也将获得更平衡的训练。最后要注意的是,因为我们只使用每个视频的前k个样本,所以我们的方法通过相对较少的训练样本即可被有效地优化。

。该定理表明,通过最大化来自异常和正常视频(对于k≤µ)的可分性,我们可以促进对异常视频和片段的分类。它还表明,使用top-k特征来训练片段分类器允许更有效的训练,因为异常视频中的大多数top-k个样本将是异常的,并且,通过使用top-k个最正常片段我们也将获得更平衡的训练。最后要注意的是,因为我们只使用每个视频的前k个样本,所以我们的方法通过相对较少的训练样本即可被有效地优化。

3.2.多尺度时间特征学习

受视频理解中使用的注意力技术的启发,我们提出的多尺度时间网络(MTN)捕获了多分辨率的局部时间依赖性和视频片段之间的全局时间依赖性。MTN使用一个在时域上的扩展卷积金字塔来学习视频片段的多尺度表示。扩展卷积通常应用于空间域,以在不失去分辨率的情况下扩大感受野。在这里,我们建议在时间维度上使用扩展卷积,因为捕获相邻视频片段的多尺度时间依赖性对异常检测很重要。

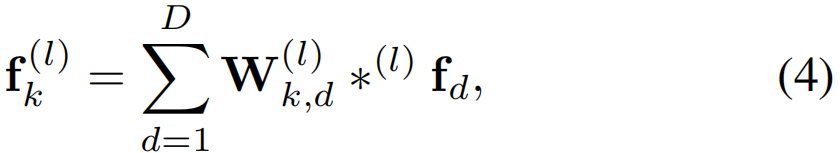

MTN从预先计算的特征![]() 中学习多尺度的时间特征。然后给定特征fd∈RT,将核为

中学习多尺度的时间特征。然后给定特征fd∈RT,将核为![]() ∈RW的一维扩展卷积操作(k∈{1、...,D/4},d∈{1、...,D}、l∈{PDC1、PDC2、PDC2、PDC3},W表示滤波器大小)定义为

∈RW的一维扩展卷积操作(k∈{1、...,D/4},d∈{1、...,D}、l∈{PDC1、PDC2、PDC2、PDC3},W表示滤波器大小)定义为

其中![]() 表示由

表示由![]() 索引的扩展卷积算子,

索引的扩展卷积算子,![]() ∈RT表示在时间维度上应用扩展卷积后的输出特征。{PDC1、PDC2、PDC3}的扩展因子分别为{1、2、4}。

∈RT表示在时间维度上应用扩展卷积后的输出特征。{PDC1、PDC2、PDC3}的扩展因子分别为{1、2、4}。

通过自注意模块实现了视频片段之间的全局时间依赖关系,在捕获视频理解、图像分类和目标检测的远程空间依赖关系方面表现出了良好的性能。基于之前使用GCN建模全局时间信息的工作,我们重新制定了空间自注意力技术来研究时间维度并捕获全局时间上下文建模。详细地说,我们的目标是生成一个注意力图M∈RT×T,以估计片段之间的成对相关性。我们的时间自注意力(TSA)模块首先使用一个1×1卷积将空间维度从F∈RT×D减少到F(c)∈RT×D/4,![]()

![]() 。然后,我们将三个独立的1×1卷积层应用于F(c),生成F(c1)、F(c2)、F(c3)∈RT×D/4,注意力图M由下式构成

。然后,我们将三个独立的1×1卷积层应用于F(c),生成F(c1)、F(c2)、F(c3)∈RT×D/4,注意力图M由下式构成![]() ,它生成

,它生成![]() 。

。

在这个最后的1×1卷积层之后添加一个跳跃连接,如

![]()

MTN的输出由PDC和MTN模块的输出串联形成,![]() ,

,![]() 。使用原始特征F的跳跃连接产生最终的时间特征表示

。使用原始特征F的跳跃连接产生最终的时间特征表示![]() ,其中,参数θ包含本节中描述的所有卷积的权重。

,其中,参数θ包含本节中描述的所有卷积的权重。

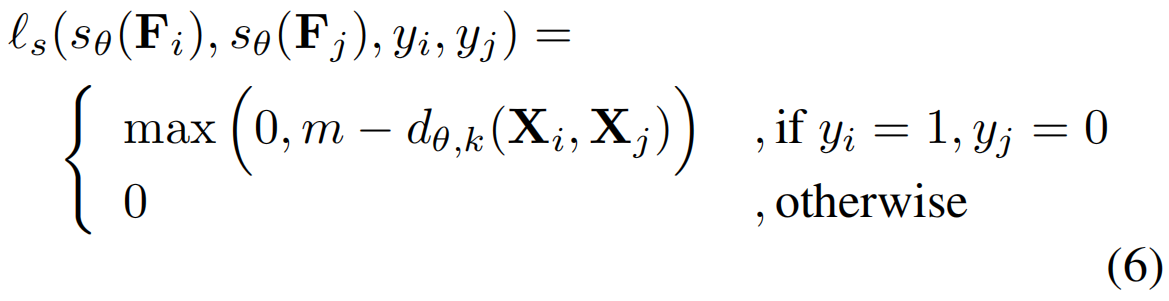

3.3.特征幅值学习

利用第二节中介绍的定理3.1,我们在(1)中提出了一个用于模型![]() 的损失函数,其中正常视频的最大片段特征幅值最小,异常视频的最大片段特征幅值最大。更具体地说,我们基于(1)式提出了最大化正常视频和异常视频之间的可分性的损失

的损失函数,其中正常视频的最大片段特征幅值最小,异常视频的最大片段特征幅值最大。更具体地说,我们基于(1)式提出了最大化正常视频和异常视频之间的可分性的损失![]() :

:

其中,m是一个预定义的边距,![]() 是异常的视频特征(类似于正常视频的Xj),

是异常的视频特征(类似于正常视频的Xj),![]() 表示在(3)中定义的可分性函数,该函数根据(2)式中的

表示在(3)中定义的可分性函数,该函数根据(2)式中的![]() (平均特征幅值)计算异常和正常视频的前k个示例的得分之间的差值。

(平均特征幅值)计算异常和正常视频的前k个示例的得分之间的差值。

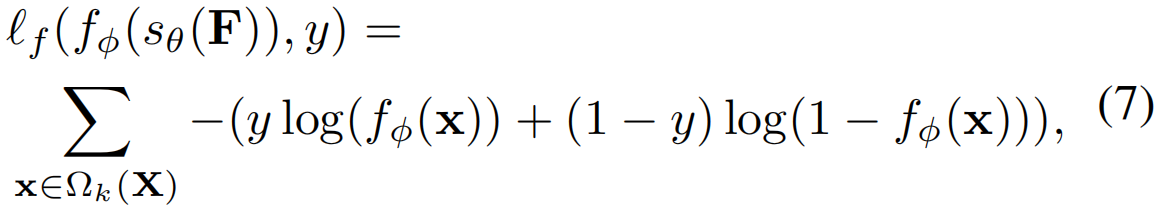

3.4.启用了RTFM的代码片段分类器学习

为了学习片段分类器,我们使用集合Ωk(X)训练一个基于二进制交叉熵的分类损失函数,其中包含(1)式sθ(F)中具有最大L2范数特征的k个片段。特别地,(1)式中的损失![]() 被定义为:

被定义为:

其中,x=sθ(f)。请注意,![]() 伴随着时间平滑和稀疏规则化,时间平滑定义为

伴随着时间平滑和稀疏规则化,时间平滑定义为![]()

![]() 以迫使相邻片段具有类似的异常分数,而稀疏正则化定义为

以迫使相邻片段具有类似的异常分数,而稀疏正则化定义为![]() 以在每个异常视频中添加一个异常事件罕见的先验信息。

以在每个异常视频中添加一个异常事件罕见的先验信息。

4.实验

4.1.数据集及评价措施

我们的模型在四个多场景基准数据集上进行了评估,这些数据集是为弱监督视频异常检测任务创建的:ShanghaiTech、UCF-Crime、XD-Violence和UCSD-Peds。

4.2.实现细节

每个视频被分成32个视频片段,即T=32。对于所有的实验,我们在(6)式中设置了m=100,k=3。模型(第三节)中描述的三层FC层有512、128和1个节点,其中每个FC层之后都有一个ReLU激活函数和一个dropout函数,dropout率为0.7。2048维和4096维特征分别是从预训练的I3D或C3D网络的“mix5c”和“fc6”层中提取的。在MTN中,我们将金字塔扩张速率设置为1、2和4,并对每个扩展的卷积分支使用3×1Conv1D。对于自我注意块,我们使用一个一维的1×1卷积。

我们的RTFM方法使用Adam优化器以端到端方式进行训练,权重衰减为0.0005,batch大小为64,持续50个epoch。在ShanghaiTech和UCF-Crime上的学习率设置为0.001,在XD-Violence上的学习率设置为0.0001。每个mini-batch由32个随机选择的正常和异常视频的样本组成。该方法使用PyTorch实现的。对于所有的baseline,我们使用与我们的模型具有相同backbone的已发布结果。为了公平比较,我们使用与对比论文相同的基准设置。

图2。我们提出的RTFM接收一个从一个包含T个片段的视频中提取的T×D特征矩阵F。然后,MTN捕获代码片段特征之间的长时间和短时间依赖关系,以生成X=sθ(F)。接下来,我们最大限度地提高异常和正常视频特征之间的可分性,并使用来自异常和正常视频的前k个最大幅值的特征片段来训练片段分类器。

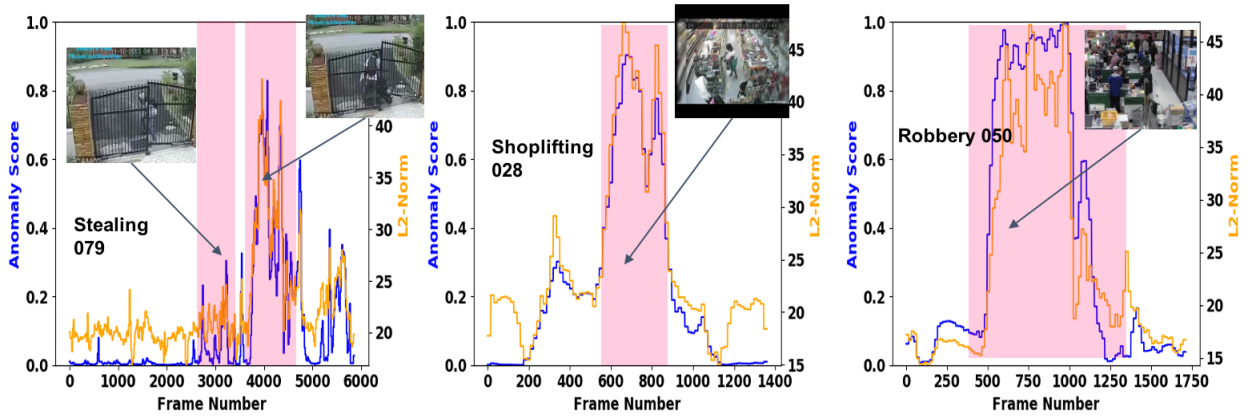

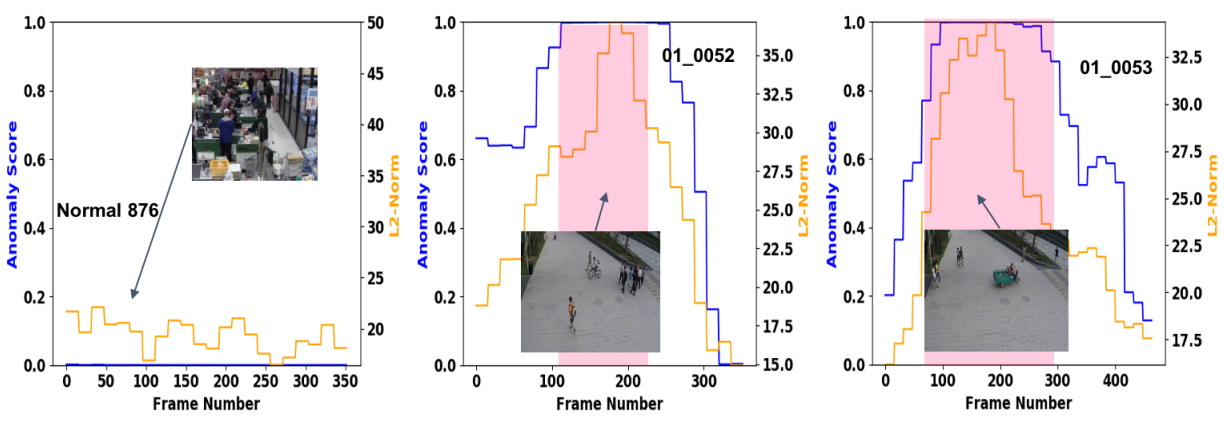

图3。本方法对UCF-Crime(盗窃079,入店行窃028,抢劫050,正常876)和ShanghaiTech(01 0052,01 0053)测试视频的异常评分和特征幅值数值。粉红色的区域表示手动标记的异常事件。

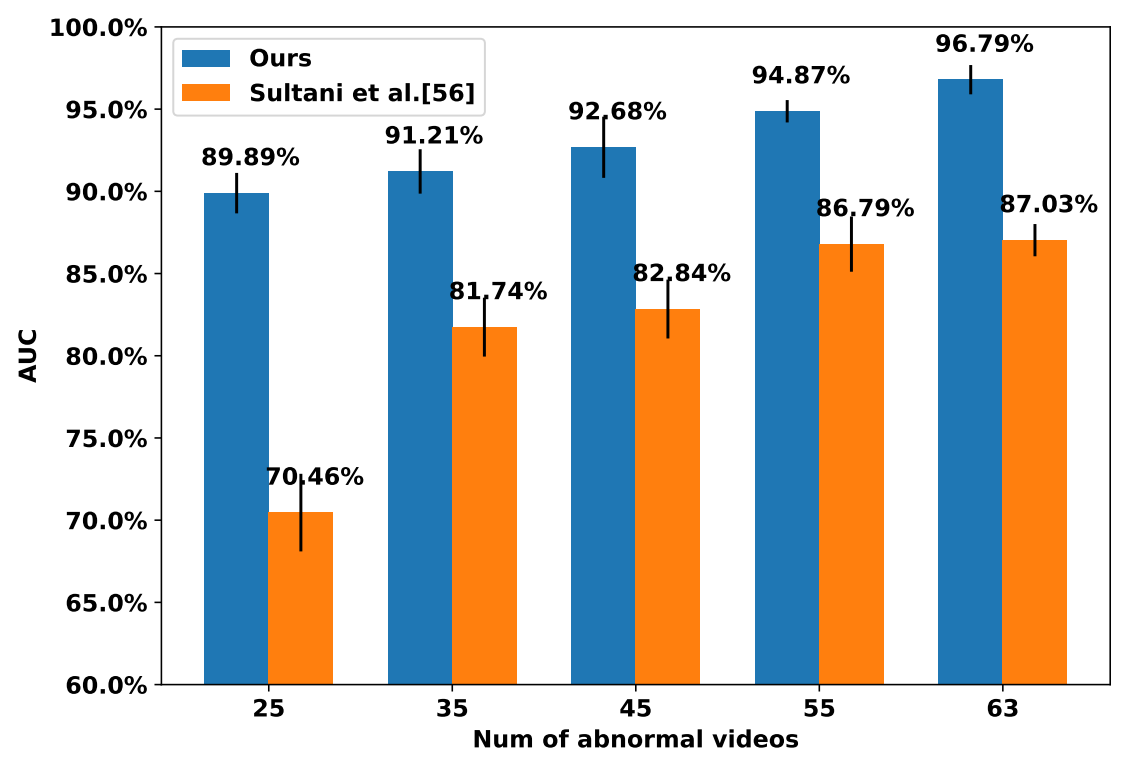

4.7.样本效率分析

我们通过观察我们的方法在ShanghaiTech训练中使用的异常视频数量方面的表现,来调查我们方法的样本效率。我们将原始63个视频的异常训练视频数量减少到25个视频,并固定了正常的训练视频和测试数据。使用苏丹等人论文中的MIL方法作为基线。为了进行公平的比较,两种方法都使用了相同的I3D特征,平均AUC结果((使用不同的随机种子进行三次运行计算))如图4所示。正如预期的那样,我们和苏丹等人的方法性能随着异常训练视频数量的减少而减小,但我们的模型的下降率小于Sultani等人方法,表明了我们的RTFM的健壮性。值得注意的是,我们的方法只使用25个异常训练视频的表现比使用全部63个异常视频的苏丹等人方法高出3%,而且我们的方法使用了低于60%的标记异常训练视频,仍优于Sultani等人的方法。这是因为RTFM对异常视频中的阳性示例的识别效果更好,因此,它可以比基于mil的方法更有效地利用相同的训练数据。请注意,我们使用相同的I3D特性对苏丹等人的方法进行了再训练。

图4。关于异常训练视频数的AUC。

5.结论

我们引入了一种名为RTFM的新方法,它使top-k MIL方法能够用于弱监督视频异常检测。RTFM学习了一个时间特征幅值映射函数,1)从包含许多正常片段的异常视频中检测到罕见的异常片段,2)保证正常片段和异常片段之间有很大的差距。这在以下两个主要方面改进了基于MIL的后续异常分类:1)我们的RTFM-baled模型学习了更多的鉴别特征,提高了其区分复杂异常(如细微异常)的能力;2)它还使MIL分类器显著改进了对异常数据的利用。与目前的SOTA MIL方法相比,这两种方法分别具有更好的细微异常判别性和样本效率。它们也是我们的模型在所有三个大型基准测试上实现SOTA性能的两个主要驱动因素。

涉及的一些概念:

MIL:多示例学习(multiple-instance learning)是1997年被提出的。其与监督学习、半监督学习和非监督学习有所不同,它是以多示例包(bag)为训练单元的学习问题。

在多示例学习中,训练集由一组具有分类标签的多示例包(bag)组成 ,每个多包(bag)含有若干个没有分类标签的示例(instance)。如果多示例包(bag)至少含有一个正示例(instance),则该包被标记为正类多示例包(正包)。如果多示例包的所有示例都是负示例,则该包被标记为负类多示例包(负包)。多示例学习的目的是,通过对具有分类标签的多示例包的学习,建立多示例分类器,并将该分类器应用于未知多示例包的预测。

浙公网安备 33010602011771号

浙公网安备 33010602011771号