07 2023 档案

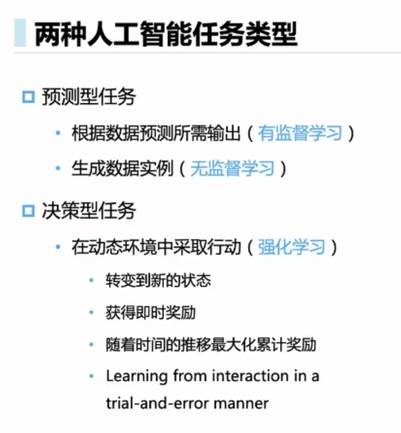

摘要:###1. 连续动作空间VS离散动作空间 【离散动作空间】Q表格、SARSA、on-policy以及off-policy、Q-learing []()https://blog.csdn.net/zbp_12138/article/details/106837306 【连续动作空间】 用神经网络的方法

阅读全文

摘要:###KL散度(KL-divergence) 直观解释:KL 散度是一种衡量两个分布(比如两条线)之间的匹配程度的方法。 需要解决的问题:已知数据太大,逍遥使用较小的信息表示已知数据。用某种已知分布来表示真实统计数据,这样我们就可以只发送该分布的参数,而无需发送真实统计数据。 KL-divergen

阅读全文

摘要:###MDP算法 MDP被定义为一个元组(S,A,P,r,R) S:所有状态集合 A:在环境力里面智能体所作动作的集合 P:状态转移函数P(s'|s,a),智能体在当前s下,执行a之后,转移到是s'的概率 R:奖励函数R(s,a),表示在环境s下执行动作a之后获得的立即奖励,有时候还需要知道s'是多

阅读全文

摘要:###强化学习基础  的网络安全 **目前关注的方面:** 集中在安全通信、入侵检测、侧通道攻击、GPS欺骗攻击、网络窃听、消息修改/注入等方面,有些侧重于分析现有的安全威胁[20]、[21],有些提出了他们的攻击方法[14]、[22],还有一些则更多地侧重于SA

阅读全文

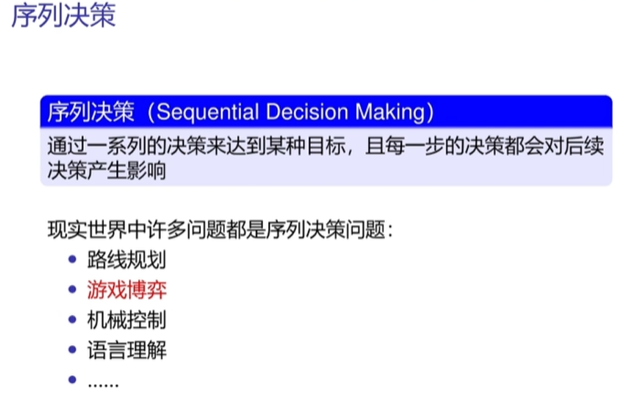

摘要:###序列决策  **序列决策问题一般用马尔可夫决策模型进行描述** 都不会提高自

阅读全文

浙公网安备 33010602011771号

浙公网安备 33010602011771号