XGBoost总结

再从头到尾复习一边+面试题总结:https://zhuanlan.zhihu.com/p/83901304

陈国平:GBDT原理小结:https://www.cnblogs.com/pinard/p/6140514.html#!comments

XGBoost算法原理小结、XGBoost类库使用小结 https://www.cnblogs.com/pinard/

https://blog.csdn.net/u013363120/article/details/80195471缺点

https://blog.csdn.net/weixin_41843918/article/details/88817166总结

简介:

xgboost是Boosting算法的其中一种,Boosting算法的思想是许多弱分类器集成在一起,形成一个强分类器。以为xgboost是一种提升树模型,所以他是将许多树模型集成在一起,形成一个很强的分类器。而所用到的树模型则是cart回归树模型。

xgboost是在GBDT的基础上进行改进,使得更加强大,使用范围更大

xgboost一般和sklearn一起使用,但是由于sklearn中没有集成Xgboost,所以需要单独安装

在安装的时候要注意安装多线程版本

1. XGBoost的优势

XGBoost算法可以给预测模型带来能力的提升。当我对它的表现有更多了解的时候,当我对它的高准确率背后的原理有更多了解的时候,我发现它具有很多优势:

1.1 正则化

标准GBM的实现没有像XGBoost这样的正则化步骤。正则化对减少过拟合也是有帮助的。

实际上,XGBoost以“正则化提升(regularized boosting)”技术而闻名。

1.2 并行处理

XGBoost可以实现并行处理,相比GBM有了速度的飞跃。

不过,众所周知,Boosting算法是顺序处理的,它怎么可能并行呢?每一课树的构造都依赖于前一棵树,那具体是什么让我们能用多核处理器去构造一个树呢?我希望你理解了这句话的意思。如果你希望了解更多,点击这个链接。

XGBoost 也支持Hadoop实现。

1.3 高度的灵活性

XGBoost 允许用户定义自定义优化目标和评价标准

它对模型增加了一个全新的维度,所以我们的处理不会受到任何限制。

1.4 缺失值处理

XGBoost内置处理缺失值的规则。

用户需要提供一个和其它样本不同的值,然后把它作为一个参数传进去,以此来作为缺失值的取值。XGBoost在不同节点遇到缺失值时采用不同的处理方法,并且会学习未来遇到缺失值时的处理方法。

1.5 剪枝

当分裂时遇到一个负损失时,GBM会停止分裂。因此GBM实际上是一个贪心算法。

XGBoost会一直分裂到指定的最大深度(max_depth),然后回过头来剪枝。如果某个节点之后不再有正值,它会去除这个分裂。

这种做法的优点,当一个负损失(如-2)后面有个正损失(如+10)的时候,就显现出来了。GBM会在-2处停下来,因为它遇到了一个负值。但是XGBoost会继续分裂,然后发现这两个分裂综合起来会得到+8,因此会保留这两个分裂。

1.6 内置交叉验证

XGBoost允许在每一轮boosting迭代中使用交叉验证。因此,可以方便地获得最优boosting迭代次数。

而GBM使用网格搜索,只能检测有限个值。

1.7、在已有的模型基础上继续

XGBoost可以在上一轮的结果上继续训练。这个特性在某些特定的应用上是一个巨大的优势。

sklearn中的GBM的实现也有这个功能,两种算法在这一点上是一致的。

3.1 参数调优的一般方法

我们会使用和GBM中相似的方法。需要进行如下步骤:

- 选择较高的学习速率(learning rate)。一般情况下,学习速率的值为0.1。但是,对于不同的问题,理想的学习速率有时候会在0.05到0.3之间波动。选择对应于此学习速率的理想决策树数量。XGBoost有一个很有用的函数“cv”,这个函数可以在每一次迭代中使用交叉验证,并返回理想的决策树数量。

- 对于给定的学习速率和决策树数量,进行决策树特定参数调优(max_depth, min_child_weight, gamma, subsample, colsample_bytree)。在确定一棵树的过程中,我们可以选择不同的参数,待会儿我会举例说明。

- xgboost的正则化参数的调优。(lambda, alpha)。这些参数可以降低模型的复杂度,从而提高模型的表现。

- 降低学习速率,确定理想参数。

3.2 具体步骤

第一步:确定学习速率和tree_based 参数调优的估计器数目。

为了确定boosting 参数,我们要先给其它参数一个初始值。咱们先按如下方法取值:

1、max_depth = 5 :这个参数的取值最好在3-10之间。我选的起始值为5,但是你也可以选择其它的值。起始值在4-6之间都是不错的选择。

2、min_child_weight = 1:在这里选了一个比较小的值,因为这是一个极不平衡的分类问题。因此,某些叶子节点下的值会比较小。

3、gamma = 0: 起始值也可以选其它比较小的值,在0.1到0.2之间就可以。这个参数后继也是要调整的。

4、subsample,colsample_bytree = 0.8: 这个是最常见的初始值了。典型值的范围在0.5-0.9之间。

5、scale_pos_weight = 1: 这个值是因为类别十分不平衡。

注意哦,上面这些参数的值只是一个初始的估计值,后继需要调优。这里把学习速率就设成默认的0.1。然后用xgboost中的cv函数来确定最佳的决策树数量。

第二步: max_depth 和 min_weight 参数调优

我们先对这两个参数调优,是因为它们对最终结果有很大的影响。首先,我们先大范围地粗调参数,然后再小范围地微调。

注意:在这一节我会进行高负荷的栅格搜索(grid search),这个过程大约需要15-30分钟甚至更久,具体取决于你系统的性能。你也可以根据自己系统的性能选择不同的值。

第三步:gamma参数调优

第四步:调整subsample 和 colsample_bytree 参数

第五步:正则化参数调优。

第6步:降低学习速率

最后,我们使用较低的学习速率,以及使用更多的决策树。我们可以用XGBoost中的CV函数来进行这一步工作

2. XGBoost的参数

XGBoost的作者把所有的参数分成了三类:

通用参数:宏观函数控制。

Booster参数:控制每一步的booster(tree/regression)。

学习目标参数:控制训练目标的表现。

在这里我会类比GBM来讲解,所以作为一种基础知识,强烈推荐先阅读这篇文章。

5.1 通用参数

这些参数用来控制XGBoost的宏观功能。

1、booster[默认gbtree]

选择每次迭代的模型,有两种选择:

gbtree:基于树的模型

gbliner:线性模型

2、silent[默认0]

当这个参数值为1时,静默模式开启,不会输出任何信息。

一般这个参数就保持默认的0,因为这样能帮我们更好地理解模型。

3、nthread[默认值为最大可能的线程数]

这个参数用来进行多线程控制,应当输入系统的核数。

如果你希望使用CPU全部的核,那就不要输入这个参数,算法会自动检测它。

还有两个参数,XGBoost会自动设置,目前你不用管它。接下来咱们一起看booster参数。

5.2 booster参数

尽管有两种booster可供选择,我这里只介绍tree booster,因为它的表现远远胜过linear booster,所以linear booster很少用到。

1、eta[默认0.3]

和GBM中的 learning rate 参数类似。

通过减少每一步的权重,可以提高模型的鲁棒性。

典型值为0.01-0.2。

为了防止过拟合,更新过程中用到的收缩步长。在每次提升计算之后,算法会直接获得新特征的权重。 eta通过缩减特征的权重使提升计算过程更加保守。

2、min_child_weight[默认1]

决定最小叶子节点样本权重和。

和GBM的 min_child_leaf 参数类似,但不完全一样。XGBoost的这个参数是最小样本权重的和,而GBM参数是最小样本总数。

这个参数用于避免过拟合。当它的值较大时,可以避免模型学习到局部的特殊样本。

但是如果这个值过高,会导致欠拟合。这个参数需要使用CV来调整。

3、max_depth[默认6]

和GBM中的参数相同,这个值为树的最大深度。

这个值也是用来避免过拟合的。max_depth越大,模型会学到更具体更局部的样本。

需要使用CV函数来进行调优。

典型值:3-10

调参:值越大,越容易过拟合;值越小,越容易欠拟合。

4、max_leaf_nodes

树上最大的节点或叶子的数量。

可以替代max_depth的作用。因为如果生成的是二叉树,一个深度为n的树最多生成n2n^2n

2

个叶子。

如果定义了这个参数,GBM会忽略max_depth参数。

5、gamma[默认0]

在节点分裂时,只有分裂后损失函数的值下降了,才会分裂这个节点。Gamma指定了节点分裂所需的最小损失函数下降值。

这个参数的值越大,算法越保守。这个参数的值和损失函数息息相关,所以是需要调整的。

6、max_delta_step[默认0]

这参数限制每棵树权重改变的最大步长。如果这个参数的值为0,那就意味着没有约束。如果它被赋予了某个正值,那么它会让这个算法更加保守。

通常,这个参数不需要设置。但是当各类别的样本十分不平衡时,它对逻辑回归是很有帮助的。

这个参数一般用不到,但是你可以挖掘出来它更多的用处。

7、subsample[默认1]

和GBM中的subsample参数一模一样。这个参数控制对于每棵树,随机采样的比例。

减小这个参数的值,算法会更加保守,避免过拟合。但是,如果这个值设置得过小,它可能会导致欠拟合。

典型值:0.5-1

调参:防止overfitting。

8、colsample_bytree[默认1]

和GBM里面的max_features参数类似。用来控制每棵随机采样的列数的占比(每一列是一个特征)。

典型值:0.5-1

调参:防止overfitting。

9、colsample_bylevel[默认1]

用来控制树的每一级的每一次分裂,对列数的采样的占比。

我个人一般不太用这个参数,因为subsample参数和colsample_bytree参数可以起到相同的作用。但是如果感兴趣,可以挖掘这个参数更多的用处。

10、lambda[默认1]

权重的L2正则化项。(和Ridge regression类似)。

这个参数是用来控制XGBoost的正则化部分的。虽然大部分数据科学家很少用到这个参数,但是这个参数在减少过拟合上还是可以挖掘出更多用处的。

11、alpha[默认1]

权重的L1正则化项。(和Lasso regression类似)。

可以应用在很高维度的情况下,使得算法的速度更快。

12、scale_pos_weight[默认1]

在各类别样本十分不平衡时,把这个参数设定为一个正值,可以使算法更快收敛。参数详解:https://blog.csdn.net/h4565445654/article/details/72257538

2.3学习目标参数

这个参数用来控制理想的优化目标和每一步结果的度量方法。

1、objective[默认reg:linear]

这个参数定义需要被最小化的损失函数。最常用的值有:

binary:logistic 二分类的逻辑回归,返回预测的概率(不是类别)。

multi:softmax 使用softmax的多分类器,返回预测的类别(不是概率)。

在这种情况下,你还需要多设一个参数:num_class(类别数目)。

multi:softprob 和multi:softmax参数一样,但是返回的是每个数据属于各个类别的概率。

- 回归任务

- reg:linear (默认)

- reg:logistic

- 二分类

- binary:logistic 概率

- binary:logitraw 类别

- 多分类

- multi:softmax num_class=n 返回类别

- multi:softprob num_class=n 返回概率

- rank:pairwise

2、eval_metric[默认值取决于objective参数的取值]

对于有效数据的度量方法。

对于回归问题,默认值是rmse,对于分类问题,默认值是error。

典型值有:

logloss 负对数似然函数值

error 二分类错误率(阈值为0.5)

merror 多分类错误率

mlogloss 多分类logloss损失函数

auc 曲线下面积

- 回归任务(默认rmse)

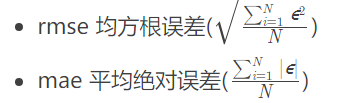

- rmse--均方根误差

- mae--平均绝对误差

- 分类任务(默认error)

- auc--roc曲线下面积

- error--错误率(二分类)

- merror--错误率(多分类)

- logloss--负对数似然函数(二分类)

- mlogloss--负对数似然函数(多分类)

3、seed(默认0)

随机数的种子

设置它可以复现随机数据的结果,也可以用于调整参数

如果你之前用的是Scikit-learn,你可能不太熟悉这些参数。但是有个好消息,python的XGBoost模块有一个sklearn包,XGBClassifier。这个包中的参数是按sklearn风格命名的。会改变的函数名是:

1、eta -> learning_rate

2、lambda -> reg_lambda

3、alpha -> reg_alpha

num_rounds

3、调参:

两种XGBoost包:

- xgb - 直接引用xgboost。接下来会用到其中的“cv”函数。--代码实现参考:https://blog.csdn.net/luanpeng825485697/article/details/79907149

- XGBClassifier - 是xgboost的sklearn包。这个包允许我们像GBM一样使用Grid Search 和并行处理。

- 两种接口的模型代码实现:https://blog.csdn.net/luanpeng825485697/article/details/79907149

调参代码实现(参考评论区):https://blog.csdn.net/han_xiaoyang/article/details/52665396

浙公网安备 33010602011771号

浙公网安备 33010602011771号