1-kubeadm部署1.18.0单master集群

1、有了docker,为什么还用kubernetes?

|

访问工具层 |

帮助用户更高效的完成任务,包括web控制台、RESTfulAPI、CI/CD、监控管理、日志管理 |

|

PaaS服务层 |

为开发、测试和运维人员提供统一的平台服务 |

|

容器编排 |

Kubernetes |

|

容器引擎 |

Docker |

|

IaaS基础设施层 |

提供基础运行环境,例如虚拟机、物理机、网络、存储、数据库、公有云等 |

2、kubernetes是什么

l Kubernetes是Google在2014年开源的一个集群管理系统,kubernetes简称k8s

l Kubernetes用于容器化应用程序的部署,扩展和管理,目标是让部署容器化应用简单高效。

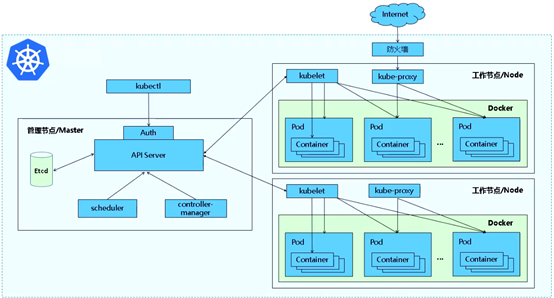

3、Kubernetes集群架构与组件

Kubernetes集群架构与组件

master组件

kube-apiserver

kubernetes API集群的同一入口,各组件协调者,以RESTful API提供接口服务,所有对象资源的增删改查和监听操作都交给APIserver处理再提交给Etcd存储

kube-controller-manager

处理集群中常规后台任务,一个资源对应一个控制器,而ControllerManager就是负责管理这些控制器的

kube-scheduler

根据调度算法为新创建的POdxuanz yig Node节点,可以在任意部署,可以部署在同一个节点上,也可以部署在不同节点上

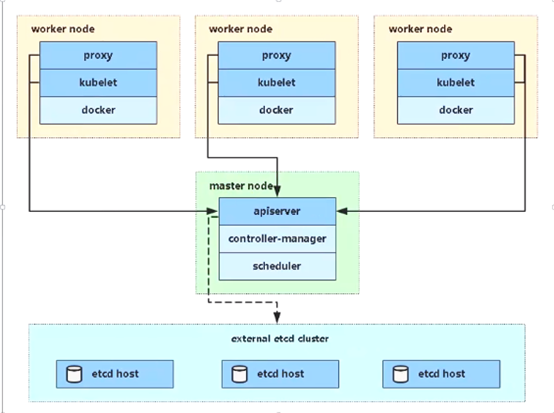

etcd

分布式键值存储系统,用于报销集群状态数据,比如Pod、service等对象信息,可以独立部署,但是需要部署在3个集群机器上,保证高可用。

Node组件

kubelet

kubelet是master在node节点上的agent,管理本机运行容器的生命周期,比如创建容器、Pod挂载数据卷、下载secret、获取容器和节点状态等工作,kubelet将每个Pod转成一组容器。

kube-proxy

在Node节点上实现Pod网络代理,维护网络规则和四层负载均衡工作

docker或rocket

容器引擎,运行容器

kubeadm 将k8s大部分组件都容器化

Master节点:

- kube-apiserver

- controller-manager

- scheduler

- etcd

Node节点:

- kubelet

- kube-proxy

- Docker

kubelet、docker以systemd守护进程方式部署。

4、Kubernetes核心概念

Pod

最小部署单元

一组容器的集合

一个Pod中的容器共享网络命名空间

Pod是短暂的

Controller 控制器

ReplicaSet:确保预期的Pod副本数量,多删少起

Deployment:无状态应用部署

StatefulSet:有状态应用部署

DaemonSet:确保所有Node运行同一个Pod

Job:一次性任务

Cronjob:定时任务

更高级层次对象,部署和管理Pod

Service

防止Pod失联

定义一组Pod的访问策略

由kube-proxy去实现的

Label:标签附近到某个资源上,用于关联对象、查询和刷选

Namespace:命名空间,将对象逻辑上隔离资源

kubernetes集群部署、配置

- 生产环境部署k8s的2种方式

- 服务器硬件配置推荐

- 使用kubeadm快速部署一个k8s集群

- Kubectl命令行管理工具

生产环境部署k8s的2种方式

l Kubeadm

Kubernetes是一个工具,提供kubeadm init和kubeadm join 用于快速部署集群,测试环境推荐方法

地址:https://kubernetes.io/docs/reference/setup-tools/kubeadm/kubeadm/

l 二进制

生产环境推荐,从官方下载发现版的二进制包,手工部署每个组建,组成kubernetes集群

下载地址:https://github.com/kubernetes/kubernetes/releases

1. 安装要求

在开始之前,部署Kubernetes集群机器需要满足以下几个条件:

l 一台或多台机器,操作系统 CentOS7.x-86_x64

l 硬件配置:2GB或更多RAM,2个CPU或更多CPU,硬盘30GB或更多

l 集群中所有机器之间网络互通

l 可以访问外网,需要拉取镜像

l 禁止swap分区

2、准备环境(优化系统环境)

1、时间同步

echo "#time sync by fage at 2019-7-22" >>/var/spool/cron/root echo "*/5 * * * * /usr/sbin/ntpdate ntp1.aliyun.com >/dev/null 2>&1" >>/var/spool/cron/root systemctl restart crond.service

2、关闭防火墙和selinux

systemctl stop firewalld systemctl disable firewalld sed -i s#SELINUX=enforcing#SELINUX=disable#g /etc/selinux/config setenforce 0

3、更改主机名

更改master主机名

hostname k8s-master echo "k8s-master" >/etc/hostname

更改node主机名 node-1

hostname node-1 echo "node-1" >/etc/hostname

更改node主机名 node-2

hostname node-2 echo "node-2" >/etc/hostname

4、更改hosts文件(集群机器都操作)

cat >/etc/hosts <<EOF 127.0.0.1 localhost localhost.localdomain localhost4 localhost4.localdomain4 ::1 localhost localhost.localdomain localhost6 localhost6.localdomain6 192.168.10.110 k8s-master 192.168.10.111 node-1 192.168.10.112 node-2 EOF

5、分发公钥(非必须项)

ssh-keygen -t rsa -f /root/.ssh/id_rsa -P "" ssh-copy-id -i /root/.ssh/id_rsa.pub root@192.168.10.110 ssh-copy-id -i /root/.ssh/id_rsa.pub root@192.168.10.111 ssh-copy-id -i /root/.ssh/id_rsa.pub root@192.168.10.112

6、全部节点node要禁用swap设备 不禁用要在初始化配置声明

swapoff -a #临时关闭 sed -i "s@/dev/mapper/centos-swap swap@#/dev/mapper/centos-swap swap@g" /etc/fstab #永久关闭

7、将桥接的IPv4流量传递到iptables的链:

cat > /etc/sysctl.d/k8s.conf << EOF net.ipv4.ip_forward = 1 net.bridge.bridge-nf-call-ip6tables = 1 net.bridge.bridge-nf-call-iptables = 1 EOF sysctl --system #执行生效

3、全部机器安装 Docker/kubeadm/kubelet/kubectl

Kubernetes默认CRI(容器运行时)为Docker,因此先安装Docker。

3.1 安装Docker(所有机器安装)

wget https://mirrors.aliyun.com/docker-ce/linux/centos/docker-ce.repo -O /etc/yum.repos.d/docker-ce.repo yum -y install docker-ce-18.06.1.ce-3.el7 #也可以安装19.03.4版本官方推荐 systemctl enable docker && systemctl start docker docker --version #docker镜像加速器 cat > /etc/docker/daemon.json << EOF { "data-root": "/data/docker", "log-driver":"json-file", "exec-opts": ["native.cgroupdriver=systemd"], "log-opts": {"max-size":"200m", "max-file":"5"}, "registry-mirrors": [ "https://hub.uuuadc.top", "https://docker.anyhub.us.kg", "https://dockerhub.jobcher.com", "https://dockerhub.icu", "https://docker.ckyl.me", "https://docker.awsl9527.cn" ] } EOF systemctl restart docker.service docker info

3.2 添加阿里云YUM软件源(所有机器操作)

cat > /etc/yum.repos.d/kubernetes.repo << EOF [kubernetes] name=Kubernetes baseurl=https://mirrors.aliyun.com/kubernetes/yum/repos/kubernetes-el7-x86_64 enabled=1 gpgcheck=0 repo_gpgcheck=0 gpgkey=https://mirrors.aliyun.com/kubernetes/yum/doc/yum-key.gpg https://mirrors.aliyun.com/kubernetes/yum/doc/rpm-package-key.gpg EOF

3.3 安装kubeadm,kubelet和kubectl(所有机器操作)

由于版本更新频繁,这里指定版本号部署:

yum install -y kubelet-1.18.0 kubeadm-1.18.0 kubectl-1.18.0 systemctl enable kubelet.service

4. 部署Kubernetes Master

在192.168.10.110(Master)执行。

kubeadm init \ --apiserver-advertise-address=192.168.10.110 \ --image-repository registry.aliyuncs.com/google_containers \ --kubernetes-version v1.18.0 \ --service-cidr=10.96.0.0/12 \ --pod-network-cidr=10.244.0.0/16 \ --ignore-preflight-errors=all

由于默认拉取镜像地址k8s.gcr.io国内无法访问,这里指定阿里云镜像仓库地址。

解释含义: --apiserver-advertise-address=192.168.10.110 \ #调用API借口的地址 --image-repository registry.aliyuncs.com/google_containers \ #下载镜像的地址 --kubernetes-version v1.18.0 \ #指定软件的版本 --service-cidr=10.96.0.0/12 \ #虚拟集群的网络 --pod-network-cidr=10.244.0.0/16 \ #集群节点中pod使用的网络 --ignore-preflight-errors=all #忽略所有初始化种遇到的错误信息

初始化方法二:

或者使用配置文件引导:

cat kubeadm.conf

apiVersion: kubeadm.k8s.io/v1beta2 kind: ClusterConfiguration kubernetesVersion: v1.18.0 imageRepository: registry.aliyuncs.com/google_containers networking: podSubnet: 10.244.0.0/16 serviceSubnet: 10.96.0.0/12

执行命令指定文件即可

kubeadm init --config kubeadm.conf --ignore-preflight-errors=all

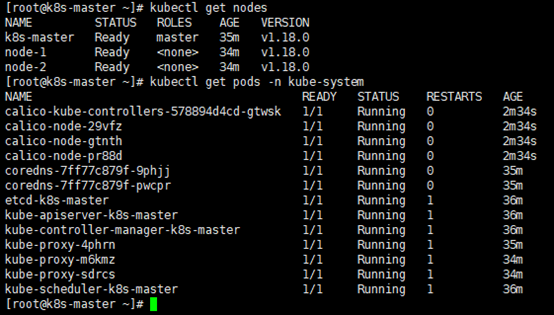

初始化完后需要创建程序配置文件夹、复制授权信息配置文件到目录和授权

mkdir -p $HOME/.kube sudo cp -i /etc/kubernetes/admin.conf $HOME/.kube/config sudo chown $(id -u):$(id -g) $HOME/.kube/config kubectl get nodes

初始化过程执行的步骤说明

kubeadm init步骤:

1、[preflight] #环境检查 2、[kubelet-start] #准备kubelet配置文件/var/lib/kubelet/config.yaml并启动 3、[certs] #证书目录 /etc/kubernetes/pki 4、[kubeconfig] #kubeconfig是用于连接k8s的认证文件 5、[control-plane] #静态pod目录 /etc/kubernetes/manifests 6、[etcd] #静态pod启动etcd 7、[upload-config] #kubeadm-config存储到kube-system configmap 8、[mark-control-plane] #给master节点打污点,不让pod分配 9、[bootstrap-token] #引导kubelet证书 10、[addons] #部署coredns和kube-proxy

5、网络方案(CNI)

1、Calico 推荐方案,支持网络策略

为什么部署CNI网络?

部署CNI是为了不同主机之间的Pod进行通信,因为kubernetes资源调度是需要通信进行计算服务器资源情况进行分配的 Calico是一个纯三层的数据中心网络方案,Calico支持广泛的平台,包括Kubernetes、OpenStack等。 Calico 在每一个计算节点利用 Linux Kernel 实现了一个高效的虚拟路由器( vRouter) 来负责数据转发,

而每个 vRouter 通过 BGP 协议负责把自己上运行的 workload 的路由信息向整个 Calico 网络内传播。 此外,Calico 项目还实现了 Kubernetes 网络策略,提供ACL功能

下载官方默认配置文件

https://docs.projectcalico.org/manifests/calico.yaml

下载完后还需要修改里面配置项:

- 定义Pod网络(CALICO_IPV4POOL_CIDR),与前面初始化集群网络pod CIDR配置一样,后面集群所有的pod都会使用这个网络进行分配地址

- 选择工作模式(CALICO_IPV4POOL_IPIP),支持**BGP(Never)**、**IPIP(Always)**、**CrossSubnet**(开启BGP并支持跨子网)

IPIP 隧道模式(overlay网络),基于以太网基础上承载容器数据表 BGP 纯路由方案,要求在二层网络中,比较推荐的模式(对性能要求高的环境) CrossSubnet 跨网段走IPIP,同网段走BGP

修改完后应用清单和查看状态:

kubectl apply -f calico.yaml kubectl get pods -n kube-system

2、Flannel 以前老版本推荐使用

Flannel是CoreOS维护的一个网络组件,Flannel为每个Pod提供全局唯一的IP,Flannel使用ETCD来存储Pod子网与Node IP之间的关系。

flanneld守护进程在每台主机上运行,并负责维护ETCD信息和路由数据包。

yaml下载地址:

https://raw.githubusercontent.com/coreos/flannel/master/Documentation/kube-flannel.yml

国外下载地址比较慢,可以考虑更换为国内的镜像下载地址

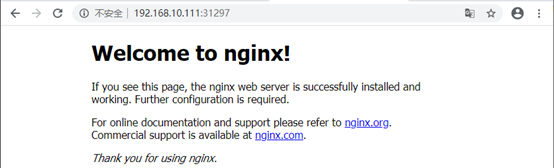

部署完成网络后创建pod测试是否能够正常访问

kubectl create deployment nginx --image=nginx #创建pod kubectl expose deployment nginx --port=80 --type=NodePort #将pod的集群端口暴露外部访问

访问地址:http://NodeIP:Port

部署管理集群URL页面

yaml下载地址,2.0版

https://raw.githubusercontent.com/kubernetes/dashboard/v2.0.3/aio/deploy/recommended.yaml

默认Dashboard只能集群内部访问,修改Service为NodePort类型,暴露到外部:

vim recommended.yaml

33 apiVersion: v1 34 metadata: 35 labels: 36 k8s-app: kubernetes-dashboard 37 name: kubernetes-dashboard 38 namespace: kubernetes-dashboard 39 spec: 40 type: NodePort 41 ports: 42 - port: 443 43 targetPort: 8443 44 nodePort: 30001 45 selector: 46 k8s-app: kubernetes-dashboard

生效文件

kubectl apply -f recommended.yaml kubectl get svc -n kubernetes-dashboard

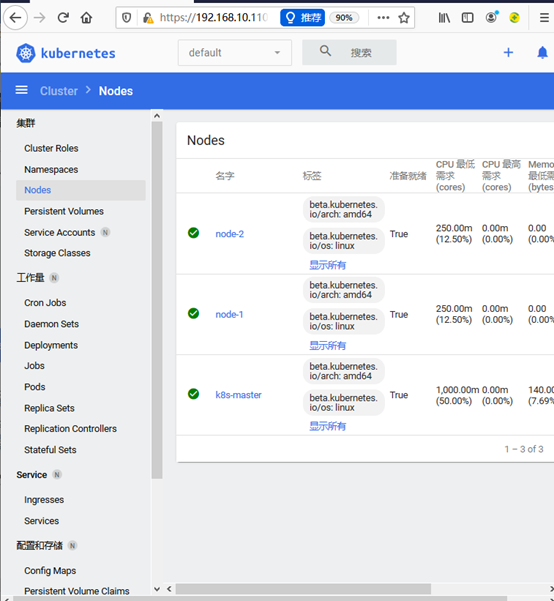

访问地址:https://NodeIP:30001

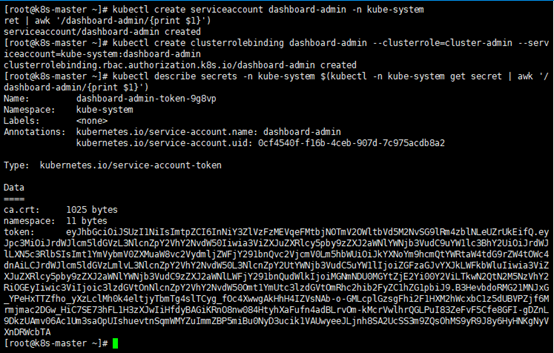

创建service account并绑定默认cluster-admin管理员集群角色:

kubectl create serviceaccount dashboard-admin -n kube-system #创建用户

kubectl create clusterrolebinding dashboard-admin --clusterrole=cluster-admin --serviceaccount=kube-system:dashboard-admin #授权

kubectl describe secrets -n kube-system $(kubectl -n kube-system get secret | awk '/dashboard-admin/{print $1}') #获取token

到此部署完成

浙公网安备 33010602011771号

浙公网安备 33010602011771号