python拓展4(Requests模块)

Requests模块

1、开发哲学(Requests 是以 PEP 20 的箴言为中心开发的)

- Beautiful is better than ugly.(美丽优于丑陋)

- Explicit is better than implicit.(直白优于含蓄)

- Simple is better than complex.(简单优于复杂)

- Complex is better than complicated.(复杂优于繁琐)

- Readability counts.(可读性很重要)

2、快速上手

1、发送请求

# 导入requests模块 import requests # 获取一个名为r的requests对象 # r = requests.get('https://api.github.com/events') # HTTP各类请求 # r = requests.post('https://api.github.com/events', data={'key': 'value'}) # r = requests.put('https://api.github.com/events', data={'key': 'value'}) # r = requests.delete('http://httpbin.org/delete') # r = requests.head('http://httpbin.org/get') # r = requests.options('http://httpbin.org/get')

3、HTTP各类请求

1、HTTP 1.1版本时,请求方法:GET、POST 、 HEAD、OPTIONS、PUT、DELETE、TRACE 和 CONNECT 方法

- GET

- 请求指定的页面信息,并返回实体主体。

- GET请求请提交的数据放置在HTTP请求协议头中,GET方法通过URL请求来传递用户的输入,GET方式的提交你需要用Request.QueryString来取得变量的值。

- GET方法提交数据,可能会带来安全性的问题,数据被浏览器缓存。

- GET请求有长度限制。

// 发起请求 http://localhost/general/form/getpost.asp?Text=Hello+World // 解析请求参数(asp语法) <% If Request.QueryString(“Text”) <> ““ Then %> 通过get方法传递来的字符串是: “<B><%= Request.QueryString(“Text”) %></B>“<BR> <% End If %>

-

HEAD

- 类似于get请求,只不过返回的响应中没有具体的内容,用于获取报头。

-

POST

- 向指定资源提交数据进行处理请求(例如提交表单或者上传文件)。

- POST请求可能会导致新的资源的建立和/或已有资源的修改。

- POST方式提交时,你必须通过Request.Form来访问提交的内容

// 发起请求 http://localhost/general/form/getpost.asp // 解析请求参数(asp语法) <% If Request.Form(“Text”) <> ““ Then %> 通过Post方法传递来的字符串是: “<B><%= Request.Form(“Text”) %></B>“<BR> <% End If %>

-

PUT

- 从客户端向服务器传送的数据取代指定的文档的内容。

-

DELETE

- 请求服务器删除指定的页面。

- DELETE请求一般返回3种码

- 200(OK)——删除成功,同时返回已经删除的资源。

- 202(Accepted)——删除请求已经接受,但没有被立即执行(资源也许已经被转移到了待删除区域)。

- 204(No Content)——删除请求已经被执行,但是没有返回资源(也许是请求删除不存在的资源造成的)。

-

CONNECT

- HTTP/1.1协议中预留给能够将连接改为管道方式的代理服务器。

-

OPTIONS

- 允许客户端查看服务器的性能。

-

TRACE

- 回显服务器收到的请求,主要用于测试或诊断。

4、传递URL参数

1、介绍:

- 老式构建URL方法:httpbin.org/get?key=val(如果你是手工构建 URL,那么数据会以键/值对的形式置于 URL 中,跟在一个问号的后面)

- Requests模块构建方法:(Requests 允许你使用

params关键字参数,以一个字符串字典来提供这些参数)

- {'key1': 'value1', 'key2': 'value2'}

- {'key1': 'value1', 'key2': ['value2', 'value3']}

import requests # 提前定义params传递的键值对 payload = {'name': 'he', 'password': '1234'} # 传递参数 r = requests.get('http://httpbin.org/get', params=payload) # 打印显示 print(r.url) # 结果: http://httpbin.org/get?name=he&password=1234

import requests # 提前定义params传递的键值对 payload = {'name': 'he', 'password': ['1234', 'abc']} # 传递参数 r = requests.get('http://httpbin.org/get', params=payload) # 打印显示 print(r.url) # 结果:http://httpbin.org/get?name=he&password=1234&password=abc

5、响应内容

1、读取服务器响应的内容

import requests # 发出请求并获得请求对象r r = requests.get('https://api.github.com/events') # 显示响应内容 print(r.text) # 显示响应内容编码方式 print(r.encoding) # 修改编码方式 r.encoding = 'JBK' print(r.encoding)

2、Requests 会自动解码来自服务器的内容。

- 请求发出后,Requests 会基于 HTTP 头部对响应的编码作出有根据的推测。当你访问

r.text之时,Requests 会使用其推测的文本编码。你可以找出 Requests 使用了什么编码,并且能够使用r.encoding属性来改变它 - 如果你改变了编码,每当你访问

r.text,Request 都将会使用r.encoding的新值 - 你可能希望在使用特殊逻辑计算出文本的编码的情况下来修改编码。比如 HTTP 和 XML 自身可以指定编码。这样的话,你应该使用

r.content来找到编码,然后设置r.encoding为相应的编码。这样就能使用正确的编码解析r.text了。 - PS:注意相比于r.encoding(从HTTP header中猜测响应内容编码方式) r.apparent_encoding(从内容中分析出响应内容编码方式【备选编码方式】)更加的准确

- 在你需要的情况下,Requests 也可以使用定制的编码。如果你创建了自己的编码,并使用

codecs模块进行注册,你就可以轻松地使用这个解码器名称作为r.encoding的值, 然后由 Requests 来为你处理编码。

6、二进制响应内容

也能以字节的方式访问请求响应体,对于非文本请求

# 导入模块 import requests from PIL import Image from io import BytesIO # 获取一张图片地址的requests对象r r = requests.get('http://www.qqzhi.com/uploadpic/2014-09-06/195035496.jpg') # 打印其请求内容 print(r.text) # 创建一个图片的对象img img = Image.open(BytesIO(r.content)) # 显示图片 img.show()

7、JSON响应内容

Requests 中也有一个内置的 JSON 解码器,助你处理 JSON 数据

import requests r = requests.get('https://api.github.com/events') # 显示内容 print(r.json())

PS:

- 如果 JSON 解码失败,

r.json()就会抛出一个异常。例如,响应内容是 401 (Unauthorized),尝试访问r.json()将会抛出ValueError: No JSON object could bedecoded异常。 - 需要注意的是,成功调用

r.json()并**不**意味着响应的成功。有的服务器会在失败的响应中包含一个 JSON 对象(比如 HTTP 500 的错误细节)。这种 JSON 会被解码返回。要检查请求是否成功,请使用r.raise_for_status()或者检查r.status_code是否和你的期望相同。

8、原始响应内容

在罕见的情况下,你可能想获取来自服务器的原始socket响应,那么你可以访问 r.raw。 如果你确实想这么干,那请你确保在初始请求中设置了 stream=True。具体见示例:

import requests r = requests.get('https://api.github.com/events', stream=True) # 打印原始套接字 print(r.raw) # 显示10个byte字节 print(r.raw.read(10))

PS:一般情况下,应该以下面的模式将文本流保存到文件

import requests r = requests.get('https://api.github.com/events', stream=True) with open('text.text', mode='wb') as f1: for chunk in r.iter_content(chunk_size=50): f1.write(chunk)

使用 Response.iter_content 将会处理大量你直接使用 Response.raw 不得不处理的。 当流下载时,上面是优先推荐的获取内容方式

PS:chunk_size可自由调节一次性读取的字节数,可能更适合使用情况

9、定制请求头

如果想为请求添加 HTTP 头部,只要简单地传递一个 dict 给 headers 参数就可以了.。

url = 'https://api.github.com/some/endpoint' headers = {'user-agent': 'my-app/0.0.1'} r = requests.get(url, headers=headers)

PS:定制 header 的优先级低于某些特定的信息源

- 如果在

.netrc中设置了用户认证信息,使用 headers= 设置的授权就不会生效。而如果设置了auth=参数,``.netrc`` 的设置就无效了。 - 如果被重定向到别的主机,授权 header 就会被删除。

- 代理授权 header 会被 URL 中提供的代理身份覆盖掉。

- 在我们能判断内容长度的情况下,header 的 Content-Length 会被改写。

更进一步讲,Requests 不会基于定制 header 的具体情况改变自己的行为。只不过在最后的请求中,所有的 header 信息都会被传递进去。

注意: 所有的 header 值必须是 string、bytestring 或者 unicode。尽管传递 unicode header 也是允许的,但不建议这样做。

10、跟复杂的POST请求

1、通常,你想要发送一些编码为表单形式的数据——非常像一个 HTML 表单。要实现这个,只需简单地传递一个字典给 data 参数。你的数据字典在发出请求时会自动编码为表单形式:

import requests payload = {'key1': 'value1', 'key2': 'value2'} r = requests.post("http://httpbin.org/post", data=payload) print(r.text)

2、还可以为 data 参数传入一个元组列表。在表单中多个元素使用同一 key 的时候,这种方式尤其有效:

import requests payload = (('key1', 'value1'), ('key1', 'value2')) r = requests.post("http://httpbin.org/post", data=payload) print(r.text)

3、很多时候你想要发送的数据并非编码为表单形式的。如果你传递一个 string 而不是一个 dict,那么数据会被直接发布出去。

例如,Github API v3 接受编码为 JSON 的 POST/PATCH 数据:

import json url = 'https://api.github.com/some/endpoint' payload = {'some': 'data'} r = requests.post(url, data=json.dumps(payload))

此处除了可以自行对 dict 进行编码,你还可以使用 json 参数直接传递,然后它就会被自动编码。这是 2.4.2 版的新加功能:

url = 'https://api.github.com/some/endpoint' payload = {'some': 'data'} r = requests.post(url, json=payload)

11、POST一个多部分编码(Multipart-Encoded)的文件

Requests 上传各种编码文件变得很容易:

url = 'http://httpbin.org/post' files = {'file': open('report.xls', 'rb')} r = requests.post(url, files=files) print(r.text)

可以自行设置文件名,文件类型和请求头(请求类型)

url = 'http://httpbin.org/post' files = {'file': ('report.xls', open('report.xls', 'rb'), 'application/vnd.ms-excel', {'Expires': '0'})} # application/vnd.ms-excel 请求头 r = requests.post(url, files=files) r.text

也可以发送作为文件来接收的字符串

url = 'http://httpbin.org/post' files = {'file': ('report.csv', 'some,data,to,send\nanother,row,to,send\n')} # 'some,data,to,send\nanother,row,to,send\n' 字符串 r = requests.post(url, files=files) r.text

PS:如果发送一个非常大的文件作为 multipart/form-data 请求,你可能希望将请求做成数据流。默认下 requests 不支持, 但有个第三方包 requests-toolbelt 是支持的。你可以阅读 toolbelt 文档 来了解使用方法。

在一个请求中发送多文件参考 高级用法 一节。

警告

强烈建议你用二进制模式(binary mode)打开文件。这是因为 Requests 可能会试图为你提供 Content-Length header,在它这样做的时候,这个值会被设为文件的字节数(bytes)。如果用文本模式(text mode)打开文件,就可能会发生错误。

12、响应状态码

检查响应状态方法

# 方法一 r = requests.get('http://httpbin.org/get') print(r.status_code) # 200 # 方法二 r.status_code == requests.codes.ok # True

如果发送了一个错误请求(一个 4XX 客户端错误,或者 5XX 服务器错误响应),可以通过Response.raise_for_status() 来抛出异常:

>>> bad_r = requests.get('http://httpbin.org/status/404') >>> bad_r.status_code 404 >>> bad_r.raise_for_status() Traceback (most recent call last): File "requests/models.py", line 832, in raise_for_status raise http_error requests.exceptions.HTTPError: 404 Client Error

PS:如果不是错误请求 raise_for_status() 是为空

13、响应头

我们可以查看以一个 Python 字典形式展示的服务器响应头:

r.headers { 'content-encoding': 'gzip', 'transfer-encoding': 'chunked', 'connection': 'close', 'server': 'nginx/1.0.4', 'x-runtime': '148ms', 'etag': '"e1ca502697e5c9317743dc078f67693f"', 'content-type': 'application/json' }

PS:HTTP 头部是大小写不敏感的。因此,我们可以使用任意大写形式来访问这些响应头字段:

>>> r.headers['Content-Type'] 'application/json' >>> r.headers.get('content-type') 'application/json'

15、重定向与请求历史

默认情况下,除了 HEAD, Requests 会自动处理所有重定向。

可以使用响应对象的 history 方法来追踪重定向。

Response.history 是一个 Response 对象的列表,为了完成请求而创建了这些对象。这个对象列表按照从最老到最近的请求进行排序。

例如,Github 将所有的 HTTP 请求重定向到 HTTPS:

>>> r = requests.get('http://github.com') >>> r.url 'https://github.com/' >>> r.status_code 200 >>> r.history [<Response [301]>]

如果你使用的是GET、OPTIONS、POST、PUT、PATCH 或者 DELETE,那么你可以通过 allow_redirects 参数禁用重定向处理:

>>> r = requests.get('http://github.com', allow_redirects=False) >>> r.status_code 301 >>> r.history []

如果你使用了 HEAD,你也可以启用重定向:

>>> r = requests.head('http://github.com', allow_redirects=True) >>> r.url 'https://github.com/' >>> r.history [<Response [301]>]

16、超时

你可以告诉 requests 在经过以 timeout 参数设定的秒数时间之后停止等待响应。基本上所有的生产代码都应该使用这一参数。如果不使用,你的程序可能会永远失去响应:

>>> requests.get('http://github.com', timeout=0.001) Traceback (most recent call last): File "<stdin>", line 1, in <module> requests.exceptions.Timeout: HTTPConnectionPool(host='github.com', port=80): Request timed out. (timeout=0.001)

注意

timeout 仅对连接过程有效,与响应体的下载无关。 timeout 并不是整个下载响应的时间限制,而是如果服务器在 timeout 秒内没有应答,将会引发一个异常(更精确地说,是在 timeout 秒内没有从基础套接字上接收到任何字节的数据时)If no timeout is specified explicitly, requests do not time out.

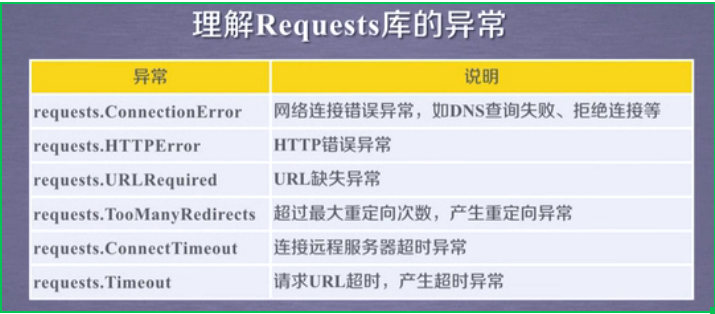

17、错误与异常

遇到网络问题(如:DNS 查询失败、拒绝连接等)时,Requests 会抛出一个ConnectionError 异常。

如果 HTTP 请求返回了不成功的状态码, Response.raise_for_status() 会抛出一个 HTTPError 异常。

若请求超时,则抛出一个 Timeout 异常。

若请求超过了设定的最大重定向次数,则会抛出一个 TooManyRedirects 异常。

所有Requests显式抛出的异常都继承自 requests.exceptions.RequestException 。

18、代码实例

1、第一实例 爬取京东页面商品信息

# 导入requests库 import requests url = "https://item.jd.com/904392.html" # 提前定义需要爬去的链接 # 异常处理 try: r = requests.get(url) # 请求对应url r.raise_for_status() # 因请求页面,如果失败不会产生报错,此代码段含义为,请求失败引发报错 r.encoding = r.apparent_encoding # 以网站备用编码方式替换现有编码方式 print(r.text) # 打印爬去信息 ps:可以进行切片打印例 r.text[:1000] 0到1000字符 except: # 异常返回信息 print("爬取失败")

2、第二实例 爬去亚马逊商品页

# ps:注意对于亚马逊等一些网站,会对网络爬虫进行限制,使其无法爬去或者报错,故需要对请求头进行定制,使爬虫像是用户浏览器访问 # 导入requests库 import requests url = "https://www.amazon.cn/dp/B073LJR2JF/ref=cngwdyfloorv2_recs_0/461-2801729-0564518?pf_rd_m=A1AJ19PSB66TGU&pf_rd_s=desktop-2&pf_rd_r=WTMJFKFD20YEJG0QJ4VY&pf_rd_r=WTMJFKFD20YEJG0QJ4VY&pf_rd_t=36701&pf_rd_p=19fc3fc8-b320-45dc-a7e8-b4ecd543eea8&pf_rd_p=19fc3fc8-b320-45dc-a7e8-b4ecd543eea8&pf_rd_i=desktop" # 提前定义需要爬去的链接 kv = {'user-agent': 'Mozilla/5.0 (Windows NT 10.0; Win64; x64) AppleWebKit/537.36 (KHTML, like Gecko) Chrome/65.0.3325.181 Safari/537.36'} # 模仿谷歌浏览器访问 # 异常处理 try: r = requests.get(url, headers=kv) # 请求对应url,添加请求头 r.raise_for_status() # 因请求页面,如果失败不会产生报错,此代码段含义为,请求失败引发报错 r.encoding = r.apparent_encoding # 以网站备用编码方式替换现有编码方式 print(r.text) # 打印爬去信息 ps:可以进行切片打印例 r.text[:1000] 0到1000字符 except: # 异常返回信息 print("爬取失败")

3、第三实例 调用百度和360搜索接口

# 导入requests库 import requests url = "https://www.baidu.com/s" # 提前定义访问的链接 kv = {'wd': 'mysql'} # 提交搜索请求 # 异常处理 try: r = requests.get(url, params=kv) # 请求对应url,添加请求的键值对 r.raise_for_status() # 因请求页面,如果失败不会产生报错,此代码段含义为,请求失败引发报错 print(r.status_code) # 返回请求状态码 如果是200 为请求成功 print(r.request.url) # 返回请求的url print(len(r.text)) # 获取返回信息的长度 except: # 异常返回信息 print("爬取失败") # 结果 # 200 # https://www.baidu.com/s?wd=mysql ps:wd为百度搜索的请求标识 # 227 ps:意思为获取了227k的信息

4、第四实例 爬去网上图片

# 导入requests库 import requests url = "http://imgsrc.baidu.com/image/c0%3Dshijue1%2C0%2C0%2C294%2C40/sign=4c3880d171899e516c8332572aceb346/0eb30f2442a7d933b157b75fa74bd11373f0011a.jpg" # 提前定义访问的链接 root = "D://123.jpg" # 存储路径 # 异常处理 try: r = requests.get(url) # 请求对应url r.raise_for_status() # 因请求页面,如果失败不会产生报错,此代码段含义为,请求失败引发报错 print(r.status_code) # 返回请求状态码 如果是200 为请求成功 print(r.request.url) # 返回请求的url with open(root, mode="wb") as f: # 将文件以二进制的方式存储到root路径下 f.write(r.content) # 存 except: # 异常返回信息 print("爬取失败") # 结果 # 200 # https://www.baidu.com/s?wd=mysql ps:wd为百度搜索的请求标识

# 导入requests库 import requests import os url = "http://imgsrc.baidu.com/image/c0%3Dshijue1%2C0%2C0%2C294%2C40/sign=4c3880d171899e516c8332572aceb346/0eb30f2442a7d933b157b75fa74bd11373f0011a.jpg" # 提前定义访问的链接 root = "D://img//" # 存储路径 path = root + url.split("/")[-1] # 字符串切割 # 异常处理 try: if not os.path.exists(root): # 如果不存在这个路径则建立此路径 os.mkdir(root) # 建立路径 if not os.path.exists(path): # 如果不存在url路径 r = requests.get(url) # 发起请求 r.raise_for_status() # 因请求页面,如果失败不会产生报错,此代码段含义为,请求失败引发报错 with open(path, mode="wb") as f: # 将文件以二进制的方式存储到root路径下 f.write(r.content) # 存 print("文件存储成功") else: print("文件已经存在") except: # 异常返回信息 print("爬取失败")

5、实例五 ip地址归属度查询

# 导入requests库 import requests url = "http://m.ip138.com/ip.asp?ip=" # 提前定义访问的链接 # 异常处理 try: r = requests.get(url + '202.204.80.112') # 拼接请求内容 r.raise_for_status() # 因请求页面,如果失败不会产生报错,此代码段含义为,请求失败引发报错 r.encoding = r.apparent_encoding # 以网站备用编码形式代替前端显示的编码方式 print(r.text[-500:]) # 打印 except: # 异常返回信息 print("爬取失败")

浙公网安备 33010602011771号

浙公网安备 33010602011771号