RNN原理介绍

RNN原理

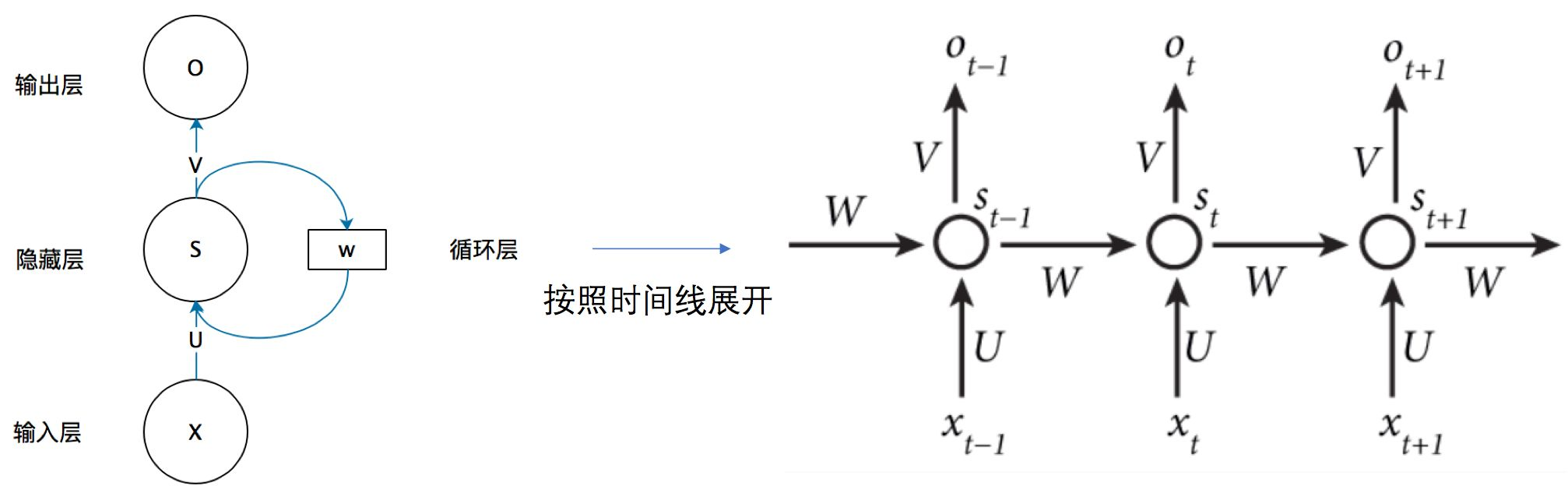

RNN在实际使用的频率并不多,大多使用LSTM替代RNN,因此对RNN进行简单的介绍。RNN是研究LSTM的基础,毕竟LSTM是基于RNN的改良,二者循环原理大体一致。

初识RNN,要记住在时间步上,RNN的权值共享即可。

RNN的运行原理就相当于,每一个时间步利用RNN计算一次得到输出结果,每个时间步上的RNN都是同一个东西。

RNN输入到输出

RNN有两个输入,其中一个输入是RNN运行时的状态,我们无法对其进行操作。

- 输入:

RNN只有两个输入: $ x_t $ 和\(h_{t-1}\)。这两个输入分别为当前时刻的样本输入和上一时刻的隐层状态输入。我们无法操作\(h_{t-1}\),只需要指定\(x_t\)即可。

- 输出:

RNN有两个输出:\(O_t\)和\(h_t\)。这两个输出分别为当前时间步的输出和当前时间步的隐藏层输出。当前隐藏层转态将作为输入参与下一时间步的计算。

由输入到输出\(O_t\)和\(h_t\)的计算公式分别为:

\(h_t=\sigma(U*x_t+V*h_{t-1}+b) \qquad(1)\)

\(O_t=W*h_t+c\qquad(2)\)

输出整个RNN网络的最终结果时,最后一层RNN输出的结果\(O_t\)需要进行一次非线性变换,如果是分类网络,激活函数一般为softmax。

\(\widetilde y_t =f(O_t) \qquad(3)\)

RNN优缺点

优点:

- 处理短序列,循环神经网络工作的比较好。

缺点:

- 不能处理长序列问题,原因是RNN循环相乘相乘导致梯度消失或者梯度爆炸,几乎不可训练

- RNN的这种利用上一步的输出作为上一时间步的信息输入到当前时间步,在任意时间步处理中,只参考了前面时间步的特征,序列后方没有学到更前面的时间步的特征。因此引出了BRNN。

RNN梯度消失或者梯度爆炸的原因和解决办法

在RNN反向传播中,需要求\(h_t\)相对权重V的偏导数,而这时由于有\(h_{t-1}\),\(h_{t-1}\)又是关于V的函数,根据链式求导法则,需要求\(h_t\)对\(h_{t-1}\)的偏导数,一直回溯1~(t-1)所有时刻的信息,于是会存在连乘项\(\prod {\partial h_t \over \partial h_{t-1}}\)

。

根据(1)式可知,\({\partial h_t \over \partial h_{t-1}}\)偏导数为:\(\sigma'*V\),连乘之后,会有\(\sigma'\)连乘。由于RNN使用sigmod激活函数,其导数范围在[0,0.25]之间,那么当V>4时会产生梯度爆炸,而当V<4时会产生梯度消失。

所以RNN在处理长序列时,会导致梯度消失和梯度爆炸。梯度爆炸可以采取clip,但是梯度消失比较难以解决。

浙公网安备 33010602011771号

浙公网安备 33010602011771号