[PaperReading] Generative Recommendation with Semantic IDs: A Practitioner’s Handbook

Generative Recommendation with Semantic IDs: A Practitioner’s Handbook

link

时间:25.07

单位:Snap Inc.

相关领域:Generative recommendation (GR)

作者相关工作:Mingxuan Ju

被引次数:1200

项目主页:https://github.com/snap-research/GRID

TL;DR

语义ID(SID)是生成式推荐GR能够成功的关键因素之一,它将连续的语义表示(From LLM)转换为离散的ID序列。已有方法的实验设置、超参多样性使得多种GR方案之间对比难度较大。本工作引入并开源了一个基于语义ID的生成式推荐框架,即 GRID。通过利用GRID在公开的基准数据集上系统地测试与消融实验,实验表明:GR模型中许多被忽视的架构组件,以及带有 SID 的组件,都会对性能产生显著影响。

Method

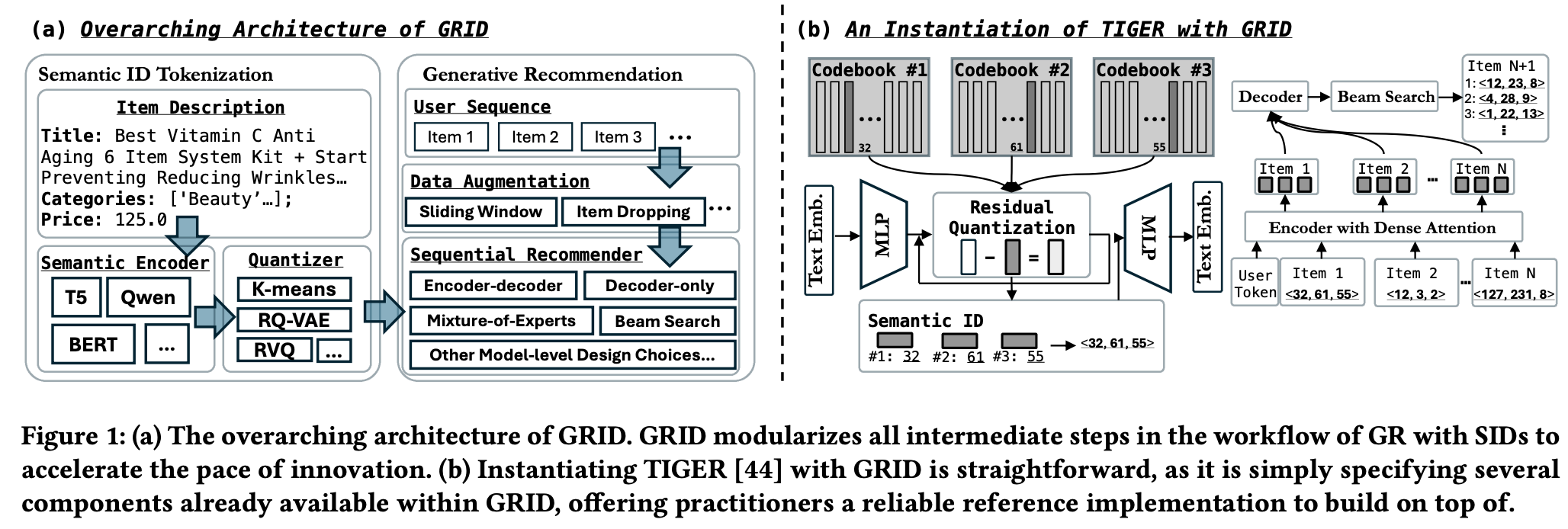

3. 解释Figure 1

Figure 1展示了GRID框架的总体架构,分为两个主要部分:

- 总体架构(Overarching Architecture)

- 模态特征 → 模态编码器 → 项目嵌入 → SID标记化器 → 语义ID序列

- 用户交互序列 + SID → 生成模型 → 候选生成

- 工作流程:

- 标记化阶段:使用预训练的模态编码器(如T5)将物品的语义特征转换为嵌入表示,然后通过分层聚类标记器映射为SID序列

- 生成阶段:给定用户的历史交互序列及其SID,使用生成模型(如Transformer)自回归地预测用户下一个可能交互物品的SID

(b) TIGER实例化

展示了如何使用GRID组件具体实现TIGER模型:

- 模态编码器:T5编码器生成项目表示

- 标记化器:RQ-VAE生成SID

- 生成模型:基于Transformer的序列推荐器

Experiment

关键洞察:复杂度≠性能

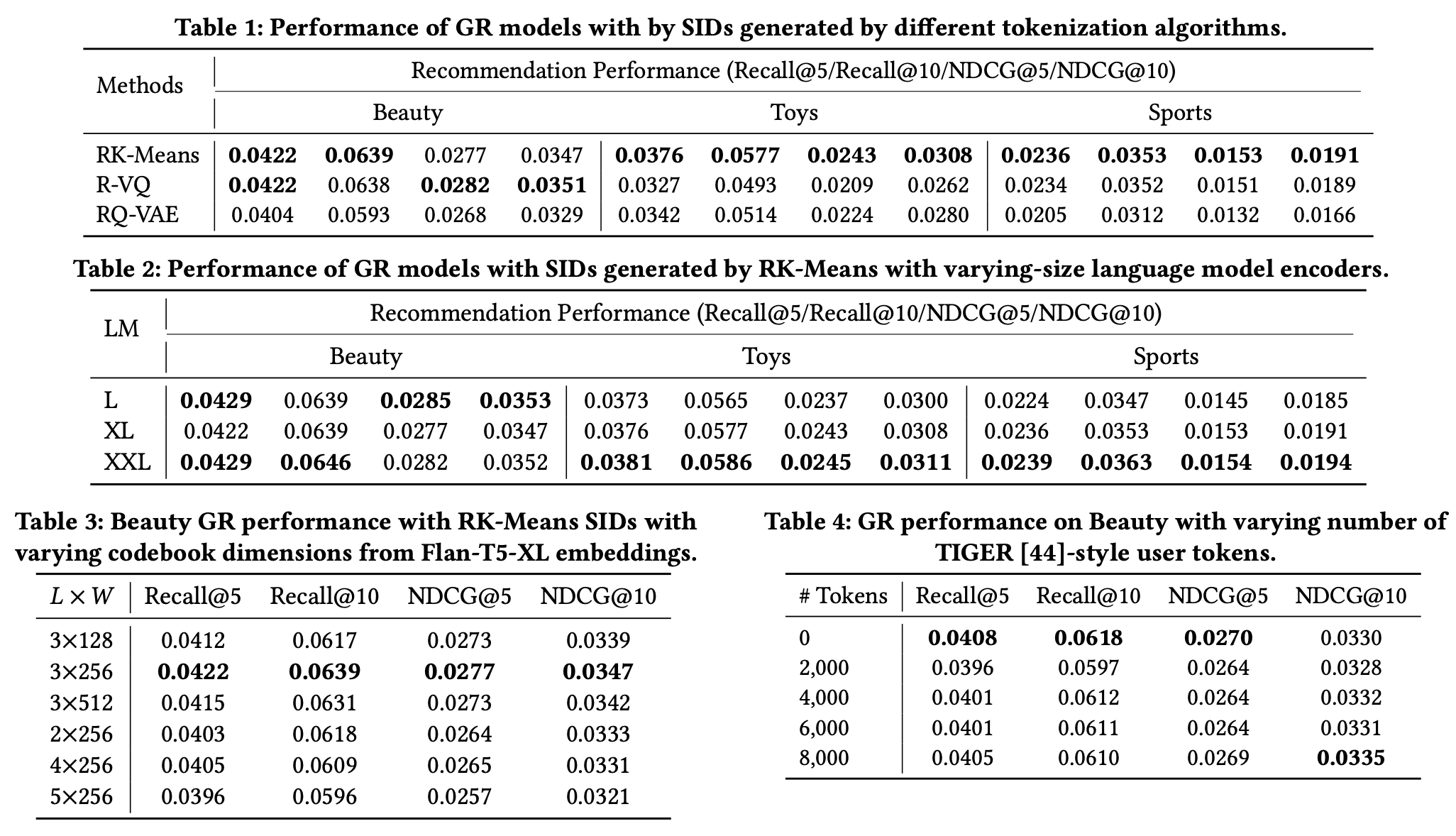

论文Table 1的一个重要发现是:

更简单的算法(RK-Means)反而比更复杂的RQ-VAE表现更好

这挑战了传统认知,说明在GR流水线中:

实现简洁性可能比算法复杂度更重要

训练稳定性:RQ-VAE需要同时优化编码器和量化器,容易出现训练挑战

工程效率:RK-Means训练更快(只需1k步/层 vs RQ-VAE的15k步)

Q&A

- 为什么生成式推荐(GR)的关键贡献是 “Semantic ID将连续的语义表征转换为离散ID序列”?

- 背景解释:

- 连续语义表示:指从LLM或视觉语言模型提取的d维向量表示(如Flan-T5生成的嵌入)

- 离散ID序列:通过聚类算法(如RK-Means、R-VQ、RQ-VAE)将连续向量转换为离散的符号序列

- 核心价值:

- 语义信息与协同过滤:SID能够将预训练基础模型(如LLM)中的语义知识与用户-物品交互历史中的协同信号相结合

- 离散化表示:将连续的语义表示转换为离散的ID序列,既保留了语义相似性,又便于生成模型的解码操作

- 可扩展性:解决了传统推荐系统中为每个物品分配唯一、无信息ID带来的可扩展性问题

- 为什么说Table1中RK-Means、R-VQ、RQ-VAE 是不同的tokenizer算法?它们好像是不同的聚类算法?

- 为什么它们被称为“Tokenizer算法”?

在生成式推荐中,Semantic ID的生成过程本质上就是一个标记化(tokenization)过程,类似于NLP中将文本转换为token ID序列:- NLP类比:文本 → 分词器 → token ID序列

- GR类比:物品嵌入向量 → 量化器 → Semantic ID序列

- 三种算法的技术区别

- RK-Means (Residual K-Means)

工作原理:分层K-means,每一层对前一层的残差进行聚类

特点:简单高效,无需训练神经网络编码器

在论文中的表现:Table 1显示性能最好或接近最好 - R-VQ (Residual Vector Quantization)

工作原理:类似RK-Means,但基于向量量化的理论框架

特点:有更严格的理论基础,训练使用Adam优化器

性能:与RK-Means相当,有时稍差 - RQ-VAE (Residual Quantized Variational Autoencoder)

工作原理:结合自编码器和残差量化的端到端神经网络

特点:最复杂,需要同时训练编码器和量化器

论文发现:尽管在文献中最常用,但性能反而不如简单的RK-Means

- RK-Means (Residual K-Means)

总结与思考

无

相关链接

https://zhuanlan.zhihu.com/p/1948788125842248769

https://zhuanlan.zhihu.com/p/1937437049713066044

小红书

本文来自博客园,作者:fariver,转载请注明原文链接:https://www.cnblogs.com/fariver/p/19234698

浙公网安备 33010602011771号

浙公网安备 33010602011771号