Spark Core:创建RDD

#方式一:把数据并行化分片到节点

sc.parallelize(Array(1,2,3,4))

#方式二:把数据并行化分片到节点

sc.makeRDD(Array(1,2,3))

#方式三:可以指定RDD的存放位置

#创建一个list集合

val list1=List((1,List("Hello","Word","spark")),(2,List("at","as")))

#将List集合放入RDD

val rdd1=sc.makeRDD(list1)

#方式四:从文件创建

sc.textFile("/root/wc.txt")

#获取rdd1的分区下标为1的内容

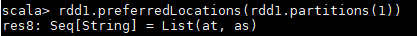

rdd1.preferredLocations(rdd1.partitions(1))

结果如下

浙公网安备 33010602011771号

浙公网安备 33010602011771号