2.安装Spark与Python练习

一、安装Spark

- 检查基础环境hadoop,jdk

- 下载spark

- 解压,文件夹重命名、权限

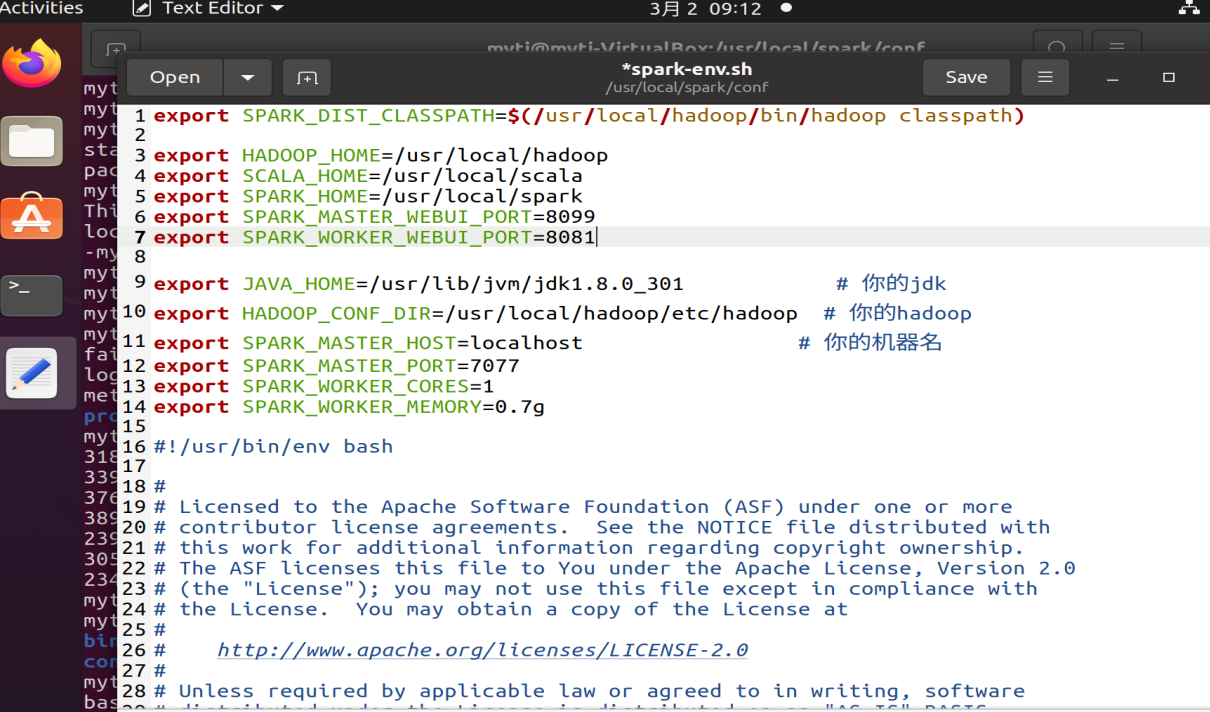

- 配置文件

- 环境变量

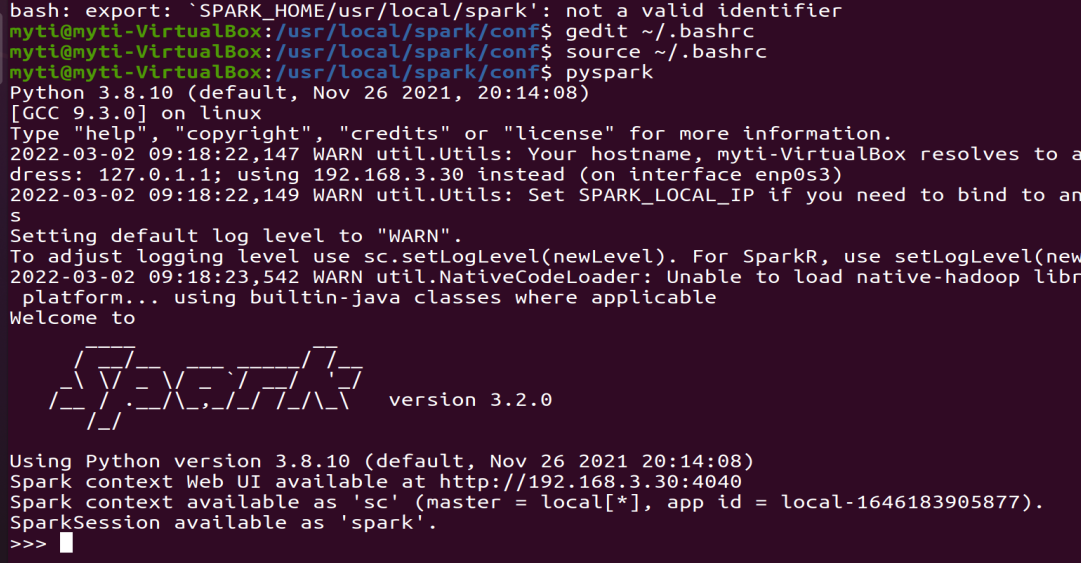

- 试运行Python代码

二、Python编程练习:英文文本的词频统计

- 准备文本文件

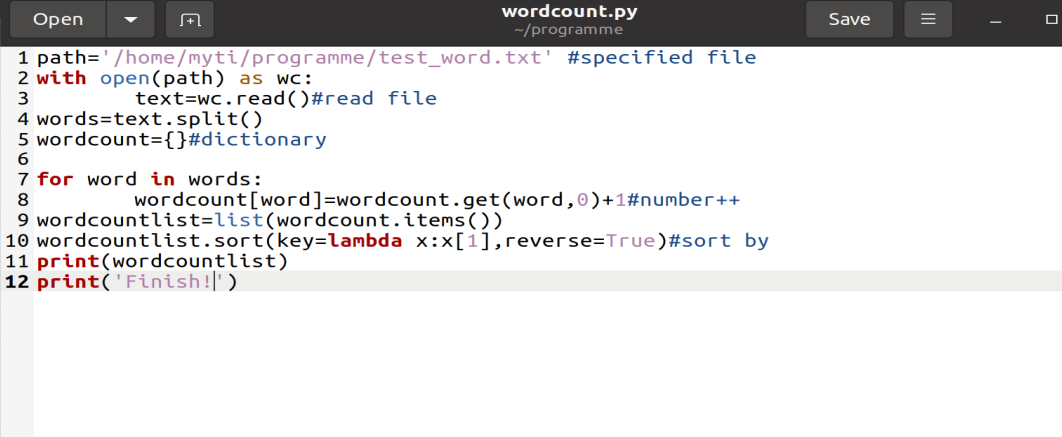

- 读文件

- 预处理:大小写,标点符号,停用词

- 分词

- 统计每个单词出现的次数

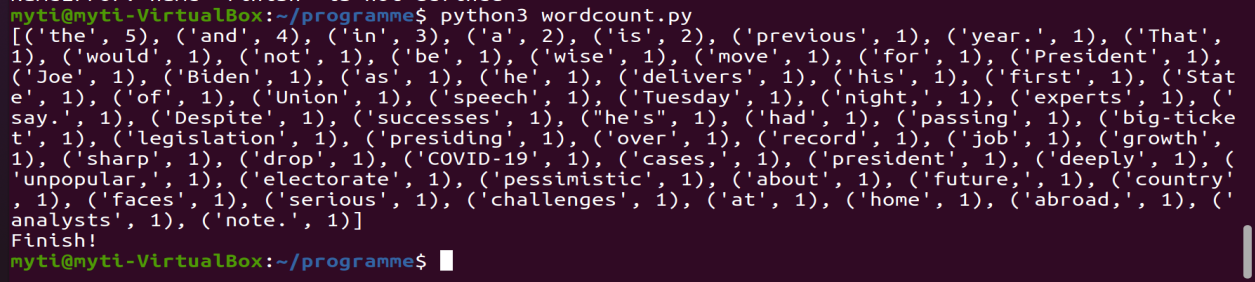

- 按词频大小排序

- 结果写文件

![]()

![]()

-

path='/home/myti/programme/test_word.txt' #specified file with open(path) as wc: text=wc.read()#read file words=text.split() wordcount={}#dictionary for word in words: wordcount[word]=wordcount.get(word,0)+1#number++ wordcountlist=list(wordcount.items()) wordcountlist.sort(key=lambda x:x[1],reverse=True)#sort by print(wordcountlist) print('Finish!')三、根据自己的编程习惯搭建编程环境(选做)

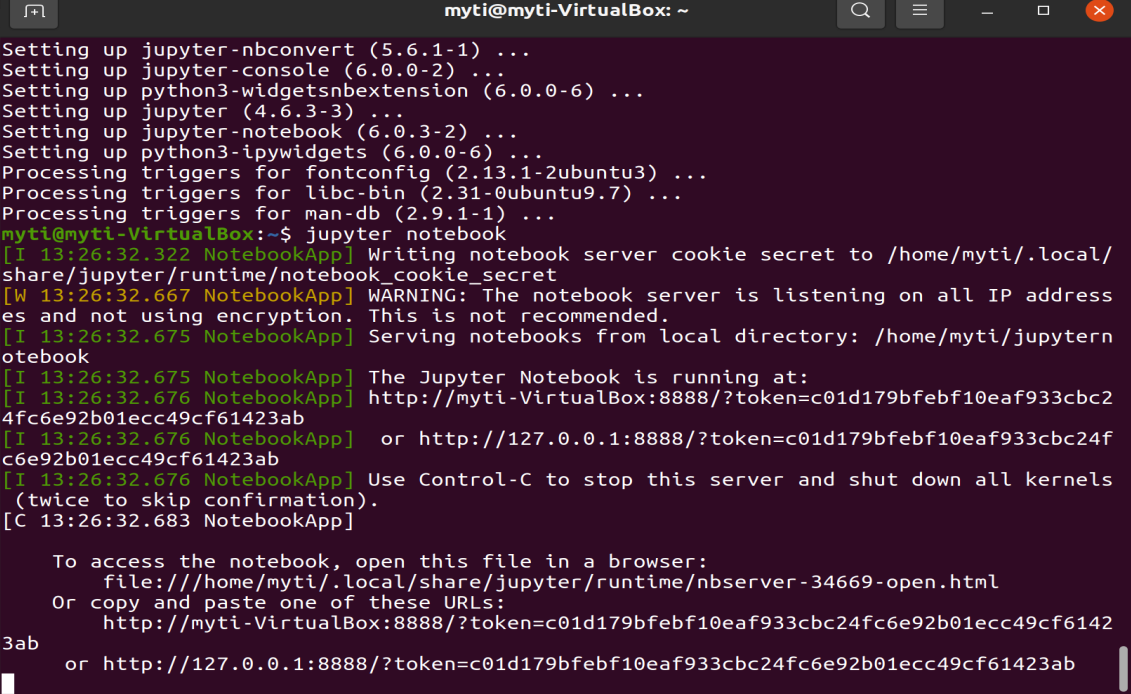

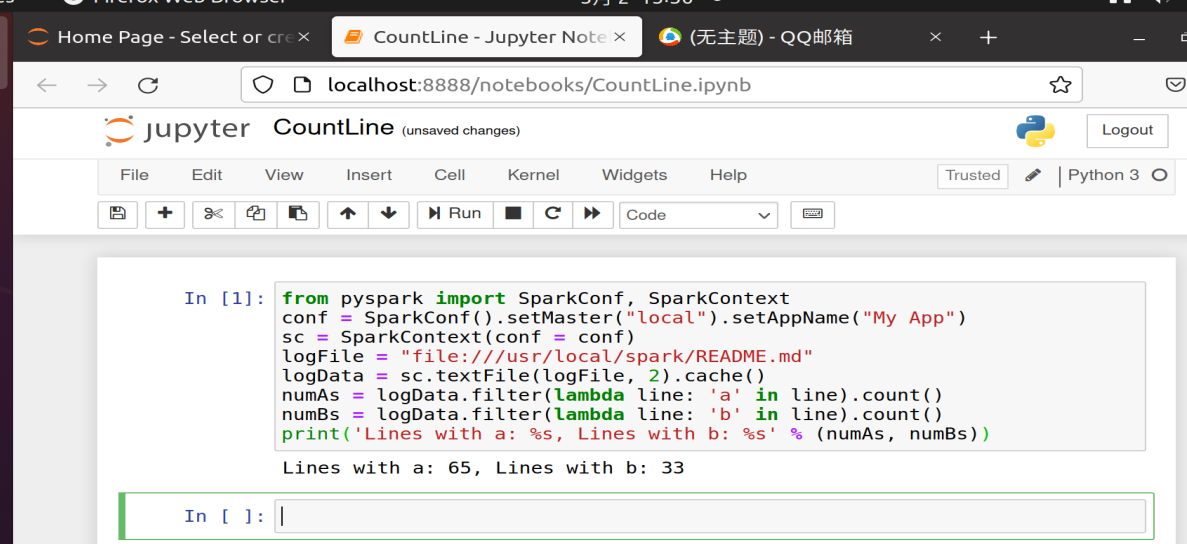

- 使用Jupyter Notebook调试PySpark程序:参考http://dblab.xmu.edu.cn/blog/2575-2/

- 使用PyCharm参考:Ubuntu 16.04 + PyCharm + spark 运行环境配置https://blog.csdn.net/zhurui_idea/article/details/72982598

![]()

![]()

![]()

三、根据自己的编程习惯搭建编程环境(选做)

- 使用Jupyter Notebook调试PySpark程序:参考http://dblab.xmu.edu.cn/blog/2575-2/

- 使用PyCharm参考:Ubuntu 16.04 + PyCharm + spark 运行环境配置https://blog.csdn.net/zhurui_idea/article/details/72982598

浙公网安备 33010602011771号

浙公网安备 33010602011771号