第二次作业_软工第5组

马俊腾:对人工智能的历史、深度学习和机器学习有了一些了解,我觉得它对于工业领域能够产生很大的作用,尽管它现在还不算真正的有智能,但是慢慢发展会有很大的空间的。另外对于知识方面,了解到机器学习分为监督式学习和非监督式学习这些知识等等,但是对于我的实践的话,我觉得还得多练。

蒋梦琦:人工智能 > 机器学习 > 深度学习,深度学习发展三要素 - 算法(学术界),算力(工业界),数据(工业界),人工智能不是突然火起来的,是数十年的积累,无数学者不断迭代至今的成果。通过学习绪论和深度学习概述,了解了深度学习的基础概念和神经网络的入门知识,感觉比去年能多看懂了一些,前方的路还很长,还要好好学。

刘瑞帅:通过本次视频学习我理解了深度学习及神经网络背后的理论知识,在以大数据为背景的时代下人工智能得以飞速发展,我相信在后面的学习中我会越来越能理解人工智能的相关知识。并且能够特别出色地完成老师布置的任务。

任晟:

吴淳桐: 深度学习是机器学习研究中的一个新的领域,其动机在于建立、模拟人脑进行分析学习的神经网络,它模仿人脑的机制来解释数据,例如图像,声音和文本。深度学习是无监督学习的一种。

1、自然语言处理、语音识别、用户画像、无人驾驶……这些和深度神经网络(即深度学习)相关的技术在最近几年突然火了起来,随着AI、机器学习和智能机器人变得越来越普遍,在这些机器人将在制造、培训、销售、维修和车队管理方面担任新的岗位。人工智能和机器人将能够实现今天难以想象的新服务。但很显然,医疗保健和交通运输将是AI第一批颠覆的行业。

2、深度学习的进展和计算能力的提高和数据的增长密不可分。

3、如果是一辆无人驾驶车出现了错误,不但它自己会从中吸取教训,所有其他的无人驾驶车甚至是所有未来的无人驾驶车,也将从中获得新的经验。这意味着,一个错误就能训练世界上所有的无人驾驶车,无人车的学习速度远远超过了人类。

钟良胜:看完两个视频了解到了很多人工智能的知识,原来由浅入深地分成了人工智能、机器学习以及深度学习三个阶段。机器学习主要依靠数据经验,由模型、策略和算法三个因素决定。同时也了解到目前理论知识方面已经研究的较为深入了,但应用方面还没有跟上,这就属于机器学习的范畴了。第一个视频大概能看懂,第二个视频后面很多抽象的概念和解释看不太懂。

1.2遇到的问题

(1)为什么算法有时候会陷入局部最优?

(2)如何选择合适的初始权值?

(3)如何选择学习率?

(4)为什么sigmoid函数现在已经不再适用了?

(5)选择loss函数时应该注意什么?

(6)自编码器有那些用途?

(7)很多模型涉及到物理定理和公式,比如能量的玻尔兹曼分布,没怎么听懂;

(8)DBN(深度信念网络)有什哪些应用?

(9)好多种N(网络),看很多模型推导和图示,还是觉得很抽象,应该是因为没太多实践。

(10) 对于模型层级复合程度(图片),模型增量性等概念不太理解,还有机器可以怎样继承知识(介质、方法)?神经网络非线性变化部分也不懂(涉及到隐层好像)。

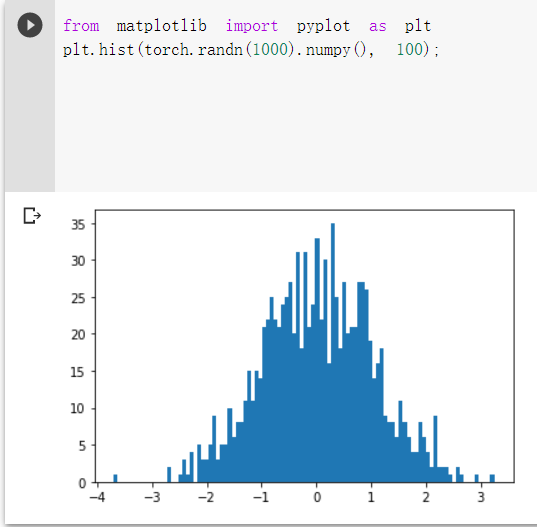

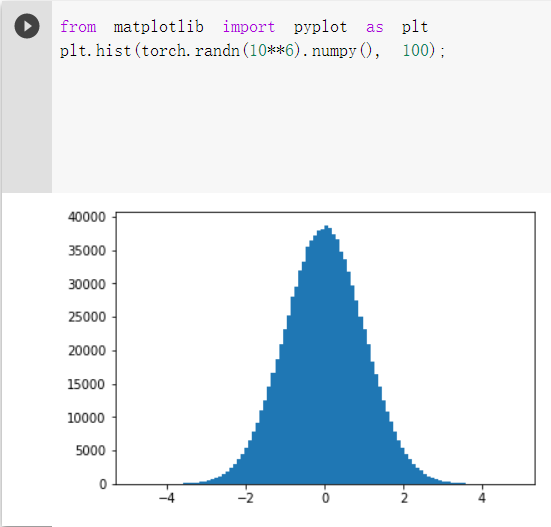

2.1 pytorch基础练习

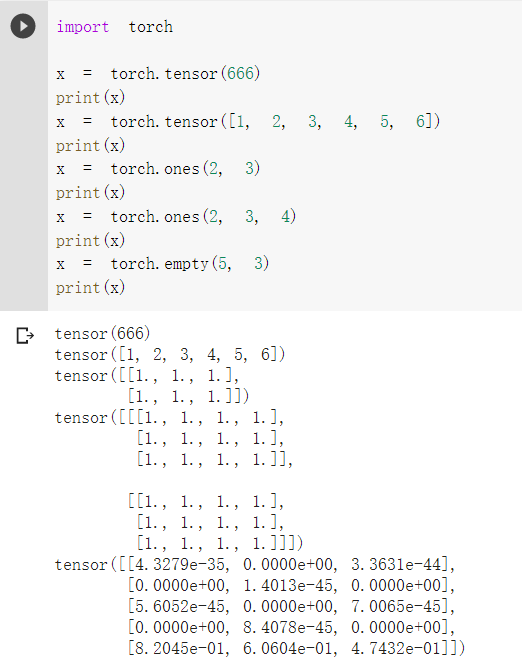

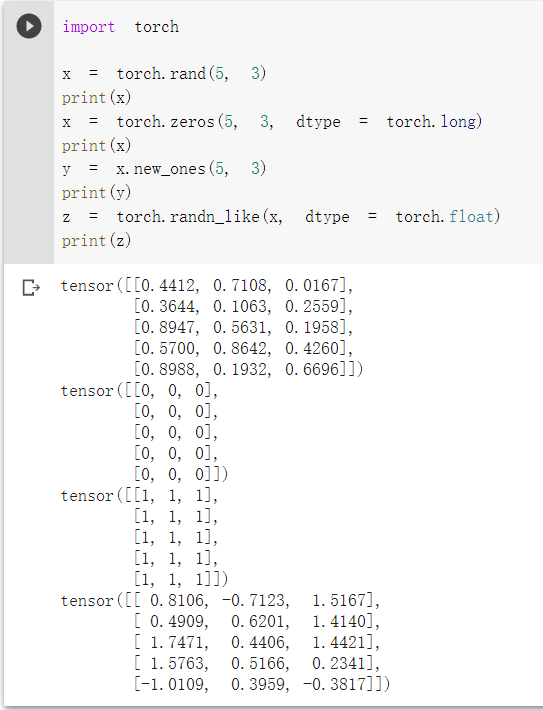

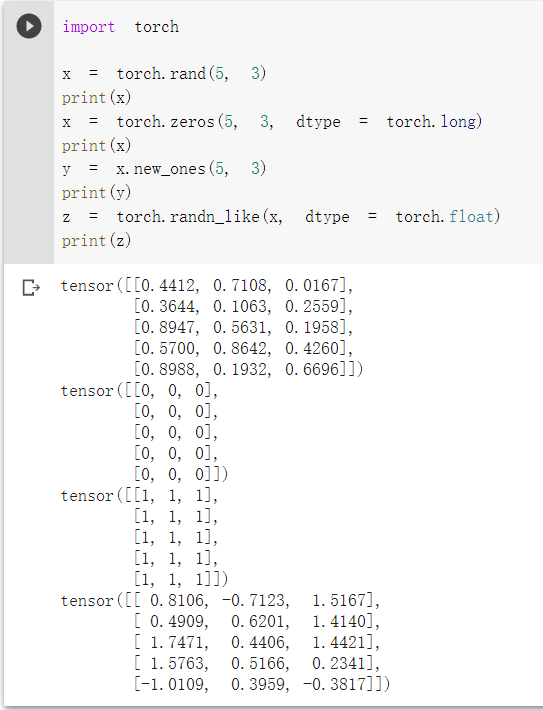

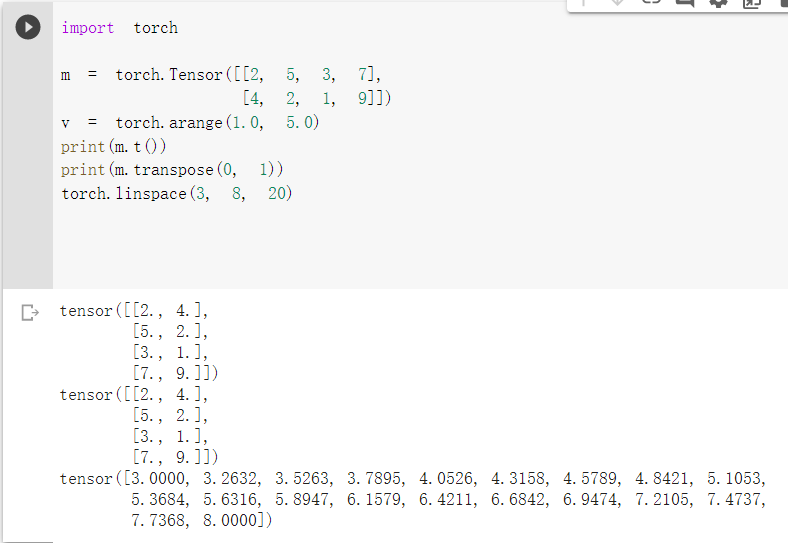

2.1.1定义数据

2.1.2定义操作

遇到的问题:

按照博客中使用Tensor时创建的是float类型的张量组,m = torch.Tensor([[2, 5, 3, 7], [4, 2, 1, 9]]),由于v = torch.arange(1, 5)创建为long类型组,会出现RuntimeError: expected scalar type Float but found Long的错误;把1和5改为1.0和5.0即可解决问题。

第一个基础练习是练习了一下torch.Tensor的使用,可以用它来表示各种数字类型以及运算。

创建张量很方便,统计数据十分方便。

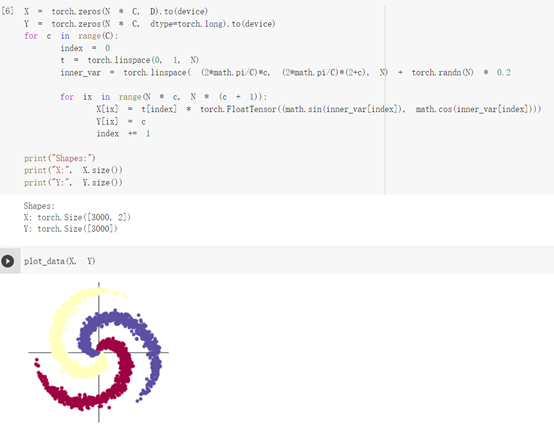

2.2螺旋数据分类

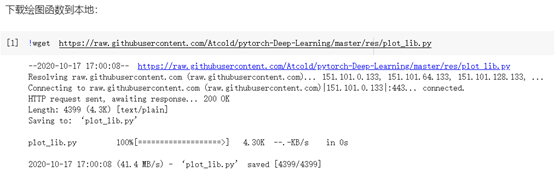

wget是一个下载文件的组件,只要url正确可以下载任何东西,视频、音乐、软件包等等。wget工具体积小但功能完善,它支持断点下载功能,同时支持FTP和HTTP下载方式,支持代理服务器,设置起来方便简单。

首先画出用于识别的spiral:

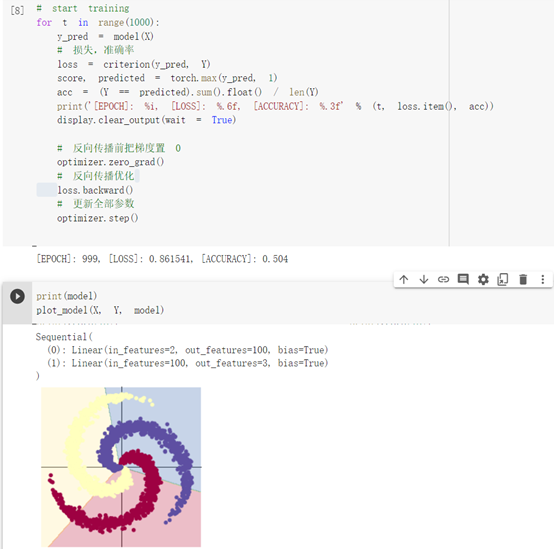

然后构建线性模型来分类

线性模型的准确率最高只能达到50%左右,难以做到准确分类。

在反向传播前将梯度置零,可以做到梯度累加,实现了batchsize的变相扩大,是一个很好的反向传播技巧。

再构建两层神经网络分类

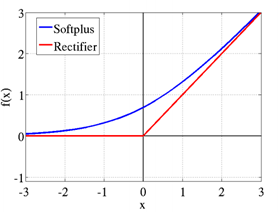

ReLU非线性激活函数是中间层,让分类的边界变成非线性的,更贴合螺旋。

第二个实验是对数据进行分类,应用了非线性变化,和第二个视频里看到的一样,在两层神经网络里加入 ReLU 激活函数以后,新的激活函数解析性质更好,克服了sigmoid函数和tanh函数的梯度消失问题,分类的准确率得到了显著提高。

浙公网安备 33010602011771号

浙公网安备 33010602011771号